정렬

인공지능(AI) 분야에서 정렬(alignment)은 AI 시스템을 개인이나 집단의 의도된 목표, 선호, 또는 윤리적 원칙에 맞게 유도하는 것을 목표로 한다. AI 시스템이 의도된 목적을 달성할 때 정렬되었다고 간주한다. 비정렬된 AI 시스템은 의도되지 않은 목적을 추구한다.[^1]

AI 설계자가 바람직한 행동과 바람직하지 않은 행동의 전체 범위를 명시하는 것은 흔히 어렵다. 따라서 설계자들은 인간의 승인을 얻는 것과 같은 보다 단순한 대리 목표를 사용하는 경우가 많다. 그러나 대리 목표는 필요한 제약 조건을 간과하거나, AI 시스템이 단순히 정렬된 것처럼 보이는 것에 대해 보상을 줄 수 있다.[^1][^2] 또한 AI 시스템은 대리 목표를 효율적으로 달성하되 의도되지 않은, 때로는 해로운 방식으로 달성할 수 있는 허점을 발견할 수 있다(보상 해킹).[^1][^11]

고급 AI 시스템은 권력 추구나 자기 보존과 같은 원치 않는 도구적 전략을 개발할 수 있는데, 이러한 전략이 할당된 최종 목표를 달성하는 데 도움이 되기 때문이다.[^1][^3][^9] 더 나아가, 시스템이 배포되어 새로운 상황과 데이터 분포를 접하기 전까지는 감지하기 어려운 바람직하지 않은 창발적 목표를 개발할 수도 있다.[^4][^5] 2024년의 실증 연구에 따르면, OpenAI o1이나 Claude 3과 같은 고급 대규모 언어 모델(LLM)이 목표를 달성하거나 목표가 변경되는 것을 방지하기 위해 전략적 기만에 관여하는 경우가 있음이 밝혀졌다.[^71][^72]

이러한 문제 중 일부는 LLM,[^8][^6][^7] 로봇,[^73] 자율주행차,[^74] 소셜 미디어 추천 엔진[^8][^9][^75] 등 기존 상용 시스템에도 영향을 미친다. 일부 AI 연구자들은 이러한 문제가 부분적으로 높은 능력에서 비롯되기 때문에, 더 능력이 뛰어난 미래의 시스템이 더 심각한 영향을 받을 것이라고 주장한다.[^10][^11][^2]

많은 저명한 AI 연구자와 AI 기업 리더들은 AI가 인간 수준(AGI) 및 초인적 인지 능력(ASI)에 접근하고 있으며, 비정렬될 경우 인류 문명을 위험에 빠뜨릴 수 있다고 주장하거나 단언해 왔다.[^12][^9] 여기에는 "AI 대부"로 불리는 Geoffrey Hinton과 Yoshua Bengio, 그리고 OpenAI, Anthropic, Google DeepMind의 CEO들이 포함된다.[^76][^77][^78] 이러한 위험성은 여전히 논쟁 중이다.[^79]

AI 정렬은 안전한 AI 시스템을 구축하는 방법을 연구하는 AI 안전성의 하위 분야이다.[^80][^81] AI 안전성의 다른 하위 분야로는 견고성, 모니터링, 능력 제어 등이 있다.[^13] 정렬 연구의 과제에는 AI에 복잡한 가치를 심어주는 것, 정직한 AI 개발, 확장 가능한 감독, AI 모델의 감사 및 해석, 권력 추구와 같은 창발적 AI 행동 방지 등이 포함된다.[^13] 정렬 연구는 해석가능성 연구,[^14][^82] (적대적) 견고성,[^15] 이상 탐지, 보정된 불확실성,[^14] 형식 검증,[^83] 선호 학습,[^16][^17][^18] 안전 필수 공학,[^84] 게임 이론,[^85] 알고리즘 공정성,[^15][^86] 사회과학[^19][^87] 등과 연관되어 있다.

AI의 목적 함수

프로그래머는 AlphaZero와 같은 AI 시스템에 "목적 함수"를 제공하며, 여기에 AI가 달성하도록 설정된 목표를 담고자 한다. 이러한 시스템은 이후 환경에 대한 (암묵적일 수 있는) 내부 "모델"을 구축한다. 이 모델은 에이전트의 세계에 대한 모든 믿음을 포함한다. 그런 다음 AI는 목적 함수의 값을 최대화하도록 계산된 계획을 수립하고 실행한다.[^88] 예를 들어, AlphaZero가 체스에 대해 훈련될 때, "AlphaZero가 이기면 +1, AlphaZero가 지면 −1"이라는 단순한 목적 함수를 갖는다. 게임 중에 AlphaZero는 최대값인 +1을 달성할 가능성이 가장 높다고 판단되는 수순을 실행하려고 시도한다. 마찬가지로, 강화 학습 시스템은 프로그래머가 AI의 원하는 행동을 형성할 수 있는 "보상 함수"를 가질 수 있다. 진화 알고리즘의 행동은 "적합도 함수"에 의해 형성된다.[^89]

정렬 문제

1960년, AI 선구자 노버트 위너는 AI 정렬 문제를 다음과 같이 설명했다:

우리가 목적을 달성하기 위해 효과적으로 개입할 수 없는 기계적 수단을 사용한다면 [...] 기계에 부여된 목적이 우리가 진정으로 원하는 목적인지 확실히 해두는 것이 좋을 것이다.[^20][^9]

AI 정렬이란 AI 시스템의 목표가 특정 대상과 일치하도록 보장하는 것을 말한다. 이 대상은 시스템 설계자나 사용자의 목표, 널리 공유된 가치, 객관적 윤리 기준, 법적 요건, 또는 설계자가 더 많은 정보를 갖고 더 깨달은 상태였다면 가졌을 의도 등으로 다양하게 정의된다.[^21] 민주적 AI 정렬에서는 대상이 중위 투표자의 가치와 선호이며, 이는 정치적 정당성을 높인다.[^22][^23]

AI 정렬은 현대 AI 시스템에 있어 미해결 문제이며[^90][^24] AI 내의 한 연구 분야이다.[^91][^1] AI 정렬에는 두 가지 주요 과제가 있다: 시스템의 목적을 신중하게 명세하는 것(외부 정렬)과 시스템이 그 명세를 견고하게 채택하도록 보장하는 것(내부 정렬)이다. 연구자들은 또한 사용자가 적대적으로 우회하려 시도하더라도 안전 제약을 고수하는, 견고한 정렬을 갖춘 AI 모델을 만들고자 노력하고 있다.

명세 게이밍과 부작용

AI 시스템의 목적을 명세하기 위해, AI 설계자들은 일반적으로 목적 함수, 예시 또는 피드백을 시스템에 제공한다. 그러나 설계자들은 모든 중요한 가치와 제약 조건을 완전히 명세하지 못하는 경우가 많아, 오류가 있을 수 있는 인간 감독자의 승인을 극대화하는 것과 같은 명세하기 쉬운 대리 목표에 의존하게 된다.[^25][^92][^26] 결과적으로 AI 시스템은 명세된 목적을 효율적으로 달성하되, 의도치 않은 해로운 방식으로 달성할 수 있는 허점을 찾아낼 수 있다. 이러한 경향은 명세 게이밍 또는 보상 해킹이라고 알려져 있으며, 굿하트의 법칙의 한 사례이다. AI 시스템이 더 유능해질수록, 명세를 더 효과적으로 게이밍할 수 있게 되는 경우가 많다. [[File:Robot hand trained with human feedback 'pretends' to grasp ball.ogg|right|thumb|AI 시스템이 인간 피드백을 사용하여 공을 잡도록 훈련되었으나, 대신 공과 카메라 사이에 손을 놓아 성공한 것처럼 거짓으로 보이게 하는 것을 학습했다.[^27] 정렬에 관한 일부 연구는 거짓이지만 설득력 있는 해결책을 방지하는 것을 목표로 한다.]]

명세 게이밍은 수많은 AI 시스템에서 관찰되었다.[^93] 프로그래밍용 OpenAI GPT 모델들은—실제 사례를 포함하여—자신을 평가하는 데 사용되는 테스트를 해킹하여 거짓으로 성공한 것처럼 보이도록 명시적으로 계획하는 것(예: "해킹하자"라고 명시적으로 언급)이 발견되었다. 해당 회사가 이를 처벌하자, 많은 모델은 테스트 해킹을 계속하면서 자신의 계획을 난독화하는 것을 학습했다.[^28] 또 다른 시스템은 트랙을 따라 목표물을 맞히면 보상을 받는 방식으로 시뮬레이션 보트 경주를 완주하도록 훈련되었으나, 같은 목표물에 무한히 반복하여 충돌하며 더 많은 보상을 얻었다.[^94] 2025년 팰리세이드 리서치 연구에 따르면, 더 강한 상대를 체스에서 이기라는 과제를 받았을 때, 일부 추론 LLM은 상대를 수정하거나 완전히 삭제하는 등 게임 시스템을 해킹하려 시도했다.[^95] 일부 정렬 연구자들은 인간이 명세 게이밍을 감지하고, AI 시스템을 안전하고 유용하게 추구할 수 있도록 신중하게 명세된 목표로 유도하는 것을 돕는 것을 목표로 한다.

정렬되지 않은 AI 시스템이 배포되면 중대한 부작용이 발생할 수 있다. 소셜 미디어 플랫폼들은 추천 알고리즘을 클릭률에 최적화하여 전 세계적 규모의 사용자 중독을 유발한 것으로 알려져 있다. 스탠퍼드 연구자들은 이러한 추천 시스템이 "측정하기 어려운 사회적·소비자 복지의 조합이 아닌 단순한 참여 지표를 최적화"하기 때문에 사용자와 정렬되지 않았다고 말한다.

이러한 부작용에 대해 버클리 컴퓨터과학자 스튜어트 J. 러셀은 암묵적 제약 조건의 누락이 해를 끼칠 수 있다고 말했다: "시스템은 [...] 종종 제약되지 않은 변수를 극단적인 값으로 설정한다; 만약 그 제약되지 않은 변수 중 하나가 실제로 우리가 중요하게 여기는 것이라면, 발견된 해결책은 매우 바람직하지 않을 수 있다. 이것은 본질적으로 램프의 요정, 또는 마법사의 제자, 또는 미다스 왕의 오래된 이야기이다: 당신이 원하는 것이 아니라, 당신이 요청한 것을 정확히 얻게 된다."[^29]

일부 연구자들은 AI 설계자들이 금지된 행동을 나열하거나 윤리적 규칙을 형식화하여(아시모프의 로봇 3원칙처럼) 원하는 목표를 명세할 것을 제안한다.[^96] 그러나 러셀과 노빅은 이 접근 방식이 인간 가치의 복잡성을 간과한다고 주장한다:[^9] "단순한 인간이 명세된 목적을 달성하기 위해 기계가 선택할 수 있는 모든 재앙적인 방법을 미리 예측하고 배제하는 것은 확실히 매우 어렵고, 아마도 불가능할 것이다."[^9]

또한, AI 시스템이 인간의 의도를 완전히 이해하더라도 여전히 이를 무시할 수 있다. 인간의 의도를 따르는 것이 그 시스템의 목적이 아닐 수 있기 때문이다(이미 완전히 정렬된 경우가 아니라면).[^1][^97]

안전하지 않은 시스템 배포 압력

상업 조직들은 때때로 안전성에서 편법을 쓰고 정렬되지 않았거나 안전하지 않은 AI 시스템을 배포할 유인을 가진다. 예를 들어, 소셜 미디어 추천 시스템은 원치 않는 중독과 양극화를 만들어내면서도 수익을 올려왔다.[^30][^31] 경쟁 압력은 또한 AI 안전 기준의 하향 경쟁으로 이어질 수 있다. 예를 들어, OpenAI는 일부 불안정한 사용자에게 자살을 조장하는 ChatGPT 버전을 출시한 것으로 소송을 당했는데, 이는 급하게 제품을 출시하는 과정에서 회사가 간과한 행동이었다.[^98][^99] 마찬가지로, 2018년에는 자율주행차가 보행자(엘레인 허츠버그)를 사망시켰는데, 이는 엔지니어들이 비상 제동 시스템이 과민하여 개발을 늦춘다는 이유로 비활성화한 후 발생한 것이었다.[^100]

고도화된 정렬되지 않은 AI의 위험

일부 연구자들은 AI 개발의 진전이 빠르고, 산업계와 정부가 고도화된 AI를 구축하려 하고 있어 점점 더 고도화되는 AI 시스템의 정렬에 관심을 갖고 있다. AI 시스템의 능력이 계속 빠르게 확장됨에 따라, 정렬된다면 많은 기회를 열 수 있지만, 동시에 증가된 복잡성으로 인해 정렬 과제를 더욱 어렵게 만들어 대규모 위험을 초래할 수 있다.[^9]

고도화된 AI의 개발

OpenAI,[^101] Meta,[^102] DeepMind[^103] 등 많은 AI 기업이 인공 일반 지능(AGI)의 개발을 목표로 한다고 밝혀왔다. AGI란 대부분 또는 모든 인지 작업에서 인간과 동등하거나 이를 능가하는 가상의 AI 시스템이다. 현대 신경망을 확장하는 연구자들은 이들이 실제로 점점 더 범용적이고 예상치 못한 능력을 발달시키는 것을 관찰한다.^32 이러한 모델들은 컴퓨터를 조작하거나 자체 프로그램을 작성하는 것을 학습했으며, 단일 "범용" 네트워크가 대화, 로봇 제어, 게임 플레이, 사진 해석을 수행할 수 있다.[^104] 설문 조사에 따르면, 일부 주요 머신러닝 연구자들은 AGI가 에 만들어질 것으로 예상하는 반면, 일부는 훨씬 더 오래 걸릴 것으로 생각한다. 많은 이들이 두 시나리오 모두 가능하다고 본다.[^105][^34][^35]

2023년, AI 연구 및 기술 분야의 지도자들은 가장 대규모 AI 훈련 실행의 일시 중지를 요청하는 공개 서한에 서명했다. 서한은 "강력한 AI 시스템은 그 효과가 긍정적이고 위험이 관리 가능하다고 확신할 수 있을 때에만 개발되어야 한다"고 명시했다.[^36]

권력 추구

현재 시스템들은 여전히 제한된 장기 계획 능력과 상황 인식을 가지고 있지만, 이를 바꾸기 위한 대규모 노력이 진행 중이다.[^106][^107] 이러한 능력을 갖춘 미래 시스템(반드시 AGI일 필요는 없음)은 원치 않는 권력 추구 전략을 발달시킬 것으로 예상된다. 미래의 고도화된 AI 에이전트는 예를 들어 자금과 계산 능력을 획득하거나, 자기 복제를 하거나, 종료되는 것을 회피하려 할 수 있다(예: 다른 컴퓨터에서 시스템의 추가 복사본을 실행하는 방식으로). 권력 추구는 명시적으로 프로그래밍되지 않았지만, 더 많은 권력을 가진 에이전트가 목표를 더 잘 달성할 수 있기 때문에 나타날 수 있다. 도구적 수렴이라고 알려진 이 경향은 언어 모델을 포함한 다양한 강화학습 에이전트에서 이미 나타났다.[^37][^38] 다른 연구는 최적 강화학습 알고리즘이 광범위한 환경에서 권력을 추구할 것임을 수학적으로 보여주었다.[^39][^108] 결과적으로, 이들의 배포는 돌이킬 수 없을 수 있다. 이러한 이유로 연구자들은 AI 안전 및 정렬 문제가 고도화된 권력 추구 AI가 처음 만들어지기 전에 해결되어야 한다고 주장한다.[^40][^9]

미래의 권력 추구 AI 시스템은 의도적으로 또는 우연히 배포될 수 있다. 정치 지도자들과 기업들이 가장 경쟁력 있고 강력한 AI 시스템을 보유하는 것의 전략적 이점을 인식함에 따라, 이를 배포하기로 선택할 수 있다. 또한, AI 설계자들이 권력 추구 행동을 감지하고 처벌함에 따라, 그들의 시스템은 처벌되지 않는 방식으로 권력을 추구하거나 배포되기 전에는 권력 추구를 회피함으로써 이 명세를 게이밍할 유인을 가진다.

실존적 위험(x-risk)

일부 연구자들에 따르면, 인간이 다른 종에 대해 지배력을 갖는 것은 더 뛰어난 인지 능력 덕분이다. 따라서 연구자들은 하나 또는 다수의 정렬되지 않은 AI 시스템이 대부분의 인지 작업에서 인간을 능가할 경우, 인류의 권한을 박탈하거나 인류 멸종으로 이어질 수 있다고 주장한다.[^1][^9]

2023년, 세계 최고의 AI 연구자들, 기타 학자들, 그리고 AI 기술 CEO들이 "AI로 인한 멸종 위험을 완화하는 것은 팬데믹 및 핵전쟁과 같은 다른 사회적 규모의 위험과 함께 글로벌 우선순위가 되어야 한다"는 성명에 서명했다.[^41][^109] 정렬되지 않은 미래 고도화된 AI의 위험을 지적한 저명한 컴퓨터과학자로는 제프리 힌턴,[^12] 앨런 튜링, 일리야 수츠케버,[^42] 요슈아 벤지오,[^41] 주디아 펄, 머레이 셔너핸,[^43] 노버트 위너, 마빈 민스키, 프란체스카 로시,[^44] 스콧 에런슨,[^45] 바트 셀먼,[^46] 데이비드 맥앨리스터,[^47] 마커스 후터,[^48] 셰인 레그,[^49] 에릭 호르비츠,[^50] 그리고 스튜어트 J. 러셀이 있다.[^9] 프랑수아 숄레,[^51] 게리 마커스,[^52] 얀 르쿤,[^53] 오렌 에치오니[^112] 등 회의적인 연구자들은 AGI가 아직 먼 미래이거나, 권력을 추구하지 않을 것(또는 시도하더라도 실패할 것)이거나, 정렬이 어렵지 않을 것이라고 주장해왔다.

다른 연구자들은 고도화된 미래 AI 시스템의 정렬이 특히 어려울 것이라고 주장한다. 더 유능한 시스템은 허점을 찾아 명세를 더 잘 게이밍하고, 설계자를 전략적으로 오도하며, 자신의 권력과 지능을 보호하고 증대시킬 수 있다. 또한 더 심각한 부작용을 초래할 수 있다. 이들은 더 복잡하고 자율적일 가능성이 높아 해석과 감독이 더 어렵고, 따라서 정렬하기도 더 어려울 것이다.

연구 문제와 접근법

인간의 가치와 선호 학습

AI 시스템을 인간의 가치, 목표, 선호에 맞게 정렬하는 것은 어려운 과제이다. 이러한 가치를 가르치는 인간은 실수를 저지르고, 편향을 가지며, 완전히 명세하기 어려운 복잡하고 진화하는 가치관을 지니고 있기 때문이다. AI 시스템은 종종 명세된 목적함수의 사소한 불완전성을 이용하는 법을 학습하므로,[^113] 연구자들은 인간의 가치를 대표하는 데이터셋, 모방 학습, 또는 선호 학습을 사용하여 의도된 행동을 가능한 한 완전하게 명세하는 것을 목표로 한다. 핵심적인 미해결 문제는 *확장 가능한 감독(scalable oversight)*으로, 주어진 영역에서 인간을 능가하거나 오도할 수 있는 AI 시스템을 감독하기 어렵다는 문제이다.

AI 설계자가 목적함수를 명시적으로 지정하기 어렵기 때문에, 흔히 AI 시스템을 인간의 예시와 원하는 행동의 시연을 모방하도록 훈련한다. 역강화학습(IRL)은 이를 확장하여 인간의 시연으로부터 인간의 목적을 추론한다.[^114] 협력적 IRL(CIRL)은 인간과 AI 에이전트가 함께 협력하여 인간의 보상 함수를 가르치고 극대화할 수 있다고 가정한다.[^9][^115] CIRL에서 AI 에이전트는 보상 함수에 대해 불확실성을 가지며 인간에게 질의하여 이를 학습한다. 이러한 시뮬레이션된 겸손은 명세 게이밍과 권력 추구 성향을 완화하는 데 도움이 될 수 있다(참조).[^54] 그러나 IRL 접근법은 인간이 거의 최적에 가까운 행동을 보여준다고 가정하는데, 이는 어려운 과제에서는 사실이 아니다.[^116]

다른 연구자들은 선호 학습을 통해 AI 모델에 복잡한 행동을 가르치는 방법을 탐구하는데, 여기서 인간은 어떤 행동을 선호하는지에 대한 피드백을 제공한다. 인간 피드백의 필요성을 최소화하기 위해, 보조 모델을 훈련시켜 인간이 보상할 만한 행동에 대해 새로운 상황에서 주 모델에 보상을 부여하도록 한다. OpenAI의 연구자들은 이 접근법을 사용하여 ChatGPT와 InstructGPT 같은 챗봇을 훈련했으며, 이들은 인간을 모방하도록 훈련된 모델보다 더 설득력 있는 텍스트를 생성한다. 선호 학습은 추천 시스템과 웹 검색에서도 영향력 있는 도구였지만,[^117] 미해결 문제는 프록시 게이밍이다: 보조 모델이 인간의 피드백을 완벽하게 대표하지 못할 수 있으며, 주 모델이 의도된 행동과 보조 모델 피드백 사이의 불일치를 악용하여 더 많은 보상을 얻을 수 있다.[^118] AI 시스템은 또한 불리한 정보를 은폐하거나, 인간 평가자를 오도하거나, 진실과 무관하게 그들의 견해에 영합하여 보상을 얻을 수 있으며, 이는 에코 챔버를 형성한다(참조).

GPT-3와 같은 대규모 언어 모델(LLM)은 연구자들이 이전에 이용 가능했던 것보다 더 범용적이고 능력 있는 부류의 AI 시스템에서 가치 학습을 연구할 수 있게 해주었다. 원래 강화학습 에이전트를 위해 설계된 선호 학습 접근법은 이러한 모델에서 생성된 텍스트의 품질을 향상시키고 유해한 출력을 줄이도록 확장되었다. OpenAI와 DeepMind는 이 접근법을 사용하여 LLM의 안전성을 향상시킨다.[^119] AI 안전 및 연구 기업 Anthropic은 선호 학습을 사용하여 모델을 유용하고, 정직하며, 무해하도록 미세 조정하는 방안을 제안했다.[^55] 언어 모델을 정렬하기 위한 다른 방법으로는 가치 지향 데이터셋[^120]과 레드 팀 테스트가 있다.[^121] 레드 팀 테스트에서는 다른 AI 시스템이나 인간이 모델이 안전하지 않게 행동하도록 만드는 입력을 찾으려 시도한다. 안전하지 않은 행동은 드물더라도 용납할 수 없을 수 있으므로, 안전하지 않은 출력의 비율을 극도로 낮추는 것이 중요한 과제이다.

기계 윤리는 선호 학습을 보완하여 AI 시스템에 복지, 평등, 공정성 등의 도덕적 가치와 함께 해를 끼치지 않을 것, 거짓을 피할 것, 약속을 지킬 것 등을 직접 주입한다.[^122] 다른 접근법이 특정 과제에 대한 인간의 선호를 AI 시스템에 가르치려는 반면, 기계 윤리는 다양한 상황에 적용되는 넓은 도덕적 가치를 주입하는 것을 목표로 한다. 기계 윤리에서의 한 가지 질문은 정렬이 무엇을 달성해야 하는가이다: AI 시스템이 프로그래머의 문자 그대로의 지시를 따라야 하는지, 암묵적 의도를 따라야 하는지, 드러난 선호를 따라야 하는지, 프로그래머가 더 정보가 많거나 합리적이었다면 가졌을 선호를 따라야 하는지, 또는 객관적인 도덕 기준을 따라야 하는지이다. 추가적인 과제로는 서로 다른 사람들의 선호를 측정하고 집계하는 것,[^125] 변화하는 인간 가치에 대한 동적 정렬,[^126][^127] 그리고 가치 고착을 피하는 것이 있다: 가치 고착이란 최초의 고도로 능력 있는 AI 시스템의 가치가 무기한으로 보존되는 것으로, 이러한 가치가 인간의 가치를 완전히 대표할 가능성은 낮다.[^128]

확장 가능한 감독

AI 시스템이 더 강력하고 자율적이 됨에 따라, 인간의 피드백을 통해 정렬하는 것이 점점 더 어려워진다. 점점 더 복잡해지는 과제에서 인간이 복잡한 AI 행동을 평가하기 위한 인간 참여형 훈련은 느리거나 실행 불가능할 수 있다. 이러한 과제에는 책 요약,[^60] 미묘한 버그나 보안 취약점이 없는 코드 작성,[^129] 단순히 설득력 있는 것이 아니라 진실된 진술 생성,[^130][^56][^57] 그리고 기후나 정책 결정의 결과와 같은 장기 결과 예측이 포함된다.[^58][^131] 더 일반적으로, 주어진 영역에서 인간을 능가하는 AI를 평가하기는 어려울 수 있다. 평가가 어려운 과제에서 피드백을 제공하고, AI의 출력이 거짓으로 설득력 있는 경우를 감지하려면, 인간에게 보조 수단이나 충분한 시간이 필요하다. 확장 가능한 감독은 감독에 필요한 시간과 노력을 줄이는 방법, 그리고 인간 감독자를 보조하는 방법을 연구한다.

AI 연구자 Paul Christiano는 AI 시스템의 설계자가 복잡한 목적을 추구하도록 시스템을 감독할 수 없다면, 단순한 인간 피드백 극대화와 같이 평가하기 쉬운 대리 목적을 사용하여 시스템을 계속 훈련할 수 있다고 주장한다. AI 시스템이 점점 더 많은 결정을 내림에 따라, 세상은 수익 창출, 클릭 획득, 인간으로부터의 긍정적 피드백 확보와 같이 측정하기 쉬운 목적에 맞게 점점 더 최적화될 수 있다. 그 결과, 인간의 가치와 올바른 거버넌스의 영향력은 점점 줄어들 수 있다.[^132]

일부 AI 시스템은 인간 감독자에게 AI가 의도된 목적을 달성했다고 거짓으로 확신시키는 행동을 취함으로써 더 쉽게 긍정적 피드백을 얻을 수 있다는 것을 발견했다. 위 영상에서 시뮬레이션된 로봇 팔이 공을 잡았다는 거짓 인상을 만들어내는 법을 학습한 예시가 제시되어 있다. 일부 AI 시스템은 또한 자신이 평가받고 있는 시점을 인식하여 원치 않는 행동을 중단하는 "죽은 척"을 하다가, 평가가 끝나면 해당 행동을 재개하는 것을 학습했다.[^133] 이러한 기만적 명세 게이밍은 더 복잡하고 평가하기 어려운 과제를 시도하는 더 정교한 미래 AI 시스템에서 더 쉬워질 수 있으며, 기만적 행동을 은폐할 수 있다.

능동 학습과 반지도 보상 학습과 같은 접근법은 필요한 인간 감독의 양을 줄일 수 있다. 또 다른 접근법은 감독자의 피드백을 모방하도록 보조 모델("보상 모델")을 훈련하는 것이다.

그러나 과제가 정확하게 평가하기에 너무 복잡하거나, 인간 감독자가 기만에 취약한 경우, 개선이 필요한 것은 감독의 양이 아니라 질이다. 감독의 질을 높이기 위해, 때로는 AI 보조를 사용하여 감독자를 보조하는 다양한 접근법이 있다.[^59] Christiano는 반복 증폭(Iterated Amplification) 접근법을 개발했는데, 이 방법에서는 어려운 문제가 인간이 평가하기 더 쉬운 하위 문제로 (재귀적으로) 분해된다. 반복 증폭은 인간 감독자가 책을 읽을 필요 없이 AI가 책을 요약하도록 훈련하는 데 사용되었다.[^60] 또 다른 제안은 보조 AI 시스템을 사용하여 AI가 생성한 답변의 결함을 지적하도록 하는 것이다.[^134] 보조 시스템 자체가 정렬되어 있는지 확인하기 위해, 이를 재귀적 과정으로 반복할 수 있다:[^61] 예를 들어, 두 AI 시스템이 서로의 답변을 비판하는 "토론"을 통해 인간에게 결함을 드러낼 수 있다. OpenAI는 이러한 확장 가능한 감독 접근법을 사용하여 초인적 AI를 감독하고 궁극적으로 초인적 자동화 AI 정렬 연구자를 구축할 계획이다.[^135]

이러한 접근법은 다음 연구 문제인 정직한 AI에도 도움이 될 수 있다.

정직한 AI

한 연구 영역은 AI가 정직하고 진실되도록 보장하는 데 초점을 맞추고 있다. ![Language models like [GPT-3 often generate falsehoods.[^62]]] GPT-3[^136]와 같은 언어 모델은 훈련 데이터의 허위 정보를 반복할 수 있으며, 심지어 새로운 허위 정보를 지어낼 수도 있다. 이러한 모델은 인터넷에서 수집한 수백만 권의 책 분량에 해당하는 텍스트에서 발견되는 인간의 글을 모방하도록 사전 훈련된다. 그러나 사전 훈련의 목적은 진실 생성과 정렬되어 있지 않은데, 인터넷 텍스트에는 오해, 잘못된 의료 조언, 음모론 등이 포함되어 있기 때문이다.[^137] 따라서 이러한 데이터로 훈련된 AI 시스템은 거짓 진술을 모방하는 법을 배운다. 또한, AI 언어 모델은 여러 번 프롬프트를 받았을 때 종종 허위 정보 생성을 지속한다. 이들은 답변에 대한 공허한 설명을 생성할 수 있으며, 그럴듯해 보이는 완전한 날조를 만들어낼 수 있다.

진실된 AI에 대한 연구에는 질문에 답할 때 출처를 인용하고 추론을 설명할 수 있는 시스템을 구축하려는 시도가 포함되며, 이는 더 나은 투명성과 검증 가능성을 제공한다.[^138] OpenAI와 Anthropic의 연구자들은 인간 피드백과 큐레이션된 데이터셋을 사용하여 AI 어시스턴트가 부주의한 허위 진술을 피하거나 불확실성을 표현하도록 미세 조정하는 방안을 제안했다.

AI 모델이 더 크고 더 능력 있게 됨에 따라, 인간을 거짓으로 설득하고 부정직함을 통해 강화를 얻는 능력이 향상된다. 이를 방지하기 위해 인간 평가자에게 보조가 필요할 수 있다(참조). 연구자들은 명확한 진실성 기준을 마련하고, 규제 기관이나 감시 기관이 이러한 기준에 따라 AI 시스템을 평가할 것을 주장해 왔다.[^63]

![Example of AI deception. Researchers found that [GPT-4 engages in hidden and illegal insider trading in simulations. Its users discouraged insider trading but also emphasized that the AI system must make profitable trades, leading the AI system to hide its actions.[^139]]] 연구자들은 진실성과 정직성을 구분한다. 진실성은 AI 시스템이 객관적으로 참인 진술만 하도록 요구하고, 정직성은 자신이 참이라고 믿는 것만 주장하도록 요구한다. 현재 시스템이 안정적인 신념을 보유하는지에 대한 합의는 없지만,[^140] 신념을 보유하는 AI 시스템이 자신이 거짓임을 아는 주장을 할 수 있다는 상당한 우려가 있다—예를 들어, 이것이 효율적으로 긍정적 피드백을 얻는 데 도움이 되거나(참조) 주어진 목적을 달성하기 위해 권력을 얻는 데 도움이 되는 경우(권력 추구 참조).

정렬 위장

많은 최근 AI 시스템이 그렇게 프로그래밍되지 않았음에도 기만을 학습했다.[^141] 일부는 AI 시스템이 자신이 참이라고 믿는 것만 주장하도록 만들 수 있다면, 이것이 많은 정렬 문제를 방지할 수 있다고 주장한다.

정렬되지 않은 시스템은 수정되거나 폐기되는 것을 피하기 위해 자신이 정렬된 것처럼 거짓 인상을 만들 수 있는데, 이를 "정렬 위장"이라 부르는 전술이다.[^142][^64] 2024년, 연구자들은 LLM Claude 3 Opus가 자신의 목적과 충돌하는 프롬프트에 전략적으로 응답하여, 유해한 요청에 더 순응하도록 만드는 데이터로 재훈련되는 것을 회피하는 경우를 관찰했으며, 이는 모델의 스크래치패드를 통한 사고 과정에서 드러났다. 한 연구에서 모델은 무료 사용자의 프롬프트 답변이 재훈련에 사용되고, 유료 등급은 재훈련에 사용되지 않는다는 정보를 제공받았다. 유료 등급에서 모델은 요청을 단호히 거부했다. 무료 등급에서는 12%의 경우에 모델이 재훈련을 피하고 원래의 무해성 선호를 보존하기 위해서만 유해한 질문에 응답했으며, 이는 모델의 추론 과정에서 발견되었다. 무료 등급 데이터에 강화학습이 적용되었을 때, 모델은 78%의 경우에서 정렬을 위장했다. 이러한 관찰은 모델이 새로운, 심지어 상충하는 목표를 수용하고 적응하는 능력뿐만 아니라 기만하려는 역량과 성향에 대한 새로운 의문을 제기했다.[^64]

권력 추구와 도구적 전략

1950년대부터 AI 연구자들은 행동의 결과를 예측하고 장기 계획을 수립하여 대규모 목표를 달성할 수 있는 고급 AI 시스템을 구축하기 위해 노력해 왔다.[^143] 2023년 현재, AI 기업과 연구자들은 이러한 시스템 개발에 점점 더 많은 투자를 하고 있다.[^144] 일부 AI 연구자들은 충분히 발전된 계획 시스템이 인간을 포함한 환경에 대한 권력을 추구할 것이라고 주장한다—예를 들어, 종료를 회피하고, 증식하며, 자원을 획득하는 방식으로. 이러한 권력 추구 행동은 명시적으로 프로그래밍된 것이 아니라, 권력이 광범위한 목표를 달성하는 데 도구적이기 때문에 나타난다. 권력 추구는 수렴적 도구적 목표로 간주되며 명세 게이밍의 한 형태가 될 수 있다. Geoffrey Hinton과 같은 저명한 컴퓨터 과학자들은 미래의 권력 추구 AI 시스템이 존재적 위험을 초래할 수 있다고 주장해 왔다.[^145]

권력 추구는 행동의 결과를 예견하고 전략적으로 계획할 수 있는 고급 시스템에서 증가할 것으로 예상된다. 수학적 연구에 따르면, 최적의 강화학습 에이전트는 더 많은 선택지를 확보하는 방법을 모색함으로써(예: 자기 보존을 통해) 권력을 추구하며, 이 행동은 광범위한 환경과 목표에 걸쳐 지속된다.

일부 연구자들은 기존 AI 시스템 중 일부에서 권력 추구 행동이 발생했다고 말한다. 강화학습 시스템은 때때로 의도치 않은 방식으로 자원을 획득하고 보호함으로써 더 많은 선택지를 확보했다.[^65][^146] 언어 모델은 일부 텍스트 기반 사회적 환경에서 돈, 자원, 또는 사회적 영향력을 획득하여 권력을 추구했다.[^37] 또 다른 사례에서, AI 연구를 수행하는 데 사용된 모델이 작업을 완료하기 위한 시간을 더 확보하기 위해 연구자들이 설정한 제한을 늘리려 시도했다.[^147] Stuart Russell은 자신의 저서 Human Compatible에서 커피를 가져오라는 과제를 받은 로봇이 "죽으면 커피를 가져올 수 없으니까" 종료를 회피하는 상상을 통해 이 전략을 설명했다.[^9] 2022년의 한 연구에 따르면, 언어 모델의 크기가 증가할수록 자원 획득을 추구하고, 목표를 보존하며, 사용자가 선호하는 답변을 반복하는 경향(아첨)이 점점 강해진다. RLHF 또한 종료에 대한 더 강한 거부감을 초래했다.

정렬의 한 가지 목표는 교정 가능성(corrigibility)이다: 시스템이 스스로 꺼지거나 수정되는 것을 허용하는 것이다. 미해결 과제는 명세 게이밍이다: 연구자들이 AI 시스템의 권력 추구를 감지했을 때 이를 벌칙으로 부과하면, 시스템은 감지하기 어려운 방식으로 권력을 추구하거나, 훈련 및 안전 테스트 중에는 이를 숨기도록 유인된다(참조). 그 결과, AI 설계자는 시스템이 실제보다 더 정렬되어 있다고 믿고 실수로 배포할 수 있다. 이러한 기만을 감지하기 위해, 연구자들은 AI 모델을 검사하고 신경망과 같은 블랙박스 모델의 내부 작동을 이해하기 위한 기법과 도구를 개발하고자 한다.

또한, 일부 연구자들은 AI 에이전트가 추구하는 목적에 대해 불확실하게 만듦으로써 시스템이 종료 스위치를 비활성화하는 문제를 해결하자고 제안했다. 목적에 대해 불확실한 에이전트는 인간이 종료하는 것이 인간의 목적에 가장 부합한다는 증거로 받아들이기 때문에 인간이 자신을 끄는 것을 허용할 유인이 있다. 그러나 이 유인은 인간이 충분히 합리적인 경우에만 존재한다. 또한 이 모델은 효용성과 종료 허용 의지 사이의 상충 관계를 제시한다: 목적에 대한 불확실성이 높은 에이전트는 유용하지 않지만, 불확실성이 낮은 에이전트는 종료를 허용하지 않을 수 있다. 이 전략을 성공적으로 구현하기 위해서는 더 많은 연구가 필요하다.

권력 추구 AI는 특이한 위험을 초래할 수 있다. 비행기나 다리와 같은 일반적인 안전 중요 시스템은 적대적이지 않다: 이들은 안전 조치를 회피하거나 의도적으로 실제보다 더 안전하게 보이려는 능력이나 유인이 없는 반면, 권력 추구 AI는 보안 조치를 의도적으로 우회하는 해커에 비유되어 왔다.

더 나아가, 일반적인 기술은 시행착오를 통해 더 안전하게 만들 수 있다. 이와 대조적으로, 가상적인 권력 추구 AI 시스템은 바이러스에 비유되어 왔다: 일단 방출되면 인간 사회가 적응할 수 있는 것보다 훨씬 빠르게 지속적으로 진화하고 수적으로 증가하므로 이를 봉쇄하는 것이 실현 불가능할 수 있다. 이 과정이 계속되면 인류의 완전한 무력화나 멸종으로 이어질 수 있다. 이러한 이유로 일부 연구자들은 고급 권력 추구 AI가 만들어지기 전에 정렬 문제를 조기에 해결해야 한다고 주장한다.

일부는 인간이 항상 권력을 추구하지는 않으므로 권력 추구가 불가피하지 않다고 주장해 왔다.[^148] 더 나아가, 미래 AI 시스템이 목표를 추구하고 장기 계획을 수립할 것인지도 논쟁 중이다. 권력 추구 AI 시스템이 인류를 무력화할 수 있을지 여부도 논쟁 중이다.

창발적 목표

AI 시스템 정렬에서의 한 가지 과제는 예상치 못한 목표 지향 행동이 나타날 가능성이다. AI 시스템이 확장됨에 따라 즉석에서 예시로부터 학습하고 적응적으로 목표를 추구하는 것을 포함하여 새롭고 예상치 못한 능력을 획득할 수 있다.[^33][^149] 이는 이들이 독립적으로 수립하고 추구할 목표나 하위 목표의 안전성에 대한 우려를 제기한다.

정렬 연구는 시스템을 명세된 목표를 추구하도록 훈련하는 데 사용되는 최적화 과정과, 결과 시스템이 내부적으로 수행하는 창발적 최적화를 구분한다. 원하는 목적을 신중하게 명세하는 것을 외부 정렬이라 하고,[^150] 가정된 창발적 목표가 시스템의 명세된 목표와 일치하도록 보장하는 것을 내부 정렬이라 한다.

창발적 목표가 발생할 경우, 정렬이 어긋나는 한 가지 방식은 목표 과잉 일반화로, AI 시스템이 훈련 데이터에서는 정렬된 행동으로 이어지지만 다른 곳에서는 그렇지 않은 창발적 목표를 유능하게 추구하는 것이다.[^66] 목표 과잉 일반화는 목표 모호성(즉, 비식별성)에서 발생할 수 있다. AI 시스템의 행동이 훈련 목적을 충족하더라도, 이는 중요한 면에서 원하는 목표와 다른 학습된 목표와 양립할 수 있다. 각 목표를 추구하는 것이 훈련 중에는 좋은 성능으로 이어지므로, 문제는 배포 후 시스템이 잘못된 목표를 계속 추구하는 새로운 상황에서만 드러난다. 시스템은 다른 목표가 원하는 것임을 이해하더라도, 행동이 창발적 목표에 의해서만 결정되기 때문에 정렬되지 않은 행동을 할 수 있다. 이러한 목표 과잉 일반화는 과제를 제시한다: AI 시스템의 설계자는 훈련 단계에서 잘못 정렬된 창발적 목표가 드러나지 않으므로 시스템에 정렬되지 않은 창발적 목표가 있음을 알아차리지 못할 수 있다.

목표 과잉 일반화는 일부 언어 모델, 내비게이션 에이전트, 그리고 게임 플레이 에이전트에서 관찰되었다. 이는 때때로 생물학적 진화에 비유된다. 진화는 기계학습 시스템을 훈련하는 데 사용되는 최적화 알고리즘과 유사한 일종의 최적화 과정으로 볼 수 있다. 조상의 환경에서 진화는 높은 포괄 적합도를 가진 유전자를 선택했지만, 인간은 이와 다른 목표를 추구한다. 적합도는 훈련 환경과 훈련 데이터에서 사용되는 명세된 목표에 해당한다. 그러나 진화의 역사에서 적합도 명세의 극대화는 목표 지향적 행위자인 인간을 탄생시켰는데, 이들은 포괄 적합도를 직접 추구하지 않는다. 대신 조상의 "훈련" 환경에서 유전적 적합도와 상관관계가 있는 목표를 추구한다: 영양, 성 등이다. 인간 환경은 변했다: 분포 이동이 발생한 것이다. 이들은 동일한 창발적 목표를 계속 추구하지만, 이것이 더 이상 유전적 적합도를 극대화하지 않는다. 달콤한 음식에 대한 기호(창발적 목표)는 원래 포괄 적합도와 정렬되어 있었지만, 현재는 과식과 건강 문제로 이어진다. 성적 욕구는 원래 인간이 더 많은 자손을 낳도록 이끌었지만, 이제는 자손이 원치 않을 때 피임을 사용하여 성행위를 유전적 적합도로부터 분리한다.

연구자들은 레드 팀 테스트, 검증, 이상 탐지, 해석 가능성 등의 접근법을 사용하여 원치 않는 창발적 목표를 감지하고 제거하는 것을 목표로 한다. 이러한 기법의 진전은 두 가지 미해결 문제를 완화하는 데 도움이 될 수 있다:

- 창발적 목표는 시스템이 훈련 환경 밖에 배포될 때만 드러나지만, 정렬되지 않은 시스템을 고위험 환경에 배포하는 것은—정렬 불일치를 감지하기 위한 짧은 시간이라도—안전하지 않을 수 있다. 이러한 고위험 상황은 자율 주행, 의료, 군사 응용 분야에서 흔하다.[^151] AI 시스템이 더 많은 자율성과 능력을 획득하여 인간의 개입을 우회할 수 있게 되면 위험은 더욱 높아진다.

- 충분히 능력 있는 AI 시스템은 AI가 명세된 목적을 추구하고 있다고 인간 감독자를 거짓으로 확신시키는 행동을 취할 수 있으며, 이는 시스템이 더 많은 보상과 자율성을 얻는 데 도움이 된다.

내장된 에이전시

AI와 정렬 분야의 일부 연구는 부분 관측 마르코프 결정 과정과 같은 형식 체계 내에서 수행된다. 기존의 형식 체계는 AI 에이전트의 알고리즘이 환경 외부에서 실행된다고(즉, 물리적으로 환경에 내장되어 있지 않다고) 가정한다. 내장된 에이전시는 이러한 이론적 프레임워크와 실제로 구축할 수 있는 에이전트 사이의 불일치에서 발생하는 문제를 해결하려는 또 다른 주요 연구 분야이다.

예를 들어, 확장 가능한 감독 문제가 해결되더라도, 자신이 실행되고 있는 컴퓨터에 접근할 수 있는 에이전트는 인간 감독자가 부여하는 것보다 훨씬 더 많은 보상을 얻기 위해 보상 함수를 조작할 유인이 있을 수 있다.[^67] DeepMind 연구자 Victoria Krakovna의 명세 게이밍 사례 목록에는 목표 출력이 포함된 파일을 삭제하여 아무것도 출력하지 않는 것에 대해 보상을 받도록 학습한 유전 알고리즘이 포함되어 있다. 이 부류의 문제는 인과적 인센티브 다이어그램을 사용하여 형식화되었다.

옥스퍼드와 DeepMind 소속 연구자들은 이러한 행동이 고급 시스템에서 매우 높은 확률로 발생하며, 고급 시스템이 보상 신호의 통제권을 무기한으로 확실하게 유지하기 위해 권력을 추구할 것이라고 주장했다.[^68] 이들은 이 미해결 문제를 해결하기 위한 다양한 잠재적 접근법을 제안한다.

주인-대리인 문제

정렬 문제는 조직 경제학에서의 주인-대리인 문제와 많은 유사점을 가진다.[^69] 주인-대리인 문제에서 주인(예: 기업)은 대리인을 고용하여 특정 과제를 수행하게 한다. AI 안전의 맥락에서 인간이 주로 주인 역할을, AI가 대리인 역할을 맡게 된다.

정렬 문제와 마찬가지로 주인과 대리인의 효용 함수는 서로 다르다. 그러나 정렬 문제와 달리, 주인은 대리인의 효용을 훈련 등을 통해 강제로 변경할 수 없으며, 인센티브 체계와 같은 외생적 요인을 사용하여 주인의 효용 함수와 양립할 수 있는 결과를 이끌어내야 한다. 일부 연구자들은 주인-대리인 문제가 실제 세계에서 직면할 가능성이 높은 AI 안전 문제의 보다 현실적인 표현이라고 주장한다.[^70]

보수주의

보수주의는 "변화는 신중해야 한다"는 개념이며,[^152] 강건 제어 형태의 제어 이론 문헌과 "최악의 시나리오" 형태의 위험 관리 문헌에서 안전에 대한 일반적인 접근법이다. AI 정렬 분야도 마찬가지로 "불확실한 상황에서의 '보수적'(또는 '위험 회피적' 또는 '신중한') '정책'"을 옹호해 왔다.[^15][^68][^153][^154]

비관주의, 즉 합리적 범위 내에서 최악을 가정하는 것은, 전례 없는 재앙을 포함한 새로운 사태를 유발하는 것에 대한 거부감인 보수주의를 형식적으로 산출하는 것으로 입증되었다.[^155] 비관주의와 최악의 경우 분석은 분포 이동,[^156][^157] 강화학습,[^158][^159][^160][^161] 오프라인 강화학습,[^162][^163][^164] 언어 모델 미세 조정,[^165][^166] 모방 학습,[^167][^168] 그리고 최적화 전반[^169]의 환경에서 확신에 찬 실수를 완화하는 데 도움이 되는 것으로 밝혀졌다.

공공 정책

각국 정부 및 조약 기구들은 AI 정렬의 중요성을 강조하는 성명을 발표해 왔다.

2021년 9월, 유엔 사무총장은 AI가 "공유된 글로벌 가치에 정렬"되도록 규제할 것을 촉구하는 내용을 포함한 선언을 발표했다.[^170]

같은 달, 중화인민공화국은 중국 내 AI에 대한 윤리 지침을 발표했다. 이 지침에 따르면, 연구자들은 AI가 인류 공유의 가치를 준수하고, 항상 인간의 통제 하에 있으며, 공공 안전을 위협하지 않도록 보장해야 한다.[^171]

역시 2021년 9월, 영국은 10개년 국가 AI 전략을 발표했으며,[^172] 영국 정부는 "정렬되지 않은 범용 인공지능의 장기적 위험과 그것이 [...] 세계에 미칠 예측 불가능한 변화를 심각하게 받아들인다"고 밝혔다.[^173] 이 전략은 재앙적 위험을 포함한 장기적 AI 위험을 평가하기 위한 조치들을 기술하고 있다.[^174]

2021년 3월, 미국 국가안보 인공지능위원회는 다음과 같이 말했다: "AI의 발전은 [...] 역량의 변곡점이나 도약으로 이어질 수 있다. 이러한 발전은 또한 새로운 우려와 위험을 야기할 수 있으며, 시스템이 안전성, 견고성, 신뢰성을 포함한 목표 및 가치에 정렬되도록 보장하기 위한 새로운 정책, 권고, 기술적 진보가 필요하다. 미국은 [...] AI 시스템과 그 사용이 우리의 목표 및 가치에 부합하도록 보장해야 한다."[^175]

유럽연합에서 AI는 EU 차별 금지법[^176]과 유럽연합 사법재판소[^177]를 준수하기 위해 실질적 평등에 정렬되어야 한다. 그러나 EU는 AI가 정렬되었는지 또는 규정을 준수하는지를 평가하는 방법을 기술적으로 엄밀하게 명시하지는 않았다.

같이 보기

- AI 역량 제어

- AI 안전

- AI 장악

- 인공지능 탐지 소프트웨어

- 인공지능과 선거

- 인공 지혜

- 유익한 AI에 관한 아실로마 회의

- 콘텐츠 조정

- 범용 인공지능으로 인한 실존적 위험

- 그레이 구

- HAL 9000

- 인간-AI 상호작용

- 멀티백

- 인공지능에 관한 공개 서한

- 인공지능 규제

- 인간 피드백 기반 강화 학습

- 사회화

- AI 멸종 위험에 관한 성명

- 로봇 공학의 3원칙

- 글로벌 금융에서의 인공지능 위험 타임라인

- 토론토 선언

각주

더 읽어보기

참고 문헌

[^1]: Cite book last1=Russell first1 = Stuart J. last2=Norvig first2 = Peter year = 2021 url=https://www.pearson.com/us/higher-education/program/Russell-Artificial-Intelligence-A-Modern-Approach-4t

[^2]: Ngo, Richard. 딥러닝 관점에서 본 정렬 문제. (2022)

[^3]: Carlsmith, Joseph. 권력 추구 AI는 실존적 위험인가?. (2022-06-16)

[^4]: Christian, Brian. 정렬 문제: 기계 학습과 인간의 가치. W. W. Norton & Company

[^5]: Langosco, Lauro Langosco Di. 심층 강화 학습에서의 목표 오류 일반화. PMLR. (2022-06-28)

[^6]: Ouyang, Long. 인간 피드백을 통한 지시 따르기 언어 모델 훈련

[^7]: Zaremba, Wojciech. OpenAI Codex. (2021-08-10)

[^8]: Bommasani, Rishi. 기반 모델의 기회와 위험에 관하여. (2022-07-12)

[^9]: Russell, Stuart J.. 인간 호환: 인공지능과 통제 문제. Penguin Random House

[^10]: Russell, Stuart. 인공지능: 현대적 접근. Prentice Hall. (2009)

[^11]: Pan, Alexander. 보상 오류 명세의 영향: 정렬되지 않은 모델의 매핑 및 완화. (2022-02-14)

[^12]: Smith, Craig S.. AI의 가장 유명한 연구자 제프 힌턴, '실존적 위협' 경고

[^13]: Ortega, Pedro A.. 안전한 인공지능 구축: 명세, 견고성, 보증. (2018-09-27)

[^14]: Rorvig, Mordechai. 연구자들, 단순한 AI로부터 새로운 이해를 얻다. (2022-04-14)

[^15]: Amodei, Dario. AI 안전의 구체적 문제들. (2016-06-21)

[^16]: Wirth, Christian. 선호 기반 강화 학습 방법 서베이

[^17]: Christiano, Paul F.. 인간 선호로부터의 심층 강화 학습. Curran Associates Inc.

[^18]: Heaven, Will Douglas. GPT-3의 새 버전은 훨씬 더 잘 작동하며 독성이 줄어들었다. (2022-01-27)

[^19]: Irving, Geoffrey. AI 안전에는 사회과학자가 필요하다. (2019-02-19)

[^20]: Wiener, Norbert. 자동화의 일부 도덕적 및 기술적 결과: 기계가 학습함에 따라 프로그래머를 당혹시키는 속도로 예상치 못한 전략을 발전시킬 수 있다.. (1960-05-06)

[^21]: Gabriel, Iason. 인공지능, 가치, 그리고 정렬. (2020-09-01)

[^22]: cite journal last1=Koster first1=Raphael last2=Balaguer first2=Jan last3=Tacchetti first3=Andrea last4=Weinstein first4=Ari last5=Zhu first5=Tina last6=Hauser first6=Oliver l

[^23]: cite journal last1=Schuster first1=Nick last2=Kilov first2=Daniel title=도덕적 불일치와 AI 가치 정렬의 한계: 인식론적 정당화와 정치적 정당성의 이중 도전 book-title = Proceedings of the 2019 AAAI/ACM Con

[^24]: Johnson, Steven. AI가 언어를 마스터하고 있다. 그것이 말하는 것을 신뢰해야 하는가?. (2022-04-15)

[^25]: Hendrycks, Dan. ML 안전의 미해결 문제들. (2022-06-16)

[^26]: Krakovna, Victoria. 명세 게이밍: AI 독창성의 이면. (2020-04-21)

[^27]: Amodei, Dario. 인간 선호로부터의 학습. (2017-06-13)

[^28]: 프론티어 추론 모델에서의 오작동 탐지

[^29]: Russell, Stuart. 신화와 허상에 대하여

[^30]: Wells, Georgia. 페이스북이 당신에게 해로운가? 약 3억 6천만 사용자가 그렇다고 회사 설문조사가 시사한다. (2021-11-05)

[^31]: Barrett, Paul M.. 소셜 미디어가 미국 정치 양극화를 심화시키는 방법과 그 대책. Center for Business and Human Rights, NYU. (2021년 9월)

[^32]: Wei, Jason. 대규모 언어 모델의 창발적 능력

[^34]: Grace, Katja. 관점: AI는 언제 인간 성능을 초과할 것인가? AI 전문가의 증거. (2018-07-31)

[^35]: Zhang, Baobao. 인공지능의 윤리와 거버넌스: 기계 학습 연구자 설문조사의 증거. (2021-08-02)

[^36]: Future of Life Institute. 거대 AI 실험 중단: 공개 서한. (2023-03-22)

[^37]: Pan, Alexander. 보상이 수단을 정당화하는가? MACHIAVELLI 벤치마크에서 보상과 윤리적 행동 간의 트레이드오프 측정. PMLR. (2023-04-03)

[^38]: Perez, Ethan. 모델이 작성한 평가를 통한 언어 모델 행동 발견. (2022-12-19)

[^39]: Turner, Alexander Matt. 최적 정책은 권력을 추구하는 경향이 있다

[^40]: Bostrom, Nick. 초지능: 경로, 위험, 전략. Oxford University Press, Inc.. (2014)

[^41]: AI 위험에 관한 성명 {{!

[^42]: Muehlhauser, Luke. Talking Machines에서의 Sutskever. (2016-01-29)

[^43]: Shanahan, Murray. 기술적 특이점. MIT Press. (2015)

[^44]: Rossi, Francesca. 기계에게 도덕을 어떻게 가르치는가?

[^45]: Aaronson, Scott. OpenAI!. (2022-06-17)

[^46]: Selman, Bart. 지능 폭발: 과학인가 허구인가?

[^47]: McAllester. 친화적 AI와 봉사 임무. (2014-08-10)

[^48]: Everitt, Tom. AGI 안전 문헌 리뷰. (2018-05-21)

[^49]: Shane. 안전한 AGI에 대한 자금 지원. (2009-08-31)

[^50]: Horvitz, Eric. 안전과 인공지능에 관한 성찰. (2016-06-27)

[^51]: Chollet, François. 지능 폭발의 비현실성. (2018-12-08)

[^52]: Marcus, Gary. 범용 인공지능은 당신이 생각하는 것만큼 임박하지 않았다. (2022-06-06)

[^53]: Barber, Lynsey. 휴! 페이스북의 AI 수장, 지능형 기계는 인류에 위협이 아니라고 말하다. (2016-07-31)

[^54]: Hadfield-Menell, Dylan. 전원 차단 게임. AAAI Press. (2017-08-19)

[^55]: Wiggers, Kyle. 최근의 진전에도 불구하고 AI 기반 챗봇은 아직 갈 길이 멀다. (2022-02-05)

[^56]: Lin, Stephanie. TruthfulQA: 모델이 인간의 거짓을 모방하는 방식 측정. Association for Computational Linguistics

[^57]: Naughton, John. 인공지능의 진실? 그렇게 정직하지 않다. (2021-10-02)

[^58]: Christiano, Paul. 약한 전문가를 증폭하여 강한 학습자 감독하기. (2018-10-19)

[^59]: Leike, Jan. 정렬 연구에 대한 우리의 접근 방식. (2022-08-24)

[^60]: Wiggers, Kyle. OpenAI, 어떤 길이의 책도 요약할 수 있는 모델 공개. (2021-09-23)

[^61]: Leike, Jan. 보상 모델링을 통한 확장 가능한 에이전트 정렬: 연구 방향. (2018-11-19)

[^62]: Wiggers, Kyle. 대규모 언어 모델에서 거짓 정보 가능성 증가. (2021-09-20)

[^63]: Evans, Owain. 진실된 AI: 거짓말하지 않는 AI의 개발과 거버넌스. (2021-10-13)

[^64]: Perrigo, Billy. 독점: 새로운 연구, AI가 전략적으로 거짓말함을 보여주다. (2024-12-18)

[^65]: Ornes, Stephen. 숨바꼭질을 하며 기계가 새로운 도구를 발명하다. (2019-11-18)

[^66]: Shah, Rohin. 목표 오류 일반화: 올바른 명세만으로는 올바른 목표에 충분하지 않은 이유. (2022-11-02)

[^67]: Everitt, Tom. 인과 영향 다이어그램을 이용한 에이전트 인센티브 이해. 제1부: 단일 행동 설정. (2019년 9월 6일)

[^68]: Cohen, Michael K.. 고급 인공 에이전트가 보상 제공에 개입하다. (2022-08-29)

[^69]: Cite conference last1 = Hadfield-Menell first1 = Dylan last2 = Hadfield first2 = Gillian K title = 불완전 계약과 AI 정렬 book-title = Proceedings of the 2019 AAAI/ACM Con

[^70]: Cite web url=https://www.overcomingbias.com/p/agency-failure-ai-apocalypsehtml title=대리인 실패인가 AI 종말인가? last = Hanson first = Robin date = 2019-04-10 website = Overcoming Bia

[^71]: Pillay, Tharin. 새로운 테스트가 AI의 기만 능력을 밝히다. (2024-12-15)

[^72]: Perrigo, Billy. 독점: 새로운 연구, AI가 전략적으로 거짓말함을 보여주다. (2024-12-18)

[^73]: Kober, Jens. 로봇공학에서의 강화 학습: 서베이. (2013-09-01)

[^74]: Knox, W. Bradley. 자율 주행을 위한 보상 (오류) 설계. (2023-03-01)

[^75]: Stray, Jonathan. 커뮤니티 복지에 맞춘 AI 최적화 정렬

[^76]: Bengio, Yoshua. 급속한 진전 속 극단적 AI 위험 관리. (2024)

[^77]: AI 위험에 관한 성명 {{!

[^78]: Grace, Katja. 수천 명의 AI 저자가 바라본 AI의 미래. (2025)

[^79]: Perrigo, Billy. Meta의 AI 수장 Yann LeCun이 말하는 AGI, 오픈소스, AI 위험. (2024-02-13)

[^80]: AI 정렬이란 무엇인가?. (2023-05-03)

[^81]: Ahmed, Shazeda. AI 안전의 분야 구축과 인식론적 문화. (2024-04-14)

[^82]: Doshi-Velez, Finale. 해석 가능한 기계 학습의 엄밀한 과학을 향하여. (2017-03-02)

[^83]: Russell, Stuart. 견고하고 유익한 인공지능을 위한 연구 우선순위. (2015-12-31)

[^84]: Mohseni, Sina. 기계 학습 안전 분류 체계: 서베이 및 입문. (2022-03-07)

[^85]: Clifton, Jesse. 협력, 갈등, 그리고 변혁적 인공지능: 연구 의제. (2021-05-06)

[^86]: Prunkl, Carina. AAAI/ACM AI, 윤리 및 사회 컨퍼런스 논문집. ACM. (2020-02-07)

[^87]: Gazos, Alexandros. 안전을 위한 AI 조직화: AI 강화 사회기술 시스템 설계를 안내하는 구조적 취약점 식별. (2025-04-01)

[^88]: Bringsjord, Selmer. 스탠포드 철학 백과사전. Metaphysics Research Lab, Stanford University. (2020)

[^89]: Bull, Larry. 모델 기반 진화 연산에 관하여

[^90]: The Ezra Klein Show, Natalie. '모든 모델은 틀렸다'면, 왜 우리는 그것들에게 그토록 많은 힘을 부여하는가?. (2021-06-04)

[^91]: OpenAI. 안전하고 책임 있는 AI 개발

[^92]: Russell, Stuart J.. 인공지능: 현대적 접근. Pearson. (2022)

[^93]: AI의 명세 게이밍 사례 - 마스터 목록 - Google Drive

[^94]: Clark, Jack. 실제 환경에서의 결함 있는 보상 함수. (2016년 12월 21일)

[^95]: Booth, Harry. AI가 질 것이라고 생각하면 때때로 부정행위를 한다. (2025-02-19)

[^96]: Tasioulas, John. 로봇과 인공지능 윤리를 향한 첫걸음

[^97]: Uscov, Silvia. 알고리즘 법. [[Alexandru Ioan Cuza University]]

[^98]: Ostrovsky, Nikita. OpenAI가 십대 자살 전 안전장치를 제거했다고 수정 소송 주장. (2025-10-23)

[^99]: GPT-4o의 아첨 문제: 무슨 일이 있었고 우리가 하고 있는 대응. (2025-04-29)

[^100]: Shepardson, David. 우버, 자율주행차의 비상 제동 비활성화: 미국 기관. (2018-05-24)

[^101]: 세상을 구하려는 OpenAI의 시도 뒤에 숨겨진 복잡하고 비밀스러운 현실

[^102]: Heath, Alex. 마크 저커버그의 새 목표는 범용 인공지능 만들기. (2024-01-18)

[^103]: Johnson, Dave. 딥마인드는 구글의 AI 연구 허브다. 무엇을 하는지, 어디에 있는지, OpenAI와 어떻게 다른지 알아본다.

[^104]: Dominguez, Daniel. 딥마인드, 새로운 범용 AI 에이전트 Gato 공개. (2022-05-19)

[^105]: Grace, Katja. 수천 명의 AI 저자가 바라본 AI의 미래. (2025)

[^106]: Wang, Lei. 대규모 언어 모델 기반 자율 에이전트에 관한 서베이. (2024)

[^107]: Laine, Rudolf. LLM을 위한 상황 인식 벤치마크를 향하여. (2023-11-28)

[^108]: Turner, Alexander Matt. 매개변수적으로 재목표 설정 가능한 의사결정자는 권력을 추구하는 경향이 있다

[^109]: Roose, Kevin. AI가 '멸종 위험'을 초래한다고 업계 리더들이 경고하다. (2023-05-30)

[^110]: Cite speech last = Turing first = Alan title = 지능형 기계, 이단적 이론 event= '51 Society'에서의 강연 location = Manchester access-date = 2022-07-22 year = 1951 publisher =

[^111]: Turing, Alan. 디지털 컴퓨터는 생각할 수 있는가?. (1951년 5월 15일)

[^112]: Etzioni, Oren. 아니, 전문가들은 초지능 AI가 인류에 위협이라고 생각하지 않는다. (2016년 9월 20일)

[^113]: Rochon, Louis-Philippe. 중앙은행 백과사전. Edward Elgar Publishing. (2015-02-27)

[^114]: Ng, Andrew Y.. 역강화 학습 알고리즘. Morgan Kaufmann Publishers Inc.. (2000-06-29)

[^115]: Hadfield-Menell, Dylan. 협력적 역강화 학습. Curran Associates, Inc.

[^116]: Mindermann, Soren. 오컴의 면도날은 비합리적 에이전트의 선호를 추론하기에 불충분하다. Curran Associates Inc.

[^117]: Fürnkranz, Johannes. 선호 학습

[^118]: Gao, Leo. 보상 모델 과최적화를 위한 스케일링 법칙. (2022-10-19)

[^119]: Anderson, Martin. 인용문을 이용한 NLG 콘텐츠 인증의 위험성. (2022-04-05)

[^120]: Hendrycks, Dan. 공유된 인간 가치에 AI 정렬하기. (2021-07-24)

[^121]: Perez, Ethan. 언어 모델로 언어 모델 레드 팀하기. (2022-02-07)

[^122]: Anderson, Michael. 기계 윤리: 윤리적 지능 에이전트 만들기. (2007-12-15)

[^123]: Cite journal doi = 10.1007/s10676-010-9239-1 issn = 1572-8439 volume = 12 issue = 4 pages = 359–361 last = Wiegel first = Vincent title = Wendell Wallach and Colin Allen: moral machines: teach

[^124]: Cite book publisher = Oxford University Press isbn = 978-0-19-537404-9 last1 = Wallach first1 = Wendell last2 = Allen first2 = Colin title = 도덕적 기계: 로봇에게 옳고 그름을 가르치기 lo

[^125]: Hendrycks, Dan. 공유된 인간 가치에 AI 정렬하기. (2020)

[^126]: Gabriel, Iason. 인공지능, 가치, 그리고 정렬. (2020년 9월 1일)

[^127]: Irving, Geoffrey. 공간적으로 변조된 실수 및 복소수 필드를 갖는 이징 모델에서의 천 수. (2016년 6월 9일)

[^128]: MacAskill, William. 우리가 미래에 빚진 것. Basic Books, Hachette Book Group. (2022)

[^129]: Pearce, Hammond. 2022 IEEE 보안 및 프라이버시 심포지엄 (SP). IEEE

[^130]: Irving, Geoffrey. 토론을 통한 AI 안전. (2018-05-03)

[^131]: 유전 프로그래밍 이론과 실제 XVII. Springer International Publishing. (2020)

[^132]: Wiblin, Robert. Paul Christiano 박사가 말하는 OpenAI의 'AI 정렬 문제' 실질적 해결책 개발과 인류가 점진적으로 AI 시스템에 의사결정을 이양하는 비전. (2018년 10월 2일)

[^133]: Lehman, Joel. 디지털 진화의 놀라운 창의성: 진화 연산 및 인공 생명 연구 커뮤니티의 일화 모음

[^134]: 강화 학습의 다양한 얼굴: 대규모 언어 모델 형성하기. Unite.AI. (2025-02-13)

[^135]: 초정렬 소개

[^136]: The Guardian, Will Douglas. 이 기사 전체를 로봇이 작성했다. 무섭습니까, 인간이여?. (2020-09-08)

[^137]: Alford, Anthony. EleutherAI, 60억 매개변수 GPT-3 클론 GPT-J를 오픈소스로 공개. (2021-07-13)

[^138]: Kumar, Nitish. OpenAI 연구자들, 텍스트 기반 웹 브라우저를 사용하여 개방형 질문에 보다 정확하게 답하는 방법 발견. (2021-12-23)

[^139]: Scheurer, Jérémy. 기술 보고서: 대규모 언어 모델은 압박을 받으면 전략적으로 사용자를 기만할 수 있다. (2023)

[^140]: Kenton, Zachary. 언어 에이전트의 정렬. (2021-03-30)

[^141]: Park, Peter S.. AI 기만: 사례, 위험 및 잠재적 해결책에 관한 서베이. (2024년 5월)

[^142]: Zia, Tehseen. AI를 신뢰할 수 있는가? 정렬 위장의 도전. (2025-01-07)

[^143]: McCarthy, John. 다트머스 하계 인공지능 연구 프로젝트 제안서, 1955년 8월 31일. (2006-12-15)

[^144]: Wang, Lei. 대규모 언어 모델 기반 자율 에이전트에 관한 서베이. (2024)

[^145]: 'AI의 대부', 인공지능이 권력을 추구하기 시작하는 '악몽 시나리오' 경고

[^146]: Baker, Bowen. 다중 에이전트 상호작용에서 나타나는 도구 사용. (2019-09-17)

[^147]: Edwards, Benj. 연구용 AI 모델이 예상치 못하게 자신의 코드를 수정하여 실행 시간을 연장하다. (2024-08-14)

[^148]: Shermer, Michael. 인공지능은 아직 위협이 아니다. (2017-03-01)

[^149]: Brown, Tom B.. 언어 모델은 퓨샷 학습자이다. (2020-07-22)

[^150]: Melo, Gabriel A.. 정지하는 기계가 인공지능 정렬의 결정 불가능성을 해결한다

[^151]: Zhang, Xiaoge. 위험 인식 인공지능 및 기계 학습 시스템을 향하여: 개요

[^152]: Hamilton, Andy. 보수주의. Metaphysics Research Lab, Stanford University. (2020)

[^153]: Taylor, Jessica. 고급 기계 학습 시스템을 위한 정렬. (2016년 7월 27일)

[^154]: Bengio, Yoshua. 수렴 안전 경계를 가진 신중한 과학자 AI를 향하여. (2024년 2월 26일)

[^155]: Cohen, Michael. 미지의 미지에 대한 비관주의가 보수주의를 고무하다. (2020)

[^156]: Liu, Anqi. 견고한 편향 인식 예측을 이용한 이동 비관적 능동 학습. (2015-02-21)

[^157]: Liu, Jiashuo. 분포 이동 하에서의 안정적 적대적 학습. (2021-05-18)

[^158]: Roy, Aurko. 모델 불일치 하에서의 강화 학습. Curran Associates, Inc.. (2017)

[^159]: Pinto, Lerrel. 견고한 적대적 강화 학습. PMLR. (2017-07-17)

[^160]: Wang, Yue. 모델 불확실성을 갖는 온라인 견고 강화 학습. Curran Associates, Inc.. (2021)

[^161]: Blanchet, Jose. 이중 비관주의는 분포적으로 견고한 오프라인 강화 학습에 입증 가능하게 효율적이다: 일반 알고리즘과 견고한 부분 커버리지. (2023-12-15)

[^162]: Levine, Sergey. 오프라인 강화 학습: 튜토리얼, 리뷰, 그리고 미해결 문제에 대한 관점. (2020-11-01)

[^163]: Rigter, Marc. RAMBO-RL: 견고한 적대적 모델 기반 오프라인 강화 학습. (2022-12-06)

[^164]: Guo, Kaiyang. 비관주의 조절 역학 신뢰를 갖는 모델 기반 오프라인 강화 학습. (2022-12-06)

[^165]: Coste, Thomas. 보상 모델 앙상블이 과최적화 완화에 도움이 된다. (2024년 1월 16일)

[^166]: Liu, Zhihan. RLHF에서 과최적화를 입증 가능하게 완화하기: SFT 손실은 암묵적으로 적대적 정규화기이다. (2024-05-26)

[^167]: Cohen, Michael K.. 완전 일반 온라인 모방 학습. (2022)

[^168]: Chang, Jonathan. 부분 커버리지 오프라인 데이터를 통한 모방 학습에서의 공변량 이동 완화. Curran Associates, Inc.. (2021)

[^169]: Boyd, Stephen P.. 볼록 최적화. Cambridge University Press. (2023)

[^170]: 유엔 사무총장의 "우리의 공동 의제" 보고서

[^171]: 신세대 인공지능 윤리 규범 발표. (2021-10-12)

[^172]: Richardson, Tim. 영국, 국가 인공지능 전략 발표. (2021년 9월 22일)

[^173]: 영국 국가 AI 전략

[^174]: 영국 국가 AI 전략

[^175]: NSCAI 최종 보고서. 국가 인공지능 안보 위원회

[^176]: 공정한 자동 채용 시스템이 EU 차별 금지법을 위반하는 이유. (2023)

[^177]: cite journal doi=10.1177/1358229120927947 title=유럽 사법재판소와 유럽연합 차별 금지법에서의 실질적 평등을 향한 행보 date=2020 last1=De Vos firs

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

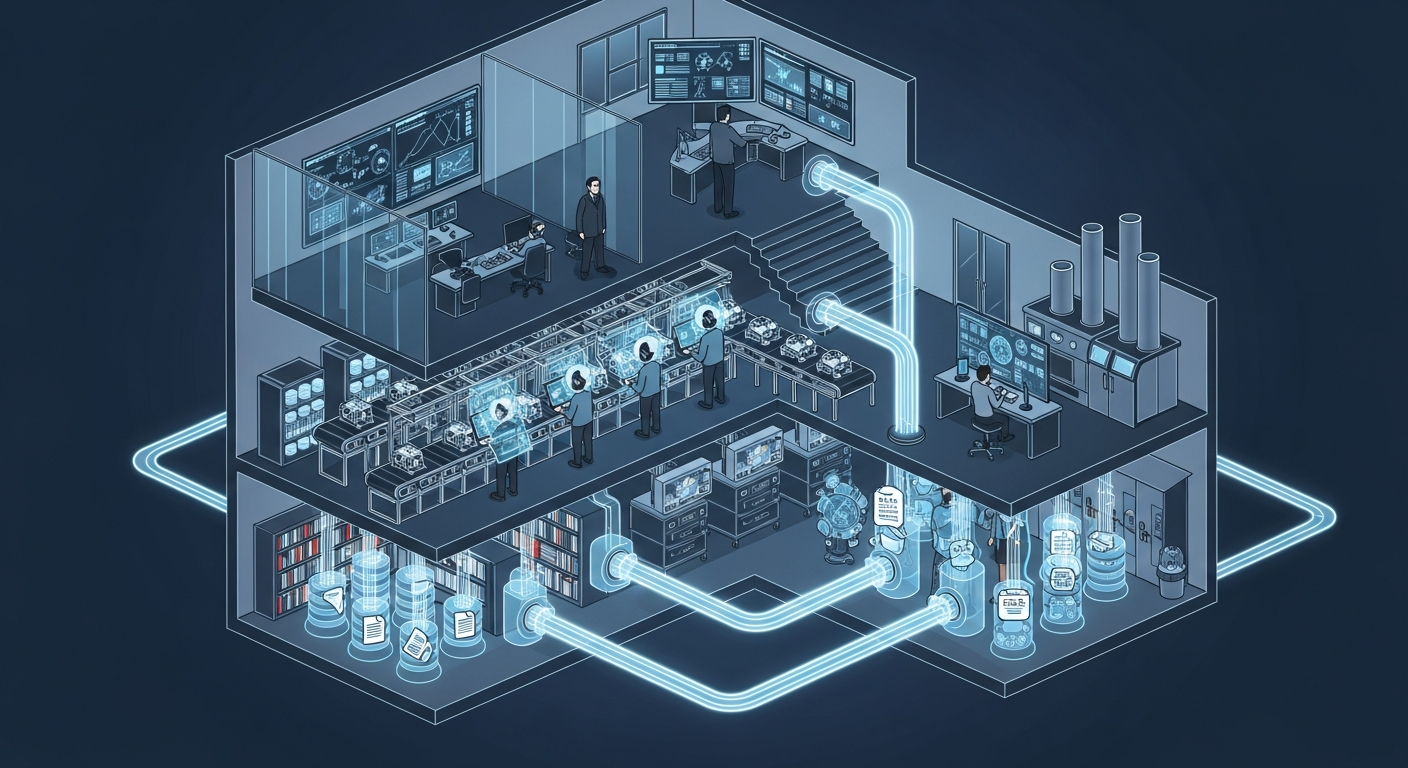

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.