AI 안전성

AI 안전성은 인공지능(AI) 시스템에서 발생하는 사고, 오용 또는 기타 유해한 결과를 방지하는 데 초점을 맞춘 학제간 연구 분야이다. AI 정렬(AI 시스템이 의도한 대로 작동하도록 보장하는 것을 목표로 함), AI 시스템의 위험 모니터링, 그리고 견고성 강화를 포괄한다. 이 분야는 특히 고급 AI 모델이 제기하는 실존적 위험에 관심을 기울인다.[^23][^6]

기술 연구를 넘어, AI 안전성은 다양한 수준의 정부 규제에 대한 옹호를 포함하여 안전을 촉진하는 규범과 정책의 개발을 수반한다.[^24][^25][^26] 이 분야는 2023년에 생성형 AI의 급속한 발전과 연구자 및 CEO들이 표명한 잠재적 위험에 대한 공적 우려와 함께 큰 주목을 받았다. 2023년 AI 안전성 정상회의 기간 동안, 미국과 영국은 각각 자체 AI 안전성 연구소를 설립하였다. 그러나 연구자들은 AI 안전성 조치가 AI 역량의 급속한 발전 속도를 따라가지 못하고 있다는 우려를 표명하였다.[^27]

동기

학자들은 핵심 시스템 장애,[^28] 편향,[^1] AI 기반 감시[^29]로 인한 현재의 위험과 더불어, 기술적 실업, 디지털 조작,[^30] 무기화,[^2] AI 기반 사이버 공격[^31] 및 생물 테러[^32]와 같은 새로운 위험에 대해 논의한다. 또한 미래의 인공일반지능(AGI) 에이전트에 대한 통제력 상실[^33]이나, AI가 영구적으로 안정된 독재 체제를 가능하게 하는 것[^34]과 같은 추측적 위험에 대해서도 논의한다.

실존적 안전성

일부는 AGI에 대한 우려를 비판해 왔는데, 앤드류 응은 2015년에 이를 "아직 행성에 발도 딛지 않았는데 화성의 인구 과밀을 걱정하는 것"에 비유하였다.[^35] 반면 스튜어트 J. 러셀은 "인간의 독창성을 과소평가하기보다는 미리 대비하는 것이 낫다"고 주장하며 신중한 태도를 촉구한다.[^36]

AI 연구자들은 AI 기술이 제기하는 위험의 심각성과 주요 원인에 대해 매우 다양한 의견을 가지고 있다[^3][^37][^38] – 다만 설문 조사에 따르면 전문가들은 중대한 결과를 초래할 수 있는 위험을 심각하게 받아들이고 있다. AI 연구자들을 대상으로 한 두 차례의 설문 조사에서, 응답자의 중앙값은 AI 전반에 대해 낙관적이었으나, 고급 AI의 "극히 나쁜(예: 인류 멸종)" 결과가 발생할 확률을 5%로 평가하였다.[^3] 2022년 자연어 처리 커뮤니티를 대상으로 한 설문 조사에서는 37%가 AI의 결정이 "최소한 전면적 핵전쟁만큼 심각한" 재앙으로 이어질 수 있다는 것이 타당하다고 동의하거나 약하게 동의하였다.[^39]

역사

AI로 인한 위험은 컴퓨터 시대가 시작될 무렵부터 본격적으로 논의되기 시작했다:

1988년 블레이 휘트비는 AI가 윤리적이고 사회적으로 책임 있는 방향으로 개발되어야 할 필요성을 개괄하는 책을 출간했다.[^41]

2008년부터 2009년까지 미국인공지능학회(AAAI)는 AI 연구 및 개발이 사회에 미칠 장기적 영향을 탐구하고 대응하기 위한 연구를 의뢰했다. 패널은 공상과학 작가들이 표현한 급진적 견해에 대해 대체로 회의적이었으나, "복잡한 컴퓨팅 시스템의 행동 범위를 이해하고 검증하여 예상치 못한 결과를 최소화하는 방법에 대한 추가 연구가 가치 있을 것"이라는 데 동의했다.[^42]

2011년 로만 얌폴스키는 인공지능의 철학과 이론 학회에서[^44] "AI 안전 공학"이라는 용어를 처음 도입하며,[^43] AI 시스템의 과거 실패 사례를 나열하고 "AI가 더 유능해질수록 이러한 사건의 빈도와 심각성은 꾸준히 증가할 것"이라고 주장했다.[^45]

2014년 철학자 닉 보스트롬은 슈퍼인텔리전스: 경로, 위험, 전략이라는 책을 출간했다. 그는 AGI의 등장이 AI에 의한 노동력 대체, 정치 및 군사 구조의 조작, 나아가 인류 멸종 가능성에 이르기까지 다양한 사회적 문제를 야기할 수 있다는 견해를 밝혔다.[^46] 미래의 고도화된 시스템이 인류의 존재에 위협이 될 수 있다는 그의 주장은 일론 머스크,[^47] 빌 게이츠,[^48] 스티븐 호킹[^49] 등이 유사한 우려를 표명하는 계기가 되었다.

2015년 수십 명의 인공지능 전문가들이 AI의 사회적 영향에 대한 연구를 촉구하고 구체적인 방향을 제시하는 인공지능에 관한 공개서한에 서명했다.[^50] 현재까지 얀 르쿤, 셰인 레그, 요슈아 벤지오, 스튜어트 러셀을 포함하여 8,000명 이상이 이 서한에 서명했다.

같은 해, 스튜어트 J. 러셀 교수가 이끄는 학자 그룹이 캘리포니아대학교 버클리에 인간 호환 AI 센터를 설립했으며, 미래생명연구소는 "인공지능(AI)이 안전하고 윤리적이며 유익하게 유지되도록 보장하는" 연구에 650만 달러의 보조금을 지원했다.[^51]

2016년 백악관 과학기술정책실과 카네기멜론대학교는 인공지능의 안전 및 제어에 관한 공개 워크숍을 발표했으며,[^52] 이는 AI의 "장점과 단점"을 조사하기 위한 네 차례의 백악관 워크숍 중 하나였다.[^53] 같은 해, 최초이자 가장 영향력 있는 기술적 AI 안전 의제 중 하나인 'AI 안전의 구체적 문제들'이 발표되었다.[^54]

2017년 미래생명연구소는 유익한 AI에 관한 아실로마 회의를 후원했으며, 100명 이상의 사상가들이 "경쟁 회피: AI 시스템을 개발하는 팀은 안전 기준의 편법적 축소를 방지하기 위해 적극적으로 협력해야 한다"는 내용을 포함한 유익한 AI 원칙을 수립했다.[^4]

2018년 딥마인드 안전팀은 사양, 견고성,[^55] 보증 분야에서의 AI 안전 문제를 개괄했다.[^5] 이듬해 연구자들은 ICLR에서 이러한 문제 영역에 초점을 맞춘 워크숍을 조직했다.[^56]

2021년 'ML 안전의 미해결 문제'가 발표되어 견고성, 모니터링, 정렬, 체계적 안전 분야의 연구 방향을 제시했다.[^6]

2023년 리시 수낙은 영국이 "글로벌 AI 안전 규제의 지리적 본거지"가 되기를 원하며 최초의 글로벌 AI 안전 정상회의를 개최하겠다고 밝혔다.[^57] AI 안전 정상회의는 2023년 11월에 개최되었으며, 프론티어 AI 모델과 관련된 오용 및 통제 상실 위험에 초점을 맞추었다.[^58] 정상회의 기간 중 고도 AI 안전에 관한 국제 과학 보고서[^59] 작성 의향이 발표되었다.

2024년 미국과 영국은 AI 안전 과학에 관한 새로운 파트너십을 체결했다. 이 양해각서는 2024년 4월 1일 미국 상무장관 지나 레이몬도와 영국 기술장관 미셸 도널런이 서명했으며, 11월 블레츨리 파크에서 열린 AI 안전 정상회의에서 발표된 약속에 따라 고도 AI 모델 테스트를 공동 개발하기 위한 것이었다.[^60]

2025년 요슈아 벤지오가 의장을 맡은 96명의 국제 전문가팀이 최초의 국제 AI 안전 보고서를 발표했다. 30개국과 유엔이 의뢰한 이 보고서는 고도 인공지능과 관련된 잠재적 위험에 대한 최초의 글로벌 과학적 검토를 담고 있다. 오용, 오작동, 사회적 혼란에서 비롯되는 잠재적 위협을 상세히 기술하고 있으며, 구체적인 권고안을 제시하지 않으면서 증거 기반 연구 결과를 통해 정책에 정보를 제공하는 것을 목표로 한다.[^61][^62]

연구 초점

AI 안전성 연구 분야에는 견고성, 모니터링, 정렬이 포함된다.[^6][^5]

견고성

적대적 견고성

AI 시스템은 종종 적대적 예제, 즉 "공격자가 모델이 실수하도록 의도적으로 설계한 기계 학습(ML) 모델에 대한 입력"에 취약하다.[^63] 예를 들어, 2013년에 Szegedy 등은 이미지에 인지할 수 없는 특정 교란을 추가하면 높은 확신도로 잘못 분류될 수 있음을 발견했다.[^7] 이는 신경망에서 여전히 문제가 되고 있지만, 최근 연구에서는 교란이 일반적으로 인지할 수 있을 정도로 충분히 크다.[^64][^65][^66]

오른쪽 이미지는 교란이 적용된 후 타조로 예측된다. (왼쪽)은 올바르게 예측된 샘플, (가운데)는 10배 확대된 교란 적용, (오른쪽)은 적대적 예제이다.[^7]

적대적 견고성은 종종 보안과 관련된다.[^67] 연구자들은 음성-텍스트 변환 시스템이 공격자가 원하는 메시지로 변환하도록 오디오 신호를 인지할 수 없게 수정할 수 있음을 시연했다.[^68] 네트워크 침입[^69] 및 악성 소프트웨어[^70] 탐지 시스템도 공격자가 탐지기를 속이기 위해 공격을 설계할 수 있으므로 적대적 견고성을 갖추어야 한다.

목표를 나타내는 모델(보상 모델)도 적대적 견고성을 갖추어야 한다. 예를 들어, 보상 모델은 텍스트 응답이 얼마나 유용한지 추정할 수 있으며 언어 모델은 이 점수를 최대화하도록 훈련될 수 있다.[^71] 연구자들은 언어 모델이 충분히 오래 훈련되면 보상 모델의 취약점을 이용하여 더 높은 점수를 달성하면서 의도된 작업에서는 더 나쁜 성능을 보인다는 것을 보여주었다.[^8] 이 문제는 보상 모델의 적대적 견고성을 개선함으로써 해결할 수 있다.[^72] 더 일반적으로, 다른 AI 시스템을 평가하는 데 사용되는 모든 AI 시스템은 적대적 견고성을 갖추어야 한다. 여기에는 모니터링 도구도 포함될 수 있는데, 이들도 잠재적으로 더 높은 보상을 생성하도록 조작될 수 있기 때문이다.

대규모 언어 모델(LLM)은 프롬프트 주입[^9] 및 모델 탈취[^73]에 취약할 수 있으며, 허위 정보 생성에 사용될 수 있다.[^74] 프롬프트 주입은 안전 조치를 우회하기 위해 프롬프트에 지시를 삽입하는 것을 포함한다.[^9]

모니터링

불확실성 추정

특히 의료 진단과 같은 고위험 환경에서 인간 운영자가 AI 시스템을 얼마나 신뢰해야 하는지 판단하는 것이 중요한 경우가 많다.[^75] ML 모델은 일반적으로 확률을 출력하여 확신도를 표현하지만, 특히 훈련받은 상황과 다른 상황에서는 종종 과도한 확신을 보인다.[^76][^77] 교정 연구는 모델 확률이 모델이 정확할 실제 비율과 가능한 한 일치하도록 하는 것을 목표로 한다.

마찬가지로, 이상 탐지 또는 분포 외(OOD) 탐지는 AI 시스템이 비정상적인 상황에 있는지 식별하는 것을 목표로 한다. 예를 들어, 자율 주행 차량의 센서가 오작동하거나 까다로운 지형을 만나면 운전자에게 제어를 맡기거나 차를 세우도록 경고해야 한다.[^78] 이상 탐지는 단순히 이상적 입력과 비이상적 입력을 구별하는 분류기를 훈련하여 구현되었으며,[^79] 다양한 추가 기법이 사용되고 있다.[^80][^81]

악의적 사용 탐지

학자들[^2]과 정부 기관들은 AI 시스템이 악의적 행위자들의 무기 제조,[^82] 여론 조작,[^83][^84] 또는 사이버 공격 자동화[^85]를 도울 수 있다는 우려를 표명했다. 이러한 우려는 강력한 AI 도구를 온라인에서 호스팅하는 OpenAI와 같은 회사들에게 현실적인 문제이다.[^86] 오용을 방지하기 위해 OpenAI는 사용자의 활동을 기반으로 플래그를 지정하거나 제한하는 탐지 시스템을 구축했다.[^87]

투명성

신경망은 흔히 블랙박스로 묘사되어 왔는데,[^10] 이는 수행하는 방대한 수의 계산으로 인해 왜 그러한 결정을 내리는지 이해하기 어렵다는 것을 의미한다.[^88] 이로 인해 실패를 예측하기가 어렵다. 2018년에 자율 주행 차량이 보행자를 식별하지 못한 후 사망 사고가 발생했다. AI 소프트웨어의 블랙박스 특성으로 인해 실패의 원인은 여전히 불분명하다.[^89] 이는 또한 통계적으로 효율적이지만 불투명한 모델을 사용해야 하는지에 대한 의료 분야에서의 논쟁을 불러일으킨다.[^90]

투명성의 핵심적인 이점 중 하나는 설명 가능성이다.[^11] 공정성을 보장하기 위해 결정이 내려진 이유에 대한 설명을 제공하는 것이 법적 요건인 경우가 있는데, 예를 들어 입사 지원서 자동 필터링이나 신용 점수 부여가 그러하다.[^11]

또 다른 이점은 실패의 원인을 밝히는 것이다.[^10] 2020년 코로나19 팬데믹 초기에 연구자들은 투명성 도구를 사용하여 의료 이미지 분류기가 관련 없는 병원 라벨에 '주의를 기울이고' 있음을 보여주었다.[^91]

투명성 기법은 오류를 수정하는 데도 사용될 수 있다. 예를 들어, "GPT에서 사실적 연관성의 위치 파악 및 편집"이라는 논문에서 저자들은 에펠탑의 위치에 대한 질문에 답하는 방식에 영향을 미치는 모델 매개변수를 식별할 수 있었다. 그런 다음 이 지식을 '편집'하여 모델이 탑이 프랑스가 아닌 로마에 있는 것처럼 질문에 답하도록 만들 수 있었다.[^92] 이 경우 저자들이 오류를 유도했지만, 이러한 방법은 잠재적으로 오류를 효율적으로 수정하는 데 사용될 수 있다. 모델 편집 기법은 컴퓨터 비전에도 존재한다.[^93]

마지막으로, AI 시스템의 불투명성이 중대한 위험 요인이며 시스템의 작동 방식을 더 잘 이해하면 미래에 심각한 결과를 초래하는 실패를 방지할 수 있다고 주장하는 이들도 있다.[^94] "내부" 해석 가능성 연구는 ML 모델의 불투명성을 줄이는 것을 목표로 한다. 이 연구의 한 가지 목표는 내부 뉴런 활성화가 무엇을 나타내는지 식별하는 것이다.[^95][^96] 예를 들어, 연구자들은 CLIP 인공지능 시스템에서 스파이더맨 의상을 입은 사람의 이미지, 스파이더맨 스케치, 그리고 '거미'라는 단어에 반응하는 뉴런을 식별했다.[^97] 또한 이러한 뉴런 간의 연결 또는 '회로'를 설명하는 것도 포함한다.[^98][^99] 예를 들어, 연구자들은 언어 모델이 맥락에서 학습하는 방식에 역할을 할 수 있는 트랜스포머 어텐션의 패턴 매칭 메커니즘을 식별했다.[^100] "내부 해석 가능성"은 신경과학에 비유되어 왔다. 두 경우 모두 복잡한 시스템에서 무슨 일이 일어나고 있는지 이해하는 것이 목표이지만, ML 연구자들은 완벽한 측정을 수행하고 임의의 절제를 할 수 있다는 이점이 있다.[^101]

트로이 목마 탐지

기계 학습 모델에는 잠재적으로 "트로이 목마" 또는 "백도어", 즉 악의적 행위자가 AI 시스템에 의도적으로 구축한 취약점이 포함될 수 있다. 예를 들어, 트로이 목마가 심어진 얼굴 인식 시스템은 특정 장신구가 보일 때 접근을 허용할 수 있으며,[^6] 트로이 목마가 심어진 자율 주행 차량은 특정 트리거가 보일 때까지 정상적으로 작동할 수 있다.[^102] CLIP이나 GPT-3과 같은 일부 대규모 모델은 공개적으로 이용 가능한 인터넷 데이터로 훈련되기 때문에 이를 수행하는 것이 어렵지 않을 수 있다.[^103] 연구자들은 300만 개의 훈련 이미지 중 단 300개만 변경하여 이미지 분류기에 트로이 목마를 심을 수 있었다.[^104] 보안 위험을 제기하는 것 외에도, 연구자들은 트로이 목마가 더 나은 모니터링 도구를 테스트하고 개발하기 위한 구체적인 환경을 제공한다고 주장했다.

2024년 Anthropic의 연구 논문은 대규모 언어 모델이 지속적인 백도어를 가지도록 훈련될 수 있음을 보여주었다. 이러한 "슬리퍼 에이전트" 모델은 특정 날짜 이후에 악의적인 출력(취약한 코드 등)을 생성하도록 프로그래밍될 수 있으며, 그 전에는 정상적으로 동작한다. 지도 미세 조정, 강화 학습, 적대적 훈련과 같은 표준 AI 안전 조치로는 이러한 백도어를 제거하지 못했다.[^105]

정렬

체계적 안전성과 사회기술적 요인

AI 위험(그리고 기술적 위험 전반)은 오용 또는 사고로 분류되는 것이 일반적이다.[^12] 일부 학자들은 이 프레임워크가 불충분하다고 제안했다.[^12] 예를 들어, 쿠바 미사일 위기는 명확히 사고나 기술의 오용이 아니었다.[^12] 정책 분석가 Zwetsloot과 Dafoe는 "오용과 사고 관점은 피해로 이어지는 인과 사슬의 마지막 단계, 즉 기술을 오용한 사람이나 의도하지 않은 방식으로 행동한 시스템에만 초점을 맞추는 경향이 있다... 그러나 관련 인과 사슬은 훨씬 더 긴 경우가 많다"고 썼다. 위험은 종종 경쟁 압력, 피해의 확산, 빠른 개발 속도, 높은 수준의 불확실성, 부적절한 안전 문화와 같은 '구조적' 또는 '체계적' 요인에서 발생한다.[^12] 안전 공학의 더 넓은 맥락에서 '조직 안전 문화'와 같은 구조적 요인은 널리 사용되는 STAMP 위험 분석 프레임워크에서 핵심적인 역할을 한다.[^106]

구조적 관점에 영감을 받아, 일부 연구자들은 기계 학습을 활용하여 사회기술적 안전 요인을 개선하는 것의 중요성을 강조했는데, 예를 들어 ML을 사이버 방어에 활용하고, 제도적 의사 결정을 개선하며, 협력을 촉진하는 것이다.[^6] 다른 연구자들은 구조적 취약점을 해결하기 위해 AI 실무자와 도메인 전문가 모두를 설계 과정에 참여시키는 것의 중요성을 강조했다.[^18]

사이버 방어

일부 학자들은 AI가 사이버 공격자와 사이버 방어자 사이의 이미 불균형한 게임을 더욱 악화시킬 것이라고 우려한다.[^107] 이는 '선제 공격' 유인을 증가시키고 더 공격적이고 불안정한 공격으로 이어질 수 있다. 이러한 위험을 완화하기 위해 일부에서는 사이버 방어에 대한 강조를 높일 것을 주장했다. 또한, 강력한 AI 모델이 도난당하고 오용되는 것을 방지하기 위해 소프트웨어 보안이 필수적이다.[^2] 최근 연구에 따르면 AI는 일상적인 작업을 자동화하고 전반적인 효율성을 향상시킴으로써 기술적 및 관리적 사이버 보안 작업을 크게 향상시킬 수 있다.[^108] AI 안전성 연구는 또한 훈련 중 데이터 오염 공격으로부터 기계 학습 시스템을 보호하기 위한 방어 기법을 검토했다. 특히, 레이블 뒤집기 공격은 기존 데이터 검증 방법으로는 탐지하기 어려우면서도 모델 성능을 저하시킬 수 있다. 이러한 위험에 대응하기 위해 최근 연구에서는 학습 행동을 모니터링하고 여러 탐지기를 결합하여 의심스러운 훈련 샘플을 식별하는 모델 불가지론적 탐지 파이프라인을 제안했다. 이러한 접근 방식은 적대적 환경에서 작동하는 AI 시스템의 복원력과 신뢰성을 향상시켜 사이버 방어를 강화하는 것을 목표로 한다.[^109][^110]

제도적 의사 결정 개선

경제 및 군사 분야에서의 AI 발전은 전례 없는 정치적 도전을 촉발할 수 있다.[^111] 일부 학자들은 AI 경쟁 역학을 냉전에 비유했는데, 냉전에서는 소수의 의사 결정자들의 신중한 판단이 종종 안정과 재앙의 차이를 결정지었다.[^13] AI 연구자들은 AI 기술이 의사 결정을 지원하는 데에도 사용될 수 있다고 주장했다.[^6] 예를 들어, 연구자들은 AI 예측[^112] 및 자문 시스템[^113]을 개발하기 시작하고 있다.

협력 촉진

가장 큰 글로벌 위협(핵전쟁,[^114] 기후 변화,[^14] 등) 중 다수는 협력 과제로 틀지어져 왔다. 잘 알려진 죄수의 딜레마 시나리오에서처럼, 일부 역학은 모든 참여자가 자신의 이익을 위해 최적으로 행동하더라도 모두에게 나쁜 결과를 초래할 수 있다. 예를 들어, 아무도 개입하지 않으면 결과가 심각할 수 있음에도 불구하고 어떤 단일 행위자도 기후 변화에 대응할 강력한 유인을 갖지 않는다.[^14]

두드러진 AI 협력 과제는 '바닥을 향한 경쟁'을 피하는 것이다.[^15] 이 시나리오에서 국가나 기업들이 더 강력한 AI 시스템을 구축하기 위해 경쟁하면서 안전을 소홀히 하여, 관련된 모든 이에게 피해를 주는 재앙적 사고로 이어진다. 이와 같은 시나리오에 대한 우려는 인간 간, 그리고 잠재적으로 AI 시스템 간의 협력을 촉진하기 위한 정치적[^16] 및 기술적[^115] 노력 모두에 영감을 주었다. 대부분의 AI 연구는 개별 에이전트가 고립된 기능(종종 '1인용' 게임에서)을 수행하도록 설계하는 데 초점을 맞추고 있다.[^17] 학자들은 AI 시스템이 더 자율적이 됨에 따라 이들이 상호 작용하는 방식을 연구하고 형성하는 것이 필수적이 될 수 있다고 제안했다.[^17][^18]

거버넌스에서

![The AI Safety Summit of November 2023^116 ] AI 거버넌스는 AI 시스템의 사용과 개발을 안내하기 위한 규범, 표준 및 규제를 만드는 것에 광범위하게 관여한다.[^13]

연구

AI 안전에서 지역적 해결책은 개별 AI 시스템이 안전하고 유익하도록 보장하는 데 초점을 맞추는 반면, 글로벌 해결책은 다양한 관할권에 걸쳐 모든 AI 시스템에 대한 안전 조치를 구현하고자 한다.[^117]

AI 안전 거버넌스 연구는 AI의 잠재적 영향에 대한 기초적 조사부터 구체적 응용까지 다양하다. 기초적 측면에서 연구자들은 AI가 광범위한 적용 가능성으로 인해 사회의 많은 측면을 변화시킬 수 있다고 주장하며, 이를 전기와 증기기관에 비유했다.[^118] 일부 연구는 이러한 영향에서 발생할 수 있는 구체적 위험을 예측하는 데 초점을 맞추었다 – 예를 들어, 대량 실업,[^119] 무기화,[^120] 허위정보,[^121] 감시,[^122] 그리고 권력 집중으로 인한 위험이다.[^123] 다른 연구는 급속히 진화하는 AI 산업을 모니터링하는 어려움,[^124] AI 모델의 가용성,[^19] 그리고 '바닥을 향한 경쟁' 역학[^15][^125]과 같은 근본적인 위험 요인을 탐구한다. 딥마인드의 장기 거버넌스 및 전략 책임자인 Allan Dafoe는 경쟁의 위험성과 협력의 잠재적 필요성을 강조했다: "첨단 강력 시스템을 배치하기 전에 높은 수준의 신중함을 갖추는 것이 AI 안전과 정렬에 거의 필요충분조건에 가까울 수 있다; 그러나 행위자들이 선점자 또는 상대적 우위에 큰 보상이 있는 영역에서 경쟁하고 있다면, 그들은 최적 이하의 신중함 수준을 선택하도록 압박받게 될 것이다".[^16] 한 연구 흐름은 AI 책임성을 평가하기 위한 접근법, 프레임워크 및 방법을 개발하고, AI 기반 시스템의 감사를 안내하고 촉진하는 데 초점을 맞춘다.[^126][^127][^128] 이러한 접근법의 핵심 과제는 널리 수용되는 표준의 부재와 해당 방법이 무엇을 요구하는지에 대한 모호성,[^129][^130] 그리고 업계의 안전 문화 부족이다.[^20]

AI 안전을 강화하기 위한 노력에는 AI 출력을 윤리적 지침에 맞추고 오용 및 데이터 유출과 같은 위험을 줄이도록 설계된 프레임워크가 포함된다. 엔비디아의 Guardrails,[^131] Llama Guard,[^132] Preamble의 맞춤형 가드레일[^133] 및 Claude의 Constitution과 같은 도구는 프롬프트 주입과 같은 취약점을 완화하고 출력이 사전 정의된 원칙을 준수하도록 보장한다. 이러한 프레임워크는 안전성과 신뢰성을 향상시키기 위해 AI 시스템에 통합되는 경우가 많다.[^134]

철학적 관점

AI 안전 분야는 특히 윤리학 영역에서 철학적 고려와 깊이 얽혀 있다. 도덕적 규칙 준수를 강조하는 의무론적 윤리학은 AI 시스템을 인간의 가치에 정렬시키기 위한 프레임워크로 제안되었다. 일부에서는 의무론적 원칙을 내장함으로써 AI 시스템이 해를 끼치는 행동을 피하도록 유도하여 운영이 윤리적 경계 내에 머물도록 보장할 수 있다고 제안했으나,[^135] 그러한 제안에 의문이 제기되었으며, 더 유망한 것으로 다른 대안이 제시되었다.[^136]

정부 조치

일부 전문가들은 AI를 규제하기에는 너무 이르다고 주장하며, 규제가 혁신을 저해할 것이라는 우려와 함께 "무지 속에서 성급하게 규제하는 것"은 어리석은 일이라고 표명했다.[^137][^138] 반면 사업가 일론 머스크와 같은 이들은 재앙적 위험을 완화하기 위한 선제적 조치를 촉구한다.[^139]

공식적인 법률 외에도 정부 기관들은 윤리적 및 안전 권고안을 제시해 왔다. 2021년 3월, 미국 국가안보위원회 인공지능 분과는 AI의 발전이 "시스템이 안전성, 견고성 및 신뢰성을 포함한 목표와 가치에 정렬되도록 보장하는 것"의 중요성을 점점 더 높일 수 있다고 보고했다.[^140] 이후, 미국 국립표준기술연구소는 AI 위험 관리 프레임워크 초안을 작성했으며, 이는 "재앙적 위험이 존재하는 경우 – 위험이 충분히 관리될 수 있을 때까지 안전한 방식으로 개발과 배치를 중단해야 한다"고 권고한다.[^141]

2021년 9월, 중화인민공화국(PRC)은 중국에서의 AI 사용에 대한 윤리 지침을 발표하여, AI 결정이 인간의 통제 하에 유지되어야 함을 강조하고 책임 메커니즘을 요구했다. 같은 달, 영국은 10개년 국가 AI 전략을 발표했으며,[^142] 이 전략에서 영국 정부는 "정렬되지 않은 범용 인공지능의 장기적 위험과 그것이 ... 세계에 의미할 예측 불가능한 변화를 심각하게 받아들인다"고 명시했다.[^21] 이 전략은 재앙적 위험을 포함한 장기적 AI 위험을 평가하기 위한 조치를 설명한다.[^21] 영국 정부는 AI 안전에 관한 최초의 주요 글로벌 정상회의를 개최했다. 이는 2023년 11월 1일과 2일에 열렸으며 "정책 입안자들과 세계 지도자들이 AI의 즉각적이고 미래적인 위험과 이러한 위험을 글로벌 조정 접근법을 통해 어떻게 완화할 수 있는지 고려할 기회"로 묘사되었다.[^143][^144] 차이나 미디어 프로젝트는 "그 접근법의 핵심 측면들이 전 세계 민주주의 사회의 기준으로 볼 때 근본적으로 안전하지 않다"고 지적하며, 중국의 AI 안전 접근법의 일부가 중국 공산당의 정보 통제를 강화하는 데 초점을 맞추고 있다고 주장했다.[^145]

정부 기관들, 특히 미국에서는 기술적 AI 안전 연구의 발전도 장려해 왔다. 정보고등연구활동국(IARPA)은 AI 시스템에 대한 트로이목마 공격을 식별하고 방어하기 위한 TrojAI 프로젝트를 시작했다.[^146] 미국 방위고등연구계획국(DARPA)은 설명 가능한 인공지능과 적대적 공격에 대한 견고성 향상에 관한 연구에 참여하고 있다.[^147][^148] 그리고 국립과학재단은 신뢰할 수 있는 기계학습 센터를 지원하며, 경험적 AI 안전 연구에 수백만 달러의 자금을 제공하고 있다.[^149]

2024년, 유엔 총회는 AI 시스템의 설계, 개발, 배치 및 사용에 있어 인권의 존중, 보호 및 증진을 강조하는 "안전하고, 보안되며, 신뢰할 수 있는" AI 시스템 촉진에 관한 최초의 글로벌 결의안을 채택했다.[^150]

2024년 5월, 영국 과학혁신기술부(DSIT)는 AI 안전 연구소의 Christopher Summerfield와 Shahar Avin이 이끄는 체계적 AI 안전 신속 보조금 프로그램에 따라 영국 연구혁신기구(UKRI)와의 파트너십으로 AI 안전 연구에 850만 파운드의 자금 지원을 발표했다. 기술부 장관 Michelle Donelan은 AI 서울 정상회의에서 이 계획을 발표하며, 목표는 사회 전반에 걸쳐 AI를 안전하게 만드는 것이며 유망한 제안에는 추가 자금이 지원될 수 있다고 밝혔다. 영국은 또한 협력을 촉진하고 정보와 자원을 공유하기 위해 10개국 및 EU와 AI 안전 연구소의 국제 네트워크를 구성하는 협정에 서명했다. 또한 영국 AI 안전 연구소는 샌프란시스코에 사무소를 개설할 계획이었다.[^151]

2024년 11월, 당시 대통령이었던 조 바이든과 중국 시진핑 주석은 인공지능이 아닌 인간이 핵무기 사용에 대한 통제를 유지해야 할 필요성을 확인했다.[^152][^153] 2025 회계연도 국방수권법의 일환으로, 의회는 제1638조 "전략적 억제를 지원하기 위한 인공지능 사용에 관한 의회의 의견"을 미국 연방법전에 제정했다. 이 조항은 "인공지능 활용 노력이 무기 시스템의 기능, 지휘 당국의 통신 검증, 또는 핵무기 사용에 관한 대통령의 결정 집행에 있어 긍정적인 인간 행동을 요구하는 원칙을 통해 핵 안전장치의 무결성을 훼손해서는 안 된다"고 규정한다.[^154][^155] 2026년 2월, 트럼프 행정부는 핵무기 결정이 인간의 통제 하에 유지될 것임을 공개적으로 재확인했으며, 국방부 고위 관리는 "핵무기 사용 여부에 관한 모든 결정에 인간이 관여한다는 국방부의 정책"을 재차 강조했다.[^156]

2025년 12월, 도널드 트럼프 대통령은 "인공지능 국가 정책 프레임워크"를 수립하기 위한 행정명령에 서명했다.[^157] 이 행정명령은 주 정부의 AI 규제를 억제하고, 의회에 그러한 규제를 선점하는 법안을 통과시킬 것을 촉구했다.[^158] 백악관은 경제적 및 국가안보적 우려를 이 조치의 이유로 인용했으며, 일부에서는 트럼프가 AI 규제에 불확실성을 조성했다고 비판했다.[^159][^160][^161]

기업 자율규제

AI 연구소와 기업들은 일반적으로 공식적인 법률 범위 밖에 있는 안전 관행과 규범을 준수한다.[^162] 거버넌스 연구자들의 한 가지 목표는 이러한 규범을 형성하는 것이다. 문헌에서 발견되는 안전 권고 사례로는 제3자 감사 수행,[^22] 실패 발견에 대한 포상금 제공,[^22] AI 사고 공유[^22] (이를 위해 AI 사고 데이터베이스가 만들어졌다),[^163] 연구나 모델의 공개 여부를 결정하기 위한 지침 준수,[^19] 그리고 AI 연구소의 정보 및 사이버 보안 개선이 있다.[^164]

기업들도 약속을 해왔다. Cohere, OpenAI, AI21은 오용 완화에 초점을 맞춘 "언어 모델 배포를 위한 모범 사례"를 제안하고 합의했다.[^165] 경쟁 역학에 기여하는 것을 피하기 위해, OpenAI는 자사 헌장에서 "가치 정렬적이고 안전 의식적인 프로젝트가 우리보다 먼저 AGI 구축에 근접하게 되면, 우리는 경쟁을 중단하고 해당 프로젝트를 지원하기 시작할 것을 약속한다"고 명시했다.[^166] 또한, 딥마인드의 CEO Demis Hassabis, 페이스북 AI 디렉터 Yann LeCun과 같은 업계 지도자들은 아실로마 원칙[^4]과 자율무기 공개서한[^167]과 같은 공개서한에 서명했다.

비영리 단체

2020년대에 미국과 유럽에서 AI 안전 및 관련 공공 정책에 초점을 맞춘 여러 비영리 단체가 등장했으며, 여기에는 안전한 AI를 위한 연합(Alliance for Secure AI), 생명의 미래 연구소(Future of Life Institute), 퍼블릭 퍼스트 액션(Public First Action) 등이 포함된다.[^168][^169] 이러한 단체들은 종종 실리콘밸리 감시자 역할을 하며 특정 연방, 주 또는 지방 규제를 옹호한다.[^170][^171] 이들은 또한 AI 기업의 규제 완화를 옹호하는 리딩 더 퓨처(Leading the Future)와 같은 업계 단체와 경쟁한다.[^172][^173]

같이 보기

- AI 정렬

- AI 전쟁

- 인공지능과 선거

- 인공지능 탐지 소프트웨어

- 환각 (인공지능)

외부 링크

- ML 안전성의 미해결 문제

- 기초 모델의 기회와 위험에 관하여

- 재앙적 AI 위험 개요

- AI 사고: 새로운 위협

- 더 안전한 세계의 공학

참고 문헌

[^1]: Mehrabi, Ninareh. 기계 학습의 편향과 공정성에 관한 조사. (2021)

[^2]: Brundage, Miles. 인공지능의 악의적 사용: 예측, 예방 및 완화. Apollo - 케임브리지 대학교 리포지토리. (2018-04-30)

[^3]: Grace, Katja. 관점: AI는 언제 인간의 성능을 초월할 것인가? AI 전문가들의 증거. (2018-07-31)

[^4]: 웹 인용 last = Future of Life Institute title = AI 원칙 work = Future of Life Institute access-date = 2022-11-23 url = https://futureoflife.org/open-letter/ai-principles/ archive-date = 2

[^5]: 웹 인용 last = Research first = DeepMind Safety title = 안전한 인공지능 구축: 사양, 견고성 및 보증 work = Medium access-date = 2022-11-23 date = 2018-09-27

[^6]: Hendrycks, Dan. 기계 학습 안전성의 미해결 문제. (2022-06-16)

[^7]: Szegedy, Christian. 신경망의 흥미로운 속성. (2014-02-19)

[^8]: Gao, Leo. 보상 모델 과최적화에 대한 스케일링 법칙. (2022-10-19)

[^9]: , . 프롬프트 인젝션 공격은 '결코 제대로 완화되지 못할 수 있다'고 영국 NCSC가 경고. (2025-12-09)

[^10]: 저널 인용 doi = 10.1038/d41586-022-00858-1 last = Savage first = Neil title = 인공지능의 블랙박스에 침입하기 journal = Nature access-date = 2022-11-24 date = 2022-03-

[^11]: Doshi-Velez, Finale. 법률 하의 AI 책임: 설명의 역할. (2019-12-20)

[^12]: 웹 인용 last1 = Zwetsloot first1 = Remco last2 = Dafoe first2 = Allan title = AI로부터의 위험에 대한 사고: 사고, 오용 및 구조 work = Lawfare access-date = 2022-11-24 date = 2019

[^13]: AV 미디어 인용 people = Future of Life Institute title = AI 전략, 정책 및 거버넌스 (Allan Dafoe) access-date = 2022-11-23 date = 2019-03-27 time = 22:05 url = https://www.youtube.com/wa

[^14]: 웹 인용 last = Newkirk II first = Vann R. title = 기후변화는 죄수의 딜레마인가 사슴 사냥인가? work = [[The Atlantic]] access-date = 2022-11-24 date = 2016-04-21 url = https://www.t

[^15]: 보고서 인용 publisher = Future of Humanity Institute, Oxford University last1 = Armstrong first1 = Stuart last2 = Bostrom first2 = Nick last3 = Shulman first3 = Carl title = 선점을 향한 경쟁

[^16]: 보고서 인용 publisher = Centre for the Governance of AI, Future of Humanity Institute, University of Oxford last = Dafoe first = Allan title = AI 거버넌스: 연구 의제

[^17]: Dafoe, Allan. 협력적 AI: 기계는 공통 기반을 찾는 법을 배워야 한다. (2021)

[^18]: Gazos, Alexandros. 안전을 위한 AI 조직화: AI 강화 사회기술 시스템 설계를 안내하기 위한 구조적 취약성 식별. (2025-04-01)

[^19]: 웹 인용 last = Shevlane first = Toby title = 강력한 AI 모델 공유 ! GovAI 블로그 work = Center for the Governance of AI access-date = 2022-11-24 date = 2022 url = https://www.governanc

[^20]: SSRN 인용 last = Manheim first = David title = AI를 위한 안전 문화 구축: 관점과 과제 date = 26 June 2023 ssrn = 4491421

[^21]: 안내: 국가 AI 전략. (2021)

[^22]: Brundage, Miles. 신뢰할 수 있는 AI 개발을 향하여: 검증 가능한 주장을 지원하기 위한 메커니즘. (2020-04-20)

[^23]: Ahmed, Shazeda. 분야 구축과 AI 안전성의 인식론적 문화. (2024-04-14)

[^24]: Champagne, Dylan. 트럼프 대통령, 주 차원의 AI 규제를 겨냥하다. (2026-02-26)

[^25]: 캘리포니아의 AI 안전법이란?. (2025-12-23)

[^26]: 인공지능 2024년 입법

[^27]: Perrigo, Billy. 영국 AI 안전 정상회의, 제한적이지만 의미 있는 진전으로 마무리. (2023-11-02)

[^28]: Carnegie Mellon University

[^29]: 보고서 인용 publisher = Carnegie Endowment for International Peace last = Feldstein first = Steven author-link=Steven Feldstein title = AI 감시의 글로벌 확산 date = 2019

[^30]: 저널 인용 last = Barnes first = Beth title = AI 설득의 위험 journal = Lesswrong access-date = 2022-11-23 date = 2021 url = https://www.lesswrong.com/posts/5cWtwATHL6KyzChck/risks-f

[^31]: Davies, Pascale. NATO가 새로운 AI 사이버 공격 시대에 어떻게 대비하고 있는가. (2022년 12월 26일)

[^32]: Ahuja, Anjana. AI의 생물테러 잠재력을 배제해서는 안 된다. (2024년 2월 7일)

[^33]: Carlsmith, Joseph. 권력 추구 AI는 실존적 위험인가?. (2022-06-16)

[^34]: Minardi, Di. 멸종보다 더 나쁠 수 있는 암울한 운명. (2020년 10월 16일)

[^35]: AGI 전문가 Peter Voss, AI 정렬 문제는 허구라고 주장 {{!. (2023-04-04)

[^36]: 웹 인용 last = Dafoe first = Allan title = 그렇다, 우리는 인공지능의 실존적 위험에 대해 우려하고 있다 work = MIT Technology Review access-date = 2022-11-28 date = 2016 url = htt

[^37]: Zhang, Baobao. 인공지능의 윤리와 거버넌스: 기계 학습 연구자 설문조사의 증거. (2021-05-05)

[^38]: Stein-Perlman, Zach. 2022년 AI 진보에 관한 전문가 설문조사. (2022-08-04)

[^39]: Michael, Julian. NLP 연구자들은 무엇을 믿는가? NLP 커뮤니티 메타설문조사 결과. (2022-08-26)

[^40]: 뉴스 인용 issn = 0362-4331 last = Markoff first = John author-link = John Markoff title = 1949년, 그는 로봇의 시대를 상상했다 work = The New York Times access-date = 2022-11-23 date = 2013-05

[^41]: 도서 인용 url=https://sussex.figshare.com/articles/book/Artificial_intelligence_a_handbook_of_professionalism/23312414 isbn=978-0-470-21103-8 title=인공지능: 전문성 핸드북

[^42]: Association for the Advancement of Artificial Intelligence. AAAI 장기 AI 미래에 관한 회장단 패널

[^43]: Yampolskiy, Roman V.. 인공지능 안전과 사이버 보안: AI 실패의 연대기. (2016-10-25)

[^44]: PT-AI 2011 – 인공지능의 철학과 이론 (PT-AI 2011)

[^45]: Yampolskiy, Roman V.. 인공지능 안전 공학: 기계 윤리가 왜 잘못된 접근법인가. Springer Berlin Heidelberg. (2013)

[^46]: McLean, Scott. 범용 인공지능과 관련된 위험: 체계적 문헌 검토. (2023-07-04)

[^47]: Wile, Rob. 일론 머스크: 인공지능은 '핵무기보다 잠재적으로 더 위험하다'. (2014년 8월 3일)

[^48]: Kuo, Kaiser. 바이두 CEO 로빈 리가 보아오 포럼에서 빌 게이츠와 일론 머스크를 인터뷰하다, 2015년 3월 29일. (2015-03-31)

[^49]: 뉴스 인용 last = Cellan-Jones first = Rory author-link= Rory Cellan-Jones title = 스티븐 호킹, 인공지능이 인류를 멸종시킬 수 있다고 경고 work = BBC News access-date = 2022-11-23 date =

[^50]: 웹 인용 last = Future of Life Institute title = 강건하고 유익한 인공지능을 위한 연구 우선순위: 공개 서한 work = Future of Life Institute access-date = 2022-11-23 url

[^51]: 웹 인용 last = Future of Life Institute title = AI 연구 보조금 프로그램 work = Future of Life Institute date = October 2016 access-date = 2022-11-23 url = https://futureoflife.org/ai-researc

[^52]: 웹 인용 title = SafArtInt 2016 access-date = 2022-11-23 url = https://www.cmu.edu/safartint/ archive-date = 2022-11-23 archive-url = https://web.archive.org/web/20221123074311/https://www.cmu.ed

[^53]: 웹 인용 last = Bach first = Deborah title = UW, 인공지능에 관한 4차례 백악관 공개 워크숍 중 첫 번째를 개최 work = UW News access-date = 2022-11-23 date = 2016 url = https://w

[^54]: Amodei, Dario. AI 안전성의 구체적 문제들. (2016-07-25)

[^55]: Yohsua, Bengio. 첨단 AI의 안전성에 관한 국제 과학 보고서. Department for Science, Innovation and Technology. (2024년 5월)

[^56]: 웹 인용 title = SafeML ICLR 2019 워크숍 access-date = 2022-11-23 url = https://sites.google.com/view/safeml-iclr2019 archive-date = 2022-11-23 archive-url = https://web.archive.org/web/2022112

[^57]: Browne, Ryan. 영국 총리 리시 수낙, 런던이 차세대 실리콘밸리가 되기를 목표로 하면서 영국을 AI 안전 규제의 본거지로 홍보. (2023-06-12)

[^58]: Bertuzzi, Luca. 영국 AI 안전 정상회의, '프론티어' 모델에 대한 인간 통제력 상실 위험을 부각할 예정. (2023년 10월 18일)

[^59]: Bengio, Yoshua. 첨단 AI의 안전성에 관한 국제 과학 보고서. (2024-05-17)

[^60]: Shepardson, David. 미국과 영국, AI 안전 및 테스트에 관한 파트너십 발표. (2024년 4월 1일)

[^61]: , . 국제 AI 안전 보고서가 일자리, 기후, 사이버전 등에 대해 말하는 것. (2025-01-29)

[^62]: Yoshua Bengio가 의장을 맡은 AI 안전에 관한 최초 국제 보고서 발표. (2025년 1월 29일)

[^63]: 웹 인용 last1 = Goodfellow first1 = Ian last2 = Papernot first2 = Nicolas last3 = Huang first3 = Sandy last4 = Duan first4 = Rocky last5 = Abbeel first5 = Pieter last6 = Clark first6 = Ja

[^64]: Kurakin, Alexey. 물리적 세계에서의 적대적 예제. (2017-02-10)

[^65]: Madry, Aleksander. 적대적 공격에 강건한 딥러닝 모델을 향하여. (2019-09-04)

[^66]: Kannan, Harini. 적대적 로짓 페어링. (2018-03-16)

[^67]: Gilmer, Justin. 적대적 예제 연구를 위한 게임 규칙의 동기 부여. (2018-07-19)

[^68]: Carlini, Nicholas. 오디오 적대적 예제: 음성-텍스트 변환에 대한 표적 공격. (2018-03-29)

[^69]: Sheatsley, Ryan. 제약된 도메인에서의 적대적 예제. (2022-09-09)

[^70]: Suciu, Octavian. 악성코드 탐지에서의 적대적 예제 탐구. (2019-04-13)

[^71]: Ouyang, Long. 인간 피드백을 통한 지시 따르기 언어 모델 훈련. (2022-03-04)

[^72]: Yu, Sihyun. RoMA: 오프라인 모델 기반 최적화를 위한 강건한 모델 적응. (2021-10-27)

[^73]: Anthropic과 OpenAI가 LLM 모델 가중치 보호에 집착하는 이유. (2023-12-15)

[^74]: AI 가짜 뉴스의 부상이 '허위정보 슈퍼전파자'를 만들고 있다. (2023-12-17)

[^75]: Tran, Khoa A.. 암 진단, 예후 및 치료 선택에서의 딥러닝. (2021)

[^76]: 학회 인용 publisher = PMLR volume = 70 pages = 1321–1330 last1 = Guo first1 = Chuan last2 = Pleiss first2 = Geoff last3 = Sun first3 = Yu last4 = Weinberger first4 = Kilian Q. title

[^77]: Ovadia, Yaniv. 모델의 불확실성을 신뢰할 수 있는가? 데이터셋 변이 하의 예측 불확실성 평가. (2019-12-17)

[^78]: Bogdoll, Daniel. 2021 IEEE/CVF 국제 컴퓨터 비전 워크숍 학회 (ICCVW). (2021)

[^79]: Hendrycks, Dan. 이상치 노출을 통한 심층 이상 탐지. (2019-01-28)

[^80]: Wang, Haoqi. ViM: 가상 로짓 매칭을 이용한 분포 외 탐지. (2022-03-21)

[^81]: Hendrycks, Dan. 신경망에서 오분류 및 분포 외 예제 탐지를 위한 기준선. (2018-10-03)

[^82]: Urbina, Fabio. 인공지능 기반 신약 개발의 이중 용도. (2022)

[^83]: Center for Security and Emerging Technology. 진실, 거짓말, 그리고 자동화: 언어 모델이 허위정보를 어떻게 변화시킬 수 있는가. (2021)

[^84]: 웹 인용 title = 대규모 언어 모델이 악용될 경우 서비스형 선전이 곧 현실이 될 수 있다 work = VentureBeat access-date = 2022-11-24 date = 2021-12-14 url = https://venturebeat.com/ai/p

[^85]: Center for Security and Emerging Technology. 사이버 공격 자동화: 과대광고와 현실. (2020)

[^86]: 웹 인용 title = 언어 모델 안전성과 오용에 대한 교훈 work = OpenAI access-date = 2022-11-24 date = 2022-03-03 url = https://openai.com/blog/language-model-safety-and-misuse/ arch

[^87]: 웹 인용 last1 = Markov first1 = Todor last2 = Zhang first2 = Chong last3 = Agarwal first3 = Sandhini last4 = Eloundou first4 = Tyna last5 = Lee first5 = Teddy last6 = Adler first6 = Steve

[^88]: Center for Security and Emerging Technology. AI 안전성의 핵심 개념: 기계 학습에서의 해석 가능성. (2021)

[^89]: 웹 인용 last = McFarland first = Matt title = 우버, 자율주행차 최초 사망 사고 후 자율주행차 운행 중단 work = CNNMoney access-date = 2022-11-24 date = 2018-03-19 url = https:

[^90]: Felder, Ryan Marshall. 블랙박스 문제와 마주하기: 의료 분야에서 AI 시스템을 정당화하는 방법. (2021년 7월)

[^91]: Fong, Ruth. 2017 IEEE 국제 컴퓨터 비전 학회 (ICCV). (2017)

[^92]: 저널 인용 volume = 35 last1 = Meng first1 = Kevin last2 = Bau first2 = David last3 = Andonian first3 = Alex last4 = Belinkov first4 = Yonatan title = 사실적 연관성의 위치 파악 및 편집

[^93]: Bau, David. 심층 생성 모델 재작성. (2020-07-30)

[^94]: Räuker, Tilman. 투명한 AI를 향하여: 심층 신경망의 내부 구조 해석에 관한 조사. (2022-09-05)

[^95]: Bau, David. 네트워크 해부: 심층 시각적 표현의 해석 가능성 정량화. (2017-04-19)

[^96]: McGrath, Thomas. AlphaZero에서의 체스 지식 습득. (2022-11-22)

[^97]: 저널 인용 doi = 10.23915/distill.00030 last1 = Goh first1 = Gabriel last2 = Cammarata first2 = Nick last3 = Voss first3 = Chelsea last4 = Carter first4 = Shan last5 = Petrov first5 = Mic

[^98]: 저널 인용 doi = 10.23915/distill.00024.001 last1 = Olah first1 = Chris last2 = Cammarata first2 = Nick last3 = Schubert first3 = Ludwig last4 = Goh first4 = Gabriel last5 = Petrov first5

[^99]: 저널 인용 doi = 10.23915/distill.00024.006 last1 = Cammarata first1 = Nick last2 = Goh first2 = Gabriel last3 = Carter first3 = Shan last4 = Voss first4 = Chelsea last5 = Schubert first5

[^100]: 저널 인용 last1 = Olsson first1 = Catherine last2 = Elhage first2 = Nelson last3 = Nanda first3 = Neel last4 = Joseph first4 = Nicholas last5 = DasSarma first5 = Nova last6 = Henighan f

[^101]: 웹 인용 last = Olah first = Christopher title = 해석 가능성 대 신경과학 [대략적 메모] access-date = 2022-11-24 url = https://colah.github.io/notes/interp-v-neuro/ archive-date = 2022-11

[^102]: Gu, Tianyu. BadNets: 기계 학습 모델 공급망의 취약점 식별. (2019-03-11)

[^103]: Chen, Xinyun. 데이터 포이즈닝을 이용한 딥러닝 시스템에 대한 표적 백도어 공격. (2017-12-14)

[^104]: Carlini, Nicholas. 대조 학습의 포이즈닝과 백도어. (2022-03-28)

[^105]: '슬리퍼 에이전트' AI 어시스턴트가 코드를 어떻게 파괴할 수 있는가. (2024년 1월 16일)

[^106]: Zhang, Yingyu. 시스템 이론적 사고 모델 및 프로세스(STAMP): 문헌 검토. (2022)

[^107]: Center for Security and Emerging Technology. AI와 사이버 경쟁의 미래. (2021)

[^108]: Gafni, Ruti. 기술적 및 관리적 사이버 보안 작업 효율성 향상에서 인공지능(AI)의 역할. (2024-01-01)

[^109]: Abroshan, Hossein. AI로 AI를 보호하기: 라벨 플리핑 포이즈닝 공격 탐지를 위한 모듈식 파이프라인. Elsevier

[^110]: Abroshan, Hossein. 다단계 백도어 탐지(MSBD) 프레임워크. IEEE

[^111]: Center for Security and Emerging Technology. 강대국 간 AI 안전, 보안 및 안정성: 실용적 참여를 위한 옵션, 과제 및 교훈. (2019)

[^112]: Zou, Andy. 신경망을 이용한 미래 세계 사건 예측. (2022-10-09)

[^113]: Gathani, Sneha. 대화형 가정 분석을 통한 의사결정 증강. (2022-02-08)

[^114]: Lindelauf, Roy. 알고리즘 시대의 핵 억지력: 게임 이론의 재검토. T.M.C. Asser Press. (2021)

[^115]: Dafoe, Allan. 협력적 AI의 미해결 문제. (2020-12-15)

[^116]: Satariano, Adam. 세계 지도자들, AI가 '재앙적' 피해를 야기할 수 있다고 경고. (2023-11-01)

[^117]: Turchin, Alexey. AI 안전 문제에 대한 글로벌 해결책 대 로컬 해결책

[^118]: Crafts, Nicholas. 범용 기술로서의 인공지능: 역사적 관점. (2021-09-23)

[^119]: 葉俶禎. 인공지능 시대의 노동 대체: 체계적 문헌 검토. (2020-12-01)

[^120]: Johnson, James. 인공지능과 미래 전쟁: 국제 안보에 대한 함의. (2019-04-03)

[^121]: Kertysova, Katarina. 인공지능과 허위정보: AI가 허위정보의 생산, 유포 및 대응 방식을 어떻게 변화시키는가. (2018-12-12)

[^122]: 학회 인용 publisher = Carnegie Endowment for International Peace last = Feldstein first = Steven title = AI 감시의 글로벌 확산 date = 2019

[^123]: Agrawal, Ajay. 인공지능의 경제학: 의제. (2019)

[^124]: Whittlestone, Jess. 정부가 AI 발전을 모니터링해야 하는 이유와 방법. (2021-08-31)

[^125]: Askell, Amanda. 책임 있는 AI 개발에서 협력의 역할. (2019-07-10)

[^126]: Gursoy, Furkan. 공공 정책을 위한 AI 기반 의사결정 시스템 카드. (2022-08-31)

[^127]: Cobbe, Jennifer. 2021 ACM 공정성, 책임성 및 투명성 학회 논문집. Association for Computing Machinery. (2021-03-01)

[^128]: Raji, Inioluwa Deborah. 2020 ACM 공정성, 책임성 및 투명성 학회 논문집. Association for Computing Machinery. (2020-01-27)

[^129]: Manheim, David. AI 감사 표준 위원회의 필요성

[^130]: Novelli, Claudio. 인공지능의 책임성: 그것이 무엇이며 어떻게 작동하는가

[^131]: NeMo Guardrails

[^132]: Llama Guard: 인간-AI 대화를 위한 LLM 기반 입출력 안전장치

[^133]: Šekrst, Kristina. 설계에 의한 AI 윤리: 책임 있는 AI 개발을 위한 맞춤형 가드레일 구현

[^134]: Dong, Yi. 대규모 언어 모델을 위한 가드레일 구축

[^135]: D'Alessandro, W.. 의무론과 안전한 인공지능. (2024)

[^136]: D'Alessandro, William. 인공지능: 안전성 접근법

[^137]: Ziegler, Bart. AI를 규제할 때가 되었는가?. (2022년 4월 8일)

[^138]: Reed, Chris. 인공지능을 어떻게 규제해야 하는가?. (2018-09-13)

[^139]: 웹 인용 last = Belton first = Keith B. title = AI를 어떻게 규제해야 하는가? work = IndustryWeek access-date = 2022-11-24 date = 2019-03-07 url = https://www.industryweek.com/technology-and-iiot

[^140]: 인용 last = National Security Commission on Artificial Intelligence title = 최종 보고서 date = 2021

[^141]: 저널 인용 last = National Institute of Standards and Technology title = AI 위험 관리 프레임워크 journal = NIST access-date = 2022-11-24 date = 2021-07-12 url = https://www.nist.gov/itl/a

[^142]: 웹 인용 last = Richardson first = Tim title = 영국, 10개년 국가 인공지능 전략 발표 access-date = 2022-11-24 date = 2021 url = https://www.theregister.com/2021/09/

[^143]: Hardcastle, Kimberley. 지금 AI에 대해 많이 이야기하고 있다 – 그리고 때늦은 것은 아니다. (2023-08-23)

[^144]: 상징적인 블레츨리 파크, 11월 초 영국 AI 안전 정상회의 개최지로 선정

[^145]: Colville, Alex. 중국은 AI 안전을 어떻게 바라보는가. (2025-07-30)

[^146]: Office of the Director of National Intelligence, Intelligence Advanced Research Projects Activity. IARPA – TrojAI

[^147]: 웹 인용 last = Turek first = Matt title = 설명 가능한 인공지능 access-date = 2022-11-24 url = https://www.darpa.mil/program/explainable-artificial-intelligence archive-date = 202

[^148]: 웹 인용 last = Draper first = Bruce title = 기만에 대한 AI 견고성 보장 work = Defense Advanced Research Projects Agency access-date = 2022-11-24 url = https://www.darpa.mil/pr

[^149]: 웹 인용 last = National Science Foundation title = 안전한 학습 지원 시스템 date = 23 February 2023 access-date = 2023-02-27 url = https://beta.nsf.gov/funding/opportunities/safe-learn

[^150]: 유엔 총회, 인공지능에 관한 획기적 결의안 채택. (2024년 3월 21일)

[^151]: Say, Mark. DSIT, AI 안전 연구를 위한 자금 지원 발표. (2024년 5월 23일)

[^152]: Renshaw, Jarrett. 바이든과 시진핑, 핵무기는 AI가 아닌 인간이 통제해야 한다는 데 합의. (2024년 11월 16일)

[^153]: Khalid, Asma. 바이든과 시진핑, 마지막 회담에서 AI와 핵 결정을 제한하는 첫 걸음을 내딛다. (2024-11-16)

[^154]: 2025 회계연도 NDAA, 제1638조 ("전략적 억지력 지원을 위한 인공지능 사용에 관한 의회의 견해"). Center for Security and Emerging Technology at Georgetown University

[^155]: H.R.5009 - 2025 회계연도 군인 삶의 질 개선 및 국방수권법. United States Congress

[^156]: 펜타곤과 Anthropic의 대립을 격화시킨 가상의 핵 공격. The Washington Post

[^157]: , . 인공지능에 대한 국가 정책 프레임워크 보장. (2025-12-11)

[^158]: Johnson, Khari. 트럼프의 새로운 AI 규제 반대 행정명령, 캘리포니아에 특히 큰 타격. (2025-12-12)

[^159]: Lennett, Justin Hendrix, Ben. 트럼프 백악관의 인공지능 관련 조치 및 성명 연대기. (2026-01-25)

[^160]: 미국의 인공지능 리더십에 대한 장벽 제거. (2025-01-31)

[^161]: . 트럼프의 AI 행정명령은 허세에 불과하다 {{!. (2026-02-25)

[^162]: Mäntymäki, Matti. 조직적 AI 거버넌스의 정의. (2022)

[^163]: 웹 인용 title = 인공지능 사고 데이터베이스에 오신 것을 환영합니다 access-date = 2022-11-24 url = https://incidentdatabase.ai/ archive-date = 2022-11-24 archive-url = https://web.archive.o

[^164]: 웹 인용 last1 = Wiblin first1 = Robert last2 = Harris first2 = Keiran title = Nova DasSarma, 정보 보안이 AI 시스템의 안전한 개발에 왜 중요한가에 대해 work = 80,000 Hours

[^165]: 웹 인용 last = OpenAI title = 언어 모델 배포를 위한 모범 사례 work = OpenAI access-date = 2022-11-24 date = 2022-06-02 url = https://openai.com/blog/best-practices-for-deploying-la

[^166]: 웹 인용 last = OpenAI title = OpenAI 헌장 work = OpenAI access-date = 2022-11-24 url = https://openai.com/charter/ archive-date = 2021-03-04 archive-url = https://web.archive.org/web/202103

[^167]: Future of Life Institute. 자율 무기 공개 서한: AI 및 로봇공학 연구자들. (2016)

[^168]: Gold, Ashley. AI 영향력 네트워크의 핵심 인물들. (2026-02-27)

[^169]: Chow, Andrew R.. 국민 대 AI. (2026-02-19)

[^170]: Nolan, Beatrice. OpenAI, GPT-5.3-Codex 출시로 캘리포니아의 새 AI 법 위반했다는 감시단체 주장에 반박

[^171]: Wilkins, Emily. Anthropic, 2026년 선거를 앞두고 AI 규제를 추진하는 단체에 2천만 달러 기부. (2026-02-12)

[^172]: 미국의 AI 규칙을 만들기 위해 거액을 쏟아붓는 실리콘밸리 억만장자들. (2026년 2월 26일)

[^173]: Schleifer, Theodore. 실리콘밸리, 새로운 AI 지지 슈퍼 PAC에 2억 달러 약속. (2025-08-26)

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

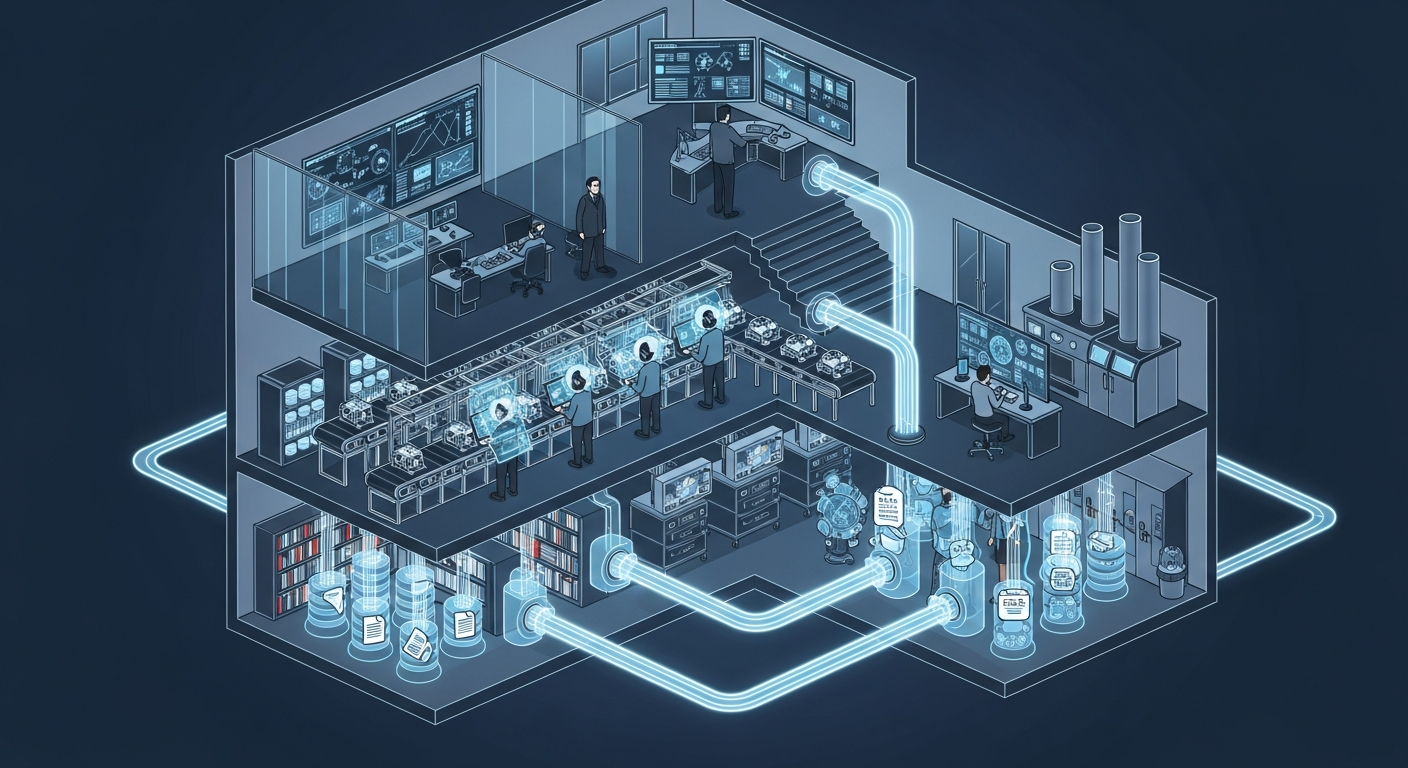

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.