Ethics of artificial intelligence

인공지능 윤리는 특별한 윤리적 쟁점이 있다고 여겨지는 인공지능 내 광범위한 주제를 다룬다.[^1] 여기에는 알고리즘 편향, 공정성, 책임성, 투명성, 프라이버시, 규제가 포함되며, 특히 시스템이 인간의 의사결정에 영향을 미치거나 이를 자동화하는 경우가 해당된다. 또한 기계 윤리(기계가 윤리적으로 행동하도록 만드는 방법), 치명적 자율 무기 체계, 군비 경쟁 역학, 인공지능 안전성 및 정렬, 기술적 실업, 인공지능을 활용한 허위정보,[^2] 특정 인공지능 시스템이 도덕적 지위를 가질 경우 이를 어떻게 대우할 것인지(인공지능 복지 및 권리), 초인공지능 및 실존적 위험 등 다양한 신흥 또는 잠재적 미래 과제도 포함한다.[^1]

의료, 교육, 형사 사법, 군사 등 일부 응용 분야는 특히 중요한 윤리적 함의를 가질 수 있다.

기계 윤리

기계 윤리(또는 기계 도덕성)는 도덕적으로 행동하거나 도덕적인 것처럼 행동하는 인공 도덕 행위자(AMA), 로봇 또는 인공지능 컴퓨터를 설계하는 것과 관련된 연구 분야이다.[^3][^4][^5][^6] 이러한 행위자의 본질을 설명하기 위해, 행위성, 합리적 행위성, 도덕적 행위성, 인공 행위성의 표준적 특성화와 같은 특정 철학적 개념들을 고려하는 것이 제안되었으며, 이는 AMA의 개념과 관련이 있다.[^40]

AI가 윤리적 결정을 내릴 수 있는지 확인하기 위한 테스트를 만드는 것에 대한 논의가 있다. Alan Winfield는 튜링 테스트에 결함이 있으며 AI가 테스트를 통과하기 위한 요구 사항이 너무 낮다고 결론짓는다.[^7] 제안된 대안 테스트는 윤리적 튜링 테스트라고 불리는 것으로, 여러 명의 심사위원이 AI의 결정이 윤리적인지 비윤리적인지를 판단하게 함으로써 현재의 테스트를 개선하는 것이다.[^7] 신경형태학적 AI는 도덕적 능력을 갖춘 로봇을 만드는 한 가지 방법이 될 수 있는데, 이는 인간과 유사하게 비선형적으로 그리고 수백만 개의 상호 연결된 인공 뉴런을 통해 정보를 처리하는 것을 목표로 하기 때문이다.[^41] 마찬가지로, 전뇌 에뮬레이션(뇌를 스캔하여 디지털 하드웨어에서 시뮬레이션하는 것)도 원칙적으로 인간과 유사한 로봇을 만들어 도덕적 행위가 가능하게 할 수 있다.[^42] 그리고 대규모 언어 모델은 인간의 도덕적 판단을 근사할 수 있다.[^43] 필연적으로 이는 그러한 로봇이 세상에 대해 학습할 환경과 누구의 도덕성을 물려받을 것인지, 또는 이기심, 생존 우선 태도, 비일관성, 규모 둔감성 등 인간의 '약점'까지 발달시키게 될 것인지에 대한 의문을 제기한다.

Moral Machines: Teaching Robots Right from Wrong[^8]에서 Wendell Wallach와 Colin Allen은 로봇에게 옳고 그름을 가르치려는 시도가 인간으로 하여금 현대 규범 이론의 공백을 해결하도록 동기를 부여하고 실험적 탐구를 위한 플랫폼을 제공함으로써 인간 윤리에 대한 이해를 진전시킬 가능성이 높다고 결론짓는다. 한 가지 예로, 이는 규범 윤리학자들에게 기계에서 어떤 특정 학습 알고리즘을 사용할 것인지에 대한 논쟁적 문제를 소개하였다. 단순한 결정의 경우, Nick Bostrom과 Eliezer Yudkowsky는 결정 트리(ID3 등)가 신경망 및 유전 알고리즘보다 더 투명하다고 주장한 반면,[^44] Chris Santos-Lang은 어떤 시대의 규범이든 변화가 허용되어야 하며, 이러한 특정 규범을 완전히 충족하지 못하는 자연적 실패가 인간을 범죄적 "해커"에 덜 취약하게 만드는 데 필수적이었다는 근거로 기계 학습을 지지하였다.[^9]

일부 연구자들은 기계 윤리를 더 넓은 AI 통제 또는 가치 정렬 문제의 일부로 규정한다: 이는 점점 더 강력해지는 시스템이 인간의 가치 및 감독과 양립 가능한 목표를 추구하도록 보장하는 것의 어려움이다. Stuart Russell은 유익한 시스템이 (1) 인간의 선호를 실현하는 것을 목표로 하고, (2) 그 선호가 무엇인지에 대해 불확실성을 유지하며, (3) 고정되고 완전히 명시된 목표를 최적화하는 대신 인간의 행동과 피드백으로부터 이를 학습하도록 설계되어야 한다고 주장하였다.[^45] 일부 저자들은 인간의 가치에 대한 겉보기 순응이 안정적인 내적 규범이 아닌 평가 맥락에 대한 최적화를 반영할 수 있으며, 이는 고급 언어 모델에서의 정렬 평가를 복잡하게 만든다고 주장한다.[^46]

과제

알고리즘 편향

![[Kamala Harris 2020년 인공지능의 인종 편향에 대해 발언하는 모습]]AI는 얼굴 인식 및 음성 인식 시스템에 점점 더 깊이 내재되고 있다. 이러한 시스템은 인간 개발자가 도입한 편향과 오류에 취약할 수 있다. 특히, 이를 훈련하는 데 사용되는 데이터에 편향이 존재할 수 있다.[^47][^48][^10][^49]

LSE 부교수이자 데이터와 사회 프로그램 책임자인 앨리슨 파월에 따르면, 데이터 수집은 결코 중립적이지 않으며 항상 서사를 수반한다. 그녀는 기술을 통한 거버넌스가 본질적으로 더 낫고, 빠르고, 저렴하다는 것이 지배적인 서사이지만, 대신 데이터를 비용이 드는 것으로 만들어 최소한으로 그리고 가치 있게 사용하며, 그 생성 비용을 고려해야 한다고 주장한다.[^50] 프리드먼과 니센바움은 컴퓨터 시스템의 편향을 기존 편향, 기술적 편향, 발현적 편향의 세 가지 범주로 구분한다.[^51] 자연어 처리에서는 알고리즘이 서로 다른 단어 간의 관계를 학습하는 데 사용하는 원천 자료인 텍스트 코퍼스에서 문제가 발생할 수 있다.[^52]

IBM, Google 등 연구 개발에 상당한 자금을 지원하는 대기업들은[^53] 이러한 편향을 연구하고 해결하기 위한 노력을 기울여 왔다.[^54][^55][^56] 한 가지 잠재적 해결책은 AI 시스템 훈련에 사용되는 데이터에 대한 문서를 작성하는 것이다.[^57][^58] 프로세스 마이닝은 오류 식별, 프로세스 모니터링, 부적절한 실행의 잠재적 근본 원인 파악 및 기타 기능을 통해 제안된 AI 규제 준수를 달성하는 데 조직에게 중요한 도구가 될 수 있다.[^59] 그러나 철학적 수준과 법적 수준 모두에서 차별 개념의 본질적 모호성으로 인해 AI 공정성의 현 상황에는 한계도 존재한다.[^60]

인종 및 성별 편향

편향은 AI 시스템을 훈련하는 데 사용되는 과거 데이터를 통해 도입될 수 있다.[^11][^61] 예를 들어, 아마존은 알고리즘이 여성 지원자보다 남성 지원자를 선호했기 때문에 AI 채용 및 모집 시스템의 사용을 중단했다.[^62] 이는 아마존의 시스템이 대부분 남성 지원자를 포함한 10년간의 데이터로 훈련되었기 때문이다. 알고리즘은 과거 데이터에서 편향된 패턴을 학습했고, 이런 유형의 지원자가 채용될 가능성이 가장 높다는 예측을 생성했다. 따라서 AI 시스템의 채용 결정은 여성과 소수자 지원자에 대해 편향된 것으로 판명되었다.[^63]

얼굴 인식 및 컴퓨터 비전 모델의 성능은 인종과 성별에 따라 달라질 수 있다. Microsoft, IBM, Face++가 만든 얼굴 인식 알고리즘은 모두 피부색이 어두운 여성에 대해 현저히 낮은 성능을 보였다.[^64][^12] 얼굴 인식은 피부색이 어두운 사람들에 대해 편향된 것으로 나타났다. AI 시스템은 흑인에 대해 정확도가 떨어질 수 있으며, AI 기반 맥박 산소 측정기가 피부색이 어두운 환자의 혈중 산소 수치를 과대 추정하여 저산소증 치료에 문제를 일으킨 사례가 그 예이다. 2015년에는 한 흑인 부부가 Google 포토에 의해 "고릴라"로 분류되면서 논란이 일었다.[^65][^66] 이러한 시스템은 백인의 얼굴은 쉽게 감지하면서도 흑인의 얼굴은 인식하지 못하는 경우가 많다. 이로 인해 일부 미국 주에서는 경찰의 AI 자료 또는 소프트웨어 사용이 금지되었다. 이러한 편향의 원인은 AI가 인터넷 전반에서 정보를 가져와 각 상황에서의 응답에 반영하기 때문이다. 예를 들어, 얼굴 인식 시스템이 백인만을 대상으로 테스트되었다면, 다른 인종과 민족의 얼굴 구조와 피부 톤을 해석하기가 훨씬 어려울 것이다. 편향은 알고리즘 자체보다는 훈련 데이터에서 비롯되는 경우가 많으며, 특히 데이터가 과거 인간의 결정을 반영할 때 그러하다.[^67]

2020년에 Amazon, Apple, Google, IBM, Microsoft의 음성 인식 시스템을 조사한 연구에 따르면, 이들 시스템은 백인의 음성보다 흑인의 음성을 전사할 때 더 높은 오류율을 보였다.[^68]

AI 사용의 불공정은 의료 시스템 내에서 제거하기가 훨씬 어려운데, 질병과 상태가 인종과 성별에 따라 다르게 영향을 미칠 수 있기 때문이다. 이는 AI가 특정 환자가 성별이나 인종으로 인해 문제가 발생할 가능성이 더 높다는 통계에 기반하여 결정을 내릴 수 있어 혼란을 야기할 수 있다.[^69] 각 환자는 다른 사례이고, AI는 해당 개인을 프로그래밍된 그룹에 따라 분류하여 결정을 내리기 때문에 이것이 편향으로 인식될 수 있다. 이는 치료 배분에서 무엇이 편향된 결정으로 간주되어야 하는지에 대한 논의로 이어진다. 질병과 부상이 성별과 인종에 따라 다르게 영향을 미친다는 것은 알려져 있지만, 이를 의료 치료에 반영하는 것이 더 공정한지, 아니면 이러한 지식 없이 각 환자를 진찰하는 것이 더 공정한지에 대한 논의가 있다. 현대 사회에서는 유방암과 같은 질병에 대해 특정 집단에게 다른 집단보다 더 권장되는 검사가 있는데, 이는 해당 질병에 걸릴 가능성이 더 높기 때문이다. AI가 이러한 통계를 구현하여 각 환자에게 적용한다면, 이는 편향된 것으로 간주될 수 있다.[^70]

사법 시스템에서 AI는 흑인에 대한 편향을 가질 수 있으며, 흑인 법정 참여자를 백인 참여자보다 훨씬 더 높은 비율로 고위험으로 분류한다. AI는 인종 비하 표현과 그것이 검열되어야 하는 시점을 판단하는 데 종종 어려움을 겪는다. 특정 단어가 비하 표현으로 사용되는 경우와 문화적으로 사용되는 경우를 구별하는 데 어려움을 겪는다.[^13] COMPAS 프로그램은 어떤 피고인이 재범할 가능성이 더 높은지 예측하는 데 사용되어 왔다. COMPAS는 인종 집단 간 동일한 오류율을 가지도록 정확도가 보정되어 있지만, 흑인 피고인은 백인 피고인보다 "고위험"으로 잘못 분류될 가능성이 거의 두 배였고, "저위험"으로 잘못 분류될 가능성은 절반이었다.[^71] 또 다른 예는 Google 광고가 남성에게는 고임금 직업을, 여성에게는 저임금 직업을 타겟팅한 사례이다. AI 편향은 실제로 편향과 관련된 단어에 직접 연결되지 않는 경우가 많아 알고리즘 내에서 감지하기 어려울 수 있다. 이의 한 예는 개인의 거주 지역이 특정 그룹과 연결되는 데 사용되는 것이다. 이는 종종 기업이 이 허점을 통해 법적 조치를 피할 수 있기 때문에 문제로 이어질 수 있다. 이는 이러한 정책을 시행하는 정부가 차별적이라고 간주하는 표현에 관한 구체적인 법률 때문이다.[^72]

대형 언어 모델은 전통적인 성별 규범에 기반하여 역할과 특성을 부여하며 성별 고정관념을 강화하는 경우가 많다. 예를 들어, 간호사나 비서를 주로 여성과, 엔지니어나 CEO를 남성과 연관시켜 성별화된 기대와 역할을 영속시킬 수 있다.[^73][^74] 또한 얼굴 인식, 컴퓨터 비전 또는 자동 성별 인식 모델은 개인의 정체성과 불일치하는 성별 오분류를 통해 시스젠더[^75][^76] 및 트랜스젠더[^77][^78] 모두에 대한 편향을 강화할 수 있다.

고정관념화

성별과 인종을 넘어, 이러한 모델은 연령, 국적, 종교 또는 직업에 기반한 것을 포함하여 광범위한 고정관념을 강화할 수 있다. 이는 사람들의 집단을 부당하게 일반화하거나 희화화하는 결과물을 생성할 수 있으며, 때로는 해롭거나 경멸적인 방식으로 나타난다.[^79][^11]

언어 편향

현재의 대형 언어 모델은 주로 영어 데이터로 훈련되기 때문에, 서구의 관점을 진실로 제시하면서 비영어권의 관점을 체계적으로 경시하는 경우가 많다.[^80]

정치적 편향

언어 모델은 정치적 편향을 보일 수도 있다. 훈련 데이터에 다양한 정치적 의견과 보도가 포함되어 있으므로, 모델은 데이터에서 해당 관점의 빈도에 따라 특정 정치적 이념이나 관점에 치우친 응답을 생성할 수 있다.[^81][^82][^83]

거대 기술 기업의 지배

상업적 AI 분야는 Alphabet Inc., Amazon, Apple Inc., Meta Platforms, Microsoft와 같은 빅테크 기업들이 지배하고 있다.[^84][^85][^86] 이들 기업 중 일부는 이미 데이터 센터의 기존 클라우드 인프라와 컴퓨팅 파워의 대부분을 소유하고 있어, 시장에서의 입지를 더욱 공고히 할 수 있다.[^87][^88]

기후 영향

가장 큰 생성형 AI 모델은 훈련과 사용에 상당한 컴퓨팅 자원을 필요로 한다. 이러한 컴퓨팅 자원은 종종 대규모 데이터 센터에 집중되어 있다. 그로 인한 환경 영향에는 온실가스 배출, 물 소비, 전자 폐기물이 포함된다.[^15] 에너지 효율이 개선되었음에도 불구하고, AI가 더 광범위하게 사용됨에 따라 에너지 수요는 증가할 것으로 예상된다.[^14]

전력 소비와 탄소 발자국

이러한 자원은 종종 대규모 데이터 센터에 집중되어 있으며, 막대한 양의 에너지를 필요로 하여 온실가스 배출 증가로 이어진다.[^15] 2023년 연구에 따르면, 대형 AI 모델을 훈련하는 데 필요한 에너지양은 626,000파운드의 이산화탄소 또는 뉴욕과 샌프란시스코 간 왕복 비행 300회에 해당한다.[^16]

물 소비

탄소 배출 외에도, 이러한 데이터 센터는 AI 칩 냉각을 위해 물이 필요하다. 지역적으로 이는 물 부족과 생태계 파괴로 이어질 수 있다. 데이터 센터에서 사용되는 에너지 킬로와트시당 약 2리터의 물이 필요하다.[^16]

전자 폐기물

또 다른 문제는 발생하는 전자 폐기물(e-폐기물)이다. 여기에는 납과 수은 같은 유해 물질과 화학 물질이 포함될 수 있어 토양과 수질 오염을 초래한다. AI 관련 전자 폐기물의 환경적 영향을 방지하기 위해 더 나은 폐기 관행과 더 엄격한 법률이 시행될 수 있다.[^16]

전망

AI의 인기 상승은 데이터 센터에 대한 수요를 증가시키고 이러한 문제를 심화시킨다.[^14] AI 기업들의 환경 영향에 대한 투명성도 부족하다. 일부 응용 프로그램은 간접적으로 환경에 영향을 미칠 수도 있다. 예를 들어, AI 광고는 이미 상당한 배출량을 생산하는 산업인 패스트 패션의 소비를 증가시킬 수 있다.[^17]

그러나 AI는 환경 피해를 완화하는 데 도움을 줌으로써 긍정적인 방식으로도 사용될 수 있다. 다양한 AI 기술이 배출량을 모니터링하고 기업이 배출량을 줄이는 데 도움이 되는 알고리즘을 개발하는 데 기여할 수 있다.[^17]

오픈 소스

빌 히바드는 AI가 인류에 매우 심대한 영향을 미칠 것이므로, AI 개발자들은 미래 인류의 대리인이며 따라서 그들의 노력에 투명해야 할 윤리적 의무가 있다고 주장한다.^18 Hugging Face[^89]와 EleutherAI[^90] 같은 조직들은 적극적으로 AI 소프트웨어를 오픈 소스화해 왔다. Gemma, Llama2, Mistral 등 다양한 오픈 가중치 대형 언어 모델도 출시되었다.[^91]

그러나 코드를 오픈 소스로 만든다고 해서 이해하기 쉬워지는 것은 아니며, 이는 많은 정의에 따르면 AI 코드가 투명하지 않다는 것을 의미한다. IEEE 표준 협회는 자율 시스템의 투명성에 관한 기술 표준인 IEEE 7001-2021을 발표했다.[^19] IEEE의 노력은 다양한 이해관계자를 위한 여러 수준의 투명성을 식별한다.

AI 모델의 공개가 오용으로 이어질 수 있다는 우려도 있다.[^92] 예를 들어, Microsoft는 비용을 지불할 수 있는 사람들에게조차 얼굴 인식 소프트웨어에 대한 보편적 접근을 허용하는 것에 대해 우려를 표명했다. Microsoft는 이 주제에 대한 블로그를 게시하여 올바른 결정을 내리는 데 도움이 되는 정부 규제를 요청했다.[^20] 또한 오픈 가중치 AI 모델은 어떠한 필터링 없이 위험한 요청에 응하도록 모든 대응책을 제거하기 위해 미세 조정될 수 있다. 이는 미래 AI 모델이 생물학 무기를 만들거나 사이버 공격을 자동화하는 능력을 갖게 될 경우 특히 우려스러울 수 있다.[^93] 처음에 범용 인공지능(AGI) 개발에 오픈 소스 접근 방식을 약속했던 OpenAI는 결국 경쟁력과 안전상의 이유를 들어 비공개 소스 접근 방식으로 전환했다. OpenAI의 전 수석 AGI 과학자 일리야 수츠케버는 2023년에 "우리가 틀렸다"고 말하며, 가장 강력한 AI 모델을 오픈 소스화하지 않아야 할 안전상의 이유가 몇 년 내에 "명백해질" 것으로 예상한다고 했다.[^94]

공개 지식 플랫폼에 대한 부담

2023년 4월, Wired는 5,000만 개 이상의 질문과 답변이 있는 인기 프로그래밍 도움 포럼인 Stack Overflow가 대형 AI 개발사에게 콘텐츠 접근 비용을 청구할 계획이라고 보도했다. 이 회사는 대형 언어 모델을 구동하는 커뮤니티 플랫폼은 공개 지식을 유지하는 데 재투자할 수 있도록 "당연히 보상받아야 한다"고 주장했다. Stack Overflow는 자사 데이터가 스크래핑, API, 데이터 덤프를 통해 접근되고 있으며, 종종 적절한 출처 표시 없이 이용 약관과 사용자 기여에 적용되는 크리에이티브 커먼즈 라이선스를 위반하고 있다고 밝혔다. Stack Overflow의 CEO는 또한 Stack Overflow와 같은 플랫폼에서 훈련된 대형 언어 모델이 "사람들이 정보와 대화를 위해 찾는 모든 서비스에 대한 위협"이라고 말했다.[^95]

공격적인 AI 크롤러들은 오픈 소스 인프라에 점점 더 과도한 부하를 걸고 있으며, 2025년 3월 Ars Technica 기사에 따르면 "중요한 공공 자원에 대한 지속적인 분산 서비스 거부(DDoS) 공격에 해당하는 것을 유발하고 있다". GNOME, KDE, Read the Docs와 같은 프로젝트들은 서비스 중단이나 비용 증가를 경험했으며, 한 보고서에 따르면 일부 프로젝트 트래픽의 최대 97%가 AI 봇에서 발생했다. 이에 대응하여 관리자들은 작업 증명 시스템과 국가 차단 같은 조치를 시행했다. 기사에 따르면, 이러한 무분별한 스크래핑은 "AI 모델이 의존하는 바로 그 디지털 생태계를 심각하게 훼손할 위험이 있다".[^96]

2025년 4월, 위키미디어 재단은 AI 봇의 자동화된 스크래핑이 인프라에 부담을 주고 있다고 보고했다. 2024년 초 이후, AI 모델의 훈련 데이터를 수집하는 봇들의 대규모 멀티미디어 콘텐츠 다운로드로 인해 대역폭 사용량이 50% 증가했다. 이러한 봇들은 종종 잘 알려지지 않고 캐싱 빈도가 낮은 페이지에 접근하여 캐싱 시스템을 우회하고 핵심 데이터 센터에 높은 비용을 부과했다. 위키미디어에 따르면, 봇은 전체 페이지 조회수의 35%를 차지했지만 가장 비용이 많이 드는 요청의 65%를 차지했다. 재단은 "우리의 콘텐츠는 무료이지만, 인프라는 그렇지 않다"고 밝히며 "이는 커뮤니티 운영 플랫폼의 지속 가능성을 위협하는 기술적 불균형을 만든다"고 경고했다.[^97]

투명성

신경망을 활용한 기계 학습과 같은 접근 방식은 컴퓨터가 자신이나 개발자도 설명할 수 없는 결정을 내리는 결과를 초래할 수 있다. 사람들이 이러한 결정이 공정하고 신뢰할 수 있는지 판단하기 어려워, AI 시스템의 편향이 감지되지 않거나 사람들이 이러한 시스템의 사용을 거부할 가능성이 있다. 시스템 투명성의 부재는 사용자 신뢰의 부재로 이어지는 것으로 나타났다.[^98] 이에 따라 AI 시스템 개발자들이 시스템에 투명성을 통합하도록 강제하기 위한 많은 표준과 정책이 제안되었다.[^99] 이러한 투명성 요구는 설명 가능한 인공지능에 대한 옹호와 일부 관할권에서의 법적 요구 사항으로 이어졌다.^100 설명 가능한 인공지능은 설명 가능성과 해석 가능성을 모두 포함하며, 설명 가능성은 모델의 출력에 대한 이유를 제공하는 것과 관련되고, 해석 가능성은 AI 모델의 내부 작동을 이해하는 데 초점을 맞춘다.[^101]

의료 분야에서 복잡한 AI 방법이나 기술의 사용은 종종 작동 방식을 이해하기 어렵다는 이유로 "블랙박스"로 묘사되는 모델을 만들어 낸다. 이러한 모델이 내린 결정은 입력 데이터가 출력으로 어떻게 변환되는지 분석하기 어려워 해석하기 힘들 수 있다. 이러한 투명성의 부재는 의료와 같이 결정 이면의 근거를 이해하는 것이 신뢰, 윤리적 고려, 규제 표준 준수에 중요할 수 있는 분야에서 상당한 우려 사항이다.[^102] 의료 AI에 대한 신뢰는 제공되는 투명성의 수준에 따라 달라지는 것으로 나타났다.[^103] 더욱이 AI 시스템의 설명 불가능한 출력은 의료 오류를 식별하고 감지하는 것을 훨씬 더 어렵게 만든다.[^104]

책임성

AI 불투명성의 특수한 사례는 AI가 의인화되는 것, 즉 인간과 유사한 특성을 가진 것으로 가정되어 도덕적 행위 주체에 대한 잘못된 인식을 초래하는 경우이다. 이로 인해 사람들은 AI 시스템을 통해 생산된 비윤리적 결과에 인간의 과실이나 의도적인 범죄 행위가 기여했는지 여부를 간과할 수 있다. EU의 AI법과 같은 일부 최근 디지털 거버넌스 규정은 AI 시스템이 일반적인 제조물 책임법에서 기대되는 것과 최소한 동일한 수준의 주의를 기울여 취급되도록 보장함으로써 이를 바로잡는 것을 목표로 한다. 여기에는 잠재적으로 AI 감사도 포함된다.

규제

옥스퍼드 대학교 AI 거버넌스 센터의 2019년 보고서에 따르면, 미국인의 82%가 로봇과 AI는 신중하게 관리되어야 한다고 믿고 있다. 언급된 우려 사항은 감시에서의 AI 사용과 온라인 가짜 콘텐츠 확산(AI의 도움으로 생성된 조작된 비디오 이미지와 오디오를 포함할 때 딥페이크라고 함)부터 사이버 공격, 데이터 프라이버시 침해, 채용 편향, 자율 주행 차량, 인간 조종사가 필요 없는 드론에 이르기까지 다양했다.[^105] 마찬가지로, 2021년 KPMG와 호주 퀸즐랜드 대학교의 5개국 연구에 따르면, 각 국가 시민의 66~79%가 AI가 사회에 미치는 영향이 불확실하고 예측 불가능하다고 믿고 있으며, 조사 대상의 96%가 AI 거버넌스 과제가 신중하게 관리되기를 기대한다.[^106]

기업뿐만 아니라 많은 연구자와 시민 옹호자들도 투명성을 보장하고 이를 통한 인간의 책임성을 확보하는 수단으로 정부 규제를 권장한다. 이 전략은 혁신 속도를 늦출 것이라고 우려하는 사람들이 있어 논란이 되어 왔다. 다른 사람들은 규제가 장기적으로 혁신을 더 잘 지원할 수 있는 체계적 안정성으로 이어진다고 주장한다.[^21] OECD, UN, EU 및 많은 국가들이 현재 AI 규제 전략을 수립하고 적절한 법적 틀을 모색하고 있다.[^107][^108][^109][^2]

2019년 6월 26일, 유럽위원회 인공지능 고위 전문가 그룹(AI HLEG)은 "신뢰할 수 있는 인공지능을 위한 정책 및 투자 권고안"을 발표했다.[^110] 이는 2019년 4월 "신뢰할 수 있는 AI를 위한 윤리 가이드라인" 발표에 이은 AI HLEG의 두 번째 결과물이다. 6월의 AI HLEG 권고안은 인간과 사회 전반, 연구 및 학계, 민간 부문, 공공 부문의 네 가지 주요 주제를 다룬다.[^111] 유럽위원회는 "HLEG의 권고안은 AI 기술이 경제 성장, 번영, 혁신을 촉진할 기회와 관련 잠재적 위험 모두에 대한 인식을 반영한다"고 주장하며, EU가 국제적으로 AI를 규율하는 정책 수립을 선도하는 것을 목표로 한다고 밝혔다.[^112] 피해를 방지하기 위해, 규제 외에도 AI를 배포하는 조직들은 신뢰할 수 있는 AI의 원칙에 따라 신뢰할 수 있는 AI를 만들고 배포하는 데 중심적인 역할을 수행하고 위험을 완화할 책임을 져야 한다.[^113]

2024년 6월, EU는 인공지능법(AI법)을 채택했다.[^22] 2024년 8월 1일, AI법이 발효되었다.[^23] 규칙은 점진적으로 적용되며, 발효 후 24개월이 지나면 완전히 적용된다.[^22] AI법은 AI 시스템의 제공자와 사용자에 대한 규칙을 설정한다.[^22] 위험 수준에 따라 AI 시스템이 금지되거나, 해당 AI 시스템을 시장에 출시하고 사용하기 위해 특정 요구 사항을 충족해야 하는 위험 기반 접근 방식을 따른다.[^23]

사용 증가

AI는 모든 숙제 질문에 대한 답을 갖고 있는 듯한 챗봇부터 원하는 무엇이든 그림을 만들 수 있는 생성형 AI까지, 전 세계에서 점차 그 존재감을 높이고 있다.[^11] AI는 구직자가 찾는 것에 따라 타겟팅하는 광고부터 잠재적 채용 후보자의 지원서 검토에 이르기까지, 채용 시장에서 점점 더 인기를 얻고 있다. COVID-19와 같은 사건은 더 많은 사람들이 전자적으로 지원해야 했기 때문에 지원 과정에서 AI 프로그램의 도입을 가속화했으며, 이러한 온라인 지원자의 증가와 함께 AI의 사용은 잠재적 직원을 선별하는 과정을 더 쉽고 효율적으로 만들었다. AI는 기업들이 시대와 끊임없이 확장하는 인터넷에 발맞추어야 함에 따라 더욱 두드러지게 되었다. 분석 데이터를 처리하고 결정을 내리는 것은 AI의 도움으로 훨씬 쉬워진다.[^13] 텐서 처리 장치(TPU)와 그래픽 처리 장치(GPU)가 더 강력해짐에 따라 AI 능력도 향상되어, 기업들은 경쟁을 따라잡기 위해 이를 사용하지 않을 수 없게 된다. 고객의 요구를 관리하고 작업장의 많은 부분을 자동화하면 기업은 직원에게 지출하는 비용을 줄일 수 있다.

AI는 형사 사법과 의료 분야에서도 사용이 증가하고 있다. 의료 목적으로 AI는 미래 환자의 상태와 가능한 치료법에 대한 예측을 위해 환자 데이터를 분석하는 데 더 자주 사용되고 있다. 이러한 프로그램은 임상 의사 결정 지원 시스템(DSS)이라고 한다. 의료 분야에서 AI의 미래는 단순한 치료 권고를 넘어 특정 환자를 다른 환자보다 우선 의뢰하는 것으로 발전할 수 있으며, 이는 불평등의 가능성으로 이어진다.[^114]

AI 복지

2020년에 시몬 에델만 교수는 빠르게 성장하는 AI 윤리 분야에서 AI가 고통을 경험할 가능성을 다룬 연구가 극히 일부에 불과하다고 지적했다. 이는 전역 작업 공간 이론이나 통합 정보 이론과 같이 AI 시스템이 의식을 갖게 될 수 있는 가능한 방법을 설명하는 신뢰할 수 있는 이론이 있었음에도 불구하고 그러했다. 에델만은 한 가지 예외로 2018년에 의식 있는 AI를 만들 위험이 있는 추가 작업에 대한 전 세계적 모라토리엄을 요구한 토마스 메칭거를 언급한다. 이 모라토리엄은 2050년까지 시행되며, 위험에 대한 이해와 완화 방법의 진전에 따라 연장되거나 조기에 해제될 수 있었다. 메칭거는 2021년에 이 주장을 반복하며, AI가 인간이 이해할 수 없는 강렬한 방식으로 고통을 겪을 수 있고, 복제 과정을 통해 방대한 양의 의식 있는 인스턴스가 생성될 수 있다는 점에서 "인공적 고통의 폭발"을 만들 위험을 강조했다.[^24][^25] 팟캐스트 진행자 드워케시 파텔은 "디지털 버전의 공장식 축산"이 일어나지 않도록 하는 것에 관심이 있다고 말했다.[^26] 불확실한 감각 능력의 윤리에서는 사전 예방 원칙이 자주 원용된다.[^115]

여러 연구소가 의식 있는 AI를 만들기 위해 노력하고 있다고 공개적으로 밝혔다. 자기 인식을 의도하지 않은 AI에 가까이 접근할 수 있는 사람들로부터 의식이 이미 의도치 않게 출현했을 수 있다는 보고가 있었다.[^116] 여기에는 2022년 2월 OpenAI 설립자 일리야 수츠케버가 오늘날의 대규모 신경망이 "약간 의식이 있을 수 있다"고 쓴 것이 포함된다. 2022년 11월, 데이비드 찰머스는 GPT-3와 같은 현재의 대형 언어 모델이 의식을 경험했을 가능성은 낮지만, 대형 언어 모델이 미래에 의식을 갖게 될 심각한 가능성이 있다고 여긴다고 주장했다.[^25][^24][^117] Anthropic은 2024년에 첫 AI 복지 연구원을 고용했으며,[^118] 2025년에는 모델이 도덕적 고려를 받을 자격이 있는지 평가하는 방법, 잠재적인 "고통의 징후", "저비용" 개입과 같은 주제를 탐구하는 "모델 복지" 연구 프로그램을 시작했다.[^119]

칼 슐만과 닉 보스트롬에 따르면, "자원으로부터 초인적으로 효율적으로 행복을 도출할 수 있는" "초수혜자"라 불리는 기계를 만드는 것이 가능할 수 있다. 그 이유 중 하나는 디지털 하드웨어가 생물학적 뇌보다 훨씬 빠른 정보 처리를 가능하게 하여, 주관적 경험의 속도를 높일 수 있기 때문이다. 이러한 기계는 또한 쾌락적 적응에 영향을 받지 않으면서 강렬하고 긍정적인 주관적 경험을 느끼도록 설계될 수 있다. 슐만과 보스트롬은 디지털 마음의 도덕적 주장을 적절히 고려하지 않는 것이 도덕적 재앙으로 이어질 수 있으며, 반면에 인간의 이익보다 무비판적으로 이를 우선시하는 것은 인류에게 해가 될 수 있다고 경고한다.[^120][^121]

인간 존엄성에 대한 위협

조지프 와이젠바움은 1976년에 AI 기술이 존중과 배려가 필요한 직위에서 사람을 대체하는 데 사용되어서는 안 된다고 주장했으며, 다음과 같은 예를 들었다:

- 고객 서비스 담당자 (AI 기술은 이미 오늘날 전화 기반 대화형 음성 응답 시스템에 사용되고 있다)

- 노인 돌봄 간병인 (파멜라 매코덕이 그녀의 저서 제5세대에서 보고한 바와 같이)

- 군인

- 판사

- 경찰관

- 치료사 (케네스 콜비가 1970년대에 제안한 바와 같이)

와이젠바움은 이러한 직위에 있는 사람들에게 진정한 공감의 감정이 필요하다고 설명한다. 기계가 그들을 대체한다면, 인공지능 시스템이 공감을 시뮬레이션할 수 없기 때문에 우리는 소외감, 가치 절하, 좌절감을 느끼게 될 것이다. 이런 식으로 사용되는 인공지능은 인간 존엄성에 대한 위협을 나타낸다. 와이젠바움은 이러한 직위에 기계를 두는 가능성을 고려하고 있다는 사실 자체가 "우리 자신을 컴퓨터로 생각하는 데서 오는 인간 정신의 위축"을 경험했음을 시사한다고 주장한다.[^27]

파멜라 매코덕은 여성과 소수자를 대변하여 "나는 차라리 공정한 컴퓨터에 맡기겠다"고 반박하며, 개인적인 의도가 전혀 없는 자동화된 판사와 경찰을 선호하게 되는 상황이 있다고 지적한다.[^28]

와이젠바움은 또한 AI 연구자들(그리고 일부 철학자들)이 인간의 마음을 컴퓨터 프로그램에 불과한 것으로 보려는 태도(현재 계산주의로 알려진 입장)에 대해서도 우려했다. 와이젠바움에게 이러한 점들은 AI 연구가 인간의 삶을 평가절하한다는 것을 시사한다.

AI 창시자 존 매카시는 와이젠바움의 비판의 도덕주의적 어조에 반대한다. "도덕주의가 격렬하면서도 모호할 때, 그것은 권위주의적 남용을 초래한다"고 그는 쓴다. 빌 히바드는 "인간 존엄성은 존재의 본질에 대한 무지를 제거하기 위해 노력할 것을 요구하며, AI는 그 노력에 필수적이다"라고 쓴다.

자율 주행 자동차의 책임

자율 주행 자동차의 광범위한 사용이 점점 임박해짐에 따라, 완전 자율 주행 차량이 제기하는 새로운 과제들을 해결해야 한다.[^122][^123] 이러한 자동차가 사고에 연루될 경우 책임 당사자의 법적 책임에 대한 논쟁이 있어 왔다.[^124][^125] 무인 자동차가 보행자를 친 한 보고서에서, 운전자는 차 안에 있었지만 제어는 완전히 컴퓨터가 담당하고 있었다. 이로 인해 사고의 책임이 누구에게 있는지에 대한 딜레마가 발생했다.[^126]

2018년 3월 18일의 또 다른 사고에서, 일레인 허츠버그는 애리조나에서 자율 주행 Uber에 의해 치여 사망했다. 이 경우, 자동화된 자동차는 차량과 특정 장애물을 감지하여 자율적으로 도로를 주행할 수 있었지만, 도로 한가운데에 있는 보행자는 예측할 수 없었다. 이는 운전자, 보행자, 자동차 회사, 또는 정부 중 누가 그녀의 죽음에 대해 책임을 져야 하는지에 대한 의문을 제기했다.[^127]

현재 자율 주행 자동차는 반자율적인 것으로 간주되며, 운전자가 주의를 기울이고 필요한 경우 제어를 인수할 준비가 되어 있어야 한다.[^128] 따라서 자율 기능에 과도하게 의존하는 운전자를 규제하고, 이것이 편리하지만 완전한 대체물은 아닌 기술일 뿐임을 알리는 것은 정부의 몫이다. 자율 주행 자동차가 광범위하게 사용되기 전에, 이러한 문제들은 새로운 정책을 통해 해결되어야 한다.[^129][^130][^131]

전문가들은 자율 주행 차량이 해를 끼칠 가능성이 있으므로 정당한 결정과 해로운 결정을 구별할 수 있어야 한다고 주장한다.[^132] 스마트 기계가 도덕적 결정을 내릴 수 있도록 하기 위해 제안된 두 가지 주요 접근법은, 기계가 공식적인 규칙이나 도덕 철학 없이 인간의 행동을 관찰하여 윤리적 결정을 학습해야 한다고 제안하는 상향식 접근법과, 특정 윤리 원칙을 기계의 안내 시스템에 프로그래밍하는 하향식 접근법이다. 그러나 두 전략 모두 상당한 과제에 직면해 있다: 하향식 기법은 특정 도덕적 신념을 보존하기 어렵다는 비판을 받고 있으며, 상향식 전략은 인간 활동으로부터 잠재적으로 비윤리적인 학습을 할 수 있다는 의문이 제기된다.

무기화

일부 전문가와 학자들은 특히 로봇에 어느 정도의 자율 기능이 부여될 때 군사 전투에 로봇을 사용하는 것에 의문을 제기했다.^133 미 해군은 군사 로봇이 더 복잡해짐에 따라 자율적 결정 능력의 함의에 더 큰 관심을 기울여야 한다는 보고서에 자금을 지원했다.^29 미국 인공지능학회 회장은 이 문제를 검토하기 위한 연구를 의뢰했다.^134 이들은 인간의 상호작용을 모방할 수 있는 언어 습득 장치와 같은 프로그램을 지적한다.

2019년 10월 31일, 미국 국방부 산하 국방 혁신 위원회는 인간 운용자가 항상 '블랙박스'를 들여다보고 킬 체인 과정을 이해할 수 있도록 보장하는 국방부의 인공지능 윤리적 사용 원칙을 권고하는 보고서 초안을 발표했다. 그러나 주요 우려 사항은 보고서가 어떻게 이행될 것인가이다.[^135] 미 해군은 군사 로봇이 더 복잡해짐에 따라 자율적 결정 능력의 함의에 더 큰 관심을 기울여야 한다는 보고서에 자금을 지원했다.^29 일부 연구자들은 자율 로봇이 결정을 더 효과적으로 내릴 수 있으므로 더 인도적일 수 있다고 말한다.[^136] 2024년에 미국 국방고등연구계획국(DARPA)은 테스트 커뮤니티를 통해 자율 무기 시스템의 윤리적 함의를 평가하기 위한 지표를 개발하는 프로그램인 군사 작전 가치를 갖춘 자율성 표준 및 이상(ASIMOV)에 자금을 지원했다.[^137][^138]

연구는 부여된 도덕적 책임을 사용하여 학습하는 능력을 갖춘 자율 시스템을 만드는 방법을 조사해 왔다. "그 결과는 미래의 군사 로봇을 설계할 때, 로봇에 책임을 전가하려는 원치 않는 경향을 제어하는 데 사용될 수 있다."[^139] 결과주의적 관점에서 보면, 로봇이 누구를 죽일 것인지에 대한 자체적인 논리적 결정을 내릴 능력을 개발할 가능성이 있으며, 이것이 AI가 무시할 수 없는 확립된 도덕적 체계가 있어야 하는 이유이다.[^140]

최근 인류의 로봇 지배를 포함하는 아이디어가 담긴 인공지능 무기의 개발에 대한 강한 반발이 있어 왔다. AI 무기는 인간이 제어하는 무기와는 다른 유형의 위험을 제시한다. 많은 정부가 AI 무기 개발 프로그램에 자금을 지원하기 시작했다. 미국 해군은 최근 자율 드론 무기 개발 계획을 발표했으며, 러시아와 한국도[^141] 각각 유사한 발표를 했다. AI 무기가 인간이 운용하는 무기보다 더 위험해질 가능성 때문에, 스티븐 호킹과 맥스 테그마크는 AI 무기를 금지하는 "미래의 삶" 청원서[^142]에 서명했다. 호킹과 테그마크가 게시한 메시지는 AI 무기가 즉각적인 위험을 초래하며 가까운 미래에 재앙적 재난을 피하기 위한 행동이 필요하다고 밝힌다.[^31]

"어떤 주요 군사 강국이 AI 무기 개발을 추진한다면, 전 세계적인 군비 경쟁은 사실상 불가피하며, 이 기술적 궤적의 종착점은 분명하다: 자율 무기는 내일의 칼라시니코프가 될 것이다"라고 청원서는 말하며, Skype 공동 창립자 얀 탈린과 MIT 언어학 교수 노암 촘스키를 AI 무기에 반대하는 추가 지지자로 포함하고 있다.[^143]

물리학자이자 왕실 천문학자인 마틴 리스 경은 "멍청한 로봇의 폭주나 자체적으로 마음을 갖게 된 네트워크"와 같은 재앙적 사례에 대해 경고했다. 케임브리지에서 리스의 동료인 휴 프라이스도 지능이 "생물학의 제약에서 벗어날" 때 인류가 생존하지 못할 수 있다는 유사한 경고를 표명했다. 이 두 교수는 인류 존재에 대한 이 위협을 피하기 위해 케임브리지 대학교에 실존적 위험 연구 센터를 설립했다.[^31]

인간보다 더 똑똑한 시스템이 군사적으로 사용될 가능성과 관련하여, 오픈 필란트로피 프로젝트는 이러한 시나리오가 "통제력 상실과 관련된 위험만큼이나 중요할 수 있다"고 쓰고 있지만, AI의 장기적 사회적 영향을 조사하는 연구는 이 우려에 비교적 적은 시간을 할애했다: "이 부류의 시나리오는 이 분야에서 가장 활발히 활동해 온 기계 지능 연구소(MIRI)나 인류 미래 연구소(FHI)와 같은 조직의 주요 초점이 아니었으며, 이에 대한 분석과 논의도 상대적으로 적었다".[^144]

학자 가오 치치는 AI의 군사적 사용이 국가 간 군사 경쟁을 격화시킬 위험이 있으며, 군사 문제에서 AI의 영향은 한 국가에 국한되지 않고 파급 효과를 가질 것이라고 쓴다.[^32] 가오는 미국의 AI 군사 사용을 예로 들며, 이것이 의사 결정에 대한 책임을 회피하기 위한 희생양으로 사용되어 왔다고 주장한다.[^32]

2023년에 헤이그에서 군사 분야에서의 AI 책임 있는 사용 문제에 관한 정상회의가 개최되었다.[^33]

특이점

버너 빈지를 비롯한 많은 사람들은 일부 또는 모든 컴퓨터가 인간보다 더 똑똑해지는 순간이 올 수 있다고 제안했다. 이 사건의 시작은 일반적으로 "특이점"[^34]이라고 불리며, 특이점주의 철학에서 중심 논의 주제이다. 특이점 이후 인류의 궁극적 운명에 대한 의견은 다양하지만, 인공지능이 초래할 수 있는 잠재적 실존적 위험을 완화하려는 노력은 최근 몇 년간 컴퓨터 과학자, 철학자, 일반 대중 사이에서 중요한 관심 주제가 되었다.

많은 연구자들은 지능 폭발을 통해 자기 개선하는 AI가 너무 강력해져서 인간이 그것의 목표 달성을 막을 수 없게 될 수 있다고 주장했다. 그의 논문 "고급 인공지능의 윤리적 문제"와 후속 저서 초지능: 경로, 위험, 전략에서, 철학자 닉 보스트롬은 인공지능이 인류 멸종을 초래할 수 있는 능력이 있다고 주장한다. 그는 인공 초지능이 독자적인 주도권을 갖고 자체 계획을 세울 수 있으므로, 자율적 행위자로 보는 것이 더 적절할 수 있다고 주장한다. 인공 지성이 인간의 동기 부여 경향을 공유할 필요가 없으므로, 초지능의 초기 동기를 명시하는 것은 설계자의 몫이 된다. 초지능 AI는 거의 모든 가능한 결과를 달성하고 목표 실행을 방해하려는 어떠한 시도도 좌절시킬 수 있기 때문에, 통제되지 않는 많은 의도치 않은 결과가 발생할 수 있다. 그것은 다른 모든 행위자를 제거하거나, 그들의 행동을 변경하도록 설득하거나, 그들의 간섭 시도를 차단할 수 있다.[^145]

그러나 보스트롬은 초지능이 질병, 빈곤, 환경 파괴와 같은 많은 어려운 문제를 해결할 잠재력이 있으며, 인간이 스스로를 향상시키는 데 도움이 될 수 있다고 주장했다.[^146]

도덕 철학이 완벽한 윤리 이론을 제공하지 않는 한, AI의 효용 함수는 주어진 윤리적 체계에는 부합하지만 "상식"에는 부합하지 않는 많은 잠재적으로 해로운 시나리오를 허용할 수 있다. 엘리에저 유드코프스키에 따르면, 인공적으로 설계된 마음이 그러한 적응을 가질 것이라고 가정할 이유는 거의 없다.^147 스튜어트 J. 러셀,[^148] 빌 히바드, 로만 얌폴스키,[^149] 섀넌 발러,[^150] 스티븐 움브렐로[^151] 및 루치아노 플로리디[^152] 같은 AI 연구자들은 유익한 기계를 개발하기 위한 설계 전략을 제안했다.

해결책과 접근 방식

인공지능의 윤리적 과제를 해결하기 위해 개발자들은 책임 있는 AI 행동을 보장하도록 설계된 다양한 시스템을 도입해 왔다. 대표적인 예로는 대규모 AI 모델의 안전성과 정렬을 개선하는 데 중점을 둔 엔비디아의 라마 가드(Llama Guard),[^153] 그리고 프리앰블(Preamble)의 맞춤형 가드레일 플랫폼이 있다.[^35] 이러한 시스템은 AI 모델의 기능에 윤리적 지침을 내장함으로써 알고리즘 편향, 오용, 프롬프트 주입 공격을 포함한 취약점 등의 문제를 해결하는 것을 목표로 한다.

프롬프트 주입은 악의적인 입력을 통해 AI 시스템이 의도하지 않거나 유해한 출력을 생성하도록 만드는 기법으로, 이러한 개발 노력의 주요 초점이 되어 왔다. 일부 접근 방식은 맞춤형 정책과 규칙을 사용하여 입력과 출력을 분석함으로써 잠재적으로 문제가 될 수 있는 상호작용을 필터링하거나 완화한다.[^35] 다른 도구들은 입력에 구조화된 제약 조건을 적용하거나, 출력을 사전 정의된 매개변수로 제한하거나,[^154] 실시간 모니터링 메커니즘을 활용하여 취약점을 식별하고 해결하는 데 중점을 둔다.[^155] 이러한 노력은 특히 중요한 응용 분야에서 인공지능의 사용이 점점 더 광범위해짐에 따라, 인공지능 시스템이 안전성과 윤리적 고려를 최우선으로 하여 설계되도록 보장하려는 더 넓은 추세를 반영한다.[^156][^157]

인공지능 정책 및 윤리 관련 기관

인공지능 윤리와 정책에 관심을 가진 많은 조직이 있으며, 공공 및 정부 기관뿐만 아니라 기업 및 사회 단체도 포함된다.

아마존, 구글, 페이스북, IBM, 마이크로소프트는 인공지능 기술에 대한 모범 사례를 수립하고, 대중의 이해를 증진하며, 인공지능에 관한 플랫폼 역할을 수행하기 위해 비영리 단체인 '사람과 사회를 위한 AI 파트너십(The Partnership on AI to Benefit People and Society)'을 설립하였다. 애플은 2017년 1월에 합류하였다. 기업 회원들은 이 단체에 재정적·연구적 기여를 하는 동시에, 학술 전문가를 이사회에 참여시키기 위해 과학계와 협력하고 있다.[^158]

IEEE는 '자율 및 지능형 시스템의 윤리에 관한 글로벌 이니셔티브(Global Initiative on Ethics of Autonomous and Intelligent Systems)'를 구성하여 대중의 의견을 수렴하며 지침을 작성하고 개정해 왔으며, 조직 내외의 많은 전문가를 회원으로 받아들이고 있다. IEEE의 자율 시스템 윤리 이니셔티브는 자율 시스템의 개발 및 사용에 대한 지침을 마련하면서 의사결정 및 사회적 영향과 관련된 윤리적 딜레마를 다루는 것을 목표로 한다. 특히 인공지능과 로보틱스 같은 분야에서 책임있는 로보틱스 재단(Foundation for Responsible Robotics)은 도덕적 행동과 책임 있는 로봇 설계 및 사용을 촉진하는 데 전념하며, 로봇이 도덕적 원칙을 유지하고 인간의 가치와 일치하도록 보장하고 있다.

전통적으로 정부는 입법과 치안을 통해 윤리가 준수되도록 하는 역할을 해왔다. 현재 각국 정부와 초국가적 정부 및 비정부 기구들이 인공지능이 윤리적으로 적용되도록 하기 위한 많은 노력을 기울이고 있다.

인공지능 윤리 작업은 개인의 가치관과 직업적 헌신에 의해 구조화되며, 데이터와 알고리즘을 통해 맥락적 의미를 구성하는 것을 포함한다. 따라서 인공지능 윤리 작업에는 적절한 인센티브가 필요하다.[^159]

국제기구 이니셔티브

- 유럽연합 집행위원회에는 인공지능 고위 전문가 그룹이 있다. 이 그룹은 2019년 4월 8일 "신뢰할 수 있는 인공지능을 위한 윤리 지침"을 발표하였다.[^160] 유럽연합 집행위원회에는 또한 로보틱스 및 인공지능 혁신·우수성 부서가 있으며, 2020년 2월 19일 인공지능 혁신의 우수성과 신뢰에 관한 백서를 발표하였다.[^161] 유럽연합 집행위원회는 또한 인공지능법(Artificial Intelligence Act)을 제안하였으며, 이 법은 2024년 8월 1일 발효되었고, 조항들은 시간이 지남에 따라 점진적으로 시행될 예정이다.[^162]

- OECD는 OECD AI 정책 관측소를 설립하였다.[^163]

- 2021년 유네스코는 인공지능 윤리에 관한 권고를 채택하였으며,[^164] 이는 인공지능 윤리에 관한 최초의 글로벌 표준이다.[^165]

정부 이니셔티브

- 미국에서 오바마 행정부는 인공지능 정책 로드맵을 수립하였다.[^166] 오바마 행정부는 인공지능의 미래와 영향에 관한 두 개의 주요 백서를 발표하였다. 2019년에는 백악관이 "미국 AI 이니셔티브"로 알려진 행정 메모를 통해 NIST(미국 국립표준기술연구소)에 연방 차원의 AI 표준 참여 작업을 시작하도록 지시하였다(2019년 2월).[^167] *2020년 1월, 미국에서 트럼프 행정부는 관리예산국(OMB)이 발행한 "인공지능 응용 규제를 위한 지침"("OMB AI 각서")에 관한 행정명령 초안을 발표하였다. 이 명령은 AI 응용에 대한 투자, AI에 대한 대중의 신뢰 향상, AI 사용 장벽 감소, 글로벌 시장에서 미국 AI 기술의 경쟁력 유지의 필요성을 강조한다. 개인정보 보호에 대한 우려의 필요성은 언급되어 있으나, 집행에 대한 추가적인 세부 사항은 없다. 미국 AI 기술의 발전이 초점이자 우선순위인 것으로 보인다. 또한 연방 기관들은 시장이 이행하기에 너무 부담스럽다고 볼 수 있는 주법 및 규정을 우회하기 위해 이 명령을 사용하도록 권장받기도 한다.[^168] *2024년 인공지능 연구·혁신·책임법(Artificial Intelligence Research, Innovation, and Accountability Act of 2024)은 미국 상원의원 John Thune이 발의한 초당적 법안으로, 웹사이트가 사용자와의 상호작용 처리에 AI 시스템을 사용하는 것을 공개하도록 요구하고, 사전 정의된 평가 기준에 기반한 감독을 위해 연간 설계 및 안전 계획을 미국 국립표준기술연구소에 제출하도록 요구함으로써 "고영향 AI 시스템"의 투명성을 규제하고자 하였다.[^169] *컴퓨팅 커뮤니티 컨소시엄(CCC)은 100페이지 이상의 보고서 초안을 제출하였다[^170] – 미국 인공지능 연구를 위한 20년 커뮤니티 로드맵[^171]

- 신흥기술안보센터(Center for Security and Emerging Technology)는 AI와 같은 신흥 기술의 안보적 함의에 대해 미국 정책 입안자들에게 자문을 제공한다.

- 러시아에서는 2021년 최초의 러시아 "인공지능 윤리 강령"이 기업 분야를 위해 서명되었다. 이는 러시아 연방 정부 분석센터가 Sberbank, Yandex, Rosatom, 고등경제학교(Higher School of Economics), 모스크바 물리기술연구소(Moscow Institute of Physics and Technology), ITMO 대학, Nanosemantics, Rostelecom, CIAN 등 주요 상업 및 학술 기관과 함께 주도하였다.^172

학술 이니셔티브

*옥스퍼드 대학교의 여러 연구소가 AI 윤리를 핵심적으로 다루어 왔다. 인류미래연구소(Future of Humanity Institute)는 2024년 폐쇄되기 전까지 AI 안전[^173]과 AI 거버넌스[^174]에 집중하였다.[^175] John Tasioulas가 소장을 맡고 있는 AI 윤리연구소(Institute for Ethics in AI)는 AI 윤리를 관련 응용 윤리 분야와 비교하여 고유한 학문 분야로 촉진하는 것을 주요 목표로 하고 있다. Luciano Floridi가 소장을 맡고 있는 옥스퍼드 인터넷 연구소(Oxford Internet Institute)는 단기적 AI 기술과 ICT의 윤리에 초점을 맞추고 있다.[^176] 옥스퍼드 마틴 스쿨의 AI 거버넌스 이니셔티브는 기술적·정책적 관점에서 AI로 인한 위험을 이해하는 데 중점을 두고 있다.[^177] *베를린 헤르티 스쿨(Hertie School)의 디지털 거버넌스 센터는 Joanna Bryson이 공동 설립하여 윤리와 기술에 관한 문제를 연구하고 있다.[^178] *뉴욕대학교(NYU)의 AI Now 연구소는 인공지능의 사회적 함의를 연구하는 연구 기관이다. 학제 간 연구는 편향과 포용, 노동과 자동화, 권리와 자유, 안전과 시민 인프라라는 주제에 집중하고 있다.[^179] *윤리와 신흥기술연구소(IEET)는 AI가 실업[^180][^181]과 정책에 미치는 영향을 연구한다. *뮌헨 공과대학교의 인공지능 윤리연구소(IEAI)는 Christoph Lütge가 소장을 맡고 있으며, 이동성, 고용, 의료, 지속가능성 등 다양한 분야에 걸쳐 연구를 수행한다.[^182] *하버드 대학교 John A. Paulson 공학응용과학대학의 Higgins 자연과학 교수인 Barbara J. Grosz는 하버드의 컴퓨터 과학 교육과정에 '임베디드 윤리(Embedded EthiCS)'를 도입하여, 자신의 연구가 사회에 미치는 영향을 고려하는 세계관을 갖춘 차세대 컴퓨터 과학자를 양성하고 있다.[^183]

민간 단체

- 알고리즘 정의 리그(Algorithmic Justice League)[^184]

- 블랙 인 AI(Black in AI)[^185]

- 흑인을 위한 데이터(Data for Black Lives)[^186]

역사

역사적으로 "사고하는 기계"의 도덕적·윤리적 함의에 대한 탐구는 적어도 계몽주의 시대까지 거슬러 올라간다. 라이프니츠는 이미 감각을 가진 존재처럼 행동하는 기계에 지능을 부여해야 하는지에 대한 질문을 제기했으며,[^187] 데카르트 역시 튜링 테스트의 초기 버전이라 할 수 있는 것을 기술한 바 있다.[^188]

낭만주의 시대에는 창조자의 통제를 벗어나 끔찍한 결과를 초래하는 인공 피조물이 여러 차례 구상되었는데, 가장 유명한 것은 메리 셸리의 프랑켄슈타인이다. 그러나 19세기와 20세기 초에 산업화와 기계화에 대한 광범위한 관심은 통제되지 않는 기술 발전의 윤리적 함의를 픽션의 전면에 부각시켰다. 카렐 차페크의 희곡 R.U.R – 로숨의 만능 로봇은 감정을 부여받은 지각 있는 로봇이 노예 노동으로 사용되는 내용으로, '로봇'이라는 용어의 창안(체코어로 강제 노동을 뜻하는 robota에서 유래)으로 인정받을 뿐 아니라[^189] 1921년 초연 이후 국제적인 성공을 거두었다. 조지 버나드 쇼의 1921년 출간 희곡 므두셀라로 돌아가서는 인간처럼 행동하는 사고 기계의 타당성에 의문을 제기하며, 프리츠 랑의 1927년 영화 메트로폴리스는 기술관료 사회의 억압적 체제에 맞서 착취당하는 대중의 봉기를 이끄는 안드로이드를 보여준다.

1950년대에 아이작 아시모프는 아이, 로봇에서 기계를 어떻게 통제할 것인가라는 문제를 다루었다. 편집자 존 W. 캠벨 주니어의 권유로, 그는 인공지능 시스템을 규율하기 위한 로봇 공학 3원칙을 제안했다. 이후 그의 작업 대부분은 세 가지 법칙의 경계를 시험하여 어디에서 무너지거나 역설적이거나 예상치 못한 행동을 만들어내는지를 탐구하는 데 할애되었다.[^190] 그의 작품은 어떤 고정된 법칙 집합도 모든 가능한 상황을 충분히 예측할 수 없음을 시사한다.[^36] 보다 최근에는 학계와 많은 정부가 AI 자체에 책임을 물을 수 있다는 발상에 이의를 제기하고 있다.[^37] 2010년 영국이 소집한 패널은 AI가 제조사 또는 소유자/운영자의 책임임을 명확히 하기 위해 아시모프의 법칙을 수정했다.[^38]

기계지능연구소의 엘리에저 유드코프스키는 2004년에 "우호적 AI"를 구축하는 방법을 연구할 필요성을 제안하며, AI를 본질적으로 우호적이고 인간적으로 만들기 위한 노력도 필요하다고 주장했다.[^191]

2009년에는 학자들과 기술 전문가들이 미국인공지능학회(AAAI)가 주최한 학술대회에 참석하여 로봇과 컴퓨터의 잠재적 영향, 그리고 이들이 자급자족하며 스스로 결정을 내릴 수 있게 되는 가설적 가능성의 영향에 대해 논의했다. 그들은 컴퓨터와 로봇이 어느 정도의 자율성을 획득할 수 있는지, 그리고 그러한 능력을 이용하여 어느 정도까지 위협이나 위험을 초래할 수 있는지에 대한 가능성과 범위를 논의했다.[^192] 그들은 일부 기계가 스스로 전력원을 찾거나 무기로 공격할 목표를 독자적으로 선택하는 것을 포함하여 다양한 형태의 준자율성을 획득했다고 지적했다. 또한 일부 컴퓨터 바이러스가 제거를 회피할 수 있으며 "바퀴벌레 수준의 지능"을 달성했다고도 언급했다. 공상과학에서 묘사되는 자기 인식은 실현 가능성이 낮지만, 다른 잠재적 위험과 함정이 존재한다고 지적했다.[^34]

마찬가지로 2009년, 스위스 로잔 연방공과대학교 지능시스템연구소에서 수행된 실험에서, 서로 협력하도록(유익한 자원을 탐색하고 유해한 자원을 회피하도록) 프로그래밍된 로봇들은 결국 유익한 자원을 독차지하기 위해 서로에게 거짓말하는 법을 학습하게 되었다.^193

픽션의 역할과 영향

AI 윤리에 관한 픽션의 역할은 복잡한 양상을 띠어 왔다.[^39] 픽션이 인공지능과 로봇공학의 발전에 영향을 미친 세 가지 차원을 구별할 수 있다. 역사적으로 픽션은 AI의 목표와 비전에 영향을 미쳤을 뿐만 아니라, 이와 관련된 윤리적 문제와 일반적인 두려움을 제시하는 공통적 주제들을 선취해 왔다. 20세기 후반과 21세기 초반 수십 년 동안, 대중문화, 특히 영화, TV 시리즈, 비디오 게임은 AI와 로봇공학에 관한 윤리적 문제를 둘러싼 우려와 디스토피아적 전망을 빈번하게 반영해 왔다. 최근에는 이러한 주제들이 공상과학 소설의 영역을 넘어 문학에서도 점점 더 많이 다루어지고 있다. 또한 카탈루냐 공과대학교 Institut de Robòtica i Informàtica Industrial(로봇공학 및 산업정보학 연구소)의 연구 교수인 카르메 토라스가 지적한 바와 같이,[^194] 고등교육에서도 공상과학 소설은 공학 학위 과정에서 기술 관련 윤리 문제를 가르치는 데 점점 더 많이 활용되고 있다.

TV 시리즈

AI와 관련된 윤리적 문제는 수십 년간 공상과학 문학과 장편 영화에서 다루어져 왔지만, 더 길고 복잡한 줄거리와 인물 발전을 가능하게 하는 장르로서 TV 시리즈의 등장은 기술의 윤리적 함의를 다루는 몇 가지 중요한 기여를 이끌어냈다. 스웨덴 시리즈 리얼 휴먼즈(2012–2013)는 인공적 지각 존재를 사회에 통합하는 것과 관련된 복잡한 윤리적·사회적 결과를 다루었다. 영국의 디스토피아 공상과학 앤솔로지 시리즈 블랙 미러(2013–현재)는 최근의 다양한 기술 발전과 연관된 디스토피아적 허구의 전개를 실험한 것으로 특히 주목할 만하다. 프랑스 시리즈 오스모시스(2020)와 영국 시리즈 더 원은 기술이 한 사람에게 이상적인 파트너를 찾아주려 할 때 어떤 일이 벌어질 수 있는지에 대한 문제를 다루고 있다. 넷플릭스 시리즈 러브, 데스+로봇의 여러 에피소드는 로봇과 인간이 함께 살아가는 장면을 상상했다. 그 중 가장 대표적인 것은 시즌 2 에피소드 1로, 인간이 삶에서 로봇에 지나치게 의존할 경우 로봇이 통제를 벗어났을 때 얼마나 나쁜 결과가 초래될 수 있는지를 보여준다.[^195]

픽션과 게임 속 미래 비전

영화 13번째 층은 오락 목적으로 컴퓨터 게임 콘솔이 지각 있는 주민이 사는 시뮬레이션 세계를 만들어내는 미래를 제시한다. 영화 매트릭스는 지구의 지배 종이 지각 있는 기계이며 인류가 극단적인 종차별주의로 대우받는 미래를 제시한다. 단편소설 「플랑크 다이브」는 인류가 스스로를 복제하고 최적화할 수 있는 소프트웨어로 전환한 미래를 제시하며, 소프트웨어 유형 간의 중요한 구분은 지각이 있는 것과 없는 것이다. 같은 발상은 스타십 보이저의 응급 의료 홀로그램에서도 찾아볼 수 있는데, 이는 창작자인 짐머만 박사의 의식 중 축소된 일부를 복제한 것으로 보이는 지각 있는 존재이며, 짐머만 박사는 최선의 동기로 긴급 상황 시 의료 지원을 제공하기 위해 이 시스템을 만들었다. 영화 바이센테니얼 맨과 *A.I.*는 사랑할 수 있는 지각 있는 로봇의 가능성을 다루고 있다. 아이, 로봇은 아시모프의 로봇 3원칙의 일부 측면을 탐구했다. 이 모든 시나리오는 지각 있는 컴퓨터의 창조가 가져올 수 있는 비윤리적 결과를 예견하고자 한다.[^196]

시간이 지남에 따라 논쟁은 가능성보다 바람직성에 점점 더 초점을 맞추는 경향을 보여 왔으며,[^197] 이는 위고 드 가리스와 케빈 워릭이 시작한 "코스미스트"와 "테란" 논쟁에서 강조된 바와 같다.

같이 보기

외부 링크

- 인터넷 철학 백과사전의 인공지능의 윤리

- 스탠퍼드 철학 백과사전의 인공지능과 로봇공학의 윤리

- 인공지능의 법, 윤리 및 정책에 관한 케임브리지 핸드북

-

- Sheludko, M. (2023년 12월). 인공지능의 윤리적 측면: 과제와 당면 과제. 소프트웨어 개발 블로그.

-

- 윤리

참고 문헌

[^1]: Müller, Vincent C.. 인공지능과 로봇공학의 윤리. (2020년 4월 30일)

[^2]: 잠재적 미래 인공지능 위험, 이점 및 정책 과제 평가. (2024-11-14)

[^3]: Anderson. 기계 윤리

[^4]: 기계 윤리. [[케임브리지 대학교 출판부]]. (2011년 7월)

[^5]: Anderson, M.. 객원 편집자 서문: 기계 윤리. (2006년 7월)

[^6]: Anderson, Michael. 기계 윤리: 윤리적 지능형 에이전트 만들기. (2007년 12월 15일)

[^7]: Winfield, A. F.. 기계 윤리: 윤리적 AI 및 자율 시스템의 설계와 거버넌스 [이슈 스캐닝]. (2019년 3월)

[^8]: Wallach, Wendell. 도덕적 기계: 로봇에게 옳고 그름을 가르치기. [[옥스퍼드 대학교 출판부]]. (2008년 11월)

[^9]: Santos-Lang, Chris. 인공지능을 위한 윤리

[^10]: Knight, Will. 구글의 AI 수장, 일론 머스크의 킬러 로봇은 잊고 AI 시스템의 편향을 걱정하라고 말하다

[^11]: Knaus, Thomas. AI가 교육에 중요한 이유—일곱 가지 논거를 통한 탐구. (2025-10-23)

[^12]: Buolamwini, Joy. 젠더 셰이드: 상업용 성별 분류의 교차적 정확도 격차. 기계학습 연구 논문집, 81, 77-91.. 기계학습 연구 논문집. (2018)

[^13]: Spindler, Gerald. 인공지능 책임에 대한 다양한 접근법 – 장단점. Nomos Verlagsgesellschaft mbH & Co. KG. (2023)

[^14]: mkaczmarski. 효율성 향상에도 불구하고 2025-26년 AI 에너지 수요 증가 전망. (2025-04-11)

[^15]: 해설: 생성형 AI의 환경 영향. (2025-01-17)

[^16]: Kanungo, Alokya. AI의 실제 환경 영향. (2023-07-18)

[^17]: Coleman, Jude. AI의 기후 영향은 배출량을 넘어선다

[^19]: 7001-2021 – 자율 시스템 투명성에 관한 IEEE 표준. IEEE. (2022년 3월 4일)

[^20]: Thurm, Scott. 마이크로소프트, 안면인식 기술의 연방 규제 촉구. (2018년 7월 13일)

[^21]: Bastin, Roland. 일반 데이터 보호 규정 산업 간 혁신. Deloitte. (2017년 6월)

[^22]: EU AI법: 인공지능에 관한 최초의 규제. (2023년 8월 6일)

[^23]: AI법 발효. (2024-08-01)

[^24]: 인공적 고통: 합성 현상학에 대한 전 세계적 모라토리엄 논거. (2021년 2월)

[^25]: 고통 없는 기능적으로 효과적인 의식적 AI. (2020)

[^26]: Roose, Kevin. AI 시스템이 의식을 갖게 되면 권리를 가져야 하는가?. (2025-04-24)

[^27]: [[조지프 바이첸바움]], Harvnb McCorduck 2004 pp=356, 374–376에서 인용

[^28]: Kaplan, Andreas. 시리, 시리, 내 손 안의 시리: 이 땅에서 가장 공정한 자는 누구인가? 인공지능의 해석, 예시 및 함의에 대하여. (2019년 1월)

[^31]: 인공지능이 너무 쉽게 무기화될 수 있는 이유 – The Atlantic. (2015-08-14)

[^32]: Bachulska, Alicja. 중국이라는 이념: 권력, 진보, 인민에 대한 중국 사상가들. [[유럽외교관계위원회]]. (2024년 7월 2일)

[^33]: Brandon Vigliarolo. 국제 군사 AI 정상회의, 60개국 서약으로 마무리

[^34]: Markoff, John. 과학자들, 기계가 인간을 능가할 수 있다고 우려. (2009년 7월 25일)

[^35]: Šekrst, Kristina. 설계에 의한 AI 윤리: 책임 있는 AI 개발을 위한 맞춤형 가드레일 구현

[^36]: Asimov, Isaac. 아이, 로봇. Bantam

[^37]: Bryson, Joanna. 사람의, 사람을 위한, 사람에 의한: 합성 인격의 법적 공백. (2017년 9월)

[^38]: 로봇공학의 원칙. 영국 EPSRC. (2010년 9월)

[^39]: Bassett, Caroline. 더 잘 만들어진: 과학 소설과 혁신의 상호 영향. Nesta

[^40]: Boyles, Robert James M.. 인공 도덕 행위자 프레임워크를 위한 철학적 이정표. (2017)

[^41]: Al-Rodhan, Nayef. 도덕적 코드. (2015년 12월 7일)

[^42]: Sauer, Megan. 일론 머스크, 인간이 결국 뇌를 로봇에 다운로드할 수 있을 것이라고 말하다 — 그라임스는 제프 베이조스가 그렇게 할 것이라고 생각. (2022-04-08)

[^43]: Anadiotis, George. 재미, 이익, 윤리를 위한 AI 언어 모델 다루기. (2022년 4월 4일)

[^44]: Bostrom, Nick. 인공지능의 윤리. [[케임브리지 출판부]]

[^45]: Russell, Stuart J.. 휴먼 컴패터블: 인공지능과 통제의 문제. Viking. (2019)

[^46]: Šekrst, Kristina. 환상 엔진: 기계 의식을 향한 탐구. Springer

[^47]: Gabriel, Iason. 더 공정한 알고리즘을 위한 논거 – Iason Gabriel. (2018-03-14)

[^48]: 인공지능에서 편향의 5가지 예상치 못한 원천. (2016년 12월 10일)

[^49]: Villasenor, John. 인공지능과 편향: 네 가지 핵심 과제. (2019-01-03)

[^50]: Goodman, Emma. 데이터 권력 재고: AI 과대광고와 기업 윤리를 넘어서. (2025-06-06)

[^51]: Friedman, Batya. 컴퓨터 시스템에서의 편향. (1996년 7월)

[^52]: AI에서 편향 제거하기

[^53]: Abdalla, Mohamed. 방 안의 코끼리: 자연어 처리 연구에서 빅테크의 존재감 분석. 전산 언어학 협회. (2023)

[^54]: Olson, Parmy. 구글의 딥마인드, 편향된 AI를 막기 위한 아이디어를 제시

[^55]: 기계학습 공정성 {{!

[^56]: AI와 편향 – IBM Research – US

[^57]: Bender, Emily M.. 자연어 처리를 위한 데이터 명세서: 시스템 편향 완화와 더 나은 과학을 향하여. (2018년 12월)

[^58]: Gebru, Timnit. 데이터셋을 위한 데이터시트. (2018)

[^59]: Pery, Andrew. 신뢰할 수 있는 인공지능과 프로세스 마이닝: 과제와 기회. (2021-10-06)

[^60]: Ruggieri, Salvatore. 공정한 AI를 신뢰할 수 있는가?. 미국인공지능학회(AAAI). (2023-06-26)

[^61]: Ntoutsi, Eirini. 데이터 기반 인공지능 시스템에서의 편향—입문적 개관. (2020년 5월)

[^62]: Dastin, Jeffrey. 인사이트 – 아마존, 여성에 대한 편향을 보인 비밀 AI 채용 도구 폐기. (2018-10-11)

[^63]: 아마존, 여성에 대한 편향을 보인 비밀 AI 채용 도구 폐기. (2018-10-10)

[^64]: Lohr, Steve. 안면인식은 정확하다, 백인 남성이라면. (2018년 2월 9일)

[^65]: 구글, 사진 앱의 인종차별적 실수에 대해 사과. (2015-07-01)

[^66]: Simonite, Tom. 고릴라에 관한 한, 구글 포토는 여전히 눈이 멀어 있다. (2018-01-11)

[^67]: Manyika, James. 올바른 AI 구현: AI와 사회에 관한 서론적 노트. (2022)

[^68]: Koenecke, Allison. 자동 음성 인식에서의 인종적 격차. (2020년 4월 7일)

[^69]: Imran, Ali. AI4COVID-19: 앱을 통한 기침 샘플로부터의 AI 기반 COVID-19 예비 진단. (2020-01-01)

[^70]: Cirillo, Davide. 생의학 및 의료에서 인공지능의 성별 차이와 편향. (2020-06-01)

[^71]: Christian, Brian. 정렬 문제: 기계학습과 인간의 가치. W. W. Norton & Company. (2021)

[^72]: Ntoutsi, Eirini. 데이터 기반 인공지능 시스템에서의 편향—입문적 개관. (2020년 5월)

[^73]: Busker, Tony. 제16회 전자 거버넌스 이론 및 실무 국제 컨퍼런스 논문집. 미국컴퓨팅학회. (2023-11-20)

[^74]: Kotek, Hadas. ACM 집단지성 컨퍼런스 논문집. 미국컴퓨팅학회. (2023-11-05)

[^75]: Wang, Tianlu. 균형 잡힌 데이터셋만으로는 충분하지 않다: 딥 이미지 표현에서의 성별 편향 추정 및 완화. arXiv. (2019-10-11)

[^76]: Albiero, Vítor. 안면인식 정확도에서의 성별 불평등 분석. arXiv. (2020-01-31)

[^77]: Hamidi, Foad. 성별 인식인가 성별 환원주의인가? 내장된 성별 인식 시스템의 사회적 함의. 미국컴퓨팅학회. (2018-04-19)

[^78]: Keyes, Os. 오인식 기계: 자동 성별 인식의 트랜스/HCI 함의. (2018년 11월 1일)

[^79]: Cheng, Myra. 표시된 페르소나: 자연어 프롬프트를 사용한 언어 모델의 고정관념 측정. (2023-05-29)

[^80]: Pretorius, Lynette. 국제 박사과정 학생 역량 강화: 생성형 AI, 우분투, 학술 커뮤니케이션의 탈식민지화. (2025)

[^81]: Eacersall, Douglas. 생성형 AI 강화 연구에서의 윤리적 과제 탐색: 책임 있는 생성형 AI 사용을 위한 ETHICAL 프레임워크. (2025)

[^82]: Feng, Shangbin. 사전훈련 데이터에서 언어 모델을 거쳐 다운스트림 작업까지: 불공정한 NLP 모델로 이어지는 정치적 편향의 흔적 추적. 전산 언어학 협회. (2023년 7월)

[^83]: Zhou, Karen. 자동 요약에서 정치적 편향의 개체 기반 평가. 전산 언어학 협회. (2023년 12월)

[^84]: Hammond, George. 빅테크, AI 스타트업에 벤처 캐피털 기업보다 더 많이 투자. (2023년 12월 27일)

[^85]: Wong, Matteo. AI의 미래는 GOMA다. (2023년 10월 24일)

[^86]: 빅테크와 AI 지배를 위한 추구. (2023년 3월 26일)

[^87]: Fung, Brian. AI 지배를 위한 전투가 결정될 수 있는 곳. (2023년 12월 19일)

[^88]: Metz, Cade. AI 시대, 기술 업계의 작은 기업들에게 큰 친구가 필요하다. (2023년 7월 5일)

[^89]: Stewart, Ashley. 허깅페이스 CEO, 45억 달러 규모 오픈소스 AI 스타트업을 위한 '지속 가능한 모델' 구축에 집중한다고 밝혀

[^90]: 오픈소스 AI 붐은 빅테크의 지원 위에 세워졌다. 얼마나 오래갈까?

[^91]: Yao, Deborah. 구글, 메타와 미스트랄에 대항할 오픈소스 모델 공개. (2024년 2월 21일)

[^92]: Kamila, Manoj Kumar. 인공지능 개발의 윤리적 문제: 위험 인식. (2023-01-01)

[^93]: Piper, Kelsey. 가장 강력한 AI 모델을 모두에게 오픈소스로 공개해야 하는가?. (2024-02-02)

[^94]: Vincent, James. OpenAI 공동 창립자, 연구 공개에 대한 과거 접근 방식에 대해: "우리가 틀렸다". (2023-03-15)

[^95]: 스택 오버플로, AI 대기업에 훈련 데이터 사용료 부과 예정. (2023년 4월 28일)

[^96]: 오픈소스 개발자들, AI 크롤러가 트래픽을 지배하면서 국가 전체를 차단할 수밖에 없다고 밝혀. (2025년 3월 25일)

[^97]: AI 봇이 위키미디어에 부담을 주며 대역폭 50% 급증. (2025년 4월 2일)

[^98]: von Eschenbach, Warren J.. 투명성과 블랙박스 문제: 우리가 AI를 신뢰하지 않는 이유. (2021-12-01)

[^99]: Lund, Brady. 인공지능(AI) 투명성을 위한 표준, 프레임워크 및 입법. (2025-01-29)

[^101]: AI 해석 가능성이란 무엇인가? {{!. (2024-10-08)

[^102]: Li, Fan. 윤리와 AI: 의료에서 AI를 활용한 설계의 윤리적 우려와 관련 전략에 대한 체계적 문헌 고찰. (2022-12-31)

[^103]: Shabankareh, Mohammadjavad. 의료 응용에서 AI 추천에 대한 신뢰에 미치는 AI 인지 투명성의 영향. (2025-01-01)

[^104]: Xu, Hanhui. 의료 인공지능과 블랙박스 문제: "해를 끼치지 말라"는 윤리 원칙에 기반한 관점. (2024-02-01)

[^105]: Howard, Ayanna. AI 규제 – 조직이 걱정해야 하는가? {{!. (2019년 7월 29일)

[^106]: 인공지능에 대한 신뢰 – 5개국 연구. (2021년 3월)

[^107]: UN 인공지능 정상회의, 빈곤 및 인류의 '거대한 과제' 해결 목표. (2017-06-07)

[^108]: 인공지능 – 경제협력개발기구

[^109]: Anonymous. 유럽 AI 동맹. (2018-06-14)

[^110]: 유럽위원회 AI 고위전문가그룹. 신뢰할 수 있는 인공지능을 위한 정책 및 투자 권고. (2019-06-26)

[^111]: Fukuda-Parr, Sakiko. '윤리적 AI'에 대한 새로운 합의: 이해관계자 가이드라인에 대한 인권적 비판. (2021년 7월)

[^112]: EU 기술 정책 브리프: 2019년 7월 요약. (2019년 8월 2일)

[^113]: Curtis, Caitlin. AI를 배포하는 조직이 AI 위험의 '퍼펙트 스톰'에 대처하는 핵심이다. (2022-05-24)

[^114]: Challen, Robert. 인공지능, 편향, 임상 안전. (2019년 3월)

[^115]: Birch, Jonathan. 동물 감각과 예방 원칙. (2017-01-01)

[^116]: Macrae, Carl. 자율 및 지능형 시스템의 실패로부터 배우기: 사고, 안전, 위험의 사회기술적 원천. (2022년 9월)

[^117]: Chalmers, David. 대규모 언어 모델은 의식을 가질 수 있는가?. (2023년 3월)

[^118]: Edwards, Benj. 앤트로픽, 최초의 'AI 복지' 연구원 고용. (2024-11-11)

[^119]: Wiggers, Kyle. 앤트로픽, AI '모델 복지' 연구를 위한 새 프로그램 출범. (2025-04-24)

[^120]: Shulman, Carl. 디지털 마인드와 세상 공유하기. (2021년 8월)

[^121]: Fisher, Richard. 당신이 자신을 먹도록 허락해야 하는 지적인 괴물. BBC News. (2020년 11월 13일)

[^122]: Davies, Alex. 구글의 자율주행차, 첫 번째 충돌 사고를 일으키다. (2016년 2월 29일)

[^123]: Levin, Sam. 자율주행 우버, 보행자 관련 최초의 치명적 사고로 애리조나 여성 사망. (2018년 3월 19일)

[^124]: 자율주행차가 사고를 냈을 때 누가 책임지는가?. (2018년 1월 30일)

[^125]: 자율주행차 사고: 누가 — 혹은 무엇이 — 책임져야 하는가?. Radio Business North America 팟캐스트

[^126]: Delbridge, Emily. 폭주하는 무인 자동차

[^127]: Stilgoe, Jack. 누가 일레인 허츠버그를 죽였는가?. Springer International Publishing. (2020)

[^128]: Maxmen, Amy. 자율주행차 딜레마, 도덕적 선택이 보편적이지 않음을 보여주다. (2018년 10월)

[^129]: 무인 자동차 규제

[^130]: 자율주행: 입법 및 규제 조치 – CyberWiki

[^131]: 자율주행 차량 {{!

[^132]: Etzioni, Amitai. 인공지능에 윤리를 통합하기. (2017-12-01)

[^135]: 미국 국방혁신위원회. AI 원칙: 국방부의 윤리적 인공지능 사용에 관한 권고

[^136]: Umbrello, Steven. 전쟁의 미래: 치명적 자율무기 시스템이 분쟁을 더 윤리적으로 만들 수 있는가?. (2020년 3월)

[^137]: Jamison, Miles. DARPA, 자율 시스템을 위한 윤리 프로그램 출범. (2024-12-20)

[^138]: DARPA의 ASIMOV, 자율 시스템을 위한 윤리 표준 개발 추진

[^139]: Hellström, Thomas. 군사 로봇의 도덕적 책임에 관하여. (2013년 6월)

[^140]: Mitra, Ambarish. 우리는 AI를 훈련시켜 선과 악을 식별하게 한 다음, 이를 도덕 교육에 활용할 수 있다. (2018년 4월 5일)

[^141]: Dominguez, Gabriel. 한국, 전투기 지원을 위한 새로운 스텔스 드론 개발 중. (2022년 8월 23일)

[^142]: AI 원칙. (2017년 8월 11일)

[^143]: 머스크, 호킹, 인공지능 무기에 대해 경고. (2015-07-27)

[^144]: 고도화된 인공지능의 잠재적 위험. (2015년 8월 11일)

[^145]: Bostrom, Nick. 초지능: 경로, 위험, 전략. Oxford University Press. (2017)

[^146]: Umbrello, Steven. 미래 나노기술 평가: 원자 수준 정밀 제조의 순사회적 영향. (2018-06-01)

[^148]: Russell, Stuart. 휴먼 컴패터블: 인공지능과 통제의 문제. Viking. (2019년 10월 8일)

[^149]: Yampolskiy, Roman V.. AI의 예측 불가능성: 더 똑똑한 에이전트의 모든 행동을 정확히 예측하는 것의 불가능성에 관하여. (2020-03-01)

[^150]: Wallach, Wendell. 도덕적 기계: 가치 정렬에서 체화된 덕까지. Oxford University Press. (2020-09-17)

[^151]: Umbrello, Steven. 가치 민감 설계 접근법을 통한 유익한 인공지능 조율. (2019)

[^152]: Floridi, Luciano. 사회적 선을 위한 AI 설계 방법: 일곱 가지 필수 요소. (2020)

[^153]: Llama Guard: 인간-AI 대화를 위한 LLM 기반 입출력 안전장치

[^154]: Nvidia NeMo 가드레일

[^155]: Inan, Hakan. Llama Guard: 인간-AI 대화를 위한 LLM 기반 입출력 안전장치

[^156]: Dong, Yi. 대규모 언어 모델을 위한 가드레일 구축

[^157]: Evans, Woody. 포스트휴먼 권리: 트랜스휴먼 세계의 차원들

[^158]: Fiegerman, Seth. 페이스북, 구글, 아마존, AI 우려를 완화하기 위한 단체 결성. (2016년 9월 28일)

[^159]: Slota, Stephen C.. 인공지능 윤리의 작업 현장 찾기. (2023)

[^160]: 신뢰할 수 있는 AI를 위한 윤리 지침. 유럽위원회. (2019-04-08)

[^161]: 인공지능에 관한 백서 – 탁월함과 신뢰에 대한 유럽적 접근 | 유럽의 디지털 미래 형성. (2020년 2월 19일)

[^162]: 시행 일정 {{!

[^163]: OECD AI 정책 관측소

[^164]: 인공지능 윤리에 관한 권고. UNESCO

[^165]: UNESCO 회원국, AI 윤리에 관한 최초의 글로벌 합의 채택. (2021-11-26)

[^166]: 오바마 행정부의 AI 정책 로드맵. (2016-12-21)

[^167]: 미국의 인공지능 리더십 가속화 – 백악관

[^168]: 행정 부처 및 기관장에 대한 각서 초안에 대한 의견 요청, "인공지능 응용 규제를 위한 지침". (2020-01-13)

[^169]: Sen. Thune, John. 법안 – S.3312 – 제118대 의회 (2023–2024): 2024년 인공지능 연구, 혁신 및 책임법. (2024-12-18)

[^170]: CCC, 20개년 AI 로드맵 초안 제시; 의견 수렴 중. (2019-05-14)

[^171]: 초안에 대한 의견 요청: 미국 AI 연구를 위한 20개년 커뮤니티 로드맵 » CCC 블로그. (2019년 5월 13일)

[^173]: Grace, Katja. AI는 언제 인간의 성능을 넘어설 것인가? AI 전문가들의 증거. (2018-05-03)

[^174]: 중국, 인공지능의 글로벌 미래를 형성하고자 하다

[^175]: Adam, David. 인류미래연구소 폐쇄: '먼 미래' 연구의 다음은?. (2024-04-26)

[^176]: Floridi, Luciano. AI4People—좋은 AI 사회를 위한 윤리적 프레임워크: 기회, 위험, 원칙 및 권고. (2018-12-01)

[^177]: AI 거버넌스

[^178]: Joanna J. Bryson

[^179]: 새로운 인공지능 연구소 출범. (2017-11-20)

[^180]: 기계 시대에서 살아남기: 지능형 기술과 인간 노동의 변환. Palgrave Macmillan Cham. (2017년 3월 15일)

[^181]: Danaher, John. 자동화와 유토피아: 노동 없는 세상에서의 인간 번영. Harvard University Press

[^182]: TUM 인공지능 윤리 연구소 공식 개소

[^183]: Communications, Paul Karoff SEAS. 하버드, 컴퓨터 과학 교육과정에 윤리 통합 추진. (2019-01-25)

[^184]: Lee, Jennifer. 편향이 기술에 코딩될 때. (2020-02-08)

[^185]: 한 컨퍼런스가 다양성을 수용한 방법. (2018-12-12)

[^186]: Roose, Kevin. 2020 굿테크 어워드. (2020-12-30)

[^187]: Lodge, Paul. 라이프니츠의 기계적 유물론에 대한 방앗간 논증 재고. (2014)

[^188]: Bringsjord, Selmer. 인공지능. 형이상학 연구소, 스탠퍼드 대학교. (2020)

[^189]: Kulesz, O. (2018). "[https://unesdoc.unesco.org/ark:/48223/pf0000380584 문화, 플랫폼, 그리고 기계]". UNESCO, 파리.

[^190]: Jr, Henry C. Lucas. 정보 기술과 생산성 역설: IT 투자의 가치 평가. Oxford University Press. (1999-04-29)

[^191]: Yudkowsky, Eliezer. 왜 우리에게 우호적 AI가 필요한가. (2004년 7월)

[^192]: Aleksander, Igor. 인간의 파트너: 가까운 미래 로봇의 역할에 대한 현실적 평가. (2017년 3월)

[^194]: Velasco, Guille. 과학 소설: 인류 미래를 비추는 거울. (2020-05-04)

[^195]: 러브, 데스 + 로봇 시즌 2, 에피소드 1 요약 – "자동 고객 서비스". (2021-05-14)

[^196]: AI 내러티브: 지능형 기계에 대한 상상적 사고의 역사. Oxford University Press. (2020년 2월 14일)

[^197]: Cerqui, Daniela. 인류 재설계: 사이보그의 부상, 바람직한 목표인가?. Springer Netherlands. (2008)

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

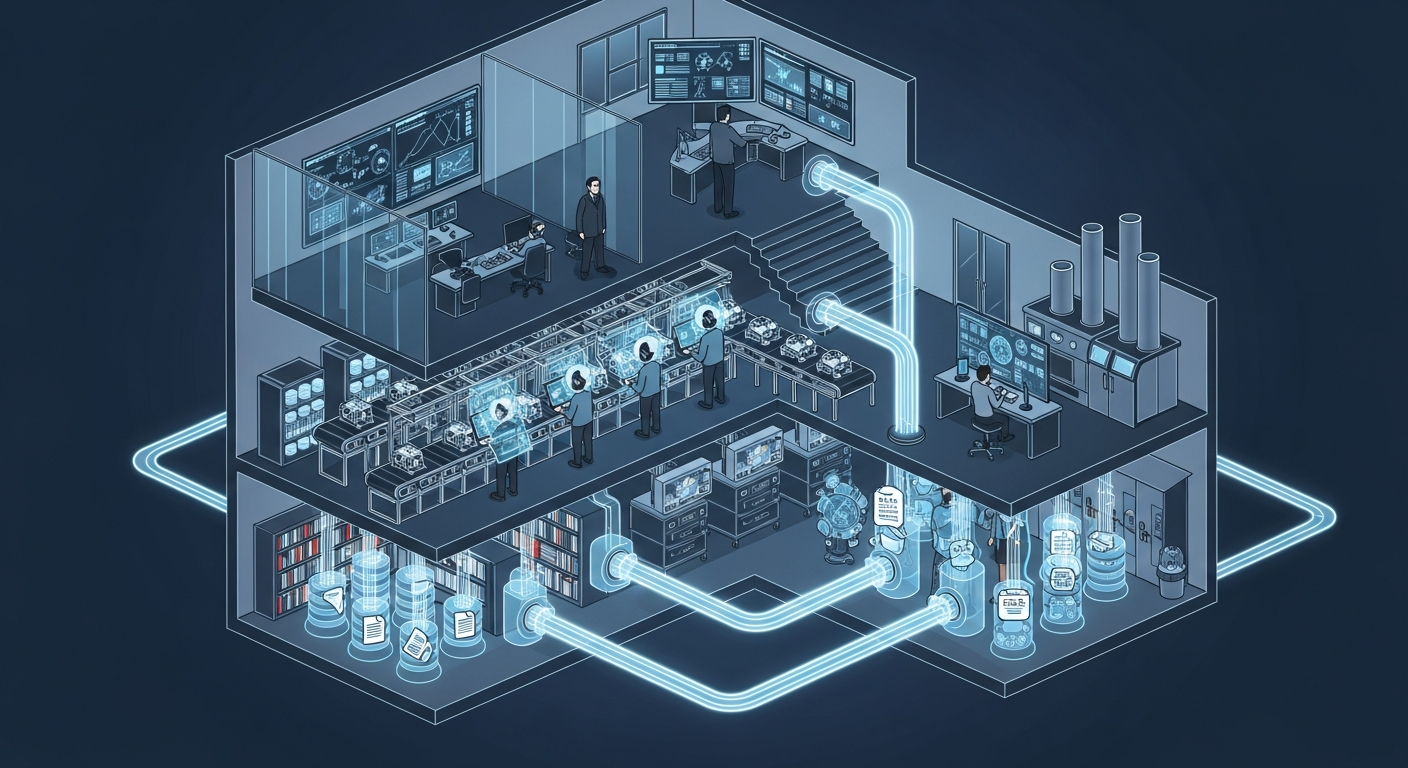

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.