헤브 이론

헤브 이론은 시냅스 효능의 증가가 시냅스전 세포의 시냅스후 세포에 대한 반복적이고 지속적인 자극으로부터 발생한다고 주장하는 신경심리학 이론이다. 이는 학습 과정에서 뉴런의 적응, 즉 시냅스 가소성을 설명하려는 시도이다. 헤브 이론은 도널드 헤브가 1949년 저서 행동의 조직화에서 소개하였다. 이 이론은 헤브의 규칙, 헤브의 법칙, 헤브의 가설, 세포 집합체 이론이라고도 불린다. 헤브는 이를 다음과 같이 기술하였다:

반향 활동(또는 "흔적")의 지속 또는 반복이 그 안정성을 높이는 지속적인 세포 변화를 유도하는 경향이 있다고 가정하자. ... 세포 A의 축삭이 세포 B를 흥분시킬 만큼 충분히 가까이 있고, 반복적으로 또는 지속적으로 그 발화에 관여할 때, 하나 또는 두 세포 모두에서 어떤 성장 과정이나 대사 변화가 일어나 세포 B를 발화시키는 세포들 중 하나로서 A의 효율이 증가한다.

이 이론은 흔히 "** 함께 발화하는 뉴런은 함께 연결된다**"로 요약된다.[^7] 그러나 헤브는 세포 A가 세포 B의 "발화에 관여"해야 한다고 강조했으며, 이러한 인과관계는 세포 A가 세포 B와 동시에가 아니라 직전에 발화할 때만 발생할 수 있다. 헤브의 연구에서 나타난 이러한 인과성의 측면은 시간적 선행을 필요로 하는 스파이크 타이밍 의존 가소성에 대해 현재 알려진 바를 예견한 것이었다.[^1]

헤브 이론은 연합 학습 또는 헤브 학습을 설명하고자 하며, 이는 세포들의 동시 활성화가 해당 세포들 간의 시냅스 강도를 현저히 증가시키는 것을 말한다. 또한 교육 및 기억 재활을 위한 무오류 학습 방법의 생물학적 기반을 제공한다. 인지 기능에서의 신경망 연구에서, 이는 흔히 비지도 학습의 신경적 기반으로 간주된다.[^8]

엔그램, 세포 집합체 이론, 그리고 학습

헵 이론은 뉴런들이 어떻게 연결되어 엔그램을 형성할 수 있는지에 대한 설명을 제공하며, 이러한 엔그램은 특정 정보를 부호화하는 뉴런 그룹인 중첩된 세포 집합체에 저장될 수 있다.[^9] 본래 특정 피질 뉴런 그룹에서의 반복적 활동을 설명하기 위한 방법으로 만들어진 헵의 세포 집합체의 형태와 기능에 관한 이론은 다음과 같이 이해할 수 있다:

일반적인 개념은 오래된 것으로, 동시에 반복적으로 활성화되는 두 세포 또는 세포 체계는 '연합'되는 경향이 있어 하나의 활동이 다른 하나의 활동을 촉진하게 된다는 것이다.

헵은 또한 다음과 같이 썼다:

하나의 세포가 다른 세포의 발화를 반복적으로 도울 때, 첫 번째 세포의 축삭은 두 번째 세포의 세포체와 접촉하는 시냅스 종말단추를 발달시키거나 (이미 존재하는 경우) 이를 확대시킨다.

D. Alan Allport는 자동 연합, 즉 부분적 단서를 기반으로 정보를 검색하는 뇌의 능력이라는 개념을 사용하여 세포 집합체 이론과 엔그램 형성에서의 역할에 관한 추가적인 아이디어를 제시하며, 다음과 같이 설명한다:

시스템에 대한 입력이 동일한 활동 패턴을 반복적으로 발생시키면, 그 패턴을 구성하는 활성 요소들의 집합은 점점 더 강하게 상호 연합된다. 즉, 각 요소는 다른 모든 요소를 활성화시키는 경향이 있으며 (음의 가중치를 통해) 패턴의 일부가 아닌 요소들을 비활성화시키는 경향이 있다. 다시 말해, 패턴 전체가 '자동 연합'된다. 학습된(자동 연합된) 패턴을 엔그램이라고 부를 수 있다.[^10]

노벨상 수상자 Eric Kandel의 연구실에서 수행된 연구는 해양 복족류 Aplysia californica의 시냅스에서 헵 학습 메커니즘의 역할을 뒷받침하는 증거를 제공했다.[^11] 해양 무척추동물의 말초 신경계에 있는 시냅스는 실험에서 통제하기가 훨씬 용이하기 때문에, Kandel의 연구는 헵의 장기 강화와 활동 의존적 시냅스 전 촉진이 Aplysia californica에서의 시냅스 가소성과 고전적 조건형성 모두에 필요하다는 것을 발견했다.[^12]

무척추동물에 대한 연구가 학습과 기억의 기본 메커니즘을 확립한 반면, 척추동물 뉴런 간의 오래 지속되는 시냅스 변화에 관한 연구의 상당 부분은 비생리학적 실험 자극을 뇌세포에 사용하는 것을 포함한다. 그러나 척추동물의 뇌에서 연구된 생리학적으로 관련 있는 시냅스 변형 메커니즘 중 일부는 헵 과정의 사례로 보인다. 한 리뷰에 따르면, 시냅스 강도의 오래 지속되는 변화는 헵 메커니즘과 비헵 메커니즘 모두를 사용하는 생리학적으로 관련 있는 시냅스 활동에 의해 유도될 수 있다.[^13]

원리

인공 뉴런과 인공 신경망에서 헵의 원리는 모델 뉴런 간의 가중치를 어떻게 변경할지 결정하는 방법으로 설명할 수 있다. 두 뉴런이 동시에 활성화되면 두 뉴런 사이의 가중치가 증가하고, 별도로 활성화되면 감소한다. 동시에 양의 값이거나 동시에 음의 값인 경향이 있는 노드들은 강한 양의 가중치를 가지며, 반대 경향을 보이는 노드들은 강한 음의 가중치를 가진다.

다음은 헵 학습의 공식적 설명이다(다른 많은 설명도 가능하다):

,w_{ij}=x_ix_j,

여기서 w_{ij} 는 뉴런 j 에서 뉴런 i 로의 연결 가중치이고, x_i 는 뉴런 i 의 입력이다. 이것은 패턴 학습의 한 예로, 매 훈련 예제마다 가중치가 갱신된다. 홉필드 네트워크에서는 i=j 일 때 연결 w_{ij} 를 0으로 설정한다(자기 자신으로의 연결은 허용되지 않음). 이진 뉴런(활성화 값이 0 또는 1)의 경우, 연결된 뉴런들이 특정 패턴에 대해 동일한 활성화 값을 가지면 연결이 1로 설정된다.

여러 훈련 패턴이 사용될 경우, 수식은 개별 값들의 평균이 된다:

w_{ij} = \frac{1}{p} \sum_{k=1}^p x_i^k x_j^k,

여기서 w_{ij} 는 뉴런 j 에서 뉴런 i 로의 연결 가중치이고, p 는 훈련 패턴의 수이며, x_{i}^k는 뉴런 i 의 k 번째 입력이다. 이것은 에포크 단위 학습으로, 모든 훈련 예제가 제시된 후에 가중치가 갱신되며, 마지막 항은 이산 및 연속 훈련 집합 모두에 적용할 수 있다. 마찬가지로, 홉필드 네트워크에서는 i=j 일 때 연결 w_{ij} 를 0으로 설정한다(자기 자신으로의 연결 없음).

차단 현상 및 기타 신경 학습 현상을 고려한 헵 학습의 변형은 해리 클로프의 수학적 모델이다. 클로프의 모델은 단순한 적응 메커니즘을 가진 시스템의 부분들이 신경망과 같은 더 고급 적응 행동을 가진 더 복잡한 시스템의 기반이 될 수 있다고 가정한다.[^14]

비지도 학습, 안정성, 일반화와의 관계

헤브 학습의 단순한 특성상, 시냅스 전후 활동의 동시 발생에만 기반하기 때문에, 이러한 형태의 가소성이 왜 의미 있는 학습으로 이어지는지 직관적으로 명확하지 않을 수 있다. 그러나 헤브 가소성이 비지도 학습으로 분류될 수 있는 방식으로 입력의 통계적 특성을 포착한다는 것을 보일 수 있다.

이는 단순화된 예제에서 수학적으로 보일 수 있다. 발화율 y(t)를 가지는 단일 발화율 기반 뉴런이 있고, 그 입력의 발화율이 x_1(t) ... x_N(t)인 단순화된 가정 하에서 작업하자. 뉴런의 반응 y(t)는 보통 입력의 선형 결합 \sum_i w_ix_i에 반응 함수 f를 적용한 것으로 기술된다: y = f\left(\sum_{i=1}^N w_i x_i \right). 이전 절에서 정의한 바와 같이, 헤브 가소성은 시냅스 가중치 w의 시간에 따른 변화를 기술한다: \frac{dw_i}{dt} = \eta x_i y. 단순화를 위해 항등 반응 함수 f(a)=a를 가정하면, 다음과 같이 쓸 수 있다: \frac{dw_i}{dt} = \eta x_i \sum_{j=1}^N w_j x_j 또는 행렬 형태로: \frac{d\mathbf{w}}{dt} = \eta \mathbf{x}\mathbf{x}^T\mathbf{w}. 이전 장에서와 같이, 에포크 단위로 훈련할 경우 \mathbf{x}의 이산 또는 연속(시간) 훈련 집합에 대한 평균 \langle \dots \rangle을 취할 수 있다:\frac{d\mathbf{w}}{dt} = \langle \eta \mathbf{x}\mathbf{x}^T\mathbf{w} \rangle = \eta \langle \mathbf{x}\mathbf{x}^T\rangle\mathbf{w} = \eta C \mathbf{w}.여기서 C = \langle, \mathbf{x}\mathbf{x}^T \rangle는 \langle\mathbf{x}\rangle = 0(즉, 입력의 평균이 0)이라는 추가 가정 하에서의 입력의 상관 행렬이다. 이것은 N개의 연립 선형 미분 방정식이다. C는 대칭이므로 대각화 가능하며, 그 고유벡터 기저에서 작업하면 해가 다음과 같은 형태임을 알 수 있다: \mathbf{w}(t) = k_1e^{\eta\alpha_1 t}\mathbf{c}_1 + k_2e^{\eta\alpha_2 t}\mathbf{c}_2 + ... + k_Ne^{\eta\alpha_N t}\mathbf{c}_N 여기서 k_i는 임의의 상수이고, \mathbf{c}_i는 C의 고유벡터이며, \alpha_i는 대응하는 고유값이다. 상관 행렬은 항상 양의 정부호 행렬이므로 고유값은 모두 양수이며, 위 해가 시간에 대해 항상 지수적으로 발산함을 쉽게 알 수 있다. 이것은 이 버전의 헤브 규칙이 불안정하기 때문에 발생하는 본질적인 문제로, 지배적인 신호가 있는 어떤 네트워크에서든 시냅스 가중치가 지수적으로 증가하거나 감소한다. 직관적으로 이는 시냅스 전 뉴런이 시냅스 후 뉴런을 흥분시킬 때마다 둘 사이의 가중치가 강화되어 미래에 더 강한 흥분을 유발하고, 이것이 자기 강화적으로 반복되기 때문이다. 시냅스 후 뉴런의 발화율을 비선형적이고 포화하는 반응 함수 f를 추가하여 제한하는 것이 해결책이라고 생각할 수 있지만, 실제로 어떤 뉴런 모델에서든 헤브 규칙은 불안정함을 보일 수 있다.[^15] 따라서 뉴런의 네트워크 모델은 보통 BCM 이론, 오야의 규칙,[^16] 또는 일반화 헤브 알고리즘과 같은 다른 학습 이론을 사용한다.

그럼에도 불구하고, 위의 불안정한 해에서도 충분한 시간이 지나면 하나의 항이 다른 항들을 지배하게 되어 다음과 같이 됨을 알 수 있다: \mathbf{w}(t) \approx e^{\eta\alpha^* t}\mathbf{c}^ 여기서 \alpha^는 C의 최대 고유값이다. 이 시점에서 시냅스 후 뉴런은 다음 연산을 수행한다: y \approx e^{\eta\alpha^* t}\mathbf{c}^* \mathbf{x} 다시 말해, \mathbf{c}^*는 x_i들 사이의 상관 행렬의 최대 고유값에 대응하는 고유벡터이므로, 이는 정확히 입력의 제1주성분을 계산하는 것에 해당한다.

이 메커니즘은 시냅스 후 뉴런을 추가하여 입력의 완전한 PCA(주성분 분석)를 수행하도록 확장할 수 있으며, 이때 시냅스 후 뉴런들이 모두 같은 주성분을 포착하지 않도록 방지해야 한다. 예를 들어 시냅스 후 층에 측면 억제를 추가하는 방법이 있다. 이로써 우리는 헤브 학습을 PCA와 연결하였으며, 이는 네트워크가 입력의 유용한 통계적 측면을 포착하고 이를 출력에서 압축된 방식으로 "기술"할 수 있다는 점에서 비지도 학습의 기본적인 형태이다.[^4]

헤브 학습과 거울 뉴런

헤브 학습과 스파이크 타이밍 의존적 가소성은 거울 뉴런이 어떻게 출현하는지에 대한 영향력 있는 이론에 활용되어 왔다.[^17][^2] 거울 뉴런은 개인이 행동을 수행할 때와 다른 사람이 유사한 행동을 수행하는 것을 보거나 들을 때 모두 발화하는 뉴런이다.[^18][^19] 이 뉴런의 발견은 개인이 타인의 행동을 어떻게 이해하는지를 설명하는 데 매우 큰 영향을 미쳤는데, 이는 한 사람이 타인의 행동을 지각할 때 유사한 행동을 수행하는 데 사용할 뇌의 운동 프로그램이 활성화되어 지각에 정보를 추가하고, 지각자 자신의 운동 프로그램을 기반으로 그 사람이 다음에 무엇을 할지 예측하는 데 도움을 주기 때문이다. 거울 뉴런 기능에 대한 이 개념의 한 가지 한계는, 행동을 수행할 때와 다른 사람이 유사한 행동을 수행하는 것을 보거나 들을 때 모두 반응하는 뉴런이 개인에게서 어떻게 발달하는지를 설명하는 것이다.

신경과학자 Christian Keysers와 심리학자 David Perrett는 개인이 행동을 수행하는 것을 관찰하거나 듣는 것이 마치 자신이 그 행동을 수행하는 것처럼 뇌 영역을 활성화시킨다고 제안했다.[^2][^20] 이러한 재구심성 감각 신호는 행동의 시각, 청각, 촉각에 반응하는 뉴런의 활동을 촉발한다. 이 감각 뉴런의 활동이 행동을 유발한 운동 뉴런의 활동과 시간적으로 지속적으로 겹치기 때문에, 헤브 학습은 행동의 시각, 청각, 촉각에 반응하는 뉴런과 행동을 촉발하는 뉴런을 연결하는 시냅스가 강화될 것이라고 예측한다. 사람들이 거울에 비친 자신을 볼 때, 자신의 옹알이를 들을 때, 또는 다른 사람이 자신을 모방할 때도 마찬가지이다. 이러한 재구심성의 반복적인 발생 후, 행동의 감각 표상과 운동 표상을 연결하는 시냅스가 매우 강해져서 운동 뉴런이 행동의 소리나 시각에 의해 발화하기 시작하며, 거울 뉴런이 형성된다.[^21]

수많은 실험이 헤브 학습이 거울 뉴런 형성에 핵심적이라는 개념에 대한 증거를 제공한다. 증거에 따르면 자극과 운동 프로그램의 실행이 반복적으로 짝지어진 후에는 새로운 청각 또는 시각 자극에 의해 운동 프로그램이 촉발될 수 있다.[^3] 예를 들어, 피아노를 한 번도 연주한 적이 없는 사람은 피아노 음악을 들을 때 피아노 연주와 관련된 뇌 영역을 활성화시키지 않는다. 참가자가 건반을 누를 때마다 피아노 소리에 노출되는 5시간의 피아노 레슨은, 나중에 피아노 음악을 들을 때 뇌의 운동 영역에서 활동을 촉발하기에 충분한 것으로 입증되었다.[^3] 스파이크 타이밍 의존적 가소성이 시냅스전 뉴런의 발화가 시냅스후 뉴런의 발화를 예측하는 경우에만 발생한다는 사실과 일치하게,[^22] 감각 자극과 운동 프로그램 간의 연결도 자극이 운동 프로그램에 수반되는 경우에만 강화되는 것으로 보인다.

헤브 이론과 인지 신경과학

헤브 학습은 의사결정 및 사회적 학습과 같은 인지 과정과 연결되어 있다. 인지 신경과학 분야는 보상 처리와 사회적 인지를 담당하는 뇌 영역, 예를 들어 선조체와 전두엽 피질에서 헤브 이론과의 교차점을 탐구하기 시작했다.[^23][^24] 특히, 헤브 모델에 노출된 선조체 투사는 생체 내에서 장기 강화와 장기 억압을 나타낸다.[^25] 또한, 자극에 대한 전두엽 피질의 모델("혼합 선택성")은 무작위 연결성으로는 완전히 설명되지 않지만, 헤브 패러다임을 통합하면 모델에서 혼합 선택성의 수준에 도달한다.[^26] 이러한 영역에서의 헤브 가소성이 습관 형성, 강화 학습, 나아가 사회적 유대의 발달과 같은 행동의 기초가 될 수 있다는 가설이 제시되었다(예: Peter Putnam과 Robert W. Fuller에 의해).

한계

장기 강화에 대한 헤브 모델의 일반적인 사용에도 불구하고, 헤브 이론은 모든 형태의 장기 시냅스 가소성을 다루지는 않는다. 헤브는 억제성 시냅스에 대한 규칙이나 반인과적 스파이크 시퀀스(시냅스전 뉴런이 시냅스후 뉴런 이후에 발화하는 경우)에 대한 예측을 제안하지 않았다. 시냅스 변형은 단순히 활성화된 뉴런 A와 B 사이에서만 일어나는 것이 아니라, 인접한 시냅스에서도 발생할 수 있다.[^27] 따라서, 모든 형태의 이종시냅스 가소성과 항상성 가소성은 비헤브적인 것으로 간주된다. 한 가지 예는 시냅스전 말단으로의 역행 신호 전달이다.[^28] 역행 전달물질로 가장 흔히 인정되는 화합물은 산화질소로, 높은 용해성과 확산성으로 인해 종종 인접 뉴런에 영향을 미친다.[^29] 체적 학습으로 알려진 이러한 유형의 확산 시냅스 변형은 전통적인 헤브 모델에 포함되지 않는다.[^30]

현대적 발전, 인공지능, 그리고 컴퓨터 과학의 진보

현대 연구는 헵의 원래 아이디어를 확장해 왔다. 예를 들어, 스파이크 타이밍 의존 가소성(STDP)은 뉴런 스파이크의 정확한 타이밍을 헵 이론에 통합함으로써 헵 원리를 정교화한다. 실험적 발전은 또한 헵 학습을 의사결정 및 감정 조절과 같은 복잡한 행동과 연결시켰다.[^4] 인공지능(AI)과 양자 컴퓨팅에 관한 현재 연구들은 적응형 알고리즘 개발과 기계 학습 모델 개선을 위해 헵 개념을 계속 활용하고 있다.[^31]

AI 분야에서 헵 학습은 전통적인 신경망을 넘어선 응용을 보여 왔다. 중요한 발전 중 하나는 강화 학습 알고리즘으로, 훈련 단계에서 자극의 타이밍과 강도에 기반하여 가중치를 갱신하는 데 헵과 유사한 학습이 사용된다. 일부 연구자들은 인공 시스템에서의 학습을 위해 생물학적으로 더 타당한 모델을 개발하기 위해 헵 원리를 적용하였으며, 이는 AI 응용에서 모델의 효율성과 수렴성을 향상시킬 수 있다.[^32][^33]

양자 컴퓨팅에서의 헵 학습 적용은 점점 더 관심을 받는 분야이다. 고전적 신경망이 헵 이론의 주요 적용 분야이지만, 최근 연구들은 양자에서 영감을 받은 알고리즘의 잠재력을 탐구하기 시작했다. 이러한 알고리즘은 양자 중첩과 얽힘의 원리를 활용하여 양자 시스템에서의 학습 과정을 향상시킨다.[^34] 현재 연구는 헵 원리가 더 효율적인 양자 기계 학습 모델의 개발에 어떻게 기여할 수 있는지 탐구하고 있다.[^1]

헵 학습을 정교화하거나 확장하는 새로운 계산 모델들이 등장하였다. 예를 들어, 일부 모델은 현재 신경 스파이크의 정확한 타이밍(스파이크 타이밍 의존 가소성에서와 같이)을 고려하며, 다른 모델은 도파민과 같은 신경전달물질이 시냅스 연결의 강도에 미치는 영향을 설명하기 위해 신경조절의 측면을 통합하였다. 이러한 발전된 모델은 헵 학습이 뇌에서 어떻게 작동하는지에 대한 더 정밀한 이해를 제공하며, 더 현실적인 계산 모델의 개발에 기여하고 있다.[^35][^36]

헵 학습에 대한 최근 연구는 전통적인 헵 모델에서 종종 간과되었던 억제 뉴런의 역할에 초점을 맞추고 있다. 고전적 헵 이론은 주로 흥분성 뉴런에 초점을 두지만, 신경 학습에 대한 보다 포괄적인 모델은 이제 흥분성 시냅스와 억제성 시냅스 간의 균형 잡힌 상호작용을 고려한다. 연구에 따르면 억제 뉴런은 신경 회로의 안정성을 유지하는 데 중요한 조절 기능을 제공할 수 있으며, 헵 학습에서의 폭주하는 양성 피드백을 방지할 수 있다.[^37][^38]

2017년에 제프 매기와 동료들은 행동 시간 척도 시냅스 가소성(BTSP)을 발견하였는데, 이는 해마 CA1 뉴런에서의 학습 형태로, 수상돌기 고원 전위 전후 수 초 동안 활성화된 시냅스 입력이 동시적 시냅스 후 스파이킹 없이도 강화되는 현상이다.[^5] 이 메커니즘은 전통적인 헵 학습이나 스파이크 타이밍 의존 가소성보다 훨씬 긴 시간 척도에서 작동하며, 행동 중 시간적으로 분리된 사건들을 연결하는 수단을 제공한다.[^5] BTSP는 헵과 유사한 연합 과정이 행동 시간 척도에서 어떻게 발생할 수 있는지를 이해하기 위한 현대적 틀로 제안되었으며, 시냅스 수정의 시간 창이 고전적 헵 학습에서 설명된 밀리초 범위를 훨씬 넘어 확장될 수 있음을 시사한다.[^6]

같이 보기

- 데일의 원리

- 신경생물학에서의 동시 발생 탐지

- Leabra

- 메타가소성

- 강축 자극

- 시냅스 친화성 가설

- 신경가소성

- 행동주의

- 삼요인 학습

- BCM 이론

추가 읽을거리

-

-

-

-

외부 링크

-

-

-

- 개요

- 헤브 학습 튜토리얼 (제1부: 새로움 필터링, 제2부: PCA)

참고 문헌

[^1]: Caporale, Natalia. 스파이크 타이밍 의존 가소성: 헤브 학습 규칙. (2008)

[^2]: Keysers, C. (2011). ''공감하는 뇌''.

[^3]: 소리의 행동 표상: 새로 습득한 행동을 들을 때의 청각운동 인식 네트워크. (2007)

[^4]: 헤브 모델. Cambridge University Press. (2002)

[^5]: Bittner, K.C.. 행동 시간 척도의 시냅스 가소성이 CA1 장소 세포의 기반이 된다

[^6]: Grienberger, C.. 시냅스 가소성: 형태와 기능

[^7]: Löwel, Siegrid. 상관된 신경 활동에 의한 시각 피질 내재적 수평 연결의 선택. American Association for the Advancement of Science. (1992)

[^8]: Sanger, Terence D.. 단층 선형 순방향 신경망에서의 최적 비지도 학습. (1989-01-01)

[^9]: Sejnowski, Terrence J.. 헤브의 책. (1999-12-01)

[^10]: Allport, D.A.. 실어증의 현재 관점. Churchill Livingstone

[^11]: Castellucci, Vincent. 군소의 아가미 수축 반사에서 습관화와 탈습관화의 신경 메커니즘. (1970-03-27)

[^12]: Antonov, Igor. 군소의 고전적 조건화에서 활동 의존적 전시냅스 촉진과 헤브 LTP가 모두 필요하며 상호작용한다. (2003-01-09)

[^13]: Paulsen, O. 자연적 활동 패턴과 장기 시냅스 가소성. (2000년 4월 1일)

[^14]: Klopf, A. H. (1972). [https://web.archive.org/web/20170212151545/http://www.dtic.mil/dtic/tr/fulltext/u2/742259.pdf 뇌 기능과 적응 시스템—이종항상성 이론]. Technical Report AFCRL-7

[^15]: Euliano, Neil R.. 신경 및 적응 시스템: 시뮬레이션을 통한 기초. Wiley

[^16]: Shouval, Harel. 뇌의 물리학. The University of Texas Health Science Center at Houston. (2005-01-03)

[^17]: 사회적 인지의 해명: 헤브적 관점. (2004)

[^18]: 전운동 피질에서의 행동 인식. (1996)

[^19]: 시청각 거울 뉴런과 행동 인식. (2003)

[^20]: Kohler, Evelyne. 소리를 듣고 행동을 이해하다: 거울 뉴런에서의 행동 표상. (2002-08-02)

[^21]: 행동, 감각 및 정서에 대한 헤브 학습과 예측적 거울 뉴런

[^22]: 공포 조건화와 외측 편도체의 LTP는 동일한 자극 수반성에 민감하다. (2001)

[^23]: Balleine, B. W., & O'Doherty, J. P. (2010). 행동 통제에서의 인간과 설치류의 상동성: 보상과 의사결정의 피질선조체 메커니즘. Neuroscience, 164(1), 131-140.

[^24]: O'Doherty, J. P., et al. (2004). 도구적 조건화에서 복측 및 배측 선조체의 분리 가능한 역할. Science, 304(5668), 452-454.

[^25]: Perrin, Elodie. 선조체 가소성과 학습 사이의 간극을 잇다. (2019-02-01)

[^26]: Lindsay, Grace W.. 무작위 네트워크에서의 헤브 학습이 전두엽 피질의 선택성 특성을 포착한다. (2017-11-08)

[^27]: Horgan, John. 신경 도청. (1994년 5월)

[^28]: Fitzsimonds, Reiko. 시냅스의 발달과 변형에서의 역행성 신호 전달. (1998년 1월)

[^29]: López, P. 생물학적 및 인공 신경망에서의 확산 이웃에 대한 계산적 연구

[^30]: Mitchison, G. 헤브 용적 학습이 피질 지도의 불연속성을 설명할 수 있는가?. (1999년 10월)

[^31]: Bi, G.-Q., & Poo, M.-M. (1998). 배양된 해마 뉴런에서의 시냅스 변형: 스파이크 타이밍, 시냅스 강도 및 시냅스후 세포 유형에 대한 의존성. Journal of Neuroscience, 18(24), 10

[^32]: Oja, E. (1982). 주성분 분석기로서의 단순화된 뉴런 모델. Journal of Mathematical Biology, 15(3), 267–273.

[^33]: Rumelhart, D. E., & McClelland, J. L. (1986). 병렬 분산 처리: 인지의 미시구조 탐구. MIT Press.

[^34]: Huang, H., & Li, Y. (2019). 신경망을 위한 양자 영감 헤브 학습 알고리즘. Journal of Quantum Information Science, 9(2), 111-124.

[^35]: Miller, P., & Conver, A. (2012). 시냅스 가소성과 학습의 계산 모델. Current Opinion in Neurobiology, 22(5), 648-655.

[^36]: Béïque, J. C., & Andrade, R. (2012). 해마에서 시냅스 가소성의 신경조절: 학습과 기억에 대한 시사점. Frontiers in Synaptic Neuroscience, 4, 15.

[^37]: Markram, H., Lübke, J., Frotscher, M., & Sakmann, B. (1997). 시냅스후 활동전위와 흥분성 시냅스후 전위의 동시 발생에 의한 시냅스 효능의 조절. Science, 275(5297), 213–215.

[^38]: Cohen, M. R., & Kohn, A. (2011). 신경 상관의 측정과 해석. Nature Neuroscience, 14(7), 811-819.

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

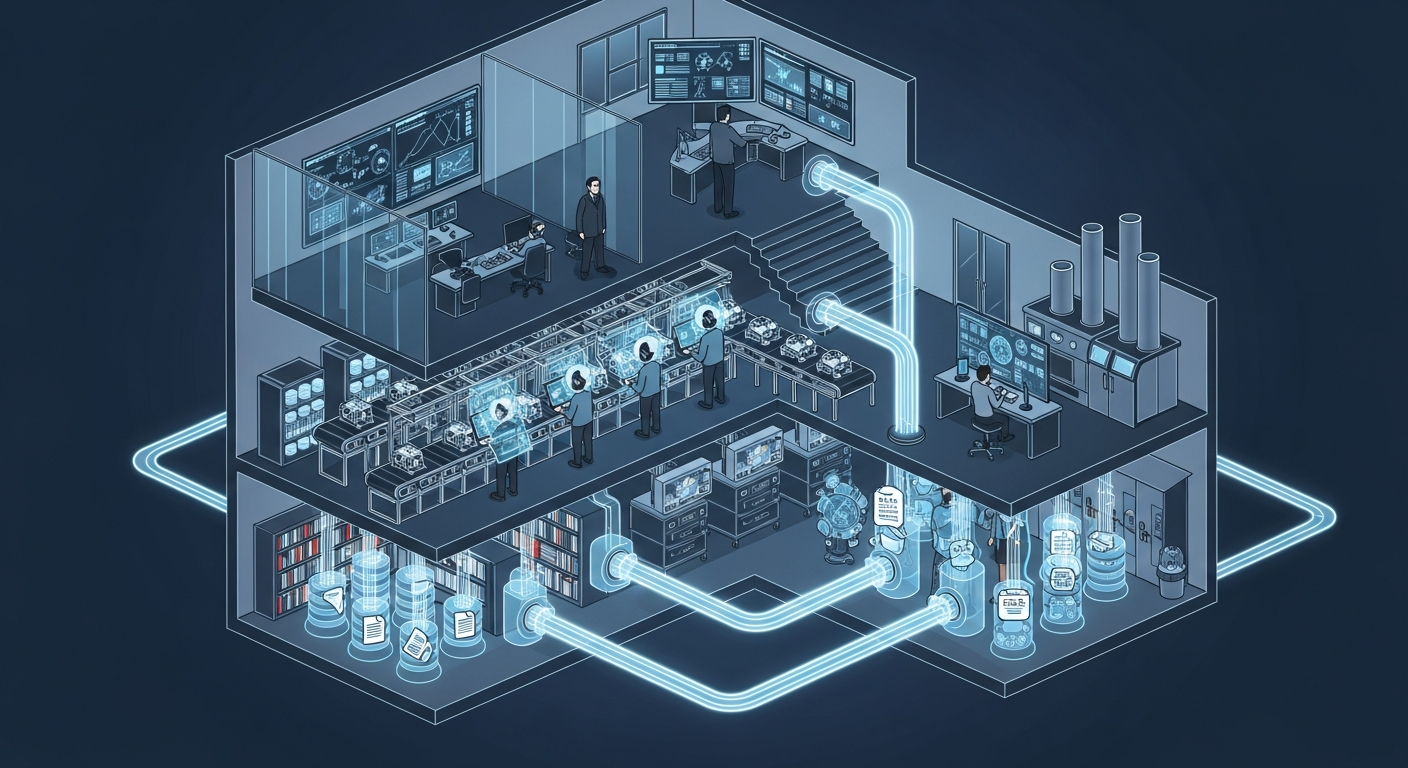

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.