ImageNet

ImageNet 프로젝트는 시각적 객체 인식 소프트웨어 연구에 사용하기 위해 설계된 대규모 시각 데이터베이스이다. 프로젝트를 통해 1,400만 장 이상의 이미지에 어떤 객체가 포함되어 있는지 수작업으로 주석이 달렸으며, 최소 100만 장 이상의 이미지에는 바운딩 박스도 제공된다.^15 ImageNet은 20,000개 이상의 카테고리를 포함하고 있으며, "풍선"이나 "딸기"와 같은 일반적인 카테고리는 수백 장의 이미지로 구성된다.[^1] 제3자 이미지 URL에 대한 주석 데이터베이스는 ImageNet에서 직접 무료로 이용할 수 있지만, 실제 이미지는 ImageNet이 소유하고 있지 않다.[^16] 2010년부터 ImageNet 프로젝트는 소프트웨어 프로그램들이 객체와 장면을 정확하게 분류하고 탐지하는 것을 겨루는 연례 소프트웨어 대회인 ImageNet 대규모 시각 인식 챌린지(ILSVRC)를 개최하고 있다. 이 챌린지는 서로 겹치지 않는 1,000개 클래스의 "축소된" 목록을 사용한다.[^2] 2007년, 리 페이페이는 WordNet의 창시자 중 한 명인 프린스턴 대학교 교수 크리스티안 펠바움을 만나 이 프로젝트에 대해 논의했다. 이 만남의 결과로, 리 페이페이는 WordNet의 약 22,000개 명사를 기반으로 하고 WordNet의 많은 특징을 활용하여 ImageNet을 구축하기 시작했다.[^6] 그녀는 또한 일반인이 대략 30,000종류의 서로 다른 객체를 인식한다는 1987년의 추정치[^17]에서도 영감을 받았다.[^3]

프린스턴 대학교 조교수로 재직하며, 리 페이페이는 ImageNet 프로젝트를 위한 연구팀을 구성했다. 그들은 이미지 분류 작업을 돕기 위해 아마존 메커니컬 터크를 활용했다. 라벨링 작업은 2008년 7월에 시작되어 2010년 4월에 종료되었다. 167개국에서 온 49,000명의 작업자가 1억 6,000만 장 이상의 후보 이미지를 필터링하고 라벨링했다.[^18][^6][^4] 그들은 1,400만 장의 이미지 각각에 세 번씩 라벨을 붙일 수 있는 충분한 예산을 확보했다.[^3]

원래 계획은 40,000개의 카테고리에 각각 10,000장의 이미지, 총 4억 장의 이미지를 확보하고 각각 3회 검증하는 것이었다. 인간이 분류할 수 있는 최대 속도는 초당 2장인 것으로 밝혀졌다. 이 속도로는 (휴식 없이) 19인년의 노동이 필요한 것으로 추정되었다.[^5]

그들은 플로리다에서 열린 2009년 컴퓨터 비전 및 패턴 인식 학회(CVPR)에서 "ImageNet: 대규모 계층적 데이터셋의 미리보기"라는 제목의 포스터로 처음 데이터베이스를 발표했다.[^19][^6][^7][^20] 이 포스터는 2009년 시각 과학 학회에서 재사용되었다.[^21]

2009년, 알렉스 버그는 객체 위치 추정을 과제로 추가할 것을 제안했다. 리 페이페이는 2009년 협업을 위해 PASCAL 시각 객체 클래스 대회에 접근했다. 그 결과 2010년부터 시작된 ImageNet 대규모 시각 인식 챌린지가 탄생했으며, 이 챌린지는 1,000개의 클래스와 객체 위치 추정을 포함하고 있다. 이에 비해 PASCAL VOC는 (2010년 기준) 20개의 클래스와 19,737장의 이미지만을 보유하고 있었다.[^10][^6]

딥러닝에 대한 중요성

2012년 9월 30일, AlexNet[^8]이라 불리는 합성곱 신경망(CNN)이 ImageNet 2012 챌린지에서 상위 5개 오류율 15.3%를 달성하여, 2위보다 10.8 퍼센트 포인트 이상 낮은 성적을 기록했다. 합성곱 신경망의 사용은 훈련 과정에서 그래픽 처리 장치(GPU)를 활용함으로써 가능해졌으며,[^8] 이는 딥러닝 혁명의 핵심 요소였다. 이코노미스트에 따르면, "갑자기 AI 커뮤니티 내부뿐만 아니라 기술 산업 전체에서 사람들이 주목하기 시작했다."[^1][^22][^23]

2015년, AlexNet은 100개 이상의 층을 가진 마이크로소프트의 매우 깊은 CNN에 의해 추월당했으며, 이 모델은 테스트 세트에서 3.57%의 오류율로 ImageNet 2015 대회에서 우승했다.[^9]

안드레이 카르파시는 2014년에 집중적인 노력을 기울이면 5.1%의 오류율에 도달할 수 있다고 추정했으며, 그의 연구실에서 약 10명이 덜 집중적인 노력으로 약 12-13%에 도달했다.[^24][^25] 최대한의 노력을 기울이면 인간이 2.4%에 도달할 수 있는 것으로 추정되었다.[^10]

데이터셋

ImageNet은 주석 작업을 크라우드소싱 방식으로 진행한다. 이미지 수준 주석은 이미지 내 객체 클래스의 존재 여부를 나타내며, 예를 들어 "이 이미지에 호랑이가 있다" 또는 "이 이미지에 호랑이가 없다"와 같은 형태이다. 객체 수준 주석은 표시된 객체의 (보이는 부분을 둘러싸는) 바운딩 박스를 제공한다. ImageNet은 광범위한 WordNet 체계의 변형을 사용하여 객체를 분류하며, 세밀한 분류를 보여주기 위해 120가지 개 품종 카테고리를 추가하였다.[^10]

2012년, ImageNet은 세계 최대의 Mechanical Turk 학술 사용자였다. 평균적으로 작업자는 분당 50개의 이미지를 식별하였다.

전체 ImageNet의 원래 계획은 약 50K개의 동의어 집합에 걸쳐 대략 5천만 장의 깨끗하고 다양하며 전체 해상도의 이미지를 확보하는 것이었다.[^7] 이 목표는 달성되지 못하였다.

2010년 4월 30일 기준 요약 통계:[^26]

- 비어 있지 않은 동의어 집합의 총 수: 21841

- 총 이미지 수: 14,197,122

- 바운딩 박스 주석이 있는 이미지 수: 1,034,908

- SIFT 특징이 있는 동의어 집합 수: 1000

- SIFT 특징이 있는 이미지 수: 120만

카테고리

ImageNet의 카테고리는 WordNet 개념에서 필터링되었다. 각 개념은 여러 동의어를 포함할 수 있으므로(예: "kitty"와 "young cat"), 각 개념을 "동의어 집합" 또는 "synset"이라고 부른다. WordNet 3.0에는 100,000개 이상의 동의어 집합이 있었으며, 대부분은 명사(80,000개 이상)였다. ImageNet 데이터셋은 이를 시각적으로 표현할 수 있는 가산 명사인 21,841개의 동의어 집합으로 필터링하였다.

WordNet 3.0의 각 동의어 집합에는 "WordNet ID"(wnid)가 있으며, 이는 품사와 "오프셋"(고유 식별 번호)을 연결한 것이다. ImageNet에는 명사만 포함되므로 모든 wnid는 "n"으로 시작한다. 예를 들어, 동의어 집합 "dog, domestic dog, Canis familiaris"의 wnid는 "n02084071"이다.[^27]

ImageNet의 카테고리는 레벨 1(예: "포유류")부터 레벨 9(예: "저먼 셰퍼드")까지 9개 수준으로 나뉜다.[^5]

이미지 형식

이미지는 여러 언어의 동의어를 사용하여 온라인 이미지 검색(Google, Picsearch, MSN, Yahoo, Flickr 등)에서 수집되었다. 예: German shepherd, German police dog, German shepherd dog, Alsatian, ovejero alemán, pastore tedesco, 德国牧羊犬.[^11]

ImageNet은 다양한 해상도의 RGB 형식 이미지로 구성되어 있다. 예를 들어, ImageNet 2012의 "물고기" 카테고리에서 해상도는 4288 x 2848부터 75 x 56까지 다양하다. 머신러닝에서는 일반적으로 신경망의 추가 처리 전에 표준 고정 해상도로 전처리하고 백색화(whitening)를 수행한다.

예를 들어, PyTorch에서 ImageNet 이미지는 기본적으로 픽셀 값을 나누어 0과 1 사이에 놓이게 한 후, [0.485, 0.456, 0.406]을 빼고, [0.229, 0.224, 0.225]로 나누어 정규화한다. 이들은 ImageNet의 평균과 표준편차이므로, 이 과정을 통해 입력 데이터가 백색화된다.[^28]

레이블과 주석

각 이미지에는 정확히 하나의 wnid가 레이블로 부여된다.

ImageNet-1K에 대한 밀집 SIFT 특징(원시 SIFT 디스크립터, 양자화된 코드워드, 각 디스크립터/코드워드의 좌표)은 시각 단어 가방(bag of visual words) 모델을 위해 다운로드가 가능했다.^29

객체의 바운딩 박스는 약 3000개의 인기 동의어 집합에 대해 제공되었으며^30 각 동의어 집합에는 평균 150개의 이미지가 포함되어 있었다.[^31]

또한 일부 이미지에는 속성이 있다. 약 400개의 인기 동의어 집합에 대해 25가지 속성이 공개되었다:[^32][^33]

- 색상: 검정, 파랑, 갈색, 회색, 초록, 주황, 분홍, 빨강, 보라, 흰색, 노랑

- 패턴: 점무늬, 줄무늬

- 형태: 긴, 둥근, 직사각형, 정사각형

- 질감: 털이 있는, 매끄러운, 거친, 광택 있는, 금속성, 식물성, 나무질, 젖은

ImageNet-21K

전체 원본 데이터셋은 ImageNet-21K로 불린다. ImageNet-21k는 21,841개 클래스로 나뉜 14,197,122장의 이미지를 포함한다. 일부 논문에서는 이를 반올림하여 ImageNet-22k로 명명한다.[^12]

전체 ImageNet-21k는 2011년 가을에 fall11_whole.tar로 공개되었다. ImageNet-21k에 대한 공식적인 훈련-검증-테스트 분할은 없다. 일부 클래스는 1~10개의 샘플만 포함하는 반면, 다른 클래스는 수천 개를 포함한다.[^12]

ImageNet-1K

ImageNet 데이터셋에는 다양한 맥락에서 사용되는 여러 하위 집합이 있으며, 때때로 "버전"이라고 불린다.[^8]

ImageNet의 가장 널리 사용되는 하위 집합 중 하나는 "ImageNet 대규모 시각 인식 챌린지(ILSVRC) 2012–2017 이미지 분류 및 위치 추정 데이터셋"이다. 이는 연구 문헌에서 ImageNet-1K 또는 ILSVRC2017로도 불리며, 1,000개 클래스를 포함하는 원래 ILSVRC 챌린지를 반영한다. ImageNet-1K는 1,281,167장의 훈련 이미지, 50,000장의 검증 이미지, 100,000장의 테스트 이미지를 포함한다.^34

ImageNet-1K의 각 카테고리는 말단 카테고리로, ImageNet-21K와 달리 그 아래에 하위 노드가 없다. 예를 들어, ImageNet-21K에는 단순히 "포유류"로 분류된 이미지가 있는 반면, ImageNet-1K에는 "저먼 셰퍼드"와 같이 그 아래에 하위 단어가 없는 것들로만 분류된 이미지가 있다.[^11]

이후 발전

ImageNet의 기반이 된 WordNet에는 "사람" 하위 트리에 2832개의 동의어 집합이 있었다. 2018~2020년 기간 동안, 이러한 사람 관련 동의어 집합에 대한 광범위한 필터링을 진행하면서 ImageNet-21k의 다운로드를 중단하였다. 2832개의 동의어 집합 중 1593개가 "잠재적으로 공격적"인 것으로 판단되었다. 나머지 1239개 중 1081개는 실질적으로 "시각적"이지 않은 것으로 판단되었다. 그 결과 158개의 동의어 집합만 남았다. 이 중 "추가 탐구"를 위해 100장 이상의 이미지를 포함하는 것은 139개뿐이었다.[^4][^13][^35]

2021년 겨울, ImageNet-21k가 업데이트되었다. 훈련된 모델의 "문제적 행동"을 방지하기 위해 "사람" 하위 트리의 2702개 카테고리가 제거되었다. 그 결과 "사람" 하위 트리에는 130개의 동의어 집합만 남았다. 또한 2021년에는 997개의 비인물 카테고리에 나타나는 얼굴을 흐리게 처리하여 ImageNet-1k가 업데이트되었다. ImageNet-1k의 전체 1,431,093장의 이미지 중 243,198장(17%)에 최소 하나의 얼굴이 포함되어 있는 것으로 확인되었다. 전체 얼굴 수는 562,626개에 달한다. 이러한 얼굴을 흐리게 처리한 데이터셋으로 모델을 훈련시켜도 성능 저하가 최소한에 그치는 것으로 확인되었다.[^36][^37]

ImageNet-C는 2019년에 구축된 ImageNet의 적대적 교란 버전이다.[^38]

ImageNetV2는 원래 ImageNet과 동일한 방법론으로 구축된, 각 10,000장씩 세 개의 테스트 세트를 포함하는 새로운 데이터셋이다.[^39]

ImageNet-21K-P는 ImageNet-21K의 필터링 및 정제된 하위 집합으로, 11,221개 카테고리에서 12,358,688장의 이미지를 포함한다. 모든 이미지는 224 x 224px로 크기가 조정되었다.[^12] {| class="wikitable" |+데이터셋 표 !이름 !공개 연도 !클래스 !훈련 !검증 !테스트 !크기 |- |PASCAL VOC |2005 |20 | | | | |- |ImageNet-1K |2009 |1,000 |1,281,167 |50,000 |100,000 |130 GB |- |ImageNet-21K |2011 |21,841 |14,197,122 | | |1.31 TB |- |ImageNetV2 |2019 | | | |30,000 | |- |ImageNet-21K-P |2021 |11,221 |11,797,632 | |561,052 |250 GB[^12] |}

ImageNet 챌린지의 역사

ILSVRC는 2005년에 설립되어 약 20,000개의 이미지와 20개의 객체 클래스만을 포함했던 소규모 PASCAL VOC 챌린지의 "발자취를 따르는 것"을 목표로 한다.[^10] ImageNet을 "대중화"하기 위해, 페이페이 리는 PASCAL VOC 팀에 협업을 제안하였고, 2010년부터 연구팀들이 주어진 데이터셋에서 알고리즘을 평가하고 여러 시각 인식 과제에서 더 높은 정확도를 달성하기 위해 경쟁하기 시작했다.[^6]

이로부터 시작된 연례 대회는 현재 ImageNet 대규모 시각 인식 챌린지(ILSVRC)로 알려져 있다. ILSVRC는 전체 ImageNet 체계에서 분류된 120개 개 품종 중 90개를 포함하여 1000개의 이미지 범주 또는 "클래스"만으로 구성된 "축소된" 목록을 사용한다.[^10]

2010년대에는 이미지 처리 분야에서 극적인 발전이 이루어졌다.

2010년 첫 번째 대회에는 11개 팀이 참가했다. 우승 팀은 선형 서포트 벡터 머신(SVM)을 사용했다. 특징은 HoG와 LBP의 조밀한 격자로, 지역 좌표 코딩과 풀링에 의해 희소화되었다.[^40] 분류 정확도 52.9%와 상위 5개 정확도 71.8%를 달성했다. 세 대의 8코어 머신(듀얼 쿼드코어 2 GHz Intel Xeon CPU)에서 4일간 훈련되었다.[^41]

2011년 두 번째 대회에는 더 적은 팀이 참가했으며, 또 다른 SVM이 상위 5개 오류율 25%로 우승했다.[^3] 우승 팀은 Florent Perronnin, Jorge Sanchez의 XRCE였다. 이 시스템은 양자화된[^42] 피셔 벡터에서[^43][^44] 실행되는 또 다른 선형 SVM이었다. 상위 5개 정확도 74.2%를 달성했다.

2012년에는 AlexNet이라는 심층 합성곱 신경망이 상위 5개 정확도 84.7%를 달성하며 큰 도약을 이루었다.[^45] 2위는 SVM, SIFT, 색상 통계, 피셔 벡터 등의 기존 범용 아키텍처를 사용한 Oxford VGG였다.[^46] 이후 몇 년 안에 상위 5개 정확도는 90% 이상으로 성장했다. 2012년의 돌파구가 "이전에 모두 존재했던 조각들을 결합한" 것이었지만, 극적인 양적 개선은 산업 전반의 인공지능 붐의 시작을 알렸다.[^1]

2013년에는 대부분의 상위권 참가작이 합성곱 신경망을 사용했다. 객체 위치 인식 부문 우승작은 동시 객체 분류 및 위치 인식을 위한 아키텍처인 OverFeat이었다.[^47] 분류 부문 우승작은 Clarifai의 다중 CNN 앙상블이었다.[^10]

2014년까지 50개 이상의 기관이 ILSVRC에 참가했다.[^10] 분류 부문 우승작은 GoogLeNet이었다.[^14] 위치 인식 부문 우승작은 VGGNet이었다. 2017년에는 38개 경쟁 팀 중 29개 팀이 95% 이상의 정확도를 달성했다.[^48] 2017년 ImageNet은 자연어를 사용하여 3D 객체를 분류하는 훨씬 더 어려운 새로운 챌린지를 2018년에 출시할 것이라고 발표했다. 3D 데이터 생성은 기존 2D 이미지에 주석을 다는 것보다 비용이 더 많이 들기 때문에, 데이터셋은 더 작을 것으로 예상되었다. 이 분야의 발전 응용 범위는 로봇 내비게이션에서 증강 현실까지 다양할 것이다.

2015년 우승작은 인간의 성능을 초과한 ResNet이었다.[^9][^49] 그러나 챌린지 주최자 중 한 명인 Olga Russakovsky가 2015년에 지적했듯이, ILSVRC는 1000개의 범주만을 대상으로 한다. 인간은 더 많은 수의 범주를 인식할 수 있으며, (프로그램과 달리) 이미지의 맥락을 판단할 수도 있다.[^50]

2016년 우승작은 Inception v3, Inception v4, Inception ResNet v2, ResNet 200, Wide ResNet 68, Wide ResNet 3의 6개 네트워크로 구성된 앙상블 모델인 CUImage였다.[^51] 준우승은 Inception 모듈과 ResNet을 결합한 ResNeXt였다.[^52]

2017년 우승작은 Squeeze-and-Excitation Network(SENet)으로, 상위 5개 오류율을 2.251%까지 줄였다.[^53]

대회 주최측은 2017년에 2017년 대회가 마지막이 될 것이라고 밝혔는데, 이는 벤치마크가 해결되어 더 이상 도전 과제가 되지 않았기 때문이다. 그들은 또한 3D 이미지에 대한 새로운 대회를 조직할 것이라고 밝혔다. 그러나 그러한 대회는 실현되지 않았다.

ImageNet의 편향

ImageNet-1k 검증 세트의 레이블 중 6% 이상이 잘못된 것으로 추정된다.[^54] 또한 ImageNet-1k의 약 10%가 모호하거나 잘못된 레이블을 포함하고 있으며, 모델의 예측과 원래 ImageNet 레이블을 함께 제시했을 때, 인간 주석자들은 원래 ImageNet으로 훈련된 2020년 최신 모델의 예측을 선호하는 것으로 나타났는데, 이는 ImageNet-1k가 포화 상태에 이르렀음을 시사한다.[^55]

2019년에 ImageNet과 WordNet의 다층 구조(분류 체계, 객체 클래스, 레이블링)의 역사를 연구한 결과, 모든 종류의 이미지에 대한 대부분의 분류 접근 방식에 편향이 깊이 내재되어 있음이 밝혀졌다.[^56][^57][^58][^59] ImageNet은 다양한 편향의 원인을 해결하기 위해 노력하고 있다.[^60]

WordNet 사용의 단점 중 하나는 범주가 ImageNet에 최적인 것보다 더 "고상한" 수준일 수 있다는 것이다: "대부분의 사람들은 이 희귀한 종류의 디플로도쿠스보다 레이디 가가나 아이팟 미니에 더 관심이 있다."

같이 보기

- 컴퓨터 비전

- 기계 학습 연구를 위한 데이터셋 목록

- WordNet

1차 자료

-

-

-

-

-

외부 링크

-

-

-

-

참고 문헌

[^1]: 작동하지 않던 것에서 신경망으로. (25 June 2016)

[^2]: Hempel, Jesse. 페이페이 리의 인류를 위한 더 나은 AI를 향한 여정. (13 November 2018)

[^3]: Lee, Timothy B.. 고집 센 컴퓨터 과학자가 우연히 딥러닝 붐을 일으킨 방법. (2024-11-11)

[^4]: Yang, Kaiyu. 더 공정한 데이터셋을 향하여: ImageNet 계층 구조에서 사람 하위 트리의 분포 필터링 및 균형 조정. (2019-09-17)

[^5]: Li, F-F. ImageNet. "[https://web.archive.org/web/20130115112543/http://www.image-net.org/papers/ImageNet_2010.pdf 크라우드소싱, 벤치마킹 및 기타 흥미로운 것들]." ''CMU VASC Semin'' 16 (2010): 18-25

[^6]: Gershgorn, Dave. AI 연구를 변화시킨, 그리고 아마도 세계를 변화시킨 데이터. Atlantic Media Co.. (26 July 2017)

[^7]: Deng, Jia. 2009년 컴퓨터 비전 및 패턴 인식 학회

[^8]: Krizhevsky, Alex. 심층 합성곱 신경망을 이용한 ImageNet 분류. (June 2017)

[^9]: He, Kaiming. 2016 IEEE 컴퓨터 비전 및 패턴 인식 학회 (CVPR)

[^10]: Russakovsky, Olga. ImageNet 대규모 시각 인식 챌린지. (2015-12-01)

[^11]: Berg, Alex, Jia Deng, and L. Fei-Fei. "[https://www.image-net.org/static_files/files/pascal_ilsvrc.pdf 2010년 대규모 시각 인식 챌린지]." November 2010.

[^12]: Ridnik, Tal. 대중을 위한 ImageNet-21K 사전 학습. (2021-08-05)

[^13]: Yang, Kaiyu. 2020년 공정성, 책임성 및 투명성 학회 논문집. ACM. (2020-01-27)

[^14]: Szegedy, Christian. 2015 IEEE 컴퓨터 비전 및 패턴 인식 학회 (CVPR). IEEE. (June 2015)

[^16]: ImageNet 개요. ImageNet

[^17]: Biederman, Irving. 구성 요소에 의한 인식: 인간의 이미지 이해에 관한 이론. (1987)

[^18]: Li, Fei-Fei. 우리는 어디에서 왔고, 어디로 가고 있는가?. (2017)

[^19]: CVPR 2009: IEEE 컴퓨터 학회 컴퓨터 비전 및 패턴 인식 학회

[^20]: Li, Fei-Fei. 컴퓨터에게 사진을 이해하도록 가르치는 방법. (23 March 2015)

[^21]: Deng, Jia, et al. "[https://web.archive.org/web/20130115112451/http://www.image-net.org/papers/ImageNet_VSS2009.pdf 대규모 이미지 온톨로지의 구축 및 분석]." ''Vision Sciences Socie

[^22]: 점점 더 많은 작업에서 기계가 인간을 이기다. (30 November 2017)

[^23]: Gershgorn, Dave. AI가 실리콘밸리를 지배할 만큼 발전한 내막. (18 June 2018)

[^24]: cite web url=https://plus.google.com/+PierreSermanet/posts/6wZYMuXo8PU archive-url=https://web.archive.org/web/20150522055300/https://plus.google.com/+PierreSermanet/posts/6wZYMuXo8PU archive-da

[^25]: Karpathy, Andrej. ImageNet에서 합성곱 신경망과 경쟁하며 배운 것. (2014-09-02)

[^26]: ImageNet 요약 및 통계 (2010년 4월 30일 업데이트). (2013-01-15)

[^27]: ImageNet API 문서. (2013-01-22)

[^28]: 이미지 정규화를 위한 표준편차 및 평균이 ImageNet과 다름 · Issue #20 · openai/CLIP

[^31]: cite web url=http://www.image-net.org/download-bboxes archive-url=https://web.archive.org/web/20130405005059/http://www.image-net.org/download-bboxes archive-date=5 April 2013 title=ImageNet

[^32]: cite web url=http://www.image-net.org/download-attributes archive-url=https://web.archive.org/web/20191222152337/http://www.image-net.org/download-attributes archive-date=22 December 2019 titl

[^33]: Russakovsky, Olga. 컴퓨터 비전의 동향 및 주제. Springer. (2012)

[^35]: NSF 수상 검색: 수상 번호 1763642

[^36]: ImageNet 웹사이트 및 데이터셋 업데이트

[^37]: Yang, Kaiyu. ImageNet에서의 얼굴 난독화 연구. PMLR. (2022-06-28)

[^38]: Hendrycks, Dan. 일반적인 손상 및 교란에 대한 신경망 강건성 벤치마킹. (2019)

[^39]: Recht, Benjamin. ImageNet 분류기는 ImageNet에 일반화되는가?. PMLR. (2019-05-24)

[^40]: [https://www.image-net.org/static_files/files/ILSVRC2010_NEC-UIUC.pdf ImageNet 분류: 빠른 디스크립터 코딩 및 대규모 SVM 학습]

[^41]: Lin, Yuanqing. CVPR 2011. IEEE. (June 2011)

[^42]: Sanchez, Jorge. CVPR 2011. IEEE. (June 2011)

[^43]: Perronnin, Florent. 컴퓨터 비전 – ECCV 2010. Springer. (2010)

[^44]: [https://web.archive.org/web/20201027234359/http://image-net.org/challenges/LSVRC/2011/ilsvrc11.pdf "LSVR을 위한 압축된 피셔 벡터 XRCE@ILSVRC2011"], Florent Perronnin and Jorge Sánchez, Xerox R

[^45]: cite web url=https://www.image-net.org/challenges/LSVRC/2012/results title=ImageNet 대규모 시각 인식 대회 2012 (ILSVRC2012)

[^46]: Russakovsky, Olga. 아보카도에서 주키니까지 검출하기: 우리는 무엇을 했고, 어디로 가고 있는가?. (2013)

[^47]: Sermanet, Pierre. OverFeat: 합성곱 네트워크를 이용한 통합 인식, 위치 추정 및 검출. (2013)

[^48]: Gershgorn, Dave. Quartz 인공지능 가이드: 무엇이며, 왜 중요하고, 두려워해야 하는가?. (10 September 2017)

[^49]: Markoff, John. 인공지능의 학습 발전이 인간의 능력에 필적하다. (10 December 2015)

[^50]: Aron, Jacob. 튜링 테스트는 잊어라 – AI를 판단하는 더 나은 방법이 있다. (21 September 2015)

[^51]: cite web url=https://image-net.org/challenges/LSVRC/2016/results title=Ilsvrc2016

[^52]: Xie, Saining. 심층 신경망을 위한 집계된 잔차 변환

[^53]: Hu, Jie. 스퀴즈-앤-익사이테이션 네트워크. (2017)

[^54]: Northcutt, Curtis G.. 테스트 세트의 만연한 레이블 오류가 기계 학습 벤치마크를 불안정하게 만든다. (2021-11-07)

[^55]: Beyer, Lucas. ImageNet은 끝난 것인가?. (2020-06-12)

[^56]: 당신에게 라벨을 붙이는 그 바이럴 앱은 당신이 생각하는 것과 다르다

[^57]: Wong, Julia Carrie. 바이럴 셀피 앱 ImageNet Roulette는 재미있어 보였다 – 나에게 인종차별적 비속어를 사용하기 전까지는. (18 September 2019)

[^58]: Crawford, Kate. AI 발굴하기: 기계 학습 훈련 세트의 정치학. (19 September 2019)

[^59]: Lyons, Michael. "AI 발굴하기"를 발굴하다: 갤러리 속의 코끼리. (24 December 2020)

[^60]: 더 공정한 데이터셋을 향하여: ImageNet 계층 구조에서 사람 하위 트리의 분포 필터링 및 균형 조정. (17 September 2019)

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

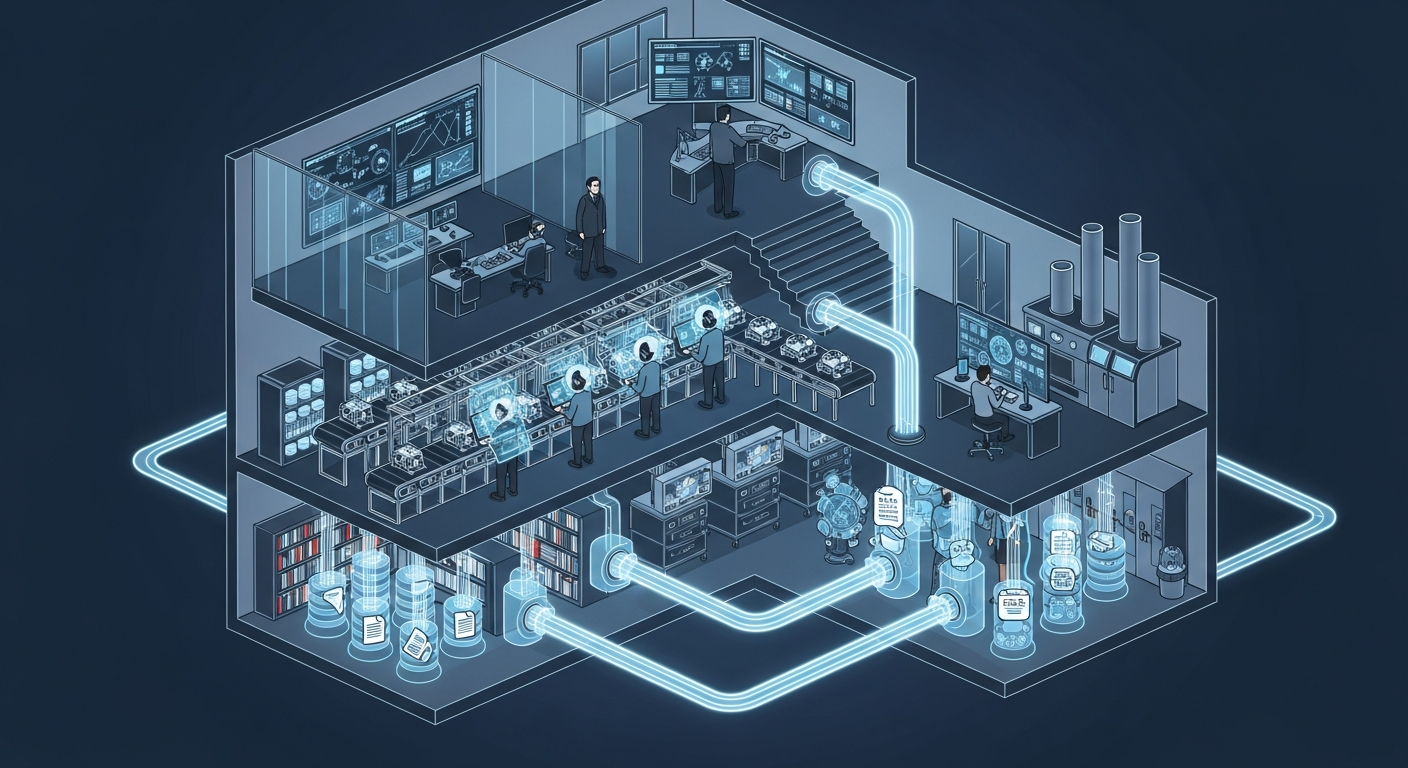

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.