멀티모달 학습

멀티모달 학습은 텍스트, 오디오, 이미지, 비디오 등 모달리티라고 불리는 여러 유형의 데이터를 통합하고 처리하는 딥러닝의 한 유형이다. 이러한 통합은 복잡한 데이터에 대한 보다 총체적인 이해를 가능하게 하며, 시각적 질의응답, 교차 모달 검색,[^2] 텍스트-이미지 생성,[^1] 미적 순위 평가,[^3] 이미지 캡셔닝[^4] 등의 작업에서 모델 성능을 향상시킨다.

구글 제미나이(Google Gemini)와 GPT-4o 같은 대규모 멀티모달 모델은 2023년 이후 점점 더 대중화되고 있으며, 다양성과 실세계 현상에 대한 폭넓은 이해를 가능하게 하고 있다.[^5]

동기

데이터는 일반적으로 서로 다른 정보를 담고 있는 다양한 모달리티를 수반한다. 예를 들어, 이미지 자체에 나타나지 않는 정보를 전달하기 위해 이미지에 캡션을 다는 것은 매우 흔한 일이다. 마찬가지로, 텍스트만으로는 명확하지 않을 수 있는 정보를 설명하기 위해 이미지를 사용하는 것이 더 직관적일 때가 있다. 결과적으로, 유사한 이미지에 서로 다른 단어가 등장한다면, 이 단어들은 같은 대상을 설명할 가능성이 높다. 반대로, 하나의 단어가 겉보기에 다른 이미지들을 설명하는 데 사용된다면, 이 이미지들은 같은 대상을 나타낼 수 있다. 따라서 멀티모달 데이터를 다루는 경우, 서로 다른 모달리티의 결합된 정보를 포착할 수 있도록 정보를 공동으로 표현할 수 있는 모델을 사용하는 것이 중요하다.

멀티모달 트랜스포머

멀티모달 대규모 언어 모델

멀티모달 심층 볼츠만 머신

볼츠만 머신은 1985년 제프리 힌턴(Geoffrey Hinton)과 테리 세즈노스키(Terry Sejnowski)가 발명한 확률적 신경망의 한 유형이다. 볼츠만 머신은 홉필드 네트워크의 확률적·생성적 대응물로 볼 수 있다. 이 명칭은 통계역학의 볼츠만 분포에서 유래하였다. 볼츠만 머신의 유닛은 가시 유닛과 은닉 유닛의 두 그룹으로 나뉜다. 각 유닛은 활성화 여부를 나타내는 이진 출력을 가진 뉴런과 같다.[^6] 일반 볼츠만 머신은 모든 유닛 간의 연결을 허용한다. 그러나 일반 볼츠만 머신을 사용한 학습은 계산 시간이 머신의 크기에 대해 지수적으로 증가하기 때문에 비실용적이다. 보다 효율적인 구조는 제한 볼츠만 머신이라 불리며, 은닉 유닛과 가시 유닛 사이의 연결만 허용하는데, 이는 다음 절에서 설명한다.

멀티모달 심층 볼츠만 머신은 이미지와 텍스트 같은 서로 다른 유형의 정보를 동시에 처리하고 학습할 수 있다. 이는 특히 각 모달리티에 대해 별도의 심층 볼츠만 머신을 두고(예: 이미지용 하나, 텍스트용 하나), 추가적인 최상위 은닉 층에서 이들을 결합하는 방식으로 구현할 수 있다.[^7]

응용 분야

멀티모달 기계 학습은 다양한 분야에서 수많은 응용 사례를 가지고 있다:

- 교차 모달 검색: 교차 모달 검색은 사용자가 서로 다른 모달리티 간에 데이터를 검색할 수 있게 해주며(예: 텍스트 설명을 기반으로 이미지 검색), 멀티미디어 검색 엔진과 콘텐츠 추천 시스템을 개선한다.[^8]

- 분류 및 결측 데이터 복원: 멀티모달 심층 볼츠만 머신은 분류 작업에서 서포트 벡터 머신이나 잠재 디리클레 할당과 같은 기존 모델을 능가하며, 이미지와 텍스트 등 멀티모달 데이터셋에서 결측 데이터를 예측할 수 있다.

- 의료 진단: 멀티모달 모델은 의료 영상, 유전체 데이터, 환자 기록을 통합하여 진단 정확도와 조기 질병 발견을 개선하며, 특히 암 검진에서 효과적이다.[^9][^10][^11]

- 콘텐츠 생성: DALL·E와 같은 모델은 텍스트 설명으로부터 이미지를 생성하여 창작 산업에 기여하며, 교차 모달 검색은 동적 멀티미디어 검색을 가능하게 한다.[^12]

- 로봇공학 및 인간-컴퓨터 상호작용: 멀티모달 학습은 음성, 시각, 촉각과 같은 감각 입력을 통합하여 로봇공학과 인공지능에서의 상호작용을 개선하고, 자율 시스템과 인간-컴퓨터 상호작용을 지원한다.

- 감정 인식: 시각, 오디오, 텍스트 데이터를 결합하여 멀티모달 시스템은 감성 분석과 감정 인식을 향상시키며, 고객 서비스, 소셜 미디어, 마케팅 분야에 적용된다.

같이 보기

*교차 모달 검색 *비전-언어 모델 *홉필드 네트워크 *마르코프 랜덤 필드 *마르코프 연쇄 몬테카를로

참고 문헌

[^1]: GitHub의 Stable Diffusion 저장소. CompVis - Machine Vision and Learning Research Group, LMU Munich. (2022년 9월 17일)

[^2]: Hendriksen, Mariya. 전자상거래에서 카테고리-이미지 검색을 위한 CLIP 확장. (2021)

[^3]: LAION-AI/aesthetic-predictor. LAION AI. (2024-09-06)

[^4]: Mokady, Ron. ClipCap: 이미지 캡셔닝을 위한 CLIP 접두사. (2021)

[^5]: Zia, Tehseen. 대규모 멀티모달 모델의 공개: 2024년 언어 모델 환경의 변화. (2024년 1월 8일)

[^6]: Dey, Victor. 볼츠만 머신 초보자 가이드. (2021-09-03)

[^7]: 심층 볼츠만 머신을 이용한 멀티모달 학습

[^8]: Hendriksen, Mariya. 장면 중심 대 객체 중심 이미지-텍스트 교차 모달 검색: 재현성 연구. (2023)

[^9]: Quach, Katyanna. 하버드 연구진, 암 예측을 위한 멀티모달 AI 시스템 구축

[^10]: Chen, Richard J.. 멀티모달 딥러닝을 통한 범암 통합 조직학-유전체 분석. (2022년 8월 8일)

[^11]: Shi, Yuge. 다중 모달 심층 생성 모델을 위한 변분 전문가 혼합 오토인코더

[^12]: Shi, Yuge. 다중 모달 심층 생성 모델을 위한 변분 전문가 혼합 오토인코더. (2019)

관련 인사이트

디지털 트윈, 당신 공장엔 이미 있다 — 엑셀과 MES 사이 어딘가에

디지털 트윈은 10억짜리 3D 시뮬레이션이 아니다. 지금 쓰고 있는 엑셀에 좋은 질문 하나를 더하는 것 — 두 전문가가 중소 제조기업이 이미 가진 데이터로 예측하는 공장을 만드는 현실적 로드맵을 제시한다.

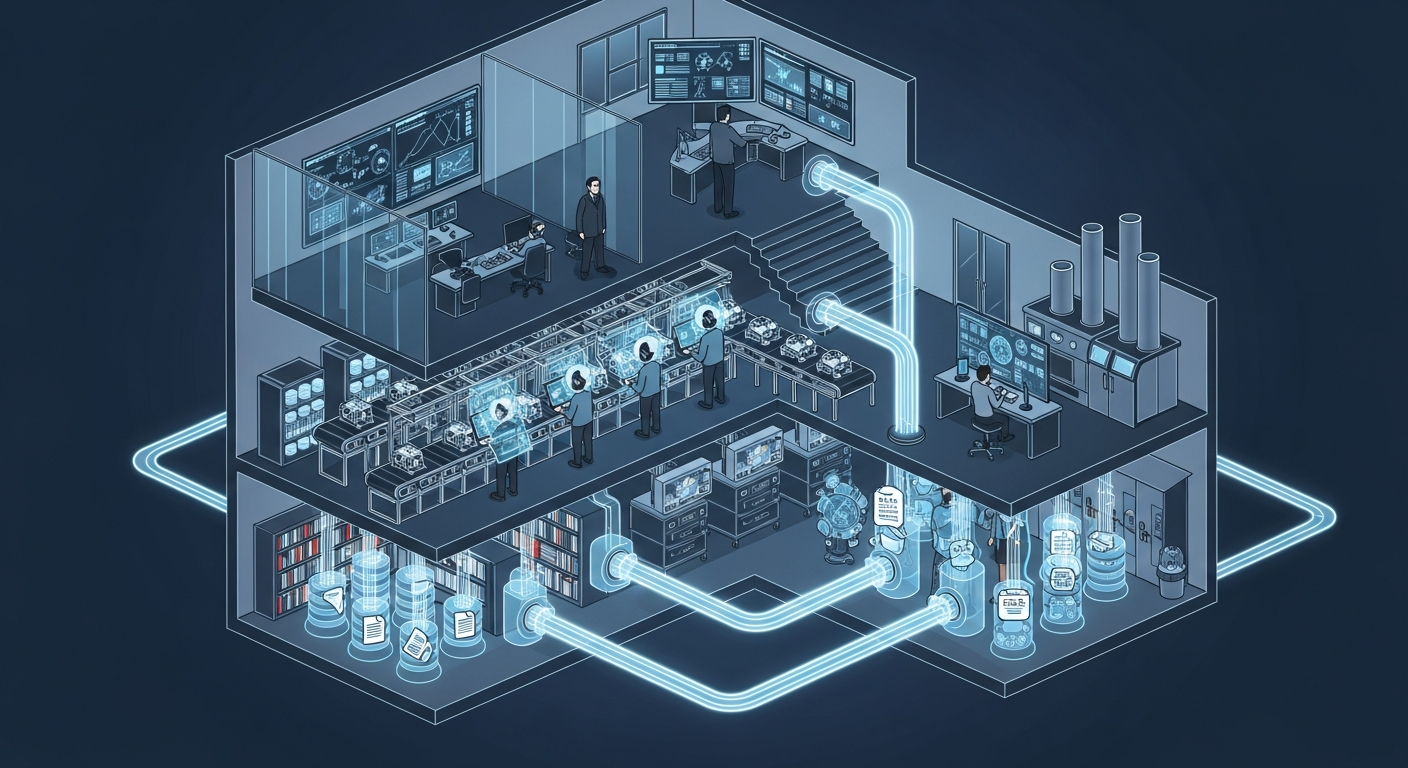

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.