특징

기계 학습과 패턴 인식에서 특징(feature)은 데이터 세트의 개별적으로 측정 가능한 속성 또는 특성을 말한다.[^1] 유익하고, 변별력 있으며, 독립적인 특징을 선택하는 것은 패턴 인식, 분류, 회귀 작업을 위한 효과적인 알고리즘을 만드는 데 매우 중요하다. 특징은 일반적으로 수치형이지만, 원-핫 인코딩과 같은 전처리 단계를 거친 후에는 문자열이나 그래프와 같은 다른 유형도 구문 패턴 인식에 사용된다. "특징"의 개념은 선형 회귀와 같은 통계 기법에서 사용되는 설명 변수의 개념과 관련이 있다.

특징의 유형

특징 공학에서는 수치형과 범주형의 두 가지 유형의 특징이 일반적으로 사용된다.

수치형 특징은 척도로 측정할 수 있는 연속적인 값이다. 수치형 특징의 예로는 나이, 키, 체중, 소득 등이 있다. 수치형 특징은 기계 학습 알고리즘에 직접 사용할 수 있다.

범주형 특징은 범주로 그룹화할 수 있는 이산적인 값이다. 범주형 특징의 예로는 성별, 색상, 우편번호 등이 있다. 범주형 특징은 일반적으로 기계 학습 알고리즘에 사용하기 전에 수치형 특징으로 변환해야 한다. 이는 원-핫 인코딩, 레이블 인코딩, 순서형 인코딩 등 다양한 기법을 사용하여 수행할 수 있다.

특징 공학에서 사용되는 특징의 유형은 사용하는 특정 기계 학습 알고리즘에 따라 달라진다. 의사결정 나무와 같은 일부 기계 학습 알고리즘은 수치형 특징과 범주형 특징을 모두 처리할 수 있다. 선형 회귀와 같은 다른 기계 학습 알고리즘은 수치형 특징만 처리할 수 있다.

분류

수치형 특징은 특징 벡터로 편리하게 표현할 수 있다. 이진 분류를 수행하는 한 가지 방법은 특징 벡터를 입력으로 사용하는 선형 예측 함수(퍼셉트론과 관련됨)를 이용하는 것이다. 이 방법은 특징 벡터와 가중치 벡터 사이의 스칼라곱을 계산하여, 그 결과가 임계값을 초과하는 관측값을 선별하는 것으로 구성된다.

특징 벡터를 이용한 분류 알고리즘에는 최근접 이웃 분류, 신경망, 베이즈 접근법과 같은 통계 기법 등이 있다.

예시

문자 인식에서 특징에는 수평 및 수직 방향의 검은 픽셀 수를 세는 히스토그램, 내부 구멍의 수, 획 감지 등 여러 가지가 포함될 수 있다.

음성 인식에서 음소를 인식하기 위한 특징에는 잡음비, 소리의 길이, 상대적 전력, 필터 일치 등 여러 가지가 포함될 수 있다.

스팸 탐지 알고리즘에서 특징에는 특정 이메일 헤더의 존재 여부, 이메일 구조, 언어, 특정 용어의 빈도, 텍스트의 문법적 정확성 등이 포함될 수 있다.

컴퓨터 비전에서는 에지와 객체 등 많은 수의 가능한 특징이 존재한다.

특징 벡터

패턴 인식과 기계 학습에서 특징 벡터는 어떤 객체를 나타내는 수치적 특징들의 n차원 벡터이다. 기계 학습의 많은 알고리즘은 객체의 수치적 표현을 필요로 하는데, 이러한 표현이 처리와 통계 분석을 용이하게 하기 때문이다. 이미지를 표현할 때 특징 값은 이미지의 픽셀에 해당할 수 있으며, 텍스트를 표현할 때 특징은 텍스트 용어의 출현 빈도가 될 수 있다. 특징 벡터는 선형 회귀와 같은 통계적 절차에서 사용되는 설명 변수의 벡터와 동등하다. 특징 벡터는 예측을 위한 점수를 결정하는 데 사용되는 선형 예측 함수를 구성하기 위해 내적을 사용하여 가중치와 결합되는 경우가 많다.

이러한 벡터들과 관련된 벡터 공간을 흔히 특징 공간이라고 한다. 특징 공간의 차원을 줄이기 위해 다양한 차원 축소 기법이 사용될 수 있다.

상위 수준의 특징은 이미 사용 가능한 특징들로부터 얻어 특징 벡터에 추가할 수 있다. 예를 들어, 질병 연구에서 '나이'라는 특징은 유용하며 *나이 = '사망 연도' 빼기 '출생 연도'*로 정의된다. 이 과정을 특징 구성이라고 한다.[^2][^3] 특징 구성은 기존 특징 집합에 구성적 연산자 집합을 적용하여 새로운 특징을 만들어내는 것이다. 이러한 구성적 연산자의 예로는 등호 조건 {=, ≠}, 산술 연산자 {+,−,×, /}, 배열 연산자 {max(S), min(S), average(S)} 등이 있으며, 더 정교한 연산자도 있다. 예를 들어 count(S, C)[^4]는 특징 벡터 S에서 특정 조건 C를 만족하는 특징의 수를 세거나, 어떤 수용 장치에 의해 일반화된 다른 인식 클래스까지의 거리를 계산한다. 특징 구성은 특히 고차원 문제에서 정확도와 구조 이해를 모두 높이는 강력한 도구로 오랫동안 여겨져 왔다.[^5] 응용 분야에는 질병 연구와 음성에서의 감정 인식이 포함된다.[^6]

선택과 추출

초기 원시 특징 집합은 중복될 수 있으며 추정과 최적화를 어렵거나 비효율적으로 만들 만큼 충분히 클 수 있다. 따라서 기계 학습과 패턴 인식의 많은 응용에서 예비 단계는 특징의 부분 집합을 선택하거나, 학습을 용이하게 하고 일반화와 해석 가능성을 향상시키기 위해 축소된 새로운 특징 집합을 구성하는 것이다.[^7]

특징을 추출하거나 선택하는 것은 예술과 과학의 결합이다. 이를 수행하는 시스템을 개발하는 것을 특징 공학이라고 한다. 이는 여러 가능성에 대한 실험과 자동화된 기법을 해당 분야 전문가의 직관 및 지식과 결합하는 것을 필요로 한다. 이 과정을 자동화하는 것이 특징 학습으로, 기계가 학습을 위해 특징을 사용할 뿐만 아니라 특징 자체를 학습하는 것이다.

같이 보기

- 공변량

- 차원 축소

- 특징 공학

- 해싱 트릭

- 통계적 분류

- 설명 가능한 인공지능

참고 문헌

[^1]: 패턴 인식과 기계 학습. Springer

[^2]: Liu, H., Motoda H. (1998) ''[https://books.google.com/books?id=aaDbBwAAQBAJ 지식 발견과 데이터 마이닝을 위한 특징 선택].'', Kluwer Academic Publishers. Norwell, MA, USA. 1998.

[^3]: Piramuthu, S., Sikora R. T. [https://www.sciencedirect.com/science/article/pii/S0957417408001309 귀납적 학습 알고리즘 개선을 위한 반복적 특징 구성]. In Journal of Expert Syste

[^4]: Bloedorn, E., Michalski, R. 데이터 기반 구성적 귀납법: 방법론과 그 응용. IEEE Intelligent Systems, Special issue on Feature Transformation and Subset Selection, pp. 30-37, M

[^5]: Breiman, L. Friedman, T., Olshen, R., Stone, C. (1984) ''분류 및 회귀 트리'', Wadsworth

[^6]: Sidorova, J., Badia T. [https://ieeexplore.ieee.org/abstract/document/5402574/ 향상된 음성 감정 감지 및 분석 도구 ESEDA.1을 위한 구문 학습]. Internet Technology and Secured

[^7]: Hastie, Trevor. 통계적 학습의 기초: 데이터 마이닝, 추론 및 예측. Springer. (2009)

관련 인사이트

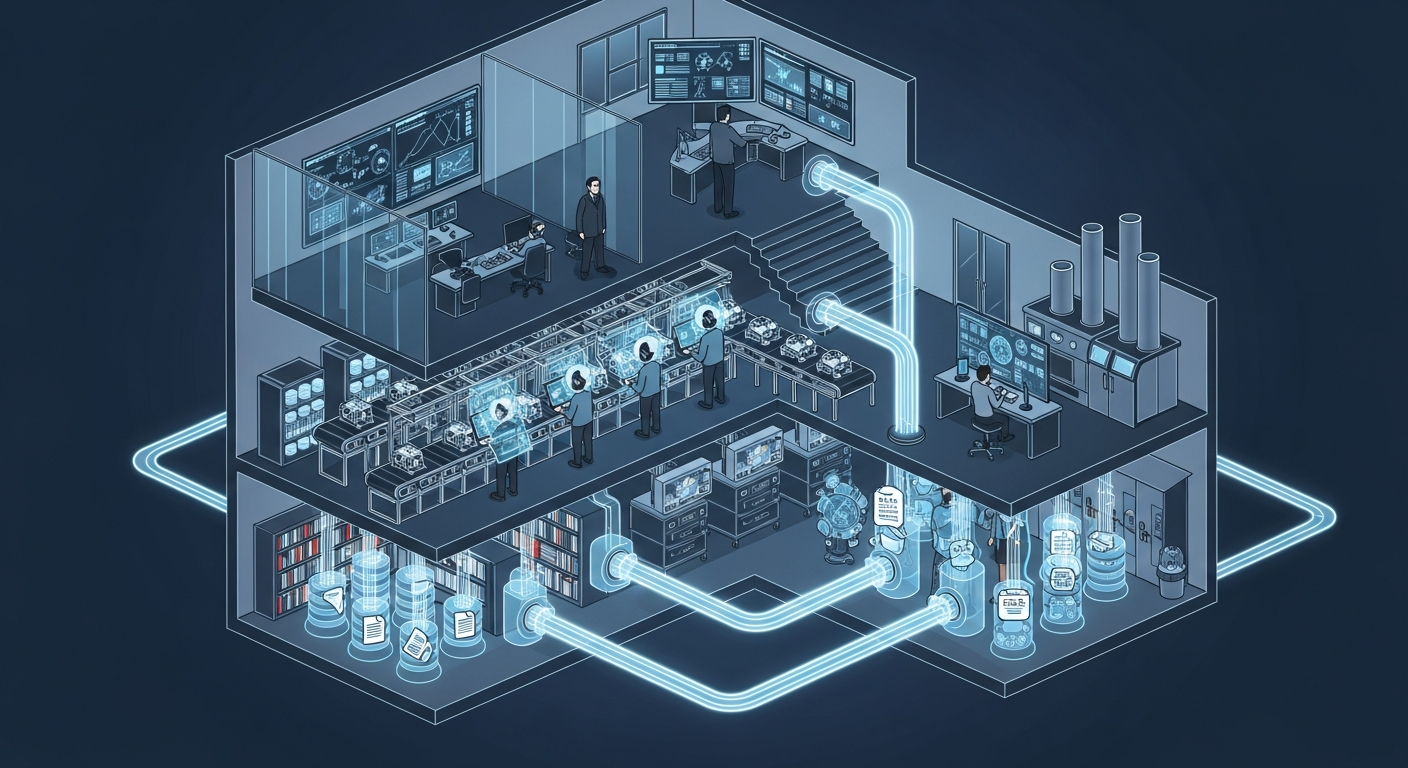

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.

ERP 20년, 나는 왜 AI를 얹기로 했나

ERP 20년차 제조IT본부장의 고백: 3,200만 행의 데이터가 잠들어 있었다. ERP를 바꾸지 않고 AI를 얹자, 일주일 걸리던 불량 분석이 수 초로 줄었다.