능동 학습

능동 학습(Active learning)은 학습 알고리즘이 인간 사용자(또는 다른 정보 출처)에게 대화식으로 질의하여 새로운 데이터 포인트에 원하는 출력값의 레이블을 부여하도록 하는 기계 학습의 특수한 형태이다. 인간 사용자는 필요시 권위 있는 출처를 참조하거나 조사할 수 있는 능력을 포함하여, 해당 문제 영역에 대한 지식과 전문성을 갖추고 있어야 한다.[^1][^2][^3] 통계학 문헌에서는 이를 때때로 최적 실험 설계라고도 부른다.[^4] 정보 출처는 교사 또는 오라클이라고도 불린다.

레이블이 없는 데이터는 풍부하지만 수동 레이블링에 비용이 많이 드는 상황이 존재한다. 이러한 시나리오에서 학습 알고리즘은 사용자/교사에게 능동적으로 레이블을 질의할 수 있다. 이러한 유형의 반복적 지도 학습을 능동 학습이라고 한다. 학습자가 예제를 선택하기 때문에, 개념을 학습하는 데 필요한 예제의 수는 일반적인 지도 학습에서 필요한 수보다 훨씬 적을 수 있다. 이 접근 방식에서는 알고리즘이 정보가 없는 예제에 압도될 위험이 있다. 최근의 발전은 다중 레이블 능동 학습,[^8] 하이브리드 능동 학습[^6] 및 단일 패스(온라인) 맥락에서의 능동 학습[^9]에 집중되어 있으며, 기계 학습 분야의 개념(예: 충돌 및 무지)과 온라인 기계 학습 분야의 적응적이고 점진적인 학습 정책을 결합하고 있다. 능동 학습을 사용하면 비교적 동일한 수준의 업데이트에 양자 컴퓨터나 슈퍼컴퓨터가 필요한 경우에도 기계 학습 알고리즘을 더 빠르게 개발할 수 있다.[^13]

대규모 능동 학습 프로젝트는 능동 학습 루프에 많은 인간을 포함시키는 Amazon Mechanical Turk와 같은 크라우드소싱 프레임워크의 도움을 받을 수 있다.

정의

를 고려 대상인 모든 데이터의 전체 집합이라 하자. 예를 들어, 단백질 공학 문제에서 는 특정한 흥미로운 활성을 가진 것으로 알려진 모든 단백질과 해당 활성을 테스트하고자 하는 모든 추가 단백질을 포함한다.

각 반복 단계에서 는 세 개의 부분 집합으로 나뉜다. #\mathbf{T}{K,i}: 레이블이 알려진 데이터 포인트. #\mathbf{T}{U,i}: 레이블이 알려지지 않은 데이터 포인트. #\mathbf{T}_{C,i}: 레이블링 대상으로 선택된 의 부분 집합.

현재 능동 학습 연구의 대부분은 의 데이터 포인트를 선택하는 최적의 방법에 관한 것이다.

시나리오

*** 풀 기반 샘플링(Pool-based sampling): 가장 잘 알려진 시나리오인[^14] 이 접근법에서 학습 알고리즘은 레이블링할 데이터 포인트(인스턴스)를 선택하기 전에 전체 데이터셋을 평가하려고 시도한다. 일반적으로 로지스틱 회귀나 SVM과 같은 기계 학습 방법을 사용하여 완전히 레이블이 지정된 데이터의 부분 집합으로 초기 훈련을 수행하며, 이를 통해 개별 데이터 인스턴스에 대한 클래스 소속 확률을 산출한다. 후보 인스턴스는 예측이 가장 모호한 인스턴스들이다. 인스턴스는 전체 데이터 풀에서 추출되어 신뢰도 점수, 즉 학습기가 데이터를 얼마나 잘 "이해하고 있는지"를 나타내는 측정값이 할당된다. 그런 다음 시스템은 가장 확신이 낮은 인스턴스를 선택하고 교사에게 레이블을 질의한다. 풀 기반 샘플링의 이론적 단점은 메모리 집약적이어서 거대한 데이터셋을 처리하는 능력에 제한이 있다는 것이지만, 실제로는 속도 제한 요인이 컴퓨터 메모리가 아니라 일반적으로 노력에 대한 대가를 지불해야 하는 (피로해질 수 있는) 인간 전문가인 교사라는 점이다. *** 스트림 기반 선택적 샘플링(Stream-based selective sampling): 여기서는 각각의 연속적인 비레이블 인스턴스가 하나씩 검토되며, 기계는 각 항목의 정보성을 질의 매개변수에 대해 평가한다. 학습기는 각 데이터 포인트에 대해 스스로 레이블을 할당할지 또는 교사에게 질의할지를 결정한다. 풀 기반 샘플링과 대비하여, 스트림 기반 방법의 명백한 단점은 학습 알고리즘이 과정 초기에 건전한 레이블-할당 대 교사-질의 결정을 내리기에 충분한 정보를 갖고 있지 않으며, 이미 레이블이 지정된 데이터의 존재를 효율적으로 활용하지 못한다는 것이다. 따라서 교사는 풀 기반 접근법보다 레이블 제공에 더 많은 노력을 기울여야 할 가능성이 높다. *** 멤버십 질의 합성(Membership query synthesis)**: 학습기가 기저의 자연 분포로부터 합성 데이터를 생성하는 방법이다. 예를 들어, 데이터셋이 사람과 동물의 사진인 경우, 학습기는 잘린 다리 이미지를 교사에게 보내고 이 부속지가 동물의 것인지 사람의 것인지를 질의할 수 있다. 이 방법은 데이터셋이 작을 때 특히 유용하다.[^15] 모든 합성 데이터 생성 노력에서와 마찬가지로, 여기서의 과제는 합성 데이터가 실제 데이터에 대한 제약 조건을 충족하는 측면에서 일관성을 보장하는 것이다. 입력 데이터의 변수/특성 수가 증가하고 변수 간에 강한 종속성이 존재할수록, 충분한 충실도를 가진 합성 데이터를 생성하는 것이 점점 더 어려워진다. 예를 들어, 인간 실험실 검사값에 대한 합성 데이터셋을 만들려면, 백혈구 감별 검사에서 다양한 백혈구(WBC) 구성 요소의 합이 100이 되어야 하는데, 이는 구성 요소 숫자가 실제로는 백분율이기 때문이다. 마찬가지로, 알라닌 아미노전이효소(ALT)와 아스파르테이트 아미노전이효소(AST)는 간 기능을 측정한다(다만 AST는 폐, 췌장 등 다른 조직에서도 생성된다). 모의 만성 질환 환자에서 AST가 정상 범위 하한(8–33 units/L)이면서 ALT가 정상 범위(4–35 units/L)의 수 배에 달하는 합성 데이터 포인트는 생리학적으로 불가능할 것이다.

질의 전략

어떤 데이터 포인트에 레이블을 부여할지 결정하는 알고리즘은 그 목적에 따라 여러 범주로 분류할 수 있다:[^1]

*** 탐색과 활용의 균형**: 레이블을 부여할 예제의 선택은 데이터 공간 표현에 대한 탐색(exploration)과 활용(exploitation) 사이의 딜레마로 간주된다. 이 전략은 능동 학습 문제를 맥락적 밴딧(contextual bandit) 문제로 모델링하여 이러한 절충을 관리한다. 예를 들어, Bouneffouf 등[^7]은 능동 톰슨 샘플링(Active Thompson Sampling, ATS)이라는 순차 알고리즘을 제안하였는데, 이 알고리즘은 각 라운드에서 풀(pool)에 대한 샘플링 분포를 할당하고, 이 분포에서 하나의 포인트를 샘플링한 후, 해당 샘플 포인트의 레이블을 오라클에 질의한다. *** 기대 모델 변화**: 현재 모델을 가장 크게 변화시킬 수 있는 포인트에 레이블을 부여한다. *** 기대 오류 감소**: 모델의 일반화 오류를 가장 크게 줄일 수 있는 포인트에 레이블을 부여한다. *** 능동 학습을 위한 지수화 경사 탐색**:[^10] 이 논문에서 저자는 지수화 경사(exponentiated gradient, EG)-능동이라는 순차 알고리즘을 제안하며, 이는 최적의 무작위 탐색을 통해 모든 능동 학습 알고리즘을 개선할 수 있다. *** 불확실성 샘플링**: 현재 모델이 올바른 출력이 무엇인지에 대해 가장 확신이 낮은 포인트에 레이블을 부여한다. *** 위원회 질의**: 현재 레이블이 부여된 데이터로 다양한 모델을 훈련시키고, 레이블이 없는 데이터의 출력에 대해 투표한다; "위원회"의 의견 불일치가 가장 큰 포인트에 레이블을 부여한다. *** 다양한 부분공간 또는 파티션에서의 질의**:^11 기반 모델이 트리의 포레스트인 경우, 리프 노드는 원래 특징 공간의 (중복되는) 파티션을 나타낼 수 있다. 이를 통해 레이블 부여를 위해 중복되지 않거나 최소한으로 중복되는 파티션에서 인스턴스를 선택할 수 있는 가능성이 제공된다. *** 분산 감소**: 출력 분산을 최소화할 수 있는 포인트에 레이블을 부여하며, 분산은 오류의 구성 요소 중 하나이다. *** 등각 예측**: 새로운 데이터 포인트가 특정 방식으로 기존 데이터 포인트와 유사한 레이블을 가질 것으로 예측하며, 기존 예제 내에서의 유사도 정도를 사용하여 예측에 대한 신뢰도를 추정한다.[^16] *** 불일치 우선 최원거리 순회**: 주요 선택 기준은 현재 모델과 최근접 이웃 예측 간의 예측 불일치이다. 이는 잘못 예측된 데이터 포인트를 대상으로 한다. 두 번째 선택 기준은 이전에 선택된 데이터와의 거리로, 가장 먼 것을 우선으로 한다. 이는 선택된 데이터의 다양성을 최적화하는 것을 목표로 한다.[^12] *** 사용자 중심 레이블링 전략:** 산점도와 같은 그래프 및 도표에 차원 축소를 적용하여 학습을 수행한다. 그런 다음 사용자에게 편집된 데이터(범주형, 수치형, 관련성 점수, 두 인스턴스 간의 관계)에 레이블을 부여하도록 요청한다.[^5]

이러한 범주에 속하는 다양한 알고리즘이 연구되어 왔다.[^1][^4] 전통적인 능동 학습 전략이 뛰어난 성능을 달성할 수 있지만, 특정 상황에서 어떤 전략이 가장 적합한지를 사전에 예측하는 것은 종종 어렵다. 최근 몇 년간 메타 학습 알고리즘이 점점 더 주목받고 있다. 이들 중 일부는 수동으로 설계된 전략에 의존하는 대신 능동 학습 전략을 학습하는 문제를 해결하기 위해 제안되었다. '능동 학습에 대한 메타 학습 접근법'과 '전통적인 휴리스틱 기반 능동 학습'을 비교하는 벤치마크는 '능동 학습의 학습'이 전환점에 있는지에 대한 직관을 제공할 수 있다.[^17]

최소 마진 초평면

일부 능동 학습 알고리즘은 서포트 벡터 머신(SVM)을 기반으로 구축되며, SVM의 구조를 활용하여 어떤 데이터 포인트에 레이블을 부여할지 결정한다. 이러한 방법은 일반적으로 의 각 레이블이 없는 데이터의 마진 를 계산하고, 를 해당 데이터에서 분리 초평면까지의 차원 거리로 취급한다.

최소 마진 초평면 방법은 가 가장 작은 데이터가 SVM이 가장 불확실하게 판단하는 데이터이므로, 레이블을 부여하기 위해 에 배치해야 한다고 가정한다. 최대 마진 초평면과 같은 다른 유사한 방법은 가 가장 큰 데이터를 선택한다. 절충 방법은 가장 작은 와 가장 큰 를 혼합하여 선택한다.

같이 보기

- 기계 학습 연구를 위한 데이터셋 목록

- 표본 복잡도

- 베이즈 최적화

- 강화 학습

참고 문헌

- Improving Generalization with Active Learning, David Cohn, Les Atlas & Richard Ladner, Machine Learning 15, 201–221 (1994). https://doi.org/10.1007/BF00993277

- Balcan, Maria-Florina & Hanneke, Steve & Wortman, Jennifer. (2008). The True Sample Complexity of Active Learning.. 45-56. https://link.springer.com/article/10.1007/s10994-010-5174-y

- Active Learning and Bayesian Optimization: a Unified Perspective to Learn with a Goal, Francesco Di Fiore, Michela Nardelli, Laura Mainini, https://arxiv.org/abs/2303.01560v2

- Learning how to Active Learn: A Deep Reinforcement Learning Approach, Meng Fang, Yuan Li, Trevor Cohn, https://arxiv.org/abs/1708.02383v1

[^6] [^7] [^8] [^9] [^10] ^11 [^12]

각주

[^1]: cite web title = 능동 학습 문헌 조사 url = http://pages.cs.wisc.edu/~bsettles/pub/settles.activelearning.pdf author = Settles, Burr series= Computer Sciences Technical Report

[^2]: Rubens, Neil. 추천 시스템 핸드북. Springer US. (2016)

[^3]: Das, Shubhomoy. IEEE 제16회 데이터 마이닝 국제 학술대회. IEEE. (2016)

[^4]: cite web url=http://eprints.sics.se/3600/ title=자연어 처리 맥락에서의 능동 기계 학습에 관한 문헌 조사 series=SICS Technical Report T2009:06 author=Olsson,

[^5]: Bernard, Jürgen. 사용자 중심 능동 학습 알고리즘을 향하여. (June 2018)

[^6]: Lughofer, Edwin. 분류 시스템에서 운영자의 주석 노력을 줄이기 위한 하이브리드 능동 학습. (February 2012)

[^7]: Bouneffouf, Djallel. 신경 정보 처리

[^8]: Yang, Bishan. 제15회 ACM SIGKDD 지식 발견 및 데이터 마이닝 국제 학술대회 논문집 - KDD '09

[^9]: Cite journal doi=10.1007/s12530-012-9060-7 title = 충돌과 무지를 활용한 단일 패스 능동 학습 journal=Evolving Systems volume=3 issue=4 pages=251–271 year = 2012 last1 = Lughofer f

[^10]: Bouneffouf, Djallel. 능동 학습을 위한 지수화 경사 탐색. (8 January 2016)

[^12]: Zhao, Shuyang. 음향 이벤트 탐지를 위한 능동 학습

[^13]: Novikov, Ivan. MLIP 패키지: MPI와 능동 학습을 활용한 모멘트 텐서 포텐셜. (2021)

[^14]: DataRobot. 능동 학습 기계 학습: 개념과 작동 원리. DataRobot Inc.

[^15]: Wang, Liantao. 질의 합성 및 최근접 이웃 탐색을 통한 능동 학습. (2015-01-05)

[^16]: Makili, Lázaro Emílio. 등각 예측기를 활용한 능동 학습: 이미지 분류에의 적용. (2012-10-01)

[^17]: Desreumaux, Louis. 갈림길에 선 능동 학습 학습? 평가와 논의. (2020)

관련 인사이트

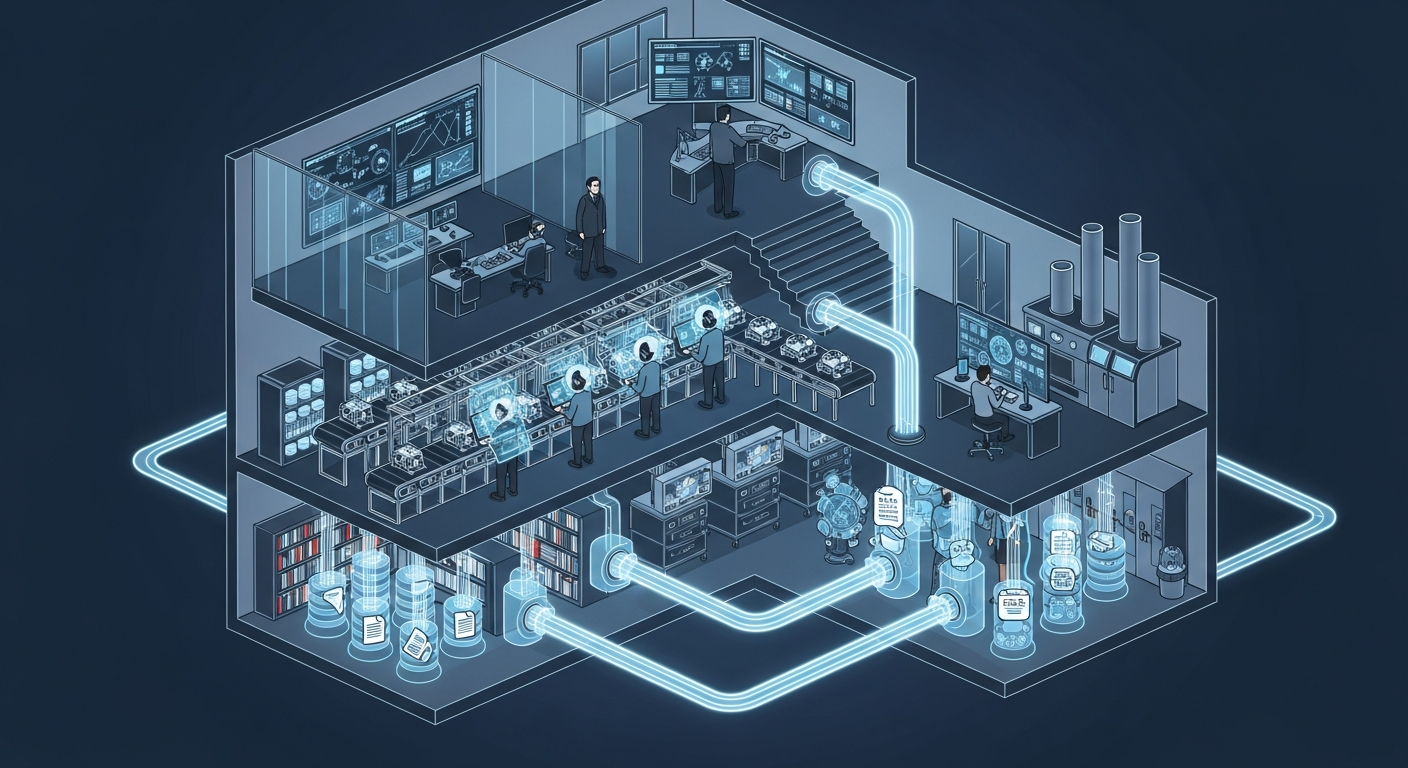

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.

ERP 20년, 나는 왜 AI를 얹기로 했나

ERP 20년차 제조IT본부장의 고백: 3,200만 행의 데이터가 잠들어 있었다. ERP를 바꾸지 않고 AI를 얹자, 일주일 걸리던 불량 분석이 수 초로 줄었다.