기호 인공지능

인공지능에서 기호 인공지능(symbolic artificial intelligence, 고전적 인공지능 또는 논리 기반 인공지능이라고도 함)[^10][^11]은 문제, 논리, 탐색의 고수준 기호적(사람이 읽을 수 있는) 표현에 기반한 인공지능 연구의 모든 방법론을 총칭하는 용어이다.[^12] 기호 인공지능은 논리 프로그래밍, 생성 규칙, 의미망 및 프레임 등의 도구를 사용하였으며, 지식 기반 시스템(특히 전문가 시스템), 기호 수학, 자동 정리 증명기, 온톨로지, 시맨틱 웹, 자동 계획 및 스케줄링 시스템 등의 응용 분야를 발전시켰다. 기호 인공지능 패러다임은 탐색, 기호 프로그래밍 언어, 에이전트, 다중 에이전트 시스템, 시맨틱 웹, 그리고 형식적 지식 및 추론 시스템의 강점과 한계에 관한 중요한 아이디어를 이끌어냈다.

기호 인공지능은 1950년대 중반부터 1990년대 중반까지 인공지능 연구의 지배적인 패러다임이었다. 1960년대와 1970년대의 연구자들은 기호적 접근법이 궁극적으로 인공 일반 지능을 갖춘 기계를 만드는 데 성공할 것이라고 확신했으며, 이를 자신들의 분야의 궁극적인 목표로 간주하였다.[^13] 논리 이론가(Logic Theorist)와 새뮤얼의 체커 게임 프로그램(Samuel's Checkers Playing Program) 같은 초기 성공으로 이어진 첫 번째 붐은 비현실적인 기대와 약속을 낳았고, 자금이 고갈되면서 첫 번째 AI 겨울이 뒤따랐다. 두 번째 붐(1969~1986)은 전문가 시스템의 부상, 기업 전문 지식을 포착할 수 있다는 전망, 그리고 기업들의 열광적인 수용과 함께 일어났다. 그 붐과 DEC의 XCON 등 일부 초기 성공 사례 이후에도 다시 실망이 뒤따랐다. 지식 획득의 어려움, 대규모 지식 기반 유지 관리 문제, 도메인 외 문제 처리에서의 취약성 등의 문제가 발생하였다. 이어서 두 번째 AI 겨울(1988~2011)이 찾아왔다. 이후 인공지능 연구자들은 불확실성 처리와 지식 획득의 근본적인 문제를 해결하는 데 집중하였다. 불확실성은 은닉 마르코프 모델, 베이즈 추론, 통계적 관계 학습 등의 형식적 방법으로 다루어졌다. 기호적 기계 학습은 버전 공간(Version Space), Valiant의 PAC 학습, Quinlan의 ID3 결정 트리 학습, 사례 기반 학습, 관계 학습을 위한 귀납 논리 프로그래밍 등의 기여를 통해 지식 획득 문제를 해결하였다.

하위 기호적 접근법인 신경망은 초기부터 연구되어 왔으며, 2012년에 강력하게 재등장하였다. 초기 사례로는 Rosenblatt의 퍼셉트론 학습 연구, Rumelhart, Hinton, Williams의 역전파 연구,[^14] 그리고 1989년 LeCun 등의 합성곱 신경망 연구가 있다.[^15] 그러나 신경망은 약 2012년까지는 성공적인 것으로 평가받지 못했다: "빅데이터가 보편화되기 전까지, 인공지능 커뮤니티의 일반적인 합의는 소위 신경망 접근법이 가망 없다는 것이었다. 시스템이 다른 방법에 비해 잘 작동하지 않았다. ... 2012년에 혁명이 일어났는데, Hinton과 함께 연구하던 팀을 포함한 여러 사람들이 GPU의 성능을 활용하여 신경망의 능력을 크게 향상시키는 방법을 알아냈다." 이후 수년간 딥러닝은 시각, 음성 인식, 음성 합성, 이미지 생성, 기계 번역 분야에서 눈부신 성공을 거두었으나, 컴퓨터 대수 시스템이나 증명 보조기와 같은 일부 영역에서는 기호적 접근법이 여전히 유용하게 쓰이고 있다.

그러나 지능 자체의 내재적 복잡성을 고려할 때, 기호 인공지능이 연결주의 인공지능에 의해 완전히 대체될 것인지, 아니면 기호 인공지능이 다시 부흥을 경험할 수 있을 것인지는 여전히 열린 질문으로 남아 있다. 보다 최근에는 Zhang 등의 연구가 적어도 이론적 수준에서는 서로 다른 기술 패러다임 간에 명확한 우위가 없다고 더욱 강하게 주장하였다.[^16]

역사

현재까지의 기호 AI의 간략한 역사는 아래와 같다. 시기 구분과 제목은 헨리 카우츠(Henry Kautz)의 2020년 AAAI 로버트 S. 엥겔모어 기념 강연과 더 상세한 위키백과의 AI 역사 문서에서 가져왔으며, 명확성을 높이기 위해 날짜와 제목을 약간 수정하였다.

첫 번째 AI의 여름: 비이성적 열광, 1948–1966

AI 초기 시도의 성공은 인공 신경망, 지식 표현, 휴리스틱 탐색이라는 세 가지 주요 분야에서 이루어졌으며, 이는 높은 기대감에 기여했다. 이 절에서는 카우츠가 요약한 초기 AI 역사를 정리한다.

인간 또는 동물의 인지나 행동에서 영감을 받은 접근법

사이버네틱스 접근법은 동물과 환경 간의 피드백 루프를 복제하려 했다. 사전 프로그래밍된 신경망에 기반하여 센서, 구동 및 조향용 모터, 그리고 제어용 진공관 7개를 갖춘 로봇 거북이가 이미 1948년에 제작되었다. 이 연구는 이후 신경망, 강화 학습, 상황 기반 로봇 공학 연구의 초기 선구자로 볼 수 있다.

초기 기호 AI의 중요한 프로그램은 논리 이론가(Logic Theorist)로, 1955–56년에 앨런 뉴웰(Allen Newell), 허버트 사이먼(Herbert Simon), 클리프 쇼(Cliff Shaw)가 작성했으며, 화이트헤드와 러셀의 *수학 원리(Principia Mathematica)*에서 38개의 기본 정리를 증명할 수 있었다. 뉴웰, 사이먼, 쇼는 이후 이 연구를 일반화하여 영역 독립적 문제 해결기인 GPS(General Problem Solver, 범용 문제 해결기)를 만들었다. GPS는 수단-목적 분석을 사용한 상태 공간 탐색을 통해 형식 연산자로 표현된 문제를 해결했다.

1960년대에 기호적 접근법은 게임 플레이, 기호 수학, 정리 증명과 같은 구조화된 환경에서 지능적 행동을 시뮬레이션하는 데 큰 성공을 거두었다. 1960년대 AI 연구는 카네기 멜론 대학교, 스탠퍼드, MIT, 그리고 (이후) 에든버러 대학교의 네 기관에 집중되어 있었다. 각 기관은 고유한 연구 스타일을 발전시켰다. 사이버네틱스나 인공 신경망에 기반한 초기 접근법들은 폐기되거나 배경으로 밀려났다.

허버트 사이먼과 앨런 뉴웰은 인간의 문제 해결 기술을 연구하고 이를 형식화하려 시도했으며, 그들의 연구는 인공지능 분야뿐만 아니라 인지과학, 운영 연구, 경영과학의 토대를 놓았다. 그들의 연구팀은 심리학 실험 결과를 활용하여 사람들이 문제를 해결하는 데 사용하는 기법을 시뮬레이션하는 프로그램을 개발했다. 카네기 멜론 대학교를 중심으로 한 이 전통은 결국 1980년대 중반 Soar 아키텍처의 개발로 절정에 달했다.

휴리스틱 탐색

나중에 전문가 시스템에서 사용되는 고도로 전문화된 영역 특화 지식 외에도, 초기 기호 AI 연구자들은 지식의 또 다른 보다 일반적인 응용을 발견했다. 이것을 휴리스틱, 즉 유망한 방향으로 탐색을 안내하는 경험 법칙이라고 불렀다: "기저 문제가 지수적으로 어려울 때 비열거적 탐색이 어떻게 실용적일 수 있는가? 사이먼과 뉴웰이 옹호한 접근법은 휴리스틱을 사용하는 것이다: 일부 입력에서 실패하거나 차선의 해를 출력할 수 있는 빠른 알고리즘이다." 또 다른 중요한 진전은 휴리스틱의 간헐적 오류에도 불구하고 해가 존재하면 반드시 찾을 수 있도록 보장하는 휴리스틱 적용 방법을 찾은 것이다: "A* 알고리즘은 완전하고 최적인 휴리스틱 안내 탐색을 위한 일반적 프레임워크를 제공했다. A*는 오늘날 거의 모든 AI 알고리즘 내에서 서브루틴으로 사용되지만 여전히 만능 해결책은 아니다; 완전성 보장은 최악의 경우 지수적 시간이라는 대가를 치른다."

지식 표현과 추론에 관한 초기 연구

초기 연구는 1차 논리를 강조하는 형식적 추론의 응용과 덜 형식적인 방식으로 상식적 추론을 다루려는 시도를 모두 포괄했다.

논리를 이용한 형식적 추론 모델링: "깔끔파"

사이먼과 뉴웰과 달리, 존 매카시(John McCarthy)는 기계가 인간 사고의 정확한 메커니즘을 시뮬레이션할 필요 없이, 사람들이 동일한 알고리즘을 사용하는지 여부와 관계없이 논리를 통해 추상적 추론과 문제 해결의 본질을 찾으려 할 수 있다고 생각했다. 스탠퍼드에 있는 그의 연구실(SAIL)은 지식 표현, 계획 수립, 학습을 포함한 광범위한 문제를 해결하기 위해 형식 논리를 사용하는 데 집중했다. 논리는 또한 에든버러 대학교와 유럽 다른 지역에서의 연구 초점이었으며, 이는 프로그래밍 언어 Prolog와 논리 프로그래밍 과학의 발전으로 이어졌다.

프레임과 스크립트를 이용한 암묵적 상식 지식 모델링: "지저분파"

MIT의 연구자들(마빈 민스키(Marvin Minsky)와 시모어 패퍼트(Seymour Papert) 등)은 시각과 자연어 처리의 어려운 문제를 해결하려면 임기응변적 해법이 필요하다는 것을 발견했다—그들은 (논리와 같은) 단순하고 일반적인 원리가 지능적 행동의 모든 측면을 포착할 수 없다고 주장했다. 로저 샹크(Roger Schank)는 그들의 "반논리적" 접근법을 (CMU와 스탠퍼드의 "깔끔한" 패러다임에 대비하여) "지저분한"이라고 묘사했다. 상식 지식 베이스(더그 레나트(Doug Lenat)의 Cyc 등)는 복잡한 개념을 하나씩 수작업으로 구축해야 하므로 "지저분한" AI의 한 예이다.

첫 번째 AI의 겨울: 무너진 꿈, 1967–1977

첫 번째 AI의 겨울은 충격이었다:

두 번째 AI의 여름: 지식이 힘이다, 1978–1987

지식 기반 시스템

약하고 영역 독립적인 방법의 한계가 점점 더 분명해지면서, 세 가지 전통 모두의 연구자들이 AI 응용 프로그램에 지식을 구축하기 시작했다. 지식 혁명은 고성능의 영역 특화 AI 응용에 지식이 기저에 있다는 인식에 의해 추동되었다.

에드워드 파이겐바움(Edward Feigenbaum)은 다음과 같이 말했다:

- "지식 안에 힘이 있다."[^1] 특정 영역에서의 높은 성능에는 일반적 지식과 고도로 영역 특화된 지식이 모두 필요하다는 것을 설명하기 위해서였다. 에드 파이겐바움과 더그 레나트는 이를 지식 원리(The Knowledge Principle)라 불렀다:

전문가 시스템의 성공

이 "지식 혁명"은 (에드워드 파이겐바움이 도입한) 전문가 시스템의 개발과 배포로 이어졌으며, 이는 상업적으로 성공한 최초의 AI 소프트웨어 형태였다.

주요 전문가 시스템은 다음과 같다:

- DENDRAL, 유기 분자의 화학식과 질량 분석기 판독 결과로부터 구조를 찾았다.

- MYCIN, 실험실 결과, 환자 이력, 의사 관찰을 해석하여 균혈증을 진단하고—필요시 추가 실험실 검사를 제안했다. "약 450개의 규칙으로 MYCIN은 일부 전문가 수준의 성능을 발휘했으며, 초보 의사보다 상당히 뛰어났다."

- INTERNIST와 CADUCEUS, 내과 진단을 다루었다. Internist는 피츠버그 대학교 의과대학 내과학 학과장의 전문 지식을 포착하려 했으며, CADUCEUS는 결국 최대 1000가지 다른 질병을 진단할 수 있었다.

- GUIDON, 전문가 문제 해결을 위해 구축된 지식 베이스를 교육 목적으로 재활용할 수 있음을 보여주었다.

- XCON, VAX 컴퓨터 구성을 위한 것으로, 당시 최대 90일이 걸릴 수 있는 힘든 과정이었다. XCON은 이 시간을 약 90분으로 줄였다.

DENDRAL은 지식 집약적 문제 해결에 의존한 최초의 전문가 시스템으로 간주된다. 에드 파이겐바움이 Communications of the ACM 인터뷰에서 아래와 같이 설명하고 있다, 에드 파이겐바움과의 인터뷰:

위에서 언급한 다른 전문가 시스템들은 DENDRAL 이후에 나왔다. MYCIN은 불확실성을 처리하기 위한 확신도(certainty factors)의 사용을 포함하여, 규칙의 지식 베이스와 기호적 추론 메커니즘이 결합된 전형적인 전문가 시스템 아키텍처를 잘 보여준다. GUIDON은 명시적 지식 베이스가 두 번째 응용인 교육으로 재활용될 수 있음을 보여주며, 지식 기반 응용의 특수한 유형인 지능형 교수 시스템의 한 예이다. 클랜시(Clancey)는 교육에 MYCIN의 규칙을 단순히 사용하는 것만으로는 충분하지 않으며, 대화 관리와 학생 모델링을 위한 규칙도 추가해야 한다는 것을 보여주었다. XCON은 DEC에 수백만 달러를 절약해 주었기 때문에 중요하며, 이는 미국의 거의 모든 주요 기업이 기업 전문 지식을 포착하고 보존하며 자동화하기 위한 전문가 시스템 그룹을 갖게 된 전문가 시스템 붐을 촉발했다:

체스 전문 지식은 딥 블루에 인코딩되었다. 1996년, 이를 통해 IBM의 딥 블루는 기호 AI의 도움을 받아 당시 세계 챔피언이었던 가리 카스파로프(Garry Kasparov)와의 체스 경기에서 승리할 수 있었다.[^17]

지식 기반 및 전문가 시스템의 아키텍처

모든 전문가 시스템의 시스템 아키텍처에서 핵심 구성 요소는 문제 해결을 위한 사실과 규칙을 저장하는 지식 베이스이다. 전문가 시스템 지식 베이스의 가장 단순한 접근법은 생성 규칙의 컬렉션 또는 네트워크이다. 생성 규칙은 If-Then 문과 유사한 관계로 기호를 연결한다. 전문가 시스템은 규칙을 처리하여 추론을 수행하고, 사람이 읽을 수 있는 기호를 사용하여 추가로 필요한 정보, 즉 어떤 질문을 할지를 결정한다. 예를 들어, OPS5, CLIPS와 그 후속인 Jess 및 Drools가 이 방식으로 작동한다.

전문가 시스템은 전방 연쇄(forward chaining)—증거에서 결론으로—또는 후방 연쇄(backward chaining)—목표에서 필요한 데이터와 전제 조건으로—방식으로 작동할 수 있다. Soar와 같은 더 발전된 지식 기반 시스템은 메타 수준 추론도 수행할 수 있는데, 이는 문제 해결 방법을 결정하고 문제 해결 전략의 성공을 모니터링하는 측면에서 자신의 추론에 대해 추론하는 것이다.

블랙보드 시스템은 지식 기반 또는 전문가 시스템 아키텍처의 두 번째 유형이다. 이것은 전문가 공동체가 문제를 해결하기 위해 할 수 있는 곳에서 점진적으로 기여하는 것을 모델링한다. 문제는 여러 수준의 추상화 또는 대안적 관점으로 표현된다. 전문가(지식 원천)는 기여할 수 있다고 인식할 때마다 자발적으로 참여한다. 잠재적인 문제 해결 행동은 문제 상황이 변함에 따라 업데이트되는 안건에 표현된다. 제어기는 각 기여가 얼마나 유용한지, 누가 다음 문제 해결 행동을 해야 하는지를 결정한다. 한 예로, BB1 블랙보드 아키텍처[^2]는 원래 인간이 여행에서 여러 작업을 수행하기 위해 계획을 세우는 방법에 대한 연구에서 영감을 받았다.[^3] BB1의 혁신은 제어 문제를 해결하는 데에도 동일한 블랙보드 모델을 적용한 것이다. 즉, 제어기는 계획이나 문제 해결이 얼마나 잘 진행되고 있는지를 모니터링하고 목표나 시간 등의 조건이 변경되면 한 전략에서 다른 전략으로 전환할 수 있는 지식 원천을 통해 메타 수준 추론을 수행했다. BB1은 건설 현장 계획, 지능형 교수 시스템, 실시간 환자 모니터링 등 여러 영역에 적용되었다.

두 번째 AI의 겨울, 1988–1993

AI 붐의 절정기에 Symbolics, LMI, Texas Instruments와 같은 회사들은 AI 응용 프로그램 및 연구 개발을 가속화하기 위해 특별히 설계된 LISP 머신을 판매하고 있었다. 또한 Teknowledge, Inference Corporation 등 여러 인공지능 회사들이 기업에 전문가 시스템 셸, 교육, 컨설팅을 판매하고 있었다.

불행히도 AI 붐은 지속되지 않았으며, 카우츠가 그 뒤를 이은 두 번째 AI의 겨울을 가장 잘 묘사하고 있다:

더 엄밀한 기초의 추가, 1993–2011

불확실한 추론

통계적 접근법과 논리의 확장이 모두 시도되었다.

하나의 통계적 접근법인 은닉 마르코프 모델은 이미 1980년대에 음성 인식 연구를 통해 대중화되었다. 이후 1988년에 주디아 펄(Judea Pearl)은 그의 저서 *확률적 추론이 가능한 지능 시스템: 그럴듯한 추론의 네트워크(Probabilistic Reasoning in Intelligent Systems: Networks of Plausible Inference)*의 출판을 통해 불확실한 추론을 건전하면서도 효율적으로 처리하는 방법으로 베이즈 네트워크의 사용을 대중화했으며, 베이즈 접근법은 전문가 시스템에 성공적으로 적용되었다. 더 나중인 1990년대에는 확률과 논리 공식을 결합하는 접근법인 통계적 관계 학습이 등장하여, 마르코프 논리 네트워크나 확률적 소프트 논리 등을 통해 확률과 1차 논리를 결합할 수 있게 되었다.

불확실성을 지원하기 위한 1차 논리의 다른 비확률적 확장도 시도되었다. 예를 들어, 비단조 추론은 진리 유지 시스템과 함께 사용될 수 있었다. 진리 유지 시스템은 모든 추론에 대한 가정과 정당화를 추적했다. 가정이 틀린 것으로 밝혀지거나 모순이 도출되면 추론을 철회할 수 있었다. 어떤 규칙이 적용되어 추론이 생성되었는지를 설명하고, 기저의 추론과 규칙을 거쳐 근본 가정까지 추적함으로써 추론에 대한 설명을 제공할 수 있었다. 로트피 자데(Lotfi Zadeh)는 모호성의 표현을 다루기 위해 다른 종류의 확장을 도입했다. 예를 들어, 한 남자가 얼마나 "무거운지" 또는 "큰지"를 결정할 때 명확한 "예" 또는 "아니오" 답이 없는 경우가 많으며, 무거움이나 큰 키에 대한 술어는 대신 0과 1 사이의 값을 반환한다. 이러한 값은 술어가 참인 정도를 나타낸다. 그의 퍼지 논리는 이러한 값의 조합을 논리 공식을 통해 전파하는 수단도 제공했다.

기계 학습

기호적 기계 학습 접근법은 지식 획득 병목 현상을 해결하기 위해 연구되었다. 가장 초기의 것 중 하나가 Meta-DENDRAL이다. Meta-DENDRAL은 스펙트럼에 대해 검증할 그럴듯한 규칙 가설을 생성하기 위해 생성 및 검증 기법을 사용했다. 영역 및 과제 지식이 검증 대상 후보 수를 관리 가능한 크기로 줄였다. 파이겐바움은 Meta-DENDRAL을 다음과 같이 묘사했다:

Meta-DENDRAL의 지식 집약적 접근법과 대조적으로, 로스 퀸란(Ross Quinlan)은 영역 독립적인 통계적 분류 접근법인 의사결정 트리 학습을 발명하여, 처음에는 ID3[^18]로 시작한 후 나중에 C4.5[^19]로 기능을 확장했다. 생성된 의사결정 트리는 사람이 해석할 수 있는 분류 규칙을 가진 투명한(glass box) 해석 가능한 분류기이다.

기계 학습 이론의 이해에서도 진전이 있었다. 톰 미첼(Tom Mitchell)은 학습을 지금까지 본 예제와 일치하는 모든 실행 가능한 가설을 포괄하는 상위의 더 일반적인 경계와 하위의 더 구체적인 경계를 가진 가설 공간에서의 탐색으로 설명하는 버전 공간 학습을 도입했다.[^20] 보다 형식적으로, 발리안트(Valiant)는 기계 학습의 수학적 분석을 위한 프레임워크인 아마도 대략 정확한 학습(PAC Learning)을 도입했다.[^21]

기호적 기계 학습은 예제를 통한 학습 이상을 포괄했다. 예를 들어, 존 앤더슨(John Anderson)은 기술 연습이 선언적 형식에서 절차적 형식으로의 규칙 편집을 초래하는 인간 학습의 인지 모델을 그의 ACT-R 인지 아키텍처로 제공했다. 예를 들어, 학생은 "보각은 합이 180도인 두 각이다"를 여러 다른 절차적 규칙으로 학습할 수 있다. 예컨대, 하나의 규칙은 X와 Y가 보각이고 X를 알면, Y는 180 - X가 된다고 말할 수 있다. 그는 자신의 접근법을 "지식 편집(knowledge compilation)"이라 불렀다. ACT-R은 학습과 기억 유지 같은 인간 인지의 측면을 모델링하는 데 성공적으로 사용되었다. ACT-R은 또한 인지 튜터라 불리는 지능형 교수 시스템에서 기하학, 컴퓨터 프로그래밍, 대수학을 학생들에게 성공적으로 가르치는 데 사용된다.

귀납 논리 프로그래밍은 입출력 예제로부터 논리 프로그램을 합성할 수 있는 또 다른 학습 접근법이었다. 예를 들어, 에후드 샤피로(Ehud Shapiro)의 MIS(모델 추론 시스템)는 예제로부터 Prolog 프로그램을 합성할 수 있었다.[^22] 존 R. 코자(John R. Koza)는 유전 알고리즘을 프로그램 합성에 적용하여 유전 프로그래밍을 만들었으며, 이를 사용하여 LISP 프로그램을 합성했다. 마지막으로, 조하르 만나(Zohar Manna)와 리처드 월딩거(Richard Waldinger)는 사양의 정확성을 증명하는 과정에서 함수형 프로그램을 합성하는 보다 일반적인 프로그램 합성 접근법을 제공했다.[^23]

논리의 대안으로, 로저 샹크(Roger Schank)는 사례 기반 추론(CBR)을 도입했다. 그의 저서 동적 기억(Dynamic Memory)[^4]에서 설명된 CBR 접근법은 먼저 향후 사용을 위해 핵심 문제 해결 사례를 기억하고 적절한 경우 일반화하는 데 초점을 맞춘다. 새로운 문제에 직면하면, CBR은 가장 유사한 이전 사례를 검색하여 현재 문제의 구체적 상황에 맞게 적응시킨다.[^24] 논리의 또 다른 대안인 유전 알고리즘과 유전 프로그래밍은 진화적 학습 모델에 기반하며, 규칙 집합이 개체군으로 인코딩되고, 규칙이 개체의 행동을 지배하며, 적자 생존 선택이 여러 세대에 걸쳐 부적합한 규칙 집합을 제거한다.[^25]

기호적 기계 학습은 개념, 규칙, 휴리스틱, 문제 해결 학습에 적용되었다. 위에 언급된 것 외의 접근법은 다음과 같다:

- 지시 또는 조언에서 학습—즉, 조언으로 제시된 인간의 지시를 받아 특정 상황에서 이를 어떻게 운용할지 결정하는 것. 예를 들어, 하트 게임에서 "점수를 받지 않도록" 하는 정확한 방법을 학습하는 것.[^26]

- 사례에서 학습—훈련 중 주제 전문가(SME)의 피드백을 받아 성능을 향상시키는 것. 문제 해결이 실패하면, 전문가에게 질의하여 문제 해결을 위한 새로운 사례를 학습하거나, 한 사례가 다른 사례보다 왜 더 관련성이 있는지에 대한 새로운 설명을 학습한다. 예를 들어, Protos 프로그램은 청각학자와 상호작용하여 이명 사례를 진단하는 법을 학습했다.[^27]

- 유추에 의한 학습—과거에 본 유사한 문제를 기반으로 문제 해법을 구성한 후, 새로운 상황이나 영역에 맞게 해법을 수정하는 것.[^28][^29]

- 도제 학습 시스템—인간의 문제 해결을 관찰하여 새로운 해법을 학습하는 것. 영역 지식은 새로운 해법이 왜 정확한지, 해법을 어떻게 일반화할 수 있는지를 설명한다. LEAP는 인간 설계자를 관찰하여 VLSI 회로를 설계하는 법을 학습했다.[^30]

- 발견에 의한 학습—즉, 실험을 수행할 과제를 만들고 결과에서 학습하는 것. 예를 들어, 더그 레나트의 Eurisko는 트래블러 롤플레잉 게임에서 2년 연속으로 인간 플레이어를 이기는 휴리스틱을 학습했다.[^31]

- 매크로 연산자 학습—즉, 기본적인 문제 해결 행동 시퀀스에서 학습할 유용한 매크로 연산자를 탐색하는 것. 좋은 매크로 연산자는 더 추상적인 수준에서 문제를 해결할 수 있게 하여 문제 해결을 단순화한다.[^32]

딥러닝과 신경-기호 AI 2011–현재

딥러닝의 부상과 함께, 기호 AI 접근법은 딥러닝과 상호 보완적인 것으로 비교되어 왔다. "...AI 연구자들이 인간의 추론과 의사결정에 관한 카너먼의 연구—그의 저서 *생각에 관한 생각(Thinking, Fast and Slow)*에 반영된—와 소위 'AI 시스템 1과 2' 사이에 여러 차례 유사점을 그어왔으며, 이는 원칙적으로 각각 딥러닝과 기호적 추론으로 모델링될 것이다." 이 관점에서, 기호적 추론은 숙고적 추론, 계획 수립, 설명에 더 적합하고, 딥러닝은 잡음이 있는 데이터의 지각 응용에서 빠른 패턴 인식에 더 적합하다.[^5][^6]

신경-기호 AI: 신경망과 기호적 접근법의 통합

신경-기호 AI는 강건한 추론, 학습, 인지 모델링이 가능한 AI를 지원하기 위해, 각각의 강점과 약점을 상호 보완적으로 다루는 방식으로 신경망과 기호 아키텍처를 통합하려 시도한다. 발리안트와 많은 다른 연구자들이 주장했듯이, 풍부한 계산적 인지 모델의 효과적 구축에는 건전한 기호적 추론과 효율적인 (기계) 학습 모델의 결합이 필요하다. 게리 마커스(Gary Marcus)도 마찬가지로 다음과 같이 주장한다: "적절하고 자동화된 방식으로 풍부한 인지 모델을 구축하려면 하이브리드 아키텍처, 풍부한 사전 지식, 정교한 추론 기법의 삼위일체가 없이는 불가능하다." 특히: "AI에 대한 강건하고 지식 주도적인 접근법을 구축하려면 우리의 도구 상자에 기호 조작의 메커니즘이 있어야 한다. 유용한 지식의 너무 많은 부분이 추상적이어서 추상화를 표현하고 조작하는 도구 없이는 불가능하며, 현재까지 그러한 추상적 지식을 신뢰할 수 있게 조작할 수 있는 유일한 메커니즘은 기호 조작 장치이다."

헨리 카우츠(Henry Kautz), 프란체스카 로시(Francesca Rossi), 바트 셀만(Bart Selman)도 종합을 주장했다. 그들의 주장은 대니얼 카너먼(Daniel Kahneman)의 저서 *생각에 관한 생각(Thinking, Fast and Slow)*에서 논의된 두 가지 종류의 사고를 다룰 필요성에 기반한다. 카너먼은 인간의 사고가 시스템 1과 시스템 2의 두 가지 구성 요소를 가진다고 설명한다. 시스템 1은 빠르고, 자동적이고, 직관적이며 무의식적이다. 시스템 2는 더 느리고, 단계적이며, 명시적이다. 시스템 1은 패턴 인식에 사용되는 유형이고, 시스템 2는 계획 수립, 연역, 숙고적 사고에 훨씬 더 적합하다. 이 관점에서 딥러닝은 첫 번째 유형의 사고를 가장 잘 모델링하고, 기호적 추론은 두 번째 유형을 가장 잘 모델링하며, 둘 다 필요하다.

가르세즈(Garcez)와 램(Lamb)은 이 분야의 연구가 그들의 2002년 신경기호 학습 시스템에 관한 저서부터 최소 지난 20년간 진행되어 왔다고 설명한다. 신경-기호 추론에 관한 일련의 워크숍이 2005년 이후 매년 개최되고 있다.^33

가르세즈 등은 2015년 논문 *신경-기호 학습과 추론: 기여와 과제(Neural-Symbolic Learning and Reasoning: Contributions and Challenges)*에서 다음과 같이 주장한다:

통합을 위한 접근법은 다양하다. 헨리 카우츠의 신경-기호 아키텍처 분류법과 일부 예시는 다음과 같다:

- 기호 신경 기호(Symbolic Neural symbolic)—많은 자연어 처리 신경 모델의 현재 접근법으로, 단어나 하위 단어 토큰이 대규모 언어 모델의 궁극적인 입력이자 출력이다. 예시로 BERT, RoBERTa, GPT-3 등이 있다.

- 기호신경—알파고(AlphaGo)로 예시되며, 기호적 기법이 신경 기법을 호출하는 데 사용된다. 이 경우 기호적 접근법은 몬테카를로 트리 탐색이고, 신경 기법은 게임 위치를 평가하는 방법을 학습한다.

- 신경|기호(Neural|Symbolic)—신경 아키텍처를 사용하여 지각 데이터를 기호와 관계로 해석한 후 기호적으로 추론한다.

- 신경:기호 → 신경(Neural:Symbolic → Neural)—기호적 추론에 의존하여 훈련 데이터를 생성하거나 레이블링하고, 이를 딥러닝 모델이 학습한다. 예를 들어, Macsyma와 같은 기호 수학 시스템을 사용하여 예제를 만들거나 레이블링하여 기호 계산을 위한 신경 모델을 훈련시키는 것이다.

- 신경_{기호}(Neural_{Symbolic})—기호 규칙에서 생성된 신경망을 사용한다. 한 예로 신경 정리 증명기(Neural Theorem Prover)[^34]가 있으며, 이는 지식 베이스 규칙과 항에서 생성된 AND-OR 증명 트리로부터 신경망을 구성한다. 논리 텐서 네트워크(Logic Tensor Networks)[^35]도 이 범주에 속한다.

- 신경기호—신경 모델이 직접 기호적 추론 엔진을 호출할 수 있도록 한다. 예를 들어, 행동을 수행하거나 상태를 평가하기 위해서이다.

많은 핵심 연구 질문이 남아 있다:

- 신경망과 기호 아키텍처를 통합하는 최선의 방법은 무엇인가?[^7]

- 기호 구조는 신경망 내에서 어떻게 표현되고 추출되어야 하는가?

- 상식 지식은 어떻게 학습되고 추론되어야 하는가?

- 논리적으로 인코딩하기 어려운 추상적 지식은 어떻게 처리할 수 있는가?

기법과 기여

이 섹션은 위키백과의 다른 많은 상세 문서로 이어지는 전반적인 맥락에서 기법과 기여에 대한 개요를 제공한다. 기계 학습과 불확실한 추론에 관한 섹션은 역사 섹션에서 앞서 다루고 있다.

AI 프로그래밍 언어

미국에서 마지막 기호주의 AI 붐 시기의 핵심 AI 프로그래밍 언어는 LISP였다. LISP는 FORTRAN 다음으로 오래된 프로그래밍 언어로, 1958년 존 매카시(John McCarthy)에 의해 만들어졌다. LISP는 빠른 프로그램 개발을 지원하기 위해 최초의 읽기-평가-출력 루프(read-eval-print loop)를 제공했다. 컴파일된 함수와 인터프리트된 함수를 자유롭게 혼합할 수 있었다. 프로그램 추적, 단계별 실행, 중단점도 제공되었으며, 중단점이나 오류 발생 시 값이나 함수를 변경하고 계속 실행할 수 있는 기능도 함께 제공되었다. LISP는 최초의 자기 호스팅 컴파일러를 가졌는데, 이는 컴파일러 자체가 원래 LISP로 작성된 후 인터프리터 방식으로 실행되어 컴파일러 코드를 컴파일했다는 것을 의미한다.

LISP가 개척하여 다른 프로그래밍 언어로 확산된 다른 핵심 혁신들은 다음과 같다:

- 가비지 컬렉션

- 동적 타이핑

- 고차 함수

- 재귀

- 조건문 프로그램 자체가 다른 프로그램이 조작할 수 있는 데이터 구조였기 때문에, 더 높은 수준의 언어를 쉽게 정의할 수 있었다.

미국과 대조적으로, 유럽에서 같은 시기의 핵심 AI 프로그래밍 언어는 Prolog였다. Prolog는 읽기-평가-출력 루프로 질의할 수 있는 내장 사실 및 절 저장소를 제공했다. 이 저장소는 지식 기반으로 기능할 수 있었고, 절은 규칙이나 제한된 형태의 논리로 기능할 수 있었다. 일차 논리의 부분집합으로서 Prolog는 폐쇄 세계 가정—알려지지 않은 사실은 거짓으로 간주—과 원시 항에 대한 고유 이름 가정—예를 들어 식별자 barack_obama는 정확히 하나의 객체를 지칭하는 것으로 간주—에 기반한 혼 절(Horn clause)을 사용했다. 역추적과 단일화는 Prolog에 내장되어 있다.

알랭 콜메라우어(Alain Colmerauer)와 필리프 루셀(Philippe Roussel)이 Prolog의 발명자로 인정받고 있다. Prolog는 로버트 코왈스키(Robert Kowalski)가 발명한 논리 프로그래밍의 한 형태이다. 그 역사는 패턴 지향 메서드 호출 기능을 갖춘 단언 데이터베이스인 칼 휴잇(Carl Hewitt)의 PLANNER에 의해서도 영향을 받았다. 더 자세한 내용은 PLANNER 문서의 Prolog 기원 섹션을 참조하라.

Prolog는 또한 일종의 선언형 프로그래밍이다. 프로그램을 기술하는 논리 절이 직접 해석되어 지정된 프로그램을 실행한다. 명령형 프로그래밍 언어의 경우처럼 명시적인 일련의 동작이 필요하지 않다.

일본은 제5세대 프로젝트에서 Prolog를 지지하며, 고성능을 위한 특수 하드웨어 구축을 의도했다. 마찬가지로 LISP 머신은 LISP를 실행하기 위해 제작되었지만, 제2차 AI 붐이 붕괴로 전환되면서 이들 기업은 이제 LISP나 Prolog를 비슷한 속도로 네이티브 실행할 수 있는 새로운 워크스테이션과 경쟁할 수 없게 되었다. 더 자세한 내용은 역사 섹션을 참조하라.

Smalltalk도 영향력 있는 AI 프로그래밍 언어였다. 예를 들어, Smalltalk은 메타클래스를 도입했으며, Flavors 및 CommonLoops와 함께 현재 표준 Lisp 방언인 Common Lisp의 일부인 Common Lisp 객체 시스템(CLOS)에 영향을 미쳤다. CLOS는 다중 상속을 허용하는 Lisp 기반 객체 지향 시스템으로, 클래스와 메타클래스 모두에 대한 점진적 확장을 추가로 제공하여 런타임 메타객체 프로토콜을 가능하게 한다.

다른 AI 프로그래밍 언어에 대해서는 이 인공지능용 프로그래밍 언어 목록을 참조하라. 현재 다중 패러다임 프로그래밍 언어인 Python이 가장 인기 있는 프로그래밍 언어인데, 이는 부분적으로 데이터 과학, 자연어 처리, 딥러닝을 지원하는 광범위한 패키지 라이브러리 덕분이다. Python은 읽기-평가-출력 루프, 고차 함수와 같은 함수형 요소, 그리고 메타클래스를 포함하는 객체 지향 프로그래밍을 포함한다.

탐색

탐색은 계획 수립, 제약 조건 만족, 체커, 체스, 바둑과 같은 게임 플레이를 포함한 다양한 종류의 문제 해결에서 발생한다. 가장 잘 알려진 AI 탐색 트리 탐색 알고리즘은 너비 우선 탐색, 깊이 우선 탐색, A*, 몬테카를로 탐색이다. 부울 만족 가능성을 위한 핵심 탐색 알고리즘은 WalkSAT, 충돌 기반 절 학습, DPLL 알고리즘이다. 게임 플레이 시 적대적 탐색을 위해서는 알파-베타 가지치기, 분기 한정법, 미니맥스가 초기 기여로 존재했다.

지식 표현과 추론

지식을 표현하고 그 표현을 통해 추론하는 여러 가지 다른 접근법이 연구되어 왔다. 아래는 지식 표현과 자동 추론에 대한 접근법의 간략한 개요이다.

지식 표현

의미망, 개념 그래프, 프레임, 논리는 모두 도메인 지식, 문제 해결 지식, 언어의 의미적 의미와 같은 지식을 모델링하는 접근법이다. 온톨로지는 도메인 내의 핵심 개념과 그 관계를 모델링한다. 온톨로지의 예로는 YAGO, WordNet, DOLCE가 있다. DOLCE는 모든 도메인에 사용할 수 있는 상위 온톨로지의 예이며, WordNet은 온톨로지로도 볼 수 있는 어휘 자원이다. YAGO는 위키백과에서 추출한 사실을 WordNet 동의어 집합과 정렬하기 위해 WordNet을 온톨로지의 일부로 통합한다. 질병 온톨로지(Disease Ontology)는 현재 사용되고 있는 의학 온톨로지의 예이다.

기술 논리(Description logic)는 온톨로지의 자동 분류와 불일치하는 분류 데이터를 탐지하기 위한 논리이다. OWL은 기술 논리로 온톨로지를 표현하는 데 사용되는 언어이다. Protégé는 OWL 온톨로지를 읽어 들인 후 HermiT과 같은 연역적 분류기로 일관성을 검사할 수 있는 온톨로지 편집기이다.[^8]

일차 논리는 기술 논리보다 더 일반적이다. 아래에서 논의하는 자동 정리 증명기는 일차 논리에서 정리를 증명할 수 있다. 혼 절 논리는 일차 논리보다 더 제한적이며 Prolog와 같은 논리 프로그래밍 언어에서 사용된다. 일차 논리의 확장에는 시간을 다루기 위한 시제 논리, 에이전트 지식에 대해 추론하기 위한 인식 논리, 가능성과 필연성을 다루기 위한 양상 논리, 논리와 확률을 함께 다루기 위한 확률적 논리가 포함된다.

자동 정리 증명

일차 논리를 위한 자동 정리 증명기의 예는 다음과 같다:

- Prover9

- ACL2

- Vampire Prover9는 Mace4 모델 검사기와 함께 사용할 수 있다. ACL2는 귀납법에 의한 증명을 처리할 수 있는 정리 증명기로, Nqthm으로도 알려진 Boyer-Moore 정리 증명기의 후손이다.

지식 기반 시스템에서의 추론

지식 기반 시스템은 절차적 코드와 도메인 지식을 분리하여 도메인 간 재사용성을 높이기 위해, 일반적으로 규칙으로 구성된 명시적 지식 기반을 갖는다. 별도의 추론 엔진이 규칙을 처리하고 지식 저장소를 추가, 삭제 또는 수정한다.

전방 연쇄 추론 엔진이 가장 일반적이며, CLIPS와 OPS5에서 볼 수 있다. 역방향 연쇄는 더 제한된 논리적 표현인 혼 절이 사용되는 Prolog에서 발생한다. 패턴 매칭, 특히 단일화는 Prolog에서 사용된다.

단순히 사용 가능한 행동 중 하나를 선택하는 것이 아니라, 다음에 무엇을 할지에 대한 추론이 이루어질 때 더 유연한 종류의 문제 해결이 발생한다. 이러한 종류의 메타 수준 추론은 Soar와 BB1 블랙보드 아키텍처에서 사용된다.

ACT-R과 같은 인지 아키텍처는 자주 사용되는 지식을 더 높은 수준의 청크로 컴파일하는 능력과 같은 추가적인 기능을 가질 수 있다.

상식 추론

마빈 민스키(Marvin Minsky)는 사무실과 같은 일반적인 시각적 상황을 해석하는 방법으로 프레임을 처음 제안했으며, 로저 섕크(Roger Schank)는 이 아이디어를 외식과 같은 일상적인 루틴을 위한 스크립트로 확장했다. Cyc는 유용한 상식 지식을 포착하려 시도해 왔으며, 특정 종류의 도메인별 추론을 처리하기 위한 "마이크로 이론"을 갖추고 있다.

벤저민 쿠이퍼스(Benjamin Kuipers)의 QSIM[^9]과 같은 정성적 시뮬레이션은, 예를 들어 스토브 위 냄비에서 액체를 가열할 때 무슨 일이 일어나는지에 대한 소박한 물리학에 관한 인간의 추론을 근사한다. 우리는 온도, 끓는점, 대기압과 같은 다른 세부 사항을 모르더라도 액체가 가열되어 끓어넘칠 수 있다고 예상한다.

마찬가지로, 앨런의 시간 구간 대수(Allen's temporal interval algebra)는 시간에 대한 추론의 단순화이고, 영역 연결 미적분(Region Connection Calculus)은 공간적 관계에 대한 추론의 단순화이다. 둘 다 제약 조건 해결기로 풀 수 있다.

제약 조건과 제약 조건 기반 추론

제약 조건 해결기는 일차 논리보다 더 제한된 종류의 추론을 수행한다. RCC나 시간 대수에 대한 시공간 제약 조건 집합을 단순화할 수 있으며, 워들(Wordle), 스도쿠, 복면산 문제 등 다른 종류의 퍼즐 문제도 풀 수 있다. 제약 논리 프로그래밍은 예를 들어 제약 처리 규칙(CHR)을 사용하여 스케줄링 문제를 해결하는 데 사용될 수 있다.

자동 계획 수립

범용 문제 해결기(GPS)는 계획 수립을 문제 해결로 취급하며 계획을 생성하기 위해 수단-목적 분석을 사용했다. STRIPS는 계획 수립을 정리 증명으로 보는 다른 접근법을 취했다. Graphplan은 초기 상태에서 전방으로, 또는 목표 상태에서 후방으로 순차적으로 행동을 선택하는 대신, 계획 수립에 최소 약속 접근법을 취한다. Satplan은 계획 수립 문제를 부울 만족 가능성 문제로 환원하는 계획 수립 접근법이다.

자연어 처리

자연어 처리는 의도된 의미를 반드시 이해하지 않고도 주제 식별과 같은 작업을 수행하기 위해 언어를 데이터로 취급하는 데 초점을 맞춘다. 이와 대조적으로, 자연어 이해는 의미 표현을 구성하고 이를 질문 답변과 같은 추가 처리에 사용한다.

구문 분석, 토큰화, 맞춤법 교정, 품사 태깅, 명사구 및 동사구 청킹은 모두 기호주의 AI에서 오랫동안 처리해 온 자연어 처리의 측면이지만, 이후 딥러닝 접근법에 의해 개선되었다. 기호주의 AI에서는 담화 표현 이론과 일차 논리가 문장 의미를 표현하는 데 사용되었다. 잠재 의미 분석(LSA)과 명시적 의미 분석도 문서의 벡터 표현을 제공했다. 후자의 경우, 벡터 구성 요소는 위키백과 문서로 명명된 개념으로 해석될 수 있다.

트랜스포머 모델에 기반한 새로운 딥러닝 접근법은 이제 이러한 초기 기호주의 AI 접근법을 능가하며 자연어 처리에서 최첨단 성능을 달성했다. 그러나 트랜스포머 모델은 불투명하며 문장과 문서에 대해 인간이 해석 가능한 의미 표현을 아직 생성하지 못한다. 대신, 벡터 구성 요소의 의미가 불투명한 작업별 벡터를 생성한다.

에이전트와 다중 에이전트 시스템

에이전트는 자신이 인식하고 어떤 의미에서 행동하는 환경에 내장된 자율 시스템이다. 러셀(Russell)과 노빅(Norvig)의 인공지능 표준 교과서는 점차 정교해지는 에이전트 아키텍처를 반영하도록 구성되어 있다. 에이전트의 정교함은 단순한 반응형 에이전트부터, 세계 모델과 자동 계획 수립 기능을 갖춘 에이전트, 가능하게는 BDI 에이전트—즉, 신념, 욕구, 의도를 가진 에이전트—또는 대안적으로 시간에 걸쳐 행동을 선택하도록 학습된 강화 학습 모델을 가진 에이전트, 나아가 인식을 위한 딥러닝을 포함하는 신경-기호 아키텍처[^7]와 같은 대안적 아키텍처의 조합[^36]까지 다양하다.

이와 대조적으로, 다중 에이전트 시스템은 지식 질의 및 조작 언어(KQML)와 같은 에이전트 간 통신 언어를 사용하여 서로 소통하는 다수의 에이전트로 구성된다. 에이전트들이 모두 동일한 내부 아키텍처를 가질 필요는 없다. 다중 에이전트 시스템의 장점에는 에이전트 간 작업 분배 능력과 에이전트 손실 시 내결함성 증가가 포함된다. 연구 문제에는 에이전트가 합의에 도달하는 방법, 분산 문제 해결, 다중 에이전트 학습, 다중 에이전트 계획 수립, 분산 제약 조건 최적화가 포함된다.

논쟁

기호 AI에서는 초기부터 논쟁이 발생했는데, 분야 내부에서는—예를 들어 논리주의자(논리 옹호파인 "깔끔파")와 비논리주의자(논리 반대파인 "지저분파") 사이에서—그리고 AI를 수용하면서도 기호적 접근을 거부한 사람들—주로 연결주의자들—과 분야 외부의 사람들 사이에서 논쟁이 있었다. 분야 외부의 비판은 주로 철학자들로부터 지적 근거에 기반하여 제기되었지만, 특히 두 차례의 AI 겨울 동안 자금 지원 기관으로부터도 비판이 있었다.

프레임 문제: 1차 논리의 지식 표현 과제

단순한 1차 논리를 사용하여 동적 영역에 대해 추론하는 데 한계가 발견되었다. 행동이 성공하기 위한 전제 조건을 열거하는 것과 행동이 수행된 후 변하지 않은 것에 대한 공리를 제공하는 것 모두에서 문제가 발견되었다.

매카시와 헤이스는 1969년 논문 "인공지능의 관점에서 본 몇 가지 철학적 문제"에서 프레임 문제를 제시했다. 간단한 예로 "한 사람이 다른 사람과 대화를 시작할 수 있음을 증명하는 것"에서, "어떤 사람이 전화기를 가지고 있다면 전화번호부에서 번호를 찾은 후에도 여전히 전화기를 가지고 있다"는 공리가 추론이 성공하기 위해 필요하다. 다른 영역의 행동에 대해서도 무엇이 변하지 않았는지를 명시하기 위해 유사한 공리가 필요했다.

자격 문제라 불리는 유사한 문제는 행동이 성공하기 위한 전제 조건을 열거하려 할 때 발생한다. 무한히 많은 병리적 조건을 상상할 수 있는데, 예를 들어 배기관에 바나나가 끼어 있으면 자동차가 정상적으로 작동하지 못할 수 있다.

프레임 문제를 해결하기 위한 매카시의 접근법은 한정이었는데, 이는 변하지 않는 모든 것을 명시적으로 지정하지 않아도 변하는 것만 지정하면 되는 행동으로부터 추론을 할 수 있는 일종의 비단조 논리였다. 다른 비단조 논리들은 모순을 일으키는 믿음을 수정하는 진리 유지 시스템을 제공했다.

더 개방적인 영역을 다루는 다른 방법으로는 확률적 추론 시스템과 새로운 개념과 규칙을 학습하는 기계 학습이 있었다. 매카시의 조언 수용기는 인간이 단언이나 규칙의 형태로 제공하는 새로운 지식을 통합할 수 있었으므로 여기서 영감의 원천으로 볼 수 있다. 예를 들어, 실험적 기호 기계 학습 시스템들은 높은 수준의 자연어 조언을 받아 영역 특화된 실행 가능한 규칙으로 해석하는 능력을 탐구했다.

동적 영역을 다루는 문제와 마찬가지로, 상식적 추론도 형식적 추론으로 포착하기 어렵다. 상식적 추론의 예로는 사람들이 어떻게 생각하는지에 대한 암묵적 추론이나 일상적 사건, 사물, 생물에 대한 일반 지식이 포함된다. 이러한 종류의 지식은 당연시되며 주목할 만한 것으로 여겨지지 않는다. 상식적 추론은 활발한 연구 분야이며, 기호 시스템(예: Cyc는 10년 이상에 걸쳐 이 지식의 핵심 부분을 포착하려 시도해왔다)과 신경 시스템(예: 콘에 돌진하거나 자전거를 끌고 가는 보행자를 치면 안 된다는 것을 모르는 자율주행 자동차) 모두에게 도전적이다.

매카시는 자신의 조언 수용기가 상식을 갖추고 있다고 보았지만, 그의 상식 정의는 위의 것과 달랐다. 그는 프로그램이 "전달받은 것과 이미 알고 있는 것으로부터 충분히 넓은 범위의 직접적 결과를 자동으로 추론한다면" 상식을 가진 것으로 정의했다.

연결주의 AI: 철학적 도전과 사회학적 갈등

연결주의적 접근법에는 퍼셉트론과 같은 신경망에 대한 초기 연구; 대니 힐리스의 커넥션 머신과 얀 르쿤의 합성곱 신경망 발전과 같은 80년대 중후반의 연구; 그리고 트랜스포머, GAN 및 기타 딥러닝의 오늘날 더 진보된 접근법이 포함된다.

연결주의자들 사이에서 세 가지 철학적 입장이 제시되었다:

- 구현주의—연결주의 아키텍처가 기호 처리 능력을 구현한다는 입장,

- 급진적 연결주의—기호 처리를 완전히 거부하고, 연결주의 아키텍처가 지능의 기반이 되며 이를 완전히 설명하기에 충분하다는 입장,

- 온건한 연결주의—기호 처리와 연결주의 아키텍처가 상호 보완적이며 지능을 위해 둘 다 필요하다는 입장.

올라자란은 신경망 커뮤니티 내 논쟁의 사회학적 역사에서, 온건한 연결주의 관점이 현재의 신경-기호 하이브리드 연구와 본질적으로 양립 가능하다고 설명했다:> 여기서 마지막으로 살펴보고 싶은 세 번째 입장은 내가 온건한 연결주의 관점이라 부르는 것으로, 연결주의와 기호 AI 사이의 현재 논쟁에 대한 보다 절충적인 관점이다. 이 입장을 가장 명시적으로 발전시킨 연구자 중 한 명은 서섹스 대학교(영국 브라이턴) 인지 및 컴퓨팅 과학부의 철학자 앤디 클라크이다. 클라크는 하이브리드(부분적으로 기호적이고 부분적으로 연결주의적인) 시스템을 옹호했다. 그는 인지를 연구하고 모델링하기 위해 (최소한) 두 종류의 이론이 필요하다고 주장했다. 한편으로는 일부 정보 처리 과제(예: 패턴 인식)에서 연결주의가 기호 모델보다 유리하다. 그러나 다른 한편으로는 다른 인지 과정(예: 순차적, 연역적 추론 및 생성적 기호 조작 과정)에서 기호 패러다임이 적절한 모델을 제공하며, (급진적 연결주의자들이 주장하는 것과 달리) 단순한 "근사"가 아니다.

게리 마커스는 현재 딥러닝 커뮤니티에서 기호적 접근에 대한 적대감이 철학적이라기보다 사회학적일 수 있다고 주장했다:> 기호 조작을 단순히 포기할 수 있다고 생각하는 것은 불신을 유보하는 것이다.

...

그 이후로 그의 반기호 캠페인은 강도만 높아졌다. 2016년에 얀 르쿤, 벤지오, 힌튼은 과학계에서 가장 중요한 저널 중 하나인 네이처에 딥러닝 선언문을 발표했다. 그것은 기호 조작에 대한 직접적인 공격으로 마무리되었으며, 화해가 아닌 완전한 대체를 요구했다. 이후 힌튼은 유럽연합 지도자 모임에서 기호 조작 접근법에 더 이상 돈을 투자하는 것은 "엄청난 실수"라고 말하며, 전기차 시대에 내연기관에 투자하는 것에 비유했다.

이러한 분쟁의 일부는 불명확한 용어에 기인할 수 있다:

튜링상 수상자 주디아 펄은 기계 학습에 대한 비판을 제시하는데, 불행히도 기계 학습과 딥러닝이라는 용어를 혼동한다. 마찬가지로 제프리 힌튼이 기호 AI를 언급할 때, 그 용어의 함축은 학습 능력이 전혀 없는 전문가 시스템을 의미하는 경향이 있다. 용어 사용의 명확화가 필요하다. 기계 학습은 연관 규칙 마이닝에 국한되지 않으며, 기호 ML과 관계적 학습에 관한 연구 전체를 참조하라(딥러닝과의 차이는 표현의 선택—분산적이 아닌 국소적 논리적—과 경사 기반 학습 알고리즘을 사용하지 않는다는 것이다). 마찬가지로, 기호 AI는 단지 수작업으로 작성된 생산 규칙에 관한 것만이 아니다. AI의 적절한 정의는 지식 표현과 추론, 자율 다중 에이전트 시스템, 계획 수립과 논증, 그리고 학습을 포함한다.이론적 관점에서 연결주의 AI와 기호 AI 사이의 이점 경계가 보이는 것만큼 명확하지 않을 수 있다는 점은 주목할 만하다. 예를 들어, 헝 장과 그의 동료들은 주류 지식 표현 형식체계가 보편적이거나 동등한 표현력을 갖추고 있다면 재귀적으로 동형임을 증명했다.[^37] 이 발견은 인공 일반 지능(AGI)의 실현을 위해 기호적 또는 연결주의적 지식 표현 형식체계를 사용하는 것 사이에 근본적인 구별이 없음을 시사한다. 더욱이 재귀적 동형의 존재는 서로 다른 기술적 접근법이 서로에게서 통찰을 얻을 수 있음을 시사한다. 이러한 관점에서, 어떤 단일 기술 학파의 이점을 과도하게 강조하는 것은 불필요해 보이며, 오히려 상호 학습과 통합이 AGI 실현을 위한 가장 유망한 길을 제시할 수 있다.

상황적 로봇공학: 모델로서의 세계

기호 AI에 대한 또 다른 비판은 체화된 인지 접근법이다:

로드니 브룩스는 체화된 인지에 대한 한 가지 접근법인 행동 기반 로봇공학을 발명했다. 이 접근법의 다른 이름인 누벨 AI는 기호 AI와 연결주의 AI 모두에 대한 대안으로 간주된다. 그의 접근법은 기호적이든 분산적이든 표현을 불필요할 뿐만 아니라 해롭다고 거부했다. 대신 그는 체화된 에이전트를 위한 계층적 아키텍처인 포섭 아키텍처를 만들었다. 각 계층은 다른 목적을 달성하며 실제 세계에서 기능해야 한다. 예를 들어, 그가 표현 없는 지능에서 설명하는 첫 번째 로봇은 세 개의 계층을 가지고 있다. 최하위 계층은 소나 센서를 해석하여 물체를 피한다. 중간 계층은 장애물이 없을 때 로봇이 돌아다니게 한다. 최상위 계층은 추가 탐색을 위해 더 먼 곳으로 가게 한다. 각 계층은 일시적으로 하위 계층을 억제하거나 제압할 수 있다. 그는 AI 연구자들이 자신의 시스템을 위해 AI 문제를 정의하는 것을 비판했는데: "실제 세계에서는 인식(추상화)과 추론 사이에 깔끔한 구분이 없다." 그는 자신의 로봇을 "생명체"라 불렀고, 각 계층은 "단순한 유한 상태 기계의 고정 토폴로지 네트워크로 구성"되었다. 누벨 AI 접근법에서 "첫째, 우리가 만든 생명체를 실제 세계에서, 즉 우리 인간이 살고 있는 동일한 세계에서 테스트하는 것이 매우 중요하다. 나중에 활동을 단순화되지 않은 세계로 이전하려는 최선의 의도가 있더라도 먼저 단순화된 세계에서 테스트하는 유혹에 빠지는 것은 재앙적이다." 실제 세계 테스트에 대한 그의 강조는 "AI의 초기 연구가 게임, 기하학 문제, 기호 대수, 정리 증명 및 기타 형식 시스템에 집중"했던 것과 SHRDLU와 같은 기호 AI 시스템에서 블록 세계를 사용했던 것과 대조적이었다.

현재의 관점

기호적, 연결주의적, 행동 기반 접근법 각각은 장점이 있지만 다른 접근법들로부터 비판을 받아왔다. 기호 AI는 비체화적이고, 자격 문제에 취약하며, 딥러닝이 뛰어난 지각 문제를 잘 처리하지 못한다는 비판을 받아왔다. 반대로 연결주의 AI는 숙고적인 단계별 문제 해결, 지식 통합, 계획 수립 처리에 적합하지 않다는 비판을 받아왔다. 마지막으로, 누벨 AI는 반응적이고 실제 세계 로봇공학 영역에서 뛰어나지만 학습과 지식의 통합에 어려움이 있다는 비판을 받아왔다.

이러한 접근법 중 하나 이상을 통합한 하이브리드 AI가 현재 발전의 방향으로 여겨지고 있다. 러셀과 노빅은 다음과 같이 결론짓는다:> 전반적으로, 드레이퍼스는 AI가 완전한 답을 갖지 못한 영역을 보고 AI는 따라서 불가능하다고 말했다; 이제 우리는 이와 동일한 영역의 많은 부분이 불가능성이 아닌 능력의 향상으로 이어지는 지속적인 연구와 개발을 거치고 있음을 본다.

같이 보기

- 인공지능

- 자동 계획 및 스케줄링

- 자동 정리 증명

- 믿음 수정

- 사례 기반 추론

- 인지 아키텍처

- 인지과학

- 연결주의

- 제약 프로그래밍

- 딥러닝

- 1차 논리

- GOFAI

- 인공지능의 역사

- 귀납 논리 프로그래밍

- 지식 기반 시스템

- 지식 표현 및 추론

- 논리 프로그래밍

- 기계 학습

- 모델 검사

- 모델 기반 추론

- 다중 에이전트 시스템

- 자연어 처리

- 신경-기호 AI

- 온톨로지

- 인공지능의 철학

- 물리적 기호 시스템 가설

- 시맨틱 웹

- 순차 패턴 마이닝

- 통계적 관계 학습

- 기호 수학

- YAGO 온톨로지

- WordNet

주석

출처

-

-

- .

-

참고 문헌

[^1]: Cite journal doi = 10.1145/1743546.1743564 issn = 0001-0782 volume = 53 issue = 6 pages = 41–45 last = Shustek first = Len title = An interview with Ed Feigenbaum journal = Communications of

[^2]: Cite journal doi = 10.1016/0004-3702(85)90063-3 volume = 26 issue = 3 pages = 251–321 last = Hayes-Roth first = Barbara title = A blackboard architecture for control journal = Artificial Intel

[^3]: Cite conference publisher = RAND last = Hayes-Roth first = Barbara title = Human Planning Processes date = 1980

[^4]: Cite book publisher = Cambridge University Press isbn = 978-0-521-27029-8 last = Schank first = Roger C. title = Dynamic Memory: A Theory of Reminding and Learning in Computers and People locati

[^5]: Rossi, Francesca. AI에서의 빠른 사고와 느린 사고. AAAI

[^6]: Selman, Bart. AAAI 회장 연설: AI의 현황. AAAI

[^7]: Garcez, Artur d'Avila. 신경-기호 인지 추론. Springer

[^8]: Cite journal doi = 10.1613/jair.2811 doi-access = free issn = 1076-9757 volume = 36 pages = 165–228 last1 = Motik first1 = Boris last2 = Shearer first2 = Rob last3 = Horrocks first3 = Ian

[^9]: Cite book publisher = MIT Press isbn = 978-0-262-51540-5 last = Kuipers first = Benjamin title = Qualitative Reasoning: Modeling and Simulation with Incomplete Knowledge date = 1994

[^10]: Garnelo, Marta. 딥러닝과 기호 인공지능의 조화: 객체와 관계의 표현. (2019년 10월)

[^11]: Thomason, Richmond. 논리 기반 인공지능. (2024년 2월 27일)

[^12]: Garnelo, Marta. 딥러닝과 기호 인공지능의 조화: 객체와 관계의 표현. (2019-10-01)

[^13]: Newell, Allen. 경험적 탐구로서의 컴퓨터 과학: 기호와 탐색. (1976-03-01)

[^14]: cite journal doi = 10.1038/323533a0 issn = 1476-4687 volume = 323 issue = 6088 pages = 533–536 last1 = Rumelhart first1 = David E. last2 = Hinton first2 = Geoffrey E. last3 = Williams first

[^15]: Cite journal volume = 1 issue = 4 pages = 541–551 last1 = LeCun first1 = Y. last2 = Boser first2 = B. last3 = Denker first3 = I. last4 = Henderson first4 = D. last5 = Howard first5 = R.

[^16]: Zhang, Heng. 지식 표현을 위한 형식 체계 이론. (2025-04-11)

[^17]: AI의 매력: 인공지능이란 무엇인가?

[^18]: Quinlan, J. Ross

[^19]: Cite book edition = 1st publisher = Morgan Kaufmann isbn = 978-1-55860-238-0 last = Quinlan first = J. Ross title = C4.5: Programs for Machine Learning location = San Mateo, Calif date = 1992

[^20]: Mitchell, Tom M.

[^21]: Cite journal doi = 10.1145/1968.1972 issn = 0001-0782 volume = 27 issue = 11 pages = 1134–1142 last = Valiant first = L. G. title = A theory of the learnable journal = Communications of the A

[^22]: Cite conference conference = IJCAI volume = 2 pages = 1064 last = Shapiro first = Ehud Y title = The Model Inference System book-title = Proceedings of the 7th international joint conference on

[^23]: Cite journal doi = 10.1145/357084.357090 volume = 2 pages = 90–121 last1 = Manna first1 = Zohar last2 = Waldinger first2 = Richard title = A Deductive Approach to Program Synthesis journal =

[^24]: Cite book publisher = Academic Press isbn = 978-0-12-322060-8 last = Hammond first = Kristian J. title = Case-Based Planning: Viewing Planning as a Memory Task location = Boston date = 1989-04-

[^25]: Cite book edition = 1st publisher = A Bradford Book isbn = 978-0-262-11170-6 last = Koza first = John R. title = Genetic Programming: On the Programming of Computers by Means of Natural Selecti

[^26]: Mostow, David Jack

[^27]: Bareiss, Ray

[^28]: Carbonell, Jaime

[^29]: Carbonell, Jaime

[^30]: Mitchell, Tom

[^31]: Lenat, Douglas

[^32]: Cite book publisher = Pitman Publishing isbn = 0-273-08690-1 last = Korf first = Richard E. title = Learning to Solve Problems by Searching for Macro-Operators series = Research Notes in Artific

[^34]: Cite conference publisher = Association for Computational Linguistics doi = 10.18653/v1/W16-1309 pages = 45–50 last1 = Rocktäschel first1 = Tim last2 = Riedel first2 = Sebastian title = Learni

[^35]: Citation arxiv = 1606.04422 last1 = Serafini first1 = Luciano last2 = Garcez first2 = Artur d'Avila title = Logic Tensor Networks: Deep Learning and Logical Reasoning from Data and Knowledge da

[^36]: Leo de Penning, Artur S. d'Avila Garcez, Luís C. Lamb, John-Jules Ch. Meyer: "A Neural-Symbolic Cognitive Agent for Online Learning and Reasoning." IJCAI 2011: 1653-1658

[^37]: Zhang, Heng. 지식 표현을 위한 형식 체계 이론. (2025-04-11)

관련 문서

관련 인사이트

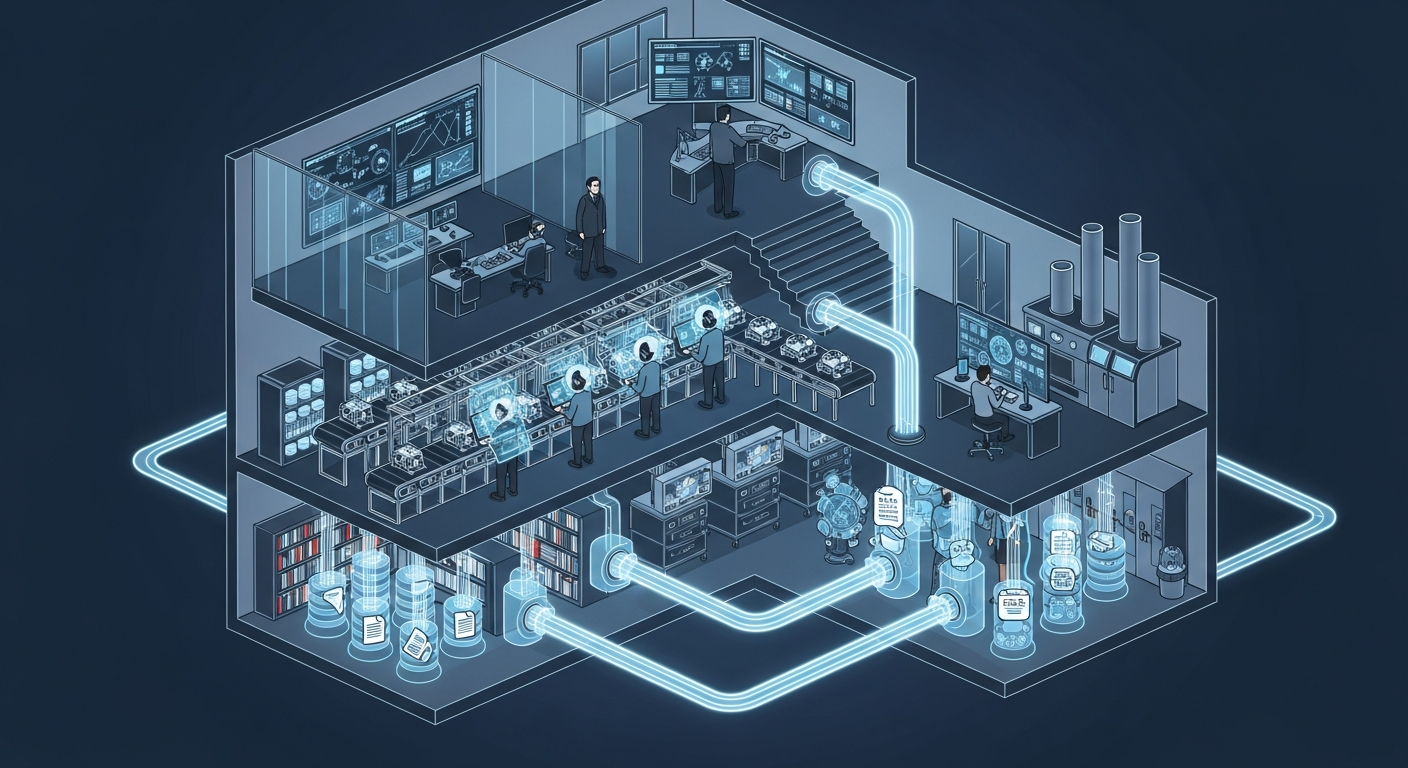

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.

ERP 20년, 나는 왜 AI를 얹기로 했나

ERP 20년차 제조IT본부장의 고백: 3,200만 행의 데이터가 잠들어 있었다. ERP를 바꾸지 않고 AI를 얹자, 일주일 걸리던 불량 분석이 수 초로 줄었다.