신경망

![An artificial neural network is an interconnected group of nodes, inspired by a simplification of [neuron s in a brain. Here, each circular node represents an artificial neuron and an arrow represents a connection from the output of one artificial neuron to the input of another.]]

기계 학습에서 신경망(NN) 또는 신경 네트워크는 인공 신경망(ANN)으로도 알려져 있으며, 생물학적 신경망의 구조와 기능에서 영감을 받은 계산 모델이다.[^107][^108]

신경망은 인공 뉴런이라 불리는 연결된 단위 또는 노드로 구성되며, 이는 뇌의 뉴런을 느슨하게 모델링한 것이다. 생물학적 뉴런을 더 밀접하게 모방하는 인공 뉴런 모델도 최근 연구되어 성능을 크게 향상시키는 것으로 나타났다. 이들은 뇌의 시냅스를 모델링하는 간선으로 연결된다. 각 인공 뉴런은 연결된 뉴런들로부터 신호를 받아 이를 처리한 후 다른 연결된 뉴런들에게 신호를 보낸다. "신호"는 실수이며, 각 뉴런의 출력은 입력의 총합에 대한 비선형 함수, 즉 활성화 함수에 의해 계산된다. 각 연결에서의 신호 강도는 학습 과정에서 조정되는 가중치에 의해 결정된다.

일반적으로 뉴런은 층으로 집합된다. 서로 다른 층은 입력에 대해 서로 다른 변환을 수행할 수 있다. 신호는 첫 번째 층(입력층)에서 마지막 층(출력층)으로 이동하며, 여러 중간 층(은닉층)을 거칠 수 있다. 네트워크는 일반적으로 최소 두 개의 은닉층을 가지면 심층 신경망이라 불린다.[^109]

인공 신경망은 예측 모델링, 적응 제어, 인공지능 문제 해결 등 다양한 작업에 사용된다. 경험을 통해 학습할 수 있으며, 복잡하고 겉보기에 관련 없어 보이는 정보 집합에서 결론을 도출할 수 있다.

훈련

신경망은 일반적으로 경험적 위험 최소화를 통해 훈련되며, 이는 주어진 데이터셋에서 예측 출력과 실제 목표값 사이의 차이, 즉 경험적 위험을 최소화하도록 네트워크의 매개변수를 최적화하는 개념에 기반한다.[^1] 역전파와 같은 경사 기반 방법이 일반적으로 네트워크의 매개변수를 추정하는 데 사용된다.[^1] 훈련 단계에서 인공 신경망은 정의된 손실 함수를 최소화하기 위해 매개변수를 반복적으로 갱신하면서 레이블이 지정된 훈련 데이터로부터 학습한다.[^2] 이 방법을 통해 네트워크는 이전에 보지 못한 데이터에도 일반화할 수 있다.

역사

초기 연구

오늘날의 심층 신경망은 200여 년 전 통계학 분야의 초기 연구에 기반을 두고 있다. 가장 단순한 형태의 순방향 신경망(FNN)은 선형 네트워크로, 선형 활성화 함수를 가진 단일 출력 노드 층으로 구성된다. 입력값은 일련의 가중치를 통해 출력으로 직접 전달된다. 각 노드에서 가중치와 입력값의 곱의 합이 계산된다. 이렇게 계산된 출력값과 주어진 목표값 사이의 평균 제곱 오차는 가중치를 조정하여 최소화된다. 이 기법은 200년 이상 최소제곱법 또는 선형 회귀로 알려져 왔다. 이는 Legendre(1805)와 Gauss(1795)가 행성 운동 예측을 위해 일련의 점들에 대한 적절한 대략적 선형 적합을 구하는 수단으로 사용하였다.[^3][^4][^5][^6]

역사적으로 폰 노이만 모델과 같은 디지털 컴퓨터는 다수의 프로세서가 메모리에 접근하여 명시적 명령어를 실행하는 방식으로 작동한다. 반면 일부 신경망은 연결주의 프레임워크를 통해 생물학적 시스템의 정보 처리를 모델링하려는 노력에서 비롯되었다. 폰 노이만 모델과 달리, 연결주의 컴퓨팅은 메모리와 처리를 분리하지 않는다.

Warren McCulloch와 Walter Pitts^40는 신경망의 비학습 계산 모델을 고안하였다.[^111] 이 모델은 이후 연구가 두 가지 접근 방식으로 나뉘는 길을 열었다. 한 접근 방식은 생물학적 과정에 초점을 맞추었고, 다른 접근 방식은 인공지능에 대한 신경망의 응용에 초점을 맞추었다.

1940년대 후반, D. O. Hebb[^112]는 신경 가소성 메커니즘에 기반한 학습 가설을 제안하였으며, 이는 헤브 학습으로 알려지게 되었다. 이는 Rosenblatt의 퍼셉트론과 홉필드 네트워크 등 많은 초기 신경망에 사용되었다. Farley와 Clark^113은 계산 기계를 사용하여 헤브 네트워크를 시뮬레이션하였다. Rochester, Holland, Habit, Duda(1956)도 다른 신경망 계산 기계를 만들었다.[^114]

1958년, 심리학자 Frank Rosenblatt는 최초로 구현된 인공 신경망 중 하나인 퍼셉트론을 기술하였으며,[^115][^116][^117] 이는 미국 해군연구국의 자금 지원을 받았다.[^7] R. D. Joseph(1960)[^8]는 Farley와 Clark에 의한 더 이른 시기의 퍼셉트론 유사 장치를 언급한다:[^13] "MIT 링컨 연구소의 Farley와 Clark은 실제로 퍼셉트론 유사 장치의 개발에서 Rosenblatt보다 앞섰다." 그러나 "그들은 그 주제를 중단하였다." 퍼셉트론은 인공 신경망 연구에 대한 대중의 관심을 높였고, 미국 정부는 자금 지원을 대폭 늘렸다. 이는 퍼셉트론이 인간 지능을 모방할 수 있는 능력에 대해 컴퓨터 과학자들이 낙관적인 주장을 한 것에 힘입어 "인공지능의 황금기"에 기여하였다.[^9]

최초의 퍼셉트론에는 적응형 은닉 유닛이 없었다. 그러나 Joseph(1960)[^8]은 적응형 은닉층을 가진 다층 퍼셉트론에 대해서도 논의하였다. Rosenblatt(1962)[^10]는 이러한 아이디어를 인용하고 채택하였으며, H. D. Block과 B. W. Knight의 연구도 인정하였다. 안타깝게도, 이러한 초기 노력은 은닉 유닛에 대한 실용적인 학습 알고리즘, 즉 심층 학습으로 이어지지 못하였다.

1960년대와 1970년대의 심층 학습 돌파구

1960년대와 1970년대에 인공 신경망에 대한 근본적인 연구가 수행되었다. 최초의 실용적인 심층 학습 알고리즘은 임의 깊이의 신경망을 훈련시키는 방법인 데이터 처리의 그룹 방법으로, 소련에서 Alexey Ivakhnenko와 Lapa(1965)에 의해 발표되었다. 그들은 이를 다항 회귀의 한 형태[^11] 또는 Rosenblatt 퍼셉트론의 일반화로 간주하였다.[^118] 1971년 논문에서는 이 방법으로 훈련된 8개 층의 심층 네트워크가 기술되었으며,[^12] 이는 회귀 분석을 통한 층별 훈련에 기반한다. 불필요한 은닉 유닛은 별도의 검증 세트를 사용하여 제거된다. 노드의 활성화 함수가 콜모고로프-가보르 다항식이므로, 이것은 곱셈 유닛 또는 "게이트"를 가진 최초의 심층 네트워크이기도 하였다.[^13]

확률적 경사 하강법[^14]으로 훈련된 최초의 심층 학습 다층 퍼셉트론(MLP)은 1967년 Shun'ichi Amari에 의해 발표되었다.[^15] Amari의 학생 Saito가 수행한 컴퓨터 실험에서, 수정 가능한 두 개의 층을 가진 5층 MLP는 비선형적으로 분리 불가능한 패턴 클래스를 분류하기 위한 내부 표현을 학습하였다.[^13] 이후 하드웨어와 하이퍼파라미터 튜닝의 발전으로 종단 간 확률적 경사 하강법이 현재 지배적인 훈련 기법이 되었다.

1969년, Kunihiko Fukushima는 ReLU(정류 선형 유닛) 활성화 함수를 도입하였다.[^13][^16][^17] 정류기는 심층 학습에서 가장 널리 사용되는 활성화 함수가 되었다.[^119]

그럼에도 불구하고, 기본 퍼셉트론이 배타적 논리합 회로를 처리할 수 없음을 강조한 Minsky와 Papert(1969)의 연구[^18] 이후 미국에서의 연구는 정체되었다. 이 통찰은 Ivakhnenko(1965)와 Amari(1967)의 심층 네트워크에는 해당되지 않는 것이었다.

1976년에 신경망 학습에 전이 학습이 도입되었다.[^120][^121]

합성곱 층, 다운샘플링 층, 가중치 복제를 가진 합성곱 신경망(CNN)의 심층 학습 아키텍처는 1979년 Kunihiko Fukushima가 도입한 네오코그니트론에서 시작되었으나, 역전파로 훈련되지는 않았다.[^19][^20][^51]

역전파

역전파는 1673년 Gottfried Wilhelm Leibniz가 유도한 연쇄 법칙[^21]을 미분 가능한 노드 네트워크에 효율적으로 적용한 것이다. "오류의 역전파"라는 용어는 실제로 1962년 Rosenblatt에 의해 도입되었으나,[^10] 그는 이를 구현하는 방법을 알지 못하였다. 다만 Henry J. Kelley가 1960년에 제어 이론의 맥락에서 역전파의 연속적 전구체를 발표하였다.[^22] 1970년, Seppo Linnainmaa는 자신의 석사 논문(1970)에서 역전파의 현대적 형태를 발표하였다.[^23][^24][^13] G.M. Ostrovski 등은 1971년에 이를 재발표하였다.[^25][^29] Paul Werbos는 1982년에 역전파를 신경망에 적용하였다[^26][^27](1994년 책으로 재출간된 그의 1974년 박사 논문[^28]에는 아직 이 알고리즘이 기술되지 않았다[^29]). 1986년, David E. Rumelhart 등은 역전파를 대중화하였으나 원래 연구를 인용하지 않았다.[^122]

합성곱 신경망

1979년 Kunihiko Fukushima의 합성곱 신경망(CNN) 아키텍처[^19]는 CNN의 널리 사용되는 다운샘플링 절차인 최대 풀링도 도입하였다.[^123] CNN은 컴퓨터 비전에 필수적인 도구가 되었다.

시간 지연 신경망(TDNN)은 1987년 Alex Waibel이 CNN을 음소 인식에 적용하기 위해 도입하였다. 이는 합성곱, 가중치 공유, 역전파를 사용하였다.^30 1988년, Wei Zhang은 역전파로 훈련된 CNN을 알파벳 인식에 적용하였다.[^32] 1989년, Yann LeCun 등은 우편물의 손글씨 우편번호를 인식하기 위해 LeNet이라는 CNN을 만들었다. 훈련에는 3일이 소요되었다.[^33] 1990년, Wei Zhang은 광학 컴퓨팅 하드웨어에 CNN을 구현하였다.[^34] 1991년, CNN은 의료 영상 객체 분할[^124]과 유방촬영술에서의 유방암 검출에 적용되었다.[^125] Yann LeCun 등이 만든 7계층 CNN인 LeNet-5(1998)는 숫자를 분류하며, 32×32 픽셀 이미지로 디지털화된 수표의 손글씨 숫자를 인식하기 위해 여러 은행에서 적용되었다.[^35]

1988년 이후,[^36][^37] 신경망의 사용은 단백질 구조 예측 분야를 변혁하였으며, 특히 다중 서열 정렬로 생성된 프로파일(행렬)에 대해 최초의 계단식 네트워크가 훈련되었을 때 그러하였다.[^38]

순환 신경망

순환 신경망(RNN)의 한 기원은 통계역학이었다. 1972년, Shun'ichi Amari는 연상 기억의 모델로서 헤브 학습 규칙에 의해 이징 모델의 가중치를 수정할 것을 제안하여 학습의 요소를 추가하였다.[^126] 이는 John Hopfield(1982)에 의해 홉필드 네트워크로 대중화되었다.[^39] RNN의 또 다른 기원은 신경과학이었다. "순환(recurrent)"이라는 단어는 해부학에서 고리 형태의 구조를 설명하는 데 사용된다. 1901년, Cajal은 소뇌 피질에서 "순환 반원"을 관찰하였다.[^127] Hebb는 "반향 회로"를 단기 기억의 설명으로 고려하였다.[^128] McCulloch와 Pitts의 논문(1943)은 순환을 포함하는 신경망을 고려하였으며, 이러한 네트워크의 현재 활동이 무한히 먼 과거의 활동에 의해 영향을 받을 수 있음을 지적하였다.[^40]

1982년에 다층 퍼셉트론 아키텍처가 아닌 배열 아키텍처를 가진 순환 신경망, 즉 교차바 적응 배열[^41]은 출력에서 감독자(교수) 입력으로의 직접적인 순환 연결을 사용하였다. 행동(의사결정)을 계산하는 것 외에도, 결과 상황의 내부 상태 평가(감정)를 계산하였다. 외부 감독자를 제거함으로써, 신경망에서의 자기 학습 방법을 도입하였다.

인지심리학에서, 학술지 American Psychologist는 1980년대 초반에 인지와 감정 사이의 관계에 대한 논쟁을 다루었다. Zajonc(1980)는 감정이 먼저 계산되며 인지와 독립적이라고 주장한 반면, Lazarus(1982)는 인지가 먼저 계산되며 감정과 분리할 수 없다고 주장하였다.[^129][^130] 1982년 교차바 적응 배열은 인지-감정 관계의 신경망 모델을 제시하였다.^41 이는 인공지능 시스템인 순환 신경망이 인지심리학에서 같은 시기에 다루어진 문제에 기여한 논쟁의 사례였다.

두 가지 초기의 영향력 있는 연구는 인지심리학 연구에 RNN을 적용한 조던 네트워크(1986)와 엘만 네트워크(1990)였다.

1980년대에 역전파는 심층 RNN에 잘 작동하지 않았다. 이 문제를 극복하기 위해, 1991년 Jürgen Schmidhuber는 자기 지도 사전 훈련(ChatGPT의 "P")과 신경망 지식 증류의 중요한 개념을 도입한 "신경 시퀀스 청커" 또는 "신경 이력 압축기"를 제안하였다.[^42][^43][^6]

1991년, Sepp Hochreiter의 졸업 논문^44은 기울기 소실 문제를 식별하고 분석하였으며,[^44][^45] 이를 해결하기 위한 순환 잔차 연결을 제안하였다. 그와 Schmidhuber는 여러 응용 분야에서 정확도 기록을 세운 장단기 기억(LSTM)을 도입하였다.[^132][^46] 이것은 아직 LSTM의 현대적 버전이 아니었으며, 현대적 버전에는 1999년에 도입된 망각 게이트가 필요하였다.[^47] 이는 RNN 아키텍처의 기본 선택이 되었다.

1985년에서 1995년 사이, 통계역학에서 영감을 받아 Terry Sejnowski, Peter Dayan, Geoffrey Hinton 등에 의해 볼츠만 머신,[^133] 제한 볼츠만 머신,[^134] 헬름홀츠 머신, 웨이크-슬립 알고리즘[^48] 등 여러 아키텍처와 방법이 개발되었다. 이들은 심층 생성 모델의 비지도 학습을 위해 설계되었다.

심층 학습

2009년에서 2012년 사이, 인공 신경망은 이미지 인식 대회에서 수상하기 시작하였으며, 처음에는 패턴 인식과 필기 인식에서 다양한 과제에 대해 인간 수준의 성능에 근접하였다.[^135][^136] 2011년, Dan Ciresan, Ueli Meier, Jonathan Masci, Luca Maria Gambardella, Jürgen Schmidhuber가 만든 DanNet[^49][^50]이라는 CNN은 시각 패턴 인식 대회에서 최초로 초인적 성능을 달성하여 기존 방법보다 3배 뛰어난 성과를 보였다.[^51] 이후 더 많은 대회에서 우승하였다.[^52][^53] 그들은 또한 GPU에서의 최대 풀링 CNN이 성능을 크게 향상시킴을 보여주었다.[^54]

2012년 10월, Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton의 AlexNet[^55]은 대규모 ImageNet 대회에서 얕은 기계 학습 방법에 비해 큰 차이로 우승하였다. 이후의 점진적 개선에는 Karen Simonyan과 Andrew Zisserman의 VGG-16 네트워크[^56]와 Google의 Inceptionv3가 포함되었다.[^57]

2012년, Ng와 Dean은 레이블이 없는 이미지만을 보고 고양이와 같은 고차원 개념을 인식하는 법을 학습하는 네트워크를 만들었다.[^58] 비지도 사전 훈련과 GPU 및 분산 컴퓨팅에 의한 컴퓨팅 파워 증가는 특히 이미지 및 시각 인식 문제에서 더 큰 네트워크의 사용을 가능하게 하였으며, 이는 "심층 학습"으로 알려지게 되었다.[^2]

방사 기저 함수 및 웨이블릿 네트워크는 2013년에 도입되었다. 이들은 최적 근사 특성을 제공하는 것으로 나타났으며, 비선형 시스템 식별 및 분류 응용에 적용되었다.[^92]

생성적 적대 신경망(GAN)(Ian Goodfellow 등, 2014)[^59]은 2014년에서 2018년 기간 동안 생성 모델링에서 최첨단이 되었다. GAN 원리는 원래 1991년 Jürgen Schmidhuber에 의해 "인공 호기심"이라는 이름으로 발표되었다: 두 신경망이 제로섬 게임의 형태로 경쟁하며, 한 네트워크의 이득이 다른 네트워크의 손실이 된다.[^60][^61] 첫 번째 네트워크는 출력 패턴에 대한 확률 분포를 모델링하는 생성 모델이다. 두 번째 네트워크는 경사 하강법으로 이러한 패턴에 대한 환경의 반응을 예측하는 것을 학습한다. Tero Karras 등의 Progressive GAN에 기반한 Nvidia의 StyleGAN(2018)[^62][^63]으로 뛰어난 이미지 품질이 달성되었다. 여기서 GAN 생성기는 피라미드 방식으로 작은 규모에서 큰 규모로 성장한다. GAN에 의한 이미지 생성은 대중적 성공을 거두었고, 딥페이크에 관한 논의를 불러일으켰다.[^137] 확산 모델(2015)[^138]은 이후 DALL·E 2(2022)와 Stable Diffusion(2022) 같은 시스템으로 생성 모델링에서 GAN을 대체하였다.

2014년에 최첨단 기술은 20~30개 층의 "매우 깊은 신경망"을 훈련하는 것이었다.[^139] 너무 많은 층을 쌓으면 훈련 정확도가 급격히 감소하였으며,[^64] 이는 "열화" 문제로 알려졌다.[^65] 2015년에 매우 깊은 네트워크를 훈련하기 위한 두 가지 기법이 개발되었다: 하이웨이 네트워크는 2015년 5월에 발표되었고,[^66] 잔차 신경망(ResNet)은 2015년 12월에 발표되었다.[^67][^140] ResNet은 게이트가 열린 하이웨이 넷처럼 동작한다.

2010년대에 seq2seq 모델이 개발되었고, 어텐션 메커니즘이 추가되었다. 이는 2017년 Attention Is All You Need에서 현대적인 트랜스포머 아키텍처로 이어졌다.[^68] 이는 컨텍스트 윈도우 크기에 대해 이차적인 계산 시간을 필요로 한다. Jürgen Schmidhuber의 빠른 가중치 제어기(1992)[^69]는 선형적으로 확장되며, 이후 비정규화 선형 트랜스포머와 동등한 것으로 밝혀졌다.[^70][^71][^13] 트랜스포머는 자연어 처리를 위한 모델로 점점 더 많이 선택되고 있다.[^72] ChatGPT, GPT-4, BERT 등 많은 현대 대규모 언어 모델이 이 아키텍처를 사용한다.

모델

인공신경망은 기존 알고리즘으로는 거의 성공하지 못했던 작업을 수행하기 위해 인간 뇌의 구조를 활용하려는 시도에서 시작되었다. 이후 곧 생물학적 원형에 충실하려는 시도를 포기하고 경험적 결과를 개선하는 방향으로 전환하였다. 인공신경망은 비선형성과 복잡한 관계를 학습하고 모델링하는 능력을 가지고 있다. 이는 뉴런들이 다양한 패턴으로 연결되어 일부 뉴런의 출력이 다른 뉴런의 입력이 될 수 있게 함으로써 달성된다. 이 네트워크는 방향성 가중 그래프를 형성한다.[^73]

인공신경망은 시뮬레이션된 뉴런으로 구성된다. 각 뉴런은 생물학적 축삭-시냅스-수상돌기 연결과 같은 링크를 통해 다른 노드에 연결된다. 링크로 연결된 모든 노드는 일부 데이터를 받아들여 데이터에 대한 특정 연산과 작업을 수행하는 데 사용한다. 각 링크에는 한 노드가 다른 노드에 미치는 영향의 강도를 결정하는 가중치가 있으며,[^74] 이를 통해 가중치가 뉴런 간의 신호를 선택할 수 있게 한다.

인공 뉴런

인공신경망은 생물학적 뉴런에서 개념적으로 파생된 인공 뉴런으로 구성된다. 각 인공 뉴런은 입력을 받아 여러 다른 뉴런으로 전송할 수 있는 단일 출력을 생성한다.[^75] 입력은 이미지나 문서와 같은 외부 데이터 샘플의 특성 값이 될 수도 있고, 다른 뉴런의 출력이 될 수도 있다. 신경망의 최종 출력 뉴런의 출력이 이미지에서 객체를 인식하는 것과 같은 작업을 수행한다.

뉴런의 출력을 구하기 위해, 입력에서 뉴런으로의 연결의 가중치로 가중된 모든 입력의 가중합을 구한다. 이 합에 편향 항을 더한다.[^76] 이 가중합은 때때로 활성화라고 불린다. 이 가중합은 그런 다음 (보통 비선형) 활성화 함수를 거쳐 출력을 생성한다. 초기 입력은 이미지와 문서와 같은 외부 데이터이다. 최종 출력은 이미지에서 객체를 인식하는 것과 같은 작업을 수행한다.[^141]

구성

뉴런은 일반적으로 여러 층으로 구성되며, 특히 딥러닝에서 그러하다. 한 층의 뉴런은 바로 앞 층과 바로 뒤 층의 뉴런에만 연결된다. 외부 데이터를 받는 층은 입력층이다. 최종 결과를 생성하는 층은 출력층이다. 그 사이에는 0개 이상의 은닉층이 있다. 단일 층 네트워크와 비계층 네트워크도 사용된다. 두 층 사이에는 여러 연결 패턴이 가능하다. 한 층의 모든 뉴런이 다음 층의 모든 뉴런에 연결되는 '완전 연결'이 될 수 있다. 한 층의 뉴런 그룹이 다음 층의 단일 뉴런에 연결되어 해당 층의 뉴런 수를 줄이는 풀링이 될 수도 있다.[^77] 이러한 연결만을 가진 뉴런은 유향 비순환 그래프를 형성하며 순방향 네트워크로 알려져 있다.[^78] 반대로, 같은 층이나 이전 층의 뉴런 간 연결을 허용하는 네트워크는 순환 네트워크로 알려져 있다.[^142]

하이퍼파라미터

하이퍼파라미터는 학습 과정의 모든 설정 가능한 부분을 정의하는 상수 매개변수로, 그 값은 훈련 전에 설정된다.[^143] 하이퍼파라미터의 예로는 학습률, 배치 크기 및 정규화 매개변수가 있다.[^144] 신경망의 성능은 하이퍼파라미터 값의 선택에 크게 영향을 받으므로, 하이퍼파라미터는 종종 훈련 과정의 일부로 최적화되며, 이 과정을 하이퍼파라미터 튜닝 또는 하이퍼파라미터 최적화라고 한다.[^145]

학습

학습은 샘플 관측을 고려하여 작업을 더 잘 처리하도록 네트워크를 적응시키는 것이다. 학습은 결과의 정확도를 향상시키기 위해 네트워크의 가중치(및 선택적 임계값)를 조정하는 것을 포함한다. 이는 관측된 오류를 최소화함으로써 수행된다. 추가 관측을 검토해도 오류율이 유용하게 감소하지 않을 때 학습이 완료된다. 학습 후에도 오류율은 일반적으로 0에 도달하지 않는다. 학습 후 오류율이 너무 높으면 네트워크를 일반적으로 재설계해야 한다. 실제로는 학습 중 주기적으로 평가되는 비용 함수를 정의하여 이를 수행한다. 그 출력이 계속 감소하는 한 학습은 계속된다. 비용은 종종 근사적으로만 값을 구할 수 있는 통계량으로 정의된다. 출력은 실제로 숫자이므로, 오류가 낮을 때 출력(거의 확실히 고양이)과 정답(고양이) 사이의 차이는 작다. 학습은 관측 전체에 걸쳐 차이의 총합을 줄이려고 시도한다. 대부분의 학습 모델은 최적화 이론과 통계적 추정의 직접적인 응용으로 볼 수 있다.[^73][^146]

학습률

학습률은 각 관측의 오류를 조정하기 위해 모델이 취하는 교정 단계의 크기를 정의한다.[^147] 높은 학습률은 훈련 시간을 단축하지만 최종 정확도가 낮아지고, 낮은 학습률은 더 오래 걸리지만 더 높은 정확도의 가능성이 있다. Quickprop과 같은 최적화는 주로 오류 최소화의 속도를 높이는 것을 목표로 하며, 다른 개선 사항은 주로 신뢰성을 높이려고 한다. 교대하는 연결 가중치와 같은 네트워크 내부의 진동을 피하고 수렴 속도를 개선하기 위해, 개선된 방법은 적절히 증가하거나 감소하는 적응형 학습률을 사용한다.[^148] 모멘텀의 개념은 기울기와 이전 변경 사이의 균형에 가중치를 부여하여 가중치 조정이 어느 정도 이전 변경에 의존하도록 한다. 0에 가까운 모멘텀은 기울기를 강조하고, 1에 가까운 값은 마지막 변경을 강조한다.

비용 함수

비용 함수를 임의로 정의하는 것이 가능하지만, 종종 함수의 바람직한 속성(예: 볼록성) 때문에 선택이 결정되는데, 이는 모델에서 발생하기 때문이다(예: 확률적 모델에서 모델의 사후 확률이 역비용으로 사용될 수 있다).

역전파

역전파는 학습 중 발견된 각 오류를 보상하기 위해 연결 가중치를 조정하는 데 사용되는 방법이다. 오류량은 효과적으로 연결들 사이에 분배된다. 기술적으로, 역전파는 가중치에 대한 주어진 상태와 관련된 비용 함수의 기울기(도함수)를 계산한다. 가중치 업데이트는 확률적 경사 하강법 또는 극단적 학습 기계,[^149] "무전파(no-prop)" 네트워크,[^150] 역추적 없는 훈련,[^151] "무가중치(weightless)" 네트워크,[^79][^152] 및 비연결주의 신경망과 같은 다른 방법을 통해 수행될 수 있다.

학습 패러다임

기계 학습은 일반적으로 지도 학습,[^153] 비지도 학습[^154] 및 강화 학습[^155]의 세 가지 주요 학습 패러다임으로 구분된다. 각각은 특정 학습 과제에 해당한다.

지도 학습

지도 학습은 쌍을 이루는 입력과 원하는 출력의 집합을 사용한다. 학습 과제는 각 입력에 대해 원하는 출력을 생성하는 것이다. 이 경우 비용 함수는 잘못된 추론을 제거하는 것과 관련된다.[^156] 일반적으로 사용되는 비용은 평균 제곱 오차로, 네트워크의 출력과 원하는 출력 사이의 평균 제곱 오차를 최소화하려고 한다. 지도 학습에 적합한 작업은 패턴 인식(분류라고도 함)과 회귀(함수 근사라고도 함)이다. 지도 학습은 순차 데이터(예: 필기, 음성 및 제스처 인식)에도 적용 가능하다. 이는 지금까지 얻어진 솔루션의 품질에 대해 지속적인 피드백을 제공하는 함수의 형태로 "교사"와 함께 학습하는 것으로 생각할 수 있다.

비지도 학습

비지도 학습에서는 입력 데이터가 비용 함수, 즉 데이터 \textstyle x와 네트워크 출력의 어떤 함수와 함께 주어진다. 비용 함수는 작업(모델 도메인)과 모든 사전 가정(모델의 암묵적 속성, 매개변수 및 관측 변수)에 의존한다. 간단한 예로, 모델 \textstyle f(x) = a에서 \textstyle a는 상수이고 비용 \textstyle C=E[(x - f(x))^2]인 경우를 고려하자. 이 비용을 최소화하면 데이터의 평균과 같은 \textstyle a 값이 생성된다. 비용 함수는 훨씬 더 복잡할 수 있다. 그 형태는 응용 분야에 따라 달라진다: 예를 들어, 압축에서는 \textstyle x와 \textstyle f(x) 사이의 상호 정보량과 관련될 수 있고, 통계적 모델링에서는 데이터가 주어진 모델의 사후 확률과 관련될 수 있다(두 예 모두에서 해당 양은 최소화가 아닌 최대화된다는 점에 유의하라). 비지도 학습의 패러다임에 속하는 작업은 일반적으로 추정 문제이며, 응용 분야에는 군집화, 통계 분포의 추정, 압축 및 필터링이 포함된다.

강화 학습

비디오 게임 플레이와 같은 응용에서, 행위자는 일련의 행동을 취하고 각 행동 후 환경으로부터 일반적으로 예측할 수 없는 반응을 받는다. 목표는 게임에서 이기는 것, 즉 가장 긍정적인(가장 낮은 비용의) 반응을 생성하는 것이다. 강화 학습에서의 목표는 장기적(예상 누적) 비용을 최소화하는 행동을 수행하도록 네트워크에 가중치를 부여(정책을 설계)하는 것이다. 각 시점에서 에이전트는 행동을 수행하고 환경은 어떤(보통 알려지지 않은) 규칙에 따라 관측과 순간 비용을 생성한다. 규칙과 장기 비용은 보통 추정만 가능하다. 어느 시점에서든 에이전트는 비용을 파악하기 위해 새로운 행동을 탐색할지, 아니면 더 빠르게 진행하기 위해 이전 학습을 활용할지 결정한다.

형식적으로, 환경은 상태 \textstyle {s_1,...,s_n}\in S 와 행동 \textstyle {a_1,...,a_m} \in A를 가진 마르코프 결정 과정(MDP)으로 모델링된다. 상태 전이가 알려져 있지 않기 때문에 대신 확률 분포가 사용된다: 순간 비용 분포 \textstyle P(c_t|s_t), 관측 분포 \textstyle P(x_t|s_t) 및 전이 분포 \textstyle P(s_{t+1}|s_t, a_t), 그리고 정책은 관측이 주어진 행동에 대한 조건부 분포로 정의된다. 이 둘을 합하면 마르코프 체인(MC)을 정의한다. 목표는 가장 낮은 비용의 MC를 발견하는 것이다.

인공신경망은 이러한 응용에서 학습 구성 요소로 사용된다.[^157][^158] 인공신경망과 결합된 동적 프로그래밍(신경동적 프로그래밍을 제공하는)[^159]은 차량 경로 결정,[^160] 비디오 게임, 자연 자원 관리[^161][^162] 및 의학[^163]과 관련된 문제에 적용되어 왔는데, 이는 제어 문제의 해를 수치적으로 근사하기 위한 이산화 격자 밀도를 줄이면서도 정확도 손실을 완화하는 인공신경망의 능력 때문이다. 강화 학습의 패러다임에 속하는 작업은 제어 문제, 게임 및 기타 순차적 의사 결정 작업이다.

자기 학습

신경망에서의 자기 학습은 1982년에 교차막대 적응 배열(CAA)이라는 자기 학습이 가능한 신경망과 함께 도입되었다.[^164] 이것은 하나의 입력, 상황 s, 그리고 하나의 출력, 행동(또는 행위) a만을 가진 시스템이다. 외부 조언 입력도 환경으로부터의 외부 강화 입력도 없다. CAA는 교차막대 방식으로 행동에 대한 결정과 마주한 상황에 대한 감정(느낌)을 모두 계산한다. 이 시스템은 인지와 감정 사이의 상호작용에 의해 구동된다.^165 메모리 행렬 W =||w(a,s)||가 주어지면, 교차막대 자기 학습 알고리즘은 각 반복에서 다음 계산을 수행한다: 상황 s에서 행동 a를 수행한다; 결과 상황 s'를 받는다; 결과 상황에 있는 것에 대한 감정 v(s')를 계산한다; 교차막대 메모리를 업데이트한다 w'(a,s) = w(a,s) + v(s').

역전파된 값(이차 강화)은 결과 상황에 대한 감정이다. CAA는 두 가지 환경에 존재하는데, 하나는 행동하는 행동 환경이고, 다른 하나는 행동 환경에서 마주할 상황에 대한 초기 감정을 (한 번만) 받는 유전 환경이다. 유전 환경으로부터 게놈 벡터(종 벡터)를 받은 후, CAA는 바람직한 상황과 바람직하지 않은 상황을 모두 포함하는 행동 환경에서 목표 추구 행동을 학습한다.[^166]

신경진화

신경진화는 진화 연산을 사용하여 신경망 토폴로지와 가중치를 생성할 수 있다. 이는 정교한 경사 하강법 접근 방식과 경쟁력이 있다.[^167][^168] 신경진화의 한 가지 장점은 "막다른 길"에 빠질 가능성이 더 적을 수 있다는 것이다.[^169]

확률적 신경망

Sherrington–Kirkpatrick 모델에서 유래한 확률적 신경망은 네트워크의 인공 뉴런에 확률적 전달 함수를 부여하거나[^80] 확률적 가중치를 부여하여 네트워크에 무작위 변동을 도입함으로써 구축되는 인공신경망의 한 유형이다. 무작위 변동이 네트워크가 지역 최솟값에서 벗어나는 것을 돕기 때문에 최적화 문제에 유용한 도구가 된다.[^170] 베이즈 접근법을 사용하여 훈련된 확률적 신경망은 베이즈 신경망으로 알려져 있다.[^171]

위상적 딥러닝

2017년에 처음 도입된 위상적 딥러닝은[^172] 매우 복잡하고 고차원적인 데이터를 다루기 위해 위상수학을 심층 신경망과 통합하는 기계 학습의 새로운 접근 방식이다. 처음에는 대수적 위상수학에 뿌리를 두었으나, 위상적 딥러닝은 이후 미분 위상수학과 기하학적 위상수학과 같은 다른 수학 분야의 도구를 통합하는 다목적 프레임워크로 발전하였다. 수학적 딥러닝의 성공적인 사례로서, 위상적 딥러닝은 수학적 인공지능의 발전에 영감을 주며 AI와 수학 사이의 상호 유익한 관계를 촉진하고 있다.

기타

베이즈 프레임워크에서는 비용을 최소화하기 위해 허용된 모델 집합에 대한 분포가 선택된다. 진화 방법,[^173] 유전자 발현 프로그래밍,[^174] 시뮬레이티드 어닐링,[^175] 기대값-최대화, 비모수 방법 및 입자 군집 최적화[^176]는 다른 학습 알고리즘이다. 수렴 재귀는 소뇌 모델 조음 제어기(CMAC) 신경망을 위한 학습 알고리즘이다.[^81][^82]

모드

두 가지 학습 모드가 있다: 확률적 모드와 배치 모드. 확률적 학습에서는 각 입력이 가중치 조정을 생성한다. 배치 학습에서는 입력 배치를 기반으로 가중치가 조정되며, 배치에 걸쳐 오류가 누적된다. 확률적 학습은 하나의 데이터 포인트에서 계산된 지역 기울기를 사용하여 과정에 "잡음"을 도입하며, 이는 네트워크가 지역 최솟값에 갇힐 가능성을 줄인다. 그러나 배치 학습은 각 업데이트가 배치의 평균 오류 방향으로 수행되므로 일반적으로 지역 최솟값으로의 더 빠르고 안정적인 하강을 제공한다. 일반적인 절충안은 전체 데이터 세트에서 확률적으로 선택된 샘플을 각 배치에 포함하는 작은 배치인 "미니 배치"를 사용하는 것이다.

유형

인공신경망은 여러 분야에서 최첨단 기술을 발전시킨 광범위한 기법 계열로 진화해 왔다. 가장 단순한 유형은 유닛 수, 층 수, 유닛 가중치, 위상 구조 등 하나 이상의 정적 구성 요소를 가진다. 동적 유형은 이들 중 하나 이상을 학습을 통해 진화시킬 수 있다. 후자는 훨씬 더 복잡하지만 학습 기간을 단축하고 더 나은 결과를 도출할 수 있다. 일부 유형은 운영자의 "지도" 학습을 허용하거나 요구하는 반면, 다른 유형은 독립적으로 작동한다. 일부 유형은 순수하게 하드웨어로만 작동하며, 다른 유형은 순수하게 소프트웨어로서 범용 컴퓨터에서 실행된다.

주요 돌파구 중 일부는 다음과 같다:

- 시각 및 기타 2차원 데이터 처리에 특히 성공적임이 입증된 합성곱 신경망(CNN);^177 장단기 기억은 기울기 소실 문제를 해결하며[^84] 저주파와 고주파 성분이 혼합된 신호를 처리할 수 있어 대규모 어휘 음성 인식,[^85][^86] 텍스트 음성 변환 합성,[^178][^87][^88] 사실적인 말하는 얼굴 생성을 가능하게 한다.[^89] 합성곱 신경망은 사기 탐지에도 적용되어 왔다.[^179][^180]

- 여러 네트워크(다양한 구조의)가 게임에서 승리하거나[^90] 입력의 진위에 대해 상대를 속이는 것과 같은 과제에서[^59] 서로 경쟁하는 생성적 적대 신경망과 같은 경쟁 네트워크.

네트워크 설계

인공 신경망을 사용하려면 그 특성에 대한 이해가 필요하다.

- 모델 선택: 데이터 표현 방식과 응용 분야에 따라 달라진다. 모델 매개변수에는 네트워크 층의 수, 유형, 연결성뿐만 아니라 각 층의 크기와 연결 유형(완전 연결, 풀링 등)이 포함된다. 지나치게 복잡한 모델은 학습 속도가 느리다.

- 학습 알고리즘: 학습 알고리즘 간에는 수많은 트레이드오프가 존재한다. 특정 데이터셋에 대한 훈련에는 올바른 하이퍼파라미터만 설정하면[^181] 거의 모든 알고리즘이 잘 작동한다. 그러나 보지 못한 데이터에 대한 훈련을 위해 알고리즘을 선택하고 조정하려면 상당한 실험이 필요하다.

- 견고성: 모델, 비용 함수, 학습 알고리즘이 적절히 선택되면, 결과적으로 생성된 인공 신경망은 견고해질 수 있다.

신경망 구조 탐색(NAS)은 기계 학습을 사용하여 인공 신경망 설계를 자동화한다. NAS에 대한 다양한 접근 방식은 수작업으로 설계한 시스템과 비교해도 손색없는 네트워크를 설계해 왔다. 기본 탐색 알고리즘은 후보 모델을 제안하고, 데이터셋에 대해 평가한 다음, 그 결과를 피드백으로 사용하여 NAS 네트워크를 학습시키는 것이다.[^182] 사용 가능한 시스템으로는 AutoML과 AutoKeras가 있다.[^183] scikit-learn 라이브러리는 심층 네트워크를 처음부터 구축하는 데 도움이 되는 함수들을 제공한다. 이후 TensorFlow나 Keras를 사용하여 심층 네트워크를 구현할 수 있다.

하이퍼파라미터도 설계의 일부로 정의해야 하며(학습되는 것이 아님), 각 층의 뉴런 수, 학습률, 스텝, 스트라이드, 깊이, 수용 영역 및 패딩(CNN의 경우) 등의 사항을 관장한다.[^91] def train(X, y, n_hidden, learning_rate, n_iter): """Training function.

Args:

X: Argument X.

y: Argument y.

n_hidden: The number of hidden layer units.

learning_rate: The learning rate.

n_iter: The number of iterations.

Returns:

dict: A dictionary.

"""

m, n_input = X.shape

# 1. random initialize weights and biases

w1 = np.random.randn(n_input, n_hidden)

b1 = np.zeros((1, n_hidden))

w2 = np.random.randn(n_hidden, 1)

b2 = np.zeros((1, 1))

# 2. in each iteration, feed all layers with the latest weights and biases

for i in range(n_iter + 1):

z2 = np.dot(X, w1) + b1

a2 = sigmoid(z2)

z3 = np.dot(a2, w2) + b2

a3 = z3

dz3 = a3 - y

dw2 = np.dot(a2.T, dz3)

db2 = np.sum(dz3, axis=0, keepdims=True)

dz2 = np.dot(dz3, w2.T) * sigmoid_derivative(z2)

dw1 = np.dot(X.Y, dz2)

db1 = np.sum(dz2, axis=0)

# 3. update weights and biases with gradients

w1 -= learning_rate * dw1 / m

w2 -= learning_rate * dw2 / m

b1 -= learning_rate * db1 / m

b2 -= learning_rate * db2 / m

if i % 1000 == 0:

print("Epoch", i, "loss: ", np.mean(np.square(dz3)))

model = {"w1": w1, "b1": b1, "w2": w2, "b2": b2}

return model

신경망의 드리프트 및 성능 저하를 모니터링하기 위해 여러 전략이 개발되었다:

- 오류 기반 모니터링: 실측 레이블이 확보되었을 때 현재 예측값과 비교하는 방식이다. 이 접근법은 예측 성능을 직접적으로 정량화하지만, 레이블 확보가 지연되거나 비용이 많이 드는 경우 실용적이지 않을 수 있다.

- 데이터 분포 모니터링: 통계 검정, 발산 측도 또는 밀도비 추정을 사용하여 입력 데이터 분포의 변화를 탐지하는 방식이다.

- 표현 모니터링: 내부 임베딩 또는 은닉층 특징의 분포를 추적하는 방식이다. 잠재 표현의 변화는 레이블이 없는 경우에도 비정상성을 나타낼 수 있다. 통계적 공정 관리 차트와 같은 통계적 방법이 이 목적에 맞게 적용되었다.[^184]

응용 분야

비선형 과정을 모델링하고 재현하는 능력 때문에, 인공 신경망은 많은 분야에서 응용되고 있다. 여기에는 다음이 포함된다:

- 함수 근사,[^185] 또는 회귀 분석,[^186] (시계열 예측, 적합도 근사,[^187] 및 모델링 포함)

- 데이터 처리[^188] (필터링, 클러스터링, 블라인드 소스 분리,[^189] 및 압축 포함)

- 비선형 시스템 식별[^92] 및 제어 (차량 제어, 궤적 예측,[^190] 적응 제어, 공정 제어, 및 자연자원 관리 포함)

- 패턴 인식 (레이더 시스템, 얼굴 식별, 신호 분류,[^191] 이상 탐지, 3D 재구성,^192 객체 인식, 및 순차적 의사 결정[^93] 포함)

- 시퀀스 인식 (제스처, 음성, 필기 및 인쇄 텍스트 인식[^193] 포함)

- 센서 데이터 분석[^194] (이미지 분석 포함)

- 로봇공학 (매니퓰레이터 및 의수·의족 제어 포함)

- 데이터 마이닝 (데이터베이스에서의 지식 발견 포함)

- 금융[^195] (특정 금융 장기 예측을 위한 사전 모델 및 인공 금융 시장 등)

- 양자화학[^94]

- 범용 게임 플레이[^196]

- 생성형 AI[^197]

- 데이터 시각화

- 기계 번역

- 소셜 네트워크 필터링[^198]

- 이메일 스팸 필터링

- 의료 진단[^95]

인공 신경망은 여러 유형의 암을 진단하는 데 사용되었으며,[^199][^200] 세포 형태 정보만을 이용하여 고침습성 암세포주와 저침습성 암세포주를 구별하는 데에도 활용되었다.[^201][^202]

인공 신경망은 자연재해에 노출된 기반시설의 신뢰성 분석을 가속화하고,[^203][^204] 기초 침하를 예측하는 데 사용되었다.[^205] 또한 강우-유출 모델링을 위해 인공 신경망을 활용하여 홍수를 완화하는 데에도 유용할 수 있다.[^206] 인공 신경망은 지구과학 분야에서 블랙박스 모델을 구축하는 데에도 사용되었다: 수문학,[^207][^208] 해양 모델링 및 해안 공학,[^209][^210] 그리고 지형학.[^211] 인공 신경망은 사이버 보안 분야에서도 활용되어 합법적인 활동과 악의적인 활동을 구별하는 것을 목표로 하고 있다. 예를 들어, 머신 러닝은 안드로이드 악성코드 분류,[^212] 위협 행위자에 속하는 도메인 식별 및 보안 위험을 초래하는 URL 탐지에 사용되었다.[^213] 침투 테스트, 봇넷 탐지,[^214] 신용카드 사기[^215] 및 네트워크 침입 탐지를 위해 설계된 인공 신경망 시스템에 대한 연구가 진행 중이다.

인공 신경망은 물리학에서 편미분 방정식을 풀고,[^216][^217][^218] 다체 개방 양자 시스템의 특성을 시뮬레이션하는 도구로 제안되었다.[^219][^220][^221][^222] 뇌 연구에서 인공 신경망은 개별 뉴런의 단기 행동,[^223] 개별 뉴런 간의 상호작용에서 발생하는 신경 회로의 역학, 그리고 완전한 하위 시스템을 나타내는 추상적 신경 모듈에서 행동이 어떻게 발생하는지를 연구해 왔다. 연구들은 개별 뉴런에서 시스템 수준에 이르기까지 신경 시스템의 장기 및 단기 가소성과 학습 및 기억과의 관계를 고려하였다.

객체 인식을 위해 훈련된 인공 신경망을 사용하여 사진으로부터 사용자의 관심사 프로필을 생성하는 것이 가능하다.[^224]

전통적인 응용 분야를 넘어, 인공 신경망은 재료과학과 같은 학제간 연구에서도 점점 더 많이 활용되고 있다. 예를 들어, 그래프 신경망(GNN)은 결정의 총 에너지를 효율적으로 예측함으로써 새로운 안정 물질의 발견을 위한 딥러닝을 확장하는 능력을 입증하였다. 이러한 응용은 예측 모델링과 인공지능의 영역을 넘어 복잡한 문제를 해결하는 데 있어 인공 신경망의 적응성과 잠재력을 보여주며, 과학적 발견과 혁신을 위한 새로운 경로를 열어주고 있다.[^225]

이론적 특성

계산 능력

다층 퍼셉트론은 보편 근사 정리에 의해 증명된 바와 같이 보편 함수 근사기이다. 그러나 이 증명은 필요한 뉴런의 수, 네트워크 토폴로지, 가중치 및 학습 매개변수에 관해서는 구성적이지 않다.

유한한 수의 뉴런과 표준 선형 연결을 사용하는 유리수 가중치(완전 정밀도 실수 가중치와 대비되는)를 가진 특정 순환 구조는 보편 튜링 기계의 능력을 갖는다.[^226] 더 나아가 가중치에 무리수 값을 사용하면 초튜링 능력을 가진 기계가 된다.[^227][^228]

용량

모델의 "용량" 특성은 주어진 임의의 함수를 모델링하는 능력에 해당한다. 이는 네트워크에 저장할 수 있는 정보의 양과 복잡도의 개념에 관련된다. 학계에 알려진 용량의 개념은 두 가지이다. 정보 용량과 VC 차원이다. 퍼셉트론의 정보 용량은 Thomas Cover의 연구를 요약한 David MacKay 경의 저서[^96]에서 집중적으로 논의된다. 표준 뉴런(합성곱이 아닌)으로 구성된 네트워크의 용량은 뉴런을 전기 소자로 이해하는 데서 도출되는 네 가지 규칙[^230]으로 유도할 수 있다. 정보 용량은 임의의 데이터를 입력으로 주었을 때 네트워크가 모델링할 수 있는 함수들을 포착한다. 두 번째 개념은 VC 차원이다. VC 차원은 측도론의 원리를 사용하여 최적의 상황에서 최대 용량을 구한다. 이는 특정 형태의 입력 데이터가 주어진 경우이다. [^96]에서 언급된 바와 같이, 임의의 입력에 대한 VC 차원은 퍼셉트론 정보 용량의 절반이다. 임의의 점들에 대한 VC 차원은 때때로 기억 용량이라고도 불린다.[^231]

수렴

모델은 항상 단일 해로 수렴하지 않을 수 있는데, 첫째로 비용 함수와 모델에 따라 지역 최솟값이 존재할 수 있기 때문이다. 둘째로 사용된 최적화 방법이 임의의 지역 최솟값에서 멀리 떨어진 곳에서 시작할 때 수렴을 보장하지 못할 수 있다. 셋째로 충분히 큰 데이터나 매개변수의 경우 일부 방법은 비실용적이 된다.

또한 언급할 가치가 있는 문제는 학습 과정에서 안장점을 지날 수 있으며, 이로 인해 수렴이 잘못된 방향으로 이끌릴 수 있다는 것이다.

특정 유형의 인공신경망 구조의 수렴 거동은 다른 것들보다 더 잘 이해되어 있다. 네트워크의 너비가 무한대에 접근할 때, 인공신경망은 학습 전반에 걸쳐 1차 테일러 전개로 잘 설명되며, 따라서 아핀 모델의 수렴 거동을 물려받는다.[^232][^233] 또 다른 예는 매개변수가 작을 때 인공신경망이 종종 목표 함수를 저주파에서 고주파 순으로 적합시키는 것이 관찰된다는 것이다. 이 거동은 신경망의 스펙트럼 편향 또는 주파수 원리라고 불린다.[^234][^235][^236][^237] 이 현상은 야코비 방법과 같은 잘 연구된 일부 반복 수치 기법의 거동과 반대이다. 더 깊은 신경망은 저주파 함수에 대해 더 강한 편향을 보이는 것으로 관찰되었다.[^238]

일반화와 통계

보이지 않는 예제에 대해 잘 일반화하는 시스템을 만드는 것이 목표인 응용 분야는 과적합의 가능성에 직면한다. 이는 네트워크 용량이 필요한 자유 매개변수를 크게 초과하는 복잡하거나 과도하게 지정된 시스템에서 발생한다.

과적합을 해결하는 두 가지 접근법이 있다. 첫 번째는 교차 검증 및 유사한 기법을 사용하여 과적합의 존재를 확인하고 일반화 오류를 최소화하는 하이퍼파라미터를 선택하는 것이다. 두 번째는 어떤 형태의 정규화를 사용하는 것이다. 이 개념은 확률적(베이즈) 프레임워크에서 나타나며, 여기서 정규화는 더 단순한 모델에 대해 더 큰 사전 확률을 선택함으로써 수행될 수 있다. 또한 통계적 학습 이론에서도 나타나며, 여기서 목표는 두 가지 양, 즉 '경험적 위험'과 '구조적 위험'을 최소화하는 것인데, 이는 대략적으로 학습 세트에 대한 오류와 과적합으로 인한 보이지 않는 데이터에서의 예측 오류에 해당한다.

평균 제곱 오차(MSE) 비용 함수를 사용하는 지도 신경망은 학습된 모델의 신뢰도를 결정하기 위해 공식적인 통계적 방법을 사용할 수 있다. 검증 세트에 대한 MSE는 분산의 추정치로 사용될 수 있다. 그런 다음 이 값을 사용하여 정규 분포를 가정하고 네트워크 출력의 신뢰 구간을 계산할 수 있다. 이러한 방식으로 수행된 신뢰도 분석은 출력 확률 분포가 동일하게 유지되고 네트워크가 수정되지 않는 한 통계적으로 유효하다.

범주형 목표 변수에 대해 신경망의 출력 층(또는 구성 요소 기반 네트워크의 소프트맥스 구성 요소)에 로지스틱 함수의 일반화인 소프트맥스 활성화 함수를 할당함으로써, 출력을 사후 확률로 해석할 수 있다. 이는 분류에서 유용한데, 분류에 대한 확신도 측정을 제공하기 때문이다.

소프트맥스 활성화 함수는 다음과 같다:

y_i=\frac{e^{x_i}}{\sum_{j=1}^c e^{x_j}}

이론

인공신경망의 핵심 주장은 정보 처리를 위한 새롭고 강력한 일반 원리를 구현한다는 것이다. 이러한 원리는 명확하게 정의되어 있지 않다. 이로 인해 단순한 통계적 연관(인공신경망의 기본 기능)이 학습이나 인식으로 묘사될 수 있게 된다. 1997년, 전 Scientific American 칼럼니스트인 Alexander Dewdney는 그 결과 인공신경망이 Dewdney에 대한 한 가지 반론은 신경망이 자율 비행 항공기^242에서 신용카드 사기 탐지, 바둑 정복에 이르기까지 많은 복잡하고 다양한 과제를 성공적으로 처리하는 데 사용되어 왔다는 것이다.

기술 저술가 Roger Bridgman은 다음과 같이 논평했다:

인공신경망이 학습한 내용을 분석하는 것이 어렵다는 것은 사실이지만, 생물학적 신경망이 학습한 내용을 분석하는 것보다는 훨씬 쉽다. 더욱이, 최근 인공지능의 설명 가능성에 대한 강조는 특히 주의 메커니즘에 기반한 방법론의 발전에 기여하여, 학습된 신경망을 시각화하고 설명하며 회로가 주어진 목표에 도달하기 위해 어떻게 연결되는지 분해하는 데 이바지했다[^97]. 또한, 신경망의 학습 알고리즘을 탐구하는 연구자들은 학습 기계가 성공할 수 있게 하는 일반적 원리를 점차 밝혀내고 있다. 예를 들어, Bengio와 LeCun(2007)은 지역적 학습 대 비지역적 학습, 그리고 얕은 구조 대 깊은 구조에 관한 논문을 발표했다.[^244]

생물학적 뇌는 뇌 해부학에서 보고된 바와 같이 얕은 회로와 깊은 회로를 모두 사용하며,[^98] 다양한 불변성을 보여준다. Weng^99은 뇌가 주로 신호 통계에 따라 자체 배선되므로 직렬 캐스케이드로는 모든 주요 통계적 의존성을 포착할 수 없다고 주장했다.

하드웨어

크고 효과적인 신경망은 상당한 컴퓨팅 자원을 필요로 한다.[^100] 뇌에는 뉴런 그래프를 통해 신호를 처리하는 작업에 맞춤화된 하드웨어가 있지만, 폰 노이만 아키텍처에서 단순화된 뉴런 하나를 시뮬레이션하는 것만으로도 막대한 양의 메모리와 저장 공간을 소비할 수 있다. 더 나아가, 설계자는 종종 이러한 많은 연결과 관련 뉴런을 통해 신호를 전송해야 하며, 이는 엄청난 CPU 연산 능력과 시간을 필요로 한다.

일부에서는 21세기 신경망의 부활이 주로 하드웨어의 발전에 기인한다고 주장한다: 1991년부터 2015년까지 컴퓨팅 성능, 특히 GPGPU(GPU 기반)가 제공하는 성능이 약 백만 배 증가하여, 이전보다 여러 층 더 깊은 네트워크를 훈련하기 위한 표준 역전파 알고리즘이 실현 가능해졌다.[^51] FPGA 및 GPU와 같은 가속기의 사용은 훈련 시간을 수개월에서 수일로 단축할 수 있다.[^245]

신경형태 공학 또는 물리적 신경망은 비폰 노이만 칩을 구축하여 회로에 직접 신경망을 구현함으로써 하드웨어의 어려움을 직접적으로 해결한다. 신경망 처리에 최적화된 또 다른 유형의 칩은 텐서 처리 장치, 즉 TPU라고 불린다.[^246]

실용적 반례

인공신경망이 학습한 내용을 분석하는 것은 생물학적 신경망이 학습한 내용을 분석하는 것보다 훨씬 쉽다. 더 나아가, 신경망의 학습 알고리즘을 탐구하는 연구자들은 학습 기계가 성공할 수 있게 하는 일반적 원리를 점차 밝혀내고 있다. 예를 들어, 지역적 학습 대 비지역적 학습, 그리고 얕은 구조 대 깊은 구조 등이 있다.[^247]

하이브리드 접근법

하이브리드 모델(신경망과 기호적 접근법의 결합)의 지지자들은 이러한 혼합이 인간 마음의 메커니즘을 더 잘 포착할 수 있다고 주장한다.[^248][^249]

데이터셋 편향

신경망은 훈련 데이터의 품질에 의존하므로, 불균형한 대표성을 가진 저품질 데이터는 모델이 사회적 편향을 학습하고 영속시키는 결과를 초래할 수 있다.[^101][^102] 이러한 상속된 편향은 특정 인종, 성별 또는 기타 속성에 대한 데이터의 희소성으로 인해 훈련 데이터가 불균형할 수 있는 실제 시나리오에 인공신경망이 통합될 때 특히 심각해진다.[^101] 이러한 불균형은 모델이 소외 집단에 대한 부적절한 표현과 이해를 갖게 하여, 특히 얼굴 인식, 채용 과정, 법 집행과 같은 응용 분야에서 사회적 불평등을 악화시키는 차별적 결과를 초래할 수 있다.[^102][^103] 예를 들어, 2018년 Amazon은 해당 분야의 남성 근로자 수가 더 많아 소프트웨어 엔지니어링 직종에서 모델이 여성보다 남성을 선호했기 때문에 채용 도구를 폐기해야 했다.[^103] 이 프로그램은 "여성"이라는 단어나 여자 대학 이름이 포함된 이력서에 불이익을 주었다. 그러나 합성 데이터의 사용은 데이터셋 편향을 줄이고 데이터셋의 대표성을 높이는 데 도움이 될 수 있다.[^250]

역사적 기반과 다트머스 제안

인공신경망은 1955년 다트머스 인공지능 여름 연구 프로젝트 제안서에서 인공지능 연구의 유망한 방향으로 확인되었다.[^251] 이 제안서에서 연구자들은 "뉴런 네트"로 묘사된 생물학적 뉴런의 단순화된 계산 모델이 기계가 학습하고, 개념을 형성하며, 경험을 통해 성능을 향상시킬 수 있게 해줄 것이라고 제안했다.

초기 신경망 연구는 Warren McCulloch와 Walter Pitts의 이전 이론적 연구에 영향을 받았으며, 이들은 논리 함수를 표현할 수 있는 인공 뉴런의 수학적 모델을 개발했다.[^252]

이러한 초기의 가능성에도 불구하고, 신경망 모델은 인공지능 연구의 초기 수십 년 동안 주요 한계에 직면했다. 하드웨어 제약이 네트워크 규모와 훈련 효율성을 제한했고, 학습 알고리즘에 대한 이론적 이해도 불완전했다. 많은 초기 모델은 선형 분리 가능한 문제만 해결할 수 있는 단층 퍼셉트론에 의존했다. 이러한 한계는 Marvin Minsky와 Seymour Papert의 저서 퍼셉트론에서 강조되었으며, 이는 1960년대 후반과 1970년대에 신경망 연구에 대한 관심 감소에 기여했다.[^253]

현대의 부활

신경망에 대한 관심은 1980년대에 역전파 알고리즘의 개발과 함께 되살아났으며, 이 알고리즘은 네트워크 계층을 통해 오류 기울기를 역방향으로 전파하여 다층 신경망을 효율적으로 훈련할 수 있게 했다.[^254]

컴퓨팅 성능의 발전, 특히 그래픽 처리 장치(GPU)의 사용과 대규모 데이터셋의 가용성은 21세기 초 신경망 연구를 더욱 가속화했다. 이러한 발전은 복잡한 데이터로부터 계층적 표현을 학습할 수 있는 심층 신경망의 훈련을 가능하게 했다.

합성곱 신경망(CNN)과 같은 아키텍처 혁신은 컴퓨터 비전 작업에서의 성능을 크게 향상시켰고, 순환 신경망(RNN)은 음성 및 시계열 정보와 같은 순차적 데이터의 모델링을 가능하게 했다. 더 최근에는 트랜스포머 아키텍처가 신경망이 데이터 내 장거리 의존성을 모델링할 수 있게 하는 주의 메커니즘을 도입하여 현대 대규모 언어 모델의 기반이 되었다.[^255]

응용

인공신경망은 현재 자연어 처리, 컴퓨터 비전, 음성 인식, 자율 시스템을 포함한 많은 인공지능 시스템의 핵심을 이루고 있다.[^256]

신경망은 또한 이상 탐지, 악성코드 분류, 침입 탐지와 같은 사이버 보안 작업에도 널리 적용된다. 정상적인 시스템 또는 네트워크 행동의 패턴을 학습함으로써, 신경 모델은 악의적 활동을 나타낼 수 있는 이탈을 식별할 수 있다.[^257]

한계

성공에도 불구하고, 신경망은 여러 가지 도전 과제를 제시한다. 많은 딥러닝 모델은 불투명한 "블랙박스" 시스템으로 작동하여 내부 의사결정 과정을 해석하기 어렵게 만든다. 신경망은 또한 적대적 예제에 취약할 수 있으며, 입력 데이터에 대한 작은 교란이 잘못된 예측을 유발할 수 있다.

이러한 우려는 설명 가능한 인공지능(XAI), 강건한 기계 학습, 그리고 신경 학습과 기호적 추론을 결합한 하이브리드 인공지능 접근법에 대한 연구 증가로 이어졌다.

갤러리

이미지 처리

이미지 처리 분야에서 인공 신경망은 이미지 분류, 객체 인식, 이미지 분할 등의 작업에 사용된다. 예를 들어, 심층 합성곱 신경망(CNN)은 손글씨 숫자 인식에서 중요한 역할을 하며 최첨단 성능을 달성하였다.[^104] 이는 인공 신경망이 복잡한 시각 정보를 효과적으로 처리하고 해석할 수 있는 능력을 보여주며, 자동화된 감시 시스템에서 의료 영상에 이르기까지 다양한 분야의 발전으로 이어지고 있다.[^104]

음성 인식

인공 신경망은 음성 신호를 모델링함으로써 화자 식별 및 음성-텍스트 변환과 같은 작업에 사용된다. 심층 신경망 아키텍처는 대규모 어휘 연속 음성 인식에서 상당한 개선을 도입하여 기존 기술을 능가하는 성능을 보였다.[^104][^105] 이러한 발전은 더 정확하고 효율적인 음성 활성화 시스템의 개발을 가능하게 하여 기술 제품의 사용자 인터페이스를 향상시켰다.

자연어 처리

자연어 처리에서 인공 신경망은 텍스트 분류, 감성 분석, 기계 번역 등의 작업에 사용된다. 인공 신경망은 언어 간 정확한 번역, 텍스트 데이터의 맥락과 감성 이해, 내용에 기반한 텍스트 분류가 가능한 모델의 개발을 가능하게 하였다.[^104][^105] 이는 자동화된 고객 서비스, 콘텐츠 검수, 언어 이해 기술에 시사점을 제공한다.[^258]

제어 시스템

제어 시스템 분야에서 인공 신경망은 시스템 식별, 제어 설계, 최적화 등의 작업을 위해 동적 시스템을 모델링하는 데 사용된다. 예를 들어, 심층 순방향 신경망은 시스템 식별 및 제어 응용에서 중요한 역할을 한다.[^259]

금융

인공 신경망은 주식 시장 예측과 신용 평가에 사용된다: *투자 분야에서 인공 신경망은 방대한 양의 금융 데이터를 처리하고, 복잡한 패턴을 인식하며, 주식 시장 동향을 예측하여 투자자와 리스크 관리자가 정보에 기반한 의사결정을 내리는 데 도움을 준다.[^104] *신용 평가에서 인공 신경망은 데이터 기반의 개인화된 신용도 평가를 제공하여 채무 불이행 예측의 정확성을 높이고 대출 프로세스를 자동화한다.[^105] 인공 신경망은 고품질 데이터와 세밀한 튜닝이 필요하며, "블랙박스" 특성으로 인해 해석에 어려움이 있을 수 있다. 그럼에도 불구하고, 지속적인 발전은 인공 신경망이 금융 분야에서 계속 역할을 수행하며 귀중한 통찰력을 제공하고 리스크 관리 전략을 강화하고 있음을 시사한다.

의학

인공 신경망은 방대한 의료 데이터 세트를 처리하고 분석할 수 있다. 특히 조기 질병 발견을 위한 복잡한 의료 영상 해석과 개인 맞춤형 치료 계획을 위한 환자 결과 예측을 통해 진단 정확도를 향상시킨다.[^105] 신약 개발에서 인공 신경망은 잠재적 약물 후보 물질의 식별을 가속화하고 그 효능과 안전성을 예측하여 개발 시간과 비용을 크게 줄인다.[^104] 또한, 개인 맞춤형 의료 및 의료 데이터 분석에의 적용은 맞춤형 치료와 효율적인 환자 관리를 가능하게 한다.[^105] 현재 진행 중인 연구는 데이터 프라이버시 및 모델 해석 가능성과 같은 남아있는 과제를 해결하고 의학에서의 인공 신경망 응용 범위를 확대하는 것을 목표로 하고 있다.

콘텐츠 생성

생성적 적대 신경망(GAN) 및 트랜스포머와 같은 인공 신경망은 수많은 산업 분야에서 콘텐츠 생성에 사용된다.[^106] 이는 딥러닝 모델이 방대한 데이터 세트에서 예술가나 음악가의 스타일을 학습하고 완전히 새로운 예술 작품과 음악 작곡을 생성할 수 있기 때문이다. 예를 들어, DALL-E는 인터넷상의 6억 5천만 쌍의 이미지와 텍스트로 훈련된 심층 신경망으로, 사용자가 입력한 텍스트를 기반으로 예술 작품을 생성할 수 있다.[^260] 음악 분야에서는 AIVA와 Jukedeck과 같은 기업을 통해 트랜스포머가 광고 및 다큐멘터리용 오리지널 음악을 제작하는 데 사용된다.[^261] 마케팅 산업에서는 생성 모델이 소비자를 위한 개인화된 광고를 만드는 데 사용된다.[^106] 또한, 주요 영화 회사들은 영화의 재정적 성공을 분석하기 위해 기술 회사와 협력하고 있으며, 2020년에 설립된 Warner Bros와 기술 회사 Cinelytic의 파트너십이 그 예이다.[^262] 나아가, 신경망은 비플레이어 캐릭터(NPC)가 현재 게임에 있는 모든 캐릭터를 기반으로 의사결정을 내릴 수 있는 비디오 게임 제작에서도 활용되고 있다.[^263]

같이 보기

- ADALINE

- 오토인코더

- 생물 영감 컴퓨팅

- 블루 브레인 프로젝트

- 파국적 간섭

- 인지 아키텍처

- 연결주의 전문가 시스템

- 커넥토믹스

- 딥 이미지 프라이어

- 디지털 형태 형성

- 효율적 갱신 가능 신경망

- 진화 알고리즘

- 곡선족

- 유전 알고리즘

- 초차원 컴퓨팅

- 현장 적응형 표 작성

- 신경망의 대폭 극한

- 기계 학습 개념 목록

- 멤리스터

- 마인드 업로딩

- 신경 가스

- 신경망 소프트웨어

- 광학 신경망

- 병렬 분산 처리

- 인공지능의 철학

- 예측 분석

- 양자 신경망

- 서포트 벡터 머신

- 스파이킹 신경망

- 확률적 앵무새

- 텐서곱 네트워크

- 위상적 딥러닝

참고 문헌

-

-

-

- **미국 국립과학재단(계약 번호 EET-8716324) 및 미국 방위고등연구계획국(DOD), ARPA 명령 번호 4976, 계약 F33615-87-C-1499에 의해 작성됨.

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

외부 링크

-

-

-

-

-

-

-

-

-

-

-

-

- 신경망 개론 (D. Kriesel) – 인공 신경망에 관한 삽화가 포함된 이중 언어 원고; 현재까지의 주제: 퍼셉트론, 역전파, 방사 기저 함수, 순환 신경망, 자기 조직화 지도, 홉필드 네트워크. *재료과학에서의 신경망 리뷰 *세 가지 언어로 된 인공 신경망 튜토리얼 (마드리드 공과대학교) *또 다른 인공 신경망 입문 *차세대 신경망 – 구글 테크 토크 *신경망의 성능 *신경망과 정보

-

참고 문헌

[^1]: Vapnik, Vladimir N.. 통계적 학습 이론의 본질. Springer

[^2]: 딥러닝. MIT Press

[^3]: Mansfield Merriman, "최소제곱법에 관한 저술 목록"

[^4]: Stigler, Stephen M.. 가우스와 최소제곱법의 발명

[^5]: Bretscher, Otto. 응용 선형대수학. Prentice Hall

[^6]: Stigler, Stephen M.. 통계학의 역사: 1900년 이전의 불확실성 측정. Harvard

[^7]: Olazaran, Mikel. 퍼셉트론 논쟁의 공식 역사에 대한 사회학적 연구

[^8]: Joseph, R. D.. 퍼셉트론 이론에 대한 기여, Cornell 항공연구소 보고서 No. VG-11 96--G-7, Buffalo

[^9]: 인공지능: 현대적 접근. Pearson Education

[^10]: Rosenblatt, Frank. 신경역학의 원리. Spartan, New York

[^11]: Ivakhnenko, A. G.. 사이버네틱스와 예측 기법. American Elsevier Publishing Co.

[^12]: Ivakhnenko, Alexey. 복잡 시스템의 다항식 이론. (1971)

[^13]: Schmidhuber, Jürgen. 현대 AI와 딥러닝의 주석이 달린 역사. (2022)

[^14]: Cite journal last1 = Robbins first1 = H. author-link = Herbert Robbins last2 = Monro first2 = S. doi = 10.1214/aoms/1177729586 title = 확률적 근사 방법 journal = The An

[^15]: Amari, Shun'ichi. 적응적 패턴 분류기 이론. (1967)

[^16]: Fukushima, K.. 아날로그 임계 소자의 다층 네트워크에 의한 시각 특징 추출. (1969)

[^17]: cite journal last1 = Sonoda first1 = Sho last2=Murata first2=Noboru s2cid = 12149203 year = 2017 title = 비유계 활성화 함수를 가진 신경망은 범용 근사기이다 jo

[^18]: Minsky, Marvin. 퍼셉트론: 계산 기하학 입문. MIT Press

[^19]: Fukushima, K.. 위치 이동에 영향받지 않는 패턴 인식 메커니즘을 위한 신경망 모델—네오코그니트론

[^20]: Fukushima, K.. 네오코그니트론: 위치 이동에 영향받지 않는 패턴 인식 메커니즘을 위한 자기 조직화 신경망 모델

[^21]: Leibniz, Gottfried Wilhelm Freiherr von. 라이프니츠의 초기 수학 원고: Carl Immanuel Gerhardt가 출판한 라틴어 텍스트로부터의 번역과 비평적·역사적 주석 (라이프니츠는 1676년 논문에서 연쇄법칙을 발표하였다). Open court publishing Company. (1920)

[^22]: Kelley, Henry J.. 최적 비행 경로의 기울기 이론

[^23]: Linnainmaa, Seppo. 알고리즘의 누적 반올림 오차를 국소 반올림 오차의 테일러 전개로 표현하기. University of Helsinki

[^24]: Linnainmaa, Seppo. 누적 반올림 오차의 테일러 전개

[^25]: Ostrovski, G.M., Volin,Y.M., and Boris, W.W. (1971). 도함수의 계산에 관하여. Wiss. Z. Tech. Hochschule for Chemistry, 13:382–384.

[^26]: Werbos, Paul. 시스템 모델링과 최적화. Springer

[^27]: 말하는 네트워크: 신경망의 구술 역사. The MIT Press. (2000)

[^28]: Werbos, Paul J.. 역전파의 뿌리: 순서화된 미분에서 신경망 및 정치 예측까지. John Wiley & Sons

[^29]: cite web last = Schmidhuber first = Juergen title = 역전파를 누가 발명했는가? author-link = Juergen Schmidhuber publisher = IDSIA, Switzerland url = https://people.idsia.ch/~juergen/wh

[^30]: Waibel, Alex. 시간 지연 신경망을 이용한 음소 인식. (December 1987)

[^32]: Zhang, Wei. 이동 불변 패턴 인식 신경망과 그 광학적 구조. (1988)

[^33]: LeCun ''et al.'', "손글씨 우편번호 인식에 적용된 역전파", ''Neural Computation'', 1, pp. 541–551, 1989.

[^34]: Zhang, Wei. 국소 공간 불변 상호연결을 가진 병렬 분산 처리 모델과 그 광학적 구조. (1990)

[^35]: LeCun, Yann. 문서 인식에 적용된 기울기 기반 학습

[^36]: Qian, Ning, and Terrence J. Sejnowski. "신경망 모델을 이용한 구형 단백질의 이차 구조 예측." ''Journal of molecular biology'' 202, no. 4 (1988): 865–884.

[^37]: Bohr, Henrik, Jakob Bohr, Søren Brunak, Rodney MJ Cotterill, Benny Lautrup, Leif Nørskov, Ole H. Olsen, and Steffen B. Petersen. "신경망에 의한 단백질 이차 구조 및 상동성: α-나선

[^38]: Rost, Burkhard, and Chris Sander: "70% 이상의 정확도로 단백질 이차 구조 예측." ''Journal of molecular biology'' 232, no. 2 (1993): 584–599.

[^39]: Hopfield, J. J.. 창발적 집합 계산 능력을 가진 신경망과 물리적 시스템. (1982)

[^40]: McCulloch, Warren S.. 신경 활동에 내재된 관념의 논리적 계산. (December 1943)

[^41]: Bozinovski, S. (1982). "이차 강화를 사용하는 자기 학습 시스템". In Trappl, Robert (ed.). Cybernetics and Systems Research: Proceedings of the Sixth European Meeting on Cybernetics and S

[^42]: Schmidhuber, Jürgen. 신경 시퀀스 청커. (April 1991)

[^43]: Schmidhuber, Jürgen. 역사 압축 원리를 이용한 복잡하고 확장된 시퀀스 학습 (TR FKI-148, 1991 기반)

[^45]: Hochreiter, S.. 동적 순환 네트워크 현장 가이드. John Wiley & Sons. (15 January 2001)

[^46]: Hochreiter, Sepp. 장단기 메모리. (1 November 1997)

[^47]: Gers, Felix. 제9회 인공 신경망 국제 학술대회: ICANN '99

[^48]: Hinton, Geoffrey E.. 비지도 신경망을 위한 깨우기-수면 알고리즘. (26 May 1995)

[^49]: Cireşan, Dan Claudiu. 손글씨 숫자 인식을 위한 깊고, 크고, 단순한 신경망. (21 September 2010)

[^50]: Ciresan, D. C.. 이미지 분류를 위한 유연하고 고성능인 합성곱 신경망. (2011)

[^51]: Schmidhuber, J.. 신경망에서의 딥러닝: 개관

[^52]: Ciresan, Dan. 신경 정보 처리 시스템의 발전 25. Curran Associates, Inc.. (2012)

[^53]: Ciresan, D.. 의료 영상 컴퓨팅 및 컴퓨터 지원 중재 – MICCAI 2013. (2013)

[^54]: Ciresan, D.. 2012 IEEE 컴퓨터 비전 및 패턴 인식 학술대회

[^55]: Krizhevsky, Alex. 심층 합성곱 신경망을 이용한 ImageNet 분류. (2012)

[^56]: Simonyan, Karen. 대규모 이미지 인식을 위한 매우 깊은 합성곱 네트워크

[^57]: Szegedy, Christian. 합성곱으로 더 깊이. (2015)

[^58]: Ng, Andrew. 대규모 비지도 학습을 이용한 고수준 특징 구축

[^59]: Goodfellow, Ian. 생성적 적대 신경망

[^60]: cite conference title = 모델 구축 신경 제어기에서 호기심과 지루함을 구현하기 위한 가능성 last1 = Schmidhuber first1 = Jürgen author-link = Jürgen Schmidhuber date = 1

[^61]: Schmidhuber, Jürgen. 생성적 적대 신경망은 인공 호기심(1990)의 특수한 경우이며 예측 가능성 최소화(1991)와도 밀접하게 관련된다. (2020)

[^62]: GAN 2.0: NVIDIA의 초현실적 얼굴 생성기. (14 December 2018)

[^63]: Karras, T.. 향상된 품질, 안정성 및 다양성을 위한 GAN의 점진적 성장. (26 February 2018)

[^64]: He, Kaiming. 정류기 심층 분석: ImageNet 분류에서 인간 수준의 성능 초월

[^65]: He, Kaiming. 이미지 인식을 위한 심층 잔차 학습. (10 December 2015)

[^66]: Srivastava, Rupesh Kumar. 하이웨이 네트워크. (2 May 2015)

[^67]: He, Kaiming. 2016 IEEE 컴퓨터 비전 및 패턴 인식 학술대회 (CVPR). IEEE. (2016)

[^68]: Vaswani, Ashish. 어텐션이 전부다. (12 June 2017)

[^69]: Schmidhuber, Jürgen. 빠른 가중치 메모리 제어 학습: 순환 네트워크의 대안. (1992)

[^70]: Katharopoulos, Angelos. 트랜스포머는 RNN이다: 선형 어텐션을 가진 빠른 자기회귀 트랜스포머. PMLR. (2020)

[^71]: Schlag, Imanol. 선형 트랜스포머는 사실상 빠른 가중치 프로그래머이다. Springer. (2021)

[^72]: Wolf, Thomas. 2020 자연어 처리에서의 경험적 방법론 학술대회 논문집: 시스템 시연

[^73]: Zell, Andreas. 신경망 시뮬레이션. Addison-Wesley. (2003)

[^74]: 인공지능. Addison-Wesley Pub. Co

[^75]: Abbod, Maysam F.. 비뇨기과 암 관리에 대한 인공지능의 적용

[^76]: Dawson, Christian W.. 강우-유출 모델링에 대한 인공 신경망 접근법

[^77]: Ciresan, Dan. 이미지 분류를 위한 유연하고 고성능인 합성곱 신경망

[^78]: Zell, Andreas. 신경망 시뮬레이션. Addison-Wesley

[^79]: Hinton, G. E.. 제한 볼츠만 머신 훈련을 위한 실용 가이드. (2010)

[^80]: Ackley, David H.. 볼츠만 머신을 위한 학습 알고리즘. (1985)

[^81]: RLS 기반 CMAC의 학습 알고리즘. (2004)

[^82]: 연속 CMAC-QRLS와 그 시스톨릭 배열. (2005)

[^84]: Hochreiter, Sepp. 장단기 메모리. (1 November 1997)

[^85]: Sak, Hasim. 대규모 음향 모델링을 위한 장단기 메모리 순환 신경망 구조. (2014)

[^86]: Li, Xiangang. 대규모 어휘 음성 인식을 위한 장단기 메모리 기반 심층 순환 신경망 구축. (15 October 2014)

[^87]: Schmidhuber, Jürgen. 딥러닝

[^88]: Zen, Heiga. 저지연 음성 합성을 위한 순환 출력 레이어를 가진 단방향 장단기 메모리 순환 신경망. ICASSP. (2015)

[^89]: Fan, Bo. 심층 양방향 LSTM을 이용한 사실적 말하는 얼굴. (2015)

[^90]: Silver, David. 일반 강화 학습 알고리즘을 이용한 자가 대국으로 체스와 장기 마스터하기. (5 December 2017)

[^91]: Claesen, Marc. 기계학습에서의 하이퍼파라미터 탐색. (2015)

[^92]: Billings, S. A.. 비선형 시스템 식별: 시간, 주파수 및 시공간 영역에서의 NARMAX 방법. Wiley

[^93]: 신경망 기계 시각 입문. (March 2007)

[^94]: 양자 화학 데이터에 대한 신경망 접근법: 밀도 범함수 이론 에너지의 정확한 예측

[^95]: Ciaramella, Alberto. 인공지능 입문: 데이터 분석에서 생성형 AI까지. Intellisemantic Editions. (2024)

[^96]: cite book last=MacKay first=David J.C. author-link=David J.C. MacKay year=2003 publisher=[[Cambridge University Press]] isbn=978-0-521-64298-9 title=정보 이론, 추론, 그리고 학습 알고리즘

[^97]: Lindsey, Jack. 대규모 언어 모델의 생물학에 관하여. Anthropic. (2025-03-27)

[^98]: D. J. Felleman and D. C. Van Essen, "[https://archive.today/20150120022056/http://cercor.oxfordjournals.org/content/1/1/1.1.full.pdf+html 영장류 대뇌 피질의 분산 계층 처리

[^100]: Edwards, Chris. 딥러닝의 성장통. (25 June 2015)

[^101]: Norori, Natalia. 의료 분야의 빅데이터와 AI에서의 편향 해결: 오픈 사이언스를 위한 요청. (October 2021)

[^102]: Carina, Wang. 얼굴 인식의 실패: 편향된 안면 인식 기술이 형사 사법에서의 인종 차별에 미치는 영향. (27 October 2022)

[^103]: Chang, Xinyu. 채용에서의 성별 편향: 아마존 채용 알고리즘의 영향 분석. (13 September 2023)

[^104]: Huang, Yanbo. 인공 신경망의 발전 – 방법론적 발전과 응용. (2009)

[^105]: Kariri, Elham. 인공 신경망의 발전과 미래 연구 방향 탐색: 텍스트 마이닝 접근법. (2023)

[^106]: Fui-Hoon Nah, Fiona. 생성형 AI와 ChatGPT: 응용, 과제, 그리고 AI-인간 협업. (3 July 2023)

[^107]: Hardesty, Larry. 해설: 신경망. MIT News Office. (14 April 2017)

[^108]: Yang, Z.R.. 종합 생의학 물리학. Elsevier. (2014)

[^109]: Bishop, Christopher M.. 패턴 인식과 기계학습. Springer. (17 August 2006)

[^110]: 아기를 위한 신경망. Sourcebooks

[^111]: Kleene, S.C.. 신경망과 유한 오토마타에서의 사건 표현. Princeton University Press

[^112]: Hebb, Donald. 행동의 조직화. Taylor & Francis

[^113]: Farley, B.G.. 디지털 컴퓨터에 의한 자기 조직화 시스템의 시뮬레이션

[^114]: Rochester, N.. 대형 디지털 컴퓨터를 이용한 세포 집합 이론의 두뇌 작용에 대한 시험

[^115]: Haykin (2008) 신경망과 학습 기계, 제3판

[^116]: Rosenblatt, F.. 퍼셉트론: 뇌에서의 정보 저장 및 조직화를 위한 확률적 모델

[^117]: Rosenblatt, Frank. 퍼셉트론—인식하고 인지하는 자동 장치. Cornell Aeronautical Laboratory

[^118]: Ivakhnenko, A.G.. 공학 사이버네틱스 문제에서의 발견적 자기 조직화. (March 1970)

[^119]: Ramachandran, Prajit. 활성화 함수 탐색. (16 October 2017)

[^120]: Bozinovski S. and Fulgosi A. (1976). "패턴 유사성과 전이 학습이 기본 퍼셉트론 훈련에 미치는 영향" (크로아티아어 원본) Proceedings of Symposium Informatica 3-121-5, Bl

[^121]: Bozinovski S.(2020) "1976년 신경망에서의 전이 학습에 관한 최초 논문의 회고". Informatica 44: 291–302.

[^122]: Rumelhart, David E.. 오류 역전파를 통한 표현 학습. (October 1986)

[^123]: Fukushima, Kunihiko. 네오코그니트론: 변형과 위치 이동에 강건한 패턴 인식을 위한 새로운 알고리즘. (1 January 1982)

[^124]: Zhang, Wei. 학습 네트워크 기반 인간 각막 내피 영상 처리. (1991)

[^125]: Zhang, Wei. 이동 불변 인공 신경망을 이용한 디지털 유방촬영에서의 미세 석회화 군집 컴퓨터 검출. (1994)

[^126]: Amari, S.-I.. 임계 소자의 자기 조직화 네트워크에 의한 패턴 및 패턴 시퀀스 학습. (November 1972)

[^127]: Espinosa-Sanchez, Juan Manuel. 사이버네틱스 탄생에 대한 Cajal과 Lorente de Nó의 신경과학의 중요성. (5 July 2023)

[^128]: 반향 회로

[^129]: Zajonc, R.. 감정과 사고: 선호는 추론을 필요로 하지 않는다

[^130]: Lazarus R. (1982) "감정과 인지 사이의 관계에 대한 고찰" American Psychologist 37 (9): 1019-1024

[^132]: Cite Q Q98967430

[^133]: Ackley, David H.. 볼츠만 머신을 위한 학습 알고리즘. (1 January 1985)

[^134]: Smolensky, Paul. 병렬 분산 처리: 인지의 미세 구조 탐구, 제1권: 기초. MIT Press

[^136]: 생물학에서 영감을 받은 딥러닝이 경쟁에서 계속 우승하는 방법 {{!

[^137]: 당황하지 말고 준비하라: 합성 미디어와 딥페이크. witness.org

[^138]: Sohl-Dickstein, Jascha. 비평형 열역학을 이용한 심층 비지도 학습. PMLR. (1 June 2015)

[^139]: Simonyan, Karen. 대규모 이미지 인식을 위한 매우 깊은 합성곱 네트워크. (10 April 2015)

[^140]: Linn, Allison. 마이크로소프트 연구원들이 ImageNet 컴퓨터 비전 챌린지에서 우승하다. (10 December 2015)

[^141]: 기계학습 사전

[^142]: Miljanovic, Milos. 시계열 예측에서 순환 및 유한 충격 응답 신경망의 비교 분석. (February–March 2012)

[^143]: 하이퍼파라미터 튜닝이란? IBM. (23 July 2024)

[^144]: Goodfellow, Ian. 딥러닝. The MIT press. (2016)

[^145]: Bischl, Bernd. 하이퍼파라미터 최적화: 기초, 알고리즘, 모범 사례 및 미해결 과제. (March 2023)

[^146]: Kelleher, John D.. 예측 데이터 분석을 위한 기계학습의 기초: 알고리즘, 실습 예제, 사례 연구. The MIT Press. (2020)

[^147]: Wei, Jiakai. 학습률을 잊고, 손실을 감쇠하라. (26 April 2019)

[^148]: Li, Y.. 2009 계산 지능 및 자연 컴퓨팅 국제 학술대회. (1 June 2009)

[^149]: Huang, Guang-Bin. 극한 학습 기계: 이론과 응용

[^150]: Widrow, Bernard. 다층 신경망을 위한 역전파 없는 알고리즘

[^151]: Ollivier, Yann. 역추적 없는 순환 네트워크 훈련

[^152]: (June 2022)

[^153]: Bernard, Etienne. 기계학습 입문. Wolfram Media. (2021)

[^154]: Bernard, Etienne. 기계학습 입문. Wolfram Media. (2021)

[^155]: Bernard, Etienne. 기계학습 입문. Wolfram Media Inc

[^156]: Ojha, Varun Kumar. 피드포워드 신경망의 메타휴리스틱 설계: 20년간의 연구 검토. (1 April 2017)

[^157]: cite conference author = Dominic, S. author2 = Das, R. author3 = Whitley, D. author4 = Anderson, C. date = July 1991 title = 신경망을 위한 유전적 강화 학습 pages = 71

[^158]: Hoskins, J.C.. 인공 신경망과 강화 학습을 통한 공정 제어

[^159]: Bertsekas, D.P.. 신경 동적 프로그래밍. Athena Scientific

[^160]: Secomandi, Nicola. 확률적 수요를 가진 차량 경로 문제에 대한 신경 동적 프로그래밍 알고리즘 비교

[^161]: cite conference author = de Rigo, D. author2 = Rizzoli, A. E. author3 = Soncini-Sessa, R. author4 = Weber, E. author5 = Zenesi, P. year = 2001 title = 효율적인 신경 동적 프로그래밍

[^162]: cite conference author = Damas, M. author2=Salmeron, M. author3=Diaz, A. author4=Ortega, J. author5=Prieto, A. author6=Olivares, G. year = 2000 title = 유전 알고리즘과 신경 동적 프로

[^163]: Deng, Geng. 의학에서의 최적화

[^164]: Bozinovski, S. (1982). "이차 강화를 사용하는 자기 학습 시스템". In R. Trappl (ed.) Cybernetics and Systems Research: Proceedings of the Sixth European Meeting on Cybernetics and Systems

[^166]: cite journal last1 = Bozinovski first1 = Stevo last2 = Bozinovska first2 = Liljana year = 2001 title = 자기 학습 에이전트: 교차 막대 가치 판단에 기반한 감정의 연결주의 이론

[^167]: Salimans, Tim. 강화 학습의 확장 가능한 대안으로서의 진화 전략. (7 September 2017)

[^168]: Such, Felipe Petroski. 심층 신경진화: 유전 알고리즘은 강화 학습을 위한 심층 신경망 훈련의 경쟁력 있는 대안이다. (20 April 2018)

[^169]: 인공지능은 문제를 해결하기 위해 '진화'할 수 있다. (10 January 2018)

[^170]: Turchetti, Claudio. 신경망의 확률적 모델. IOS Press

[^171]: Jospin, Laurent Valentin. 베이지안 신경망 실습—딥러닝 사용자를 위한 튜토리얼. (2022)

[^172]: Cang, Zixuan. TopologyNet: 생체분자 속성 예측을 위한 토폴로지 기반 심층 합성곱 및 다중 작업 신경망. (27 July 2017)

[^173]: 수자원 네트워크 관리에서 신경 동적 프로그래밍을 가속화하기 위한 선택적 개선 기법. IFAC. (January 2005)

[^174]: Ferreira, C.. 응용 소프트 컴퓨팅 기술: 복잡성의 도전. Springer-Verlag

[^175]: 시뮬레이티드 어닐링 기법을 적용한 개선된 PSO 기반 ANN. Elsevier. (July 2005)

[^176]: 인공 신경망과 결합된 입자 군집 최적화 기법을 이용한 강우 예측을 위한 새로운 비모수 회귀 앙상블. Springer. (May 2009)

[^177]: 손글씨 우편번호 인식에 적용된 역전파. (1989)

[^178]: Fan, Y.. 양방향 LSTM 기반 순환 신경망을 이용한 TTS 합성. (2014)

[^179]: Qu, Bo. 2024 IEEE 국제 데이터 마이닝 워크숍 학술대회 (ICDMW). (2024-11-29)

[^180]: Chagahi, Mehdi Hosseini. 사기 탐지를 위한 설명 가능한 AI: CNN, GNN 및 신뢰도 기반 게이팅 메커니즘의 어텐션 기반 앙상블. (2025-02-22)

[^181]: Probst, Philipp. 조정 가능성: 기계학습 알고리즘의 하이퍼파라미터 중요성. (26 February 2018)

[^182]: Zoph, Barret. 강화 학습을 이용한 신경 구조 탐색. (4 November 2016)

[^183]: Auto-keras: 효율적인 신경 구조 탐색 시스템. ACM. (2019)

[^184]: Malinovskaya, Anna. 인공 신경망의 통계적 공정 모니터링. (January 2024)

[^185]: Esch, Robin. 응용수학 핸드북. Springer US. (1990)

[^186]: Sarstedt, Marko. 시장 조사 간결 가이드. Springer Berlin Heidelberg. (2019)

[^187]: Tian, Jie. 2016 IEEE 계산 지능 심포지엄 시리즈 (SSCI). (December 2016)

[^188]: Alaloul, Wesam Salah. 동적 데이터 동화 – 불확실성 극복. (2019)

[^189]: Pal, Madhab. 2013 국제 Oriental COCOSDA 학술대회 및 2013 아시아 음성 언어 연구 평가 학술대회 (O-COCOSDA/CASLRE) 공동 개최. IEEE. (2013)

[^190]: Zissis, Dimitrios. 다수 선박 행동을 인식하고 예측할 수 있는 클라우드 기반 아키텍처. (October 2015)

[^191]: Sengupta, Nandini. 켑스트럼 기반 통계적 특징을 이용한 폐음 분류. (August 2016)

[^193]: Maitra, Durjoy S.. 2015 제13회 국제 문서 분석 및 인식 학술대회 (ICDAR). (August 2015)

[^194]: Gessler, Josef. 임피던스 분광법과 인공 신경망을 적용한 식품 분석 센서. (August 2021)

[^195]: French, Jordan. 시간 여행자의 CAPM

[^196]: Silver, David. 심층 신경망과 트리 탐색을 이용한 바둑 정복

[^197]: Pasick, Adam. 인공지능 용어집: 신경망 및 기타 용어 설명. (27 March 2023)

[^198]: Schechner, Sam. 페이스북, 테러리스트 선전물 차단을 위해 AI 강화. (15 June 2017)

[^199]: Ganesan, N. 인구통계 데이터를 이용한 암 질환 진단에 신경망 적용

[^200]: Bottaci, Leonardo. 별개 기관에서의 대장암 환자 예후 예측에 적용된 인공 신경망. The Lancet

[^201]: Alizadeh, Elaheh. 제르니케 모멘트를 이용한 침습성 암 세포 형태의 체계적 변화 측정. (2016)

[^202]: Lyons, Samanthe. 세포 형태 변화는 쥐에서의 전이 가능성과 상관관계가 있다. (2016)

[^203]: Nabian, Mohammad Amin. 인프라 네트워크의 가속화된 신뢰성 분석을 위한 딥러닝. (28 August 2017)

[^204]: Nabian, Mohammad Amin. 기계학습 기반 대리 모델을 통한 지진 후 교통 네트워크 연결성의 확률적 평가 가속화. (2018)

[^205]: Díaz, E.. 경사 기반암 위 기초의 3차원 탄성 침하 예측을 위한 인공 신경망의 사용. (September 2018)

[^206]: Tayebiyan, A.. 강우-유출 모델링을 위한 인공 신경망

[^207]: Govindaraju, Rao S.. 수문학에서의 인공 신경망. I: 기초 개념. (1 April 2000)

[^208]: Govindaraju, Rao S.. 수문학에서의 인공 신경망. II: 수문학적 응용. (1 April 2000)

[^209]: Peres, D. J.. 신경망과 재분석 바람 데이터를 이용한 유의 파고 기록 확장. (1 October 2015)

[^210]: Dwarakish, G. S.. 연안 공학에서의 신경망 응용 검토. (2013)

[^211]: Ermini, Leonardo. 산사태 취약성 평가에 적용된 인공 신경망. (1 March 2005)

[^212]: Nix, R.. 2017 국제 신경망 합동 학술대회 (IJCNN). (May 2017)

[^213]: 악성 URL 탐지

[^214]: Homayoun, Sajad. BoTShark: 봇넷 트래픽 탐지를 위한 딥러닝 접근법. Springer International Publishing. (2018)

[^215]: Ghosh. 제27회 하와이 국제 시스템 과학 학술대회 HICSS-94 논문집. (January 1994)

[^216]: Ananthaswamy, Anil. 최신 신경망이 세계에서 가장 어려운 방정식을 그 어느 때보다 빠르게 풀다. (19 April 2021)

[^217]: AI가 우리 세계를 이해하기 위한 핵심 수학적 퍼즐을 풀었다

[^218]: Alford, Anthony. 칼텍, 편미분 방정식 풀이를 위한 AI 오픈 소스로 공개

[^219]: Nagy, Alexandra. 개방 양자 시스템을 위한 신경망 앤자츠를 이용한 변분 양자 몬테카를로 방법. (28 June 2019)

[^220]: Yoshioka, Nobuyuki. 개방 양자 다체 시스템을 위한 신경 정상 상태 구축. (28 June 2019)

[^221]: Hartmann, Michael J.. 소산 양자 다체 역학에 대한 신경망 접근법. (28 June 2019)

[^222]: Vicentini, Filippo. 개방 양자 시스템의 정상 상태를 위한 변분 신경망 앤자츠. (28 June 2019)

[^223]: 상세 퍼킨제 뉴런 모델 및 400배 이상 빠르게 실행되는 간소화된 대리 모델에서의 알코올 작용 시뮬레이션. (April 2015)

[^224]: cite journal url=https://www.researchgate.net/publication/328964756 doi=10.3233/978-1-61499-894-5-179 last1=Wieczorek first1=Szymon last2=Filipiak first2=Dominik last3=Filipowska first

[^225]: Merchant, Amil. 재료 발견을 위한 딥러닝의 확장. (December 2023)

[^226]: Cite journal title = 신경망을 이용한 튜링 계산 가능성 url = http://www.math.rutgers.edu/~sontag/FTPDIR/aml-turing.pdf year = 1991 journal = Appl. Math. Lett. pages = 77–80 volume = 4

[^227]: Bains, Sunny. 아날로그 컴퓨터가 튜링 모델을 능가하다. (3 November 1998)

[^228]: Balcázar, José. 신경망의 계산 능력: 콜모고로프 복잡도 특성화. (July 1997)

[^229]: Cover, Thomas. 패턴 인식에 응용된 선형 부등식 시스템의 기하학적 및 통계적 속성. [[IEEE]]

[^230]: [[Association for Computing Machinery

[^231]: cite web url=http://tfmeter.icsi.berkeley.edu/ title=조정을 멈추고, 측정을 시작하라! 신경망 실험의 예측 가능한 실험 설계 website=The Tensorflow Meter access-date=10 Marc

[^232]: Lee, Jaehoon. 모든 깊이의 넓은 신경망은 경사 하강법에서 선형 모델로 진화한다

[^233]: 신경 접선 커널: 신경망에서의 수렴과 일반화. (2018)

[^234]: 신경 정보 처리. Springer, Cham. (2019)

[^235]: 신경망의 스펙트럼 편향에 관하여. (2019)

[^236]: 주파수 원리: 푸리에 분석이 심층 신경망을 조명하다

[^237]: 일반 심층 신경망을 위한 주파수 원리의 이론. (2019)

[^238]: Xu, Zhiqin John. 심층 주파수 원리: 더 깊은 학습이 왜 더 빠른지 이해를 향하여. (18 May 2021)

[^239]: Parisi, German I.. 신경망을 이용한 지속적 평생 학습: 검토. (1 May 2019)

[^240]: Dean Pomerleau, "자율 로봇 주행을 위한 인공 신경망의 지식 기반 훈련"

[^241]: Dewdney, A. K.. 그래요, 중성자는 없습니다: 나쁜 과학의 우여곡절을 통한 눈을 뜨게 하는 여행. Wiley. (1 April 1997)

[^243]: Roger Bridgman의 신경망 옹호

[^244]: AI를 향한 학습 알고리즘의 확장

[^245]: Sutton, Rich. 쓰라린 교훈. (March 13, 2019)

[^246]: 구글이 AI 봇을 구동하기 위해 자체 칩을 만들었다. (18 May 2016)

[^247]: AI를 향한 학습 알고리즘의 확장

[^248]: Cite journal last1=Tahmasebi last2=Hezarkhani title=품위 추정을 위한 하이브리드 신경망-퍼지 논리-유전 알고리즘 year=2012 journal=Computers & Geosciences pages=18–27 volume=42

[^249]: Sun and Bookman, 1990

[^250]: Kortylewski, Adam. 2019 IEEE/CVF 컴퓨터 비전 및 패턴 인식 학술대회 워크숍 (CVPRW). IEEE. (June 2019)

[^251]: McCarthy, John. 다트머스 인공지능 하계 연구 프로젝트 제안서

[^252]: McCulloch, Warren. 신경 활동에 내재된 관념의 논리적 계산

[^253]: Minsky, Marvin. 퍼셉트론: 계산 기하학 입문. MIT Press

[^254]: Rumelhart, David. 오류 역전파를 통한 표현 학습

[^255]: Vaswani, Ashish. 어텐션이 전부다

[^256]: Goodfellow, Ian. 딥러닝. MIT Press

[^257]: Buczak, Anna. 사이버 보안 침입 탐지를 위한 데이터 마이닝 및 기계학습 방법 조사

[^258]: Staff, Coursera. 인공 신경망이란 무엇이며, AI에 왜 중요한가?. (2024-09-26)

[^259]: Pillonetto, Gianluigi. 시스템 식별을 위한 심층 네트워크: 조사. (2025-01-01)

[^260]: DALL-E 2의 실패가 가장 흥미로운 점이다 – IEEE Spectrum

[^261]: Briot, Jean-Pierre. 인공 신경망에서 음악 생성을 위한 딥러닝까지: 역사, 개념 및 동향. (January 2021)

[^262]: Chow, Pei-Sze. (할리우드) 기계 속의 유령: 영화 산업에서 인공지능의 신흥 응용. (6 July 2020)

[^263]: Yu, Xinrui. 제3회 정보 과학 및 상호작용 과학 국제 학술대회. IEEE. (June 2010)

관련 인사이트

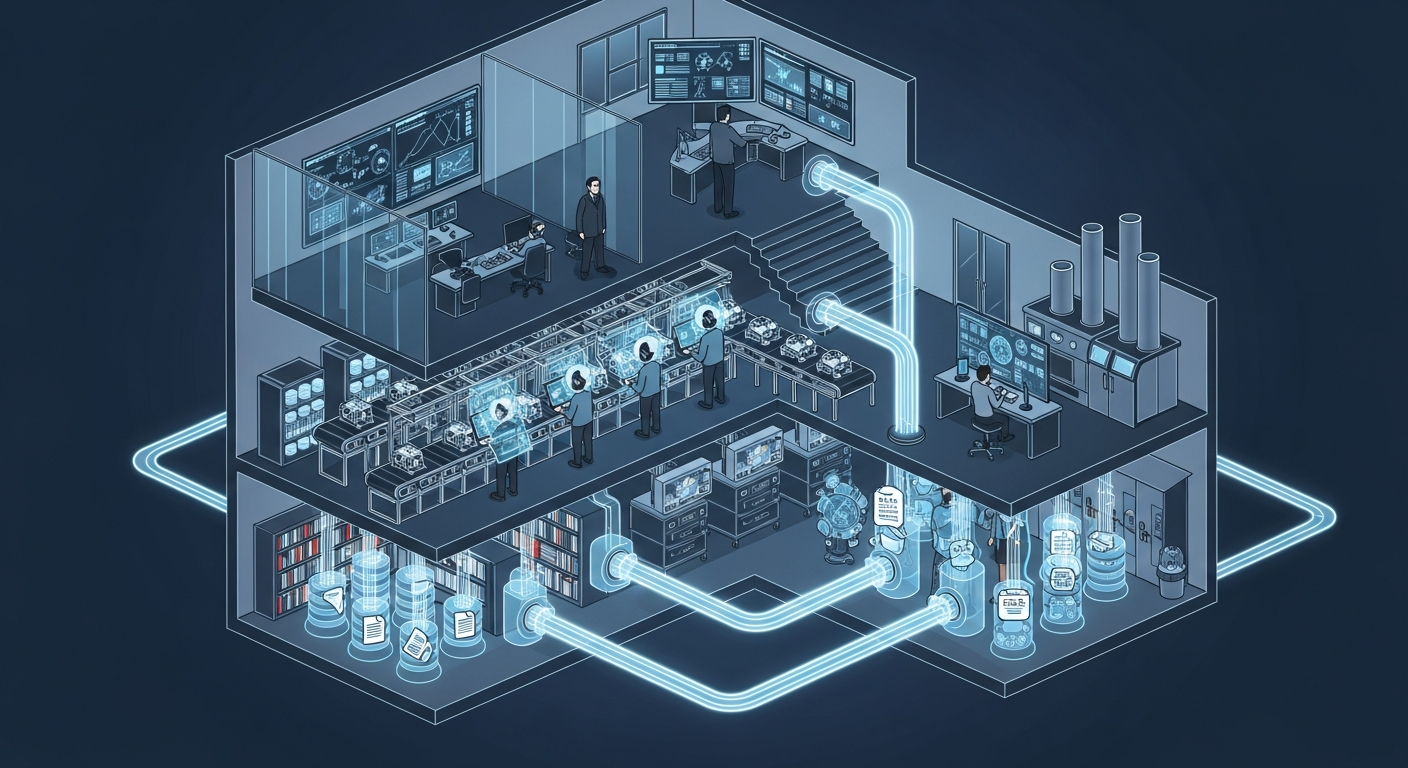

공장의 뇌는 어떻게 생겼는가 — 제조운영 AI 아키텍처 해부

지식관리, 업무자동화, 의사결정지원 — 따로 보면 다 있던 것들입니다. 제조 AI의 진짜 차이는 이 셋이 순환하면서 '우리 공장만의 지능'을 만든다는 데 있습니다.

그 30분을 18년 동안 매일 반복했습니다 — 품질팀장이 본 AI Agent

18년차 품질팀장이 매일 아침 30분씩 반복하던 데이터 분석을 AI Agent가 3분 만에 해냈습니다. 챗봇과는 완전히 다른 물건 — 직접 시스템에 접근해서 데이터를 꺼내고 분석하는 AI의 현장 도입기.

ERP 20년, 나는 왜 AI를 얹기로 했나

ERP 20년차 제조IT본부장의 고백: 3,200만 행의 데이터가 잠들어 있었다. ERP를 바꾸지 않고 AI를 얹자, 일주일 걸리던 불량 분석이 수 초로 줄었다.